Slike, ki jih pc.vector on Freepik

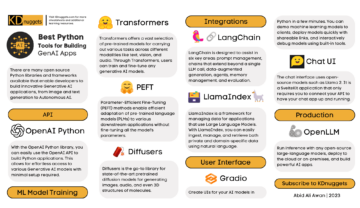

Strojno učenje je veliko področje, kjer se pogosto pojavljajo nove raziskave. To je vroče polje, kjer akademski krogi in industrija nenehno eksperimentirajo z novimi stvarmi za izboljšanje našega vsakdanjega življenja.

V zadnjih letih generativna umetna inteligenca spreminja svet zaradi uporabe strojnega učenja. Na primer ChatGPT in Stable Diffusion. Čeprav leta 2023 prevladuje generativna umetna inteligenca, se moramo zavedati še veliko več prebojev strojnega učenja.

Tukaj so najboljši članki o strojnem učenju, ki jih morate prebrati leta 2023, da ne boste zamudili prihajajočih trendov.

1) Učenje lepote v pesmih: nevronski pevski olepševalec glasu

Polepšanje pevskega glasu (SVB) je nova naloga v generativni AI, katere namen je izboljšati amaterski pevski glas v čudovitega. Prav to je cilj raziskave Liu in sod. (2022) ko so predlagali nov generativni model, imenovan Neural Singing Voice Beautifier (NSVB).

NSVB je model delno nadzorovanega učenja, ki uporablja algoritem za latentno preslikavo, ki deluje kot korektor višine in izboljša vokalni ton. Delo obljublja izboljšanje glasbene industrije in ga je vredno preveriti.

2) Simbolično odkritje optimizacijskih algoritmov

Modeli globokih nevronskih mrež so postali večji kot kdaj koli prej in opravljenih je bilo veliko raziskav za poenostavitev procesa usposabljanja. Nedavna raziskava Googlove ekipe (Chen et al. (2023)) je predlagal novo optimizacijo za nevronsko mrežo, imenovano Lion (EvoLved Sign Momentum). Metoda kaže, da je algoritem pomnilniško učinkovitejši in zahteva manjšo stopnjo učenja kot Adam. To je odlična raziskava, ki kaže veliko obljub, ki jih ne smete zamuditi.

3) TimesNet: Modeliranje časovnih 2D-variacij za splošno analizo časovnih vrst

Analiza časovnih vrst je običajna uporaba v mnogih podjetjih; Na primer, napovedovanje cen, odkrivanje anomalij itd. Vendar pa obstaja veliko izzivov pri analizi časovnih podatkov samo na podlagi trenutnih podatkov (1D podatkov). Zato Wu et al. (2023) predlagajo novo metodo, imenovano TimesNet, za pretvorbo 1D-podatkov v 2D-podatke, ki v poskusu doseže odlično zmogljivost. Preberite članek, da boste bolje razumeli to novo metodo, saj bi pomagala pri analizi časovnih vrst v prihodnosti.

4) OPT: Odpri vnaprej pripravljene jezikovne modele transformatorja

Trenutno smo v generativni dobi AI, kjer so podjetja intenzivno razvijala številne velike jezikovne modele. Večinoma tovrstne raziskave ne bi izdale svojega modela ali pa bi bile le komercialno dostopne. Vendar raziskovalna skupina Meta AI (Zhang in sod. (2022)) poskuša narediti nasprotno z javno objavo modela Open Pre-trained Transformers (OPT), ki bi lahko bil primerljiv z GPT-3. Prispevek je odličen začetek razumevanja modela OPT in podrobnosti raziskave, saj skupina zabeleži vse podrobnosti v prispevek.

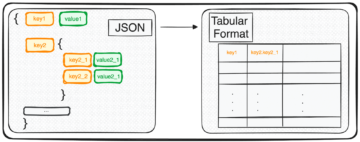

5) REaLTabFormer: Ustvarjanje realističnih relacijskih in tabelarnih podatkov z uporabo transformatorjev

Generativni model ni omejen samo na ustvarjanje besedila ali slik, temveč tudi na tabelarične podatke. Te ustvarjene podatke pogosto imenujemo sintetični podatki. Veliko modelov je bilo razvitih za ustvarjanje sintetičnih tabelarnih podatkov, vendar skoraj nobenega modela za ustvarjanje relacijskih tabelarnih sintetičnih podatkov. Prav to je cilj Solatorij in Dupriez (2023) raziskovanje; ustvarjanje modela, imenovanega REaLTabFormer, za sintetične relacijske podatke. Poskus je pokazal, da je rezultat natančno blizu obstoječega sintetičnega modela, ki bi ga lahko razširili na številne aplikacije.

6) Ali je okrepitveno učenje (ni) za obdelavo naravnega jezika?: merila uspešnosti, izhodišča in gradniki za optimizacijo politike naravnega jezika

Konceptualno okrepljeno učenje je odlična izbira za nalogo obdelave naravnega jezika, toda ali je res? To je vprašanje, ki Ramamurthy et al. (2022) poskusite odgovoriti. Raziskovalec predstavi različne knjižnice in algoritme, ki pokažejo, kje imajo tehnike krepitvenega učenja prednost v primerjavi z nadzorovano metodo pri nalogah NLP. Priporočamo, da ga preberete, če želite alternativo svojemu naboru spretnosti.

7) Tune-A-Video: Enkratna nastavitev modelov difuzije slike za generiranje besedila v video

Generiranje besedila v sliko je bilo leta 2022 veliko, leta 2023 pa naj bi bila predvidena zmogljivost besedila v video (T2V). Raziskave avtorja Wu et al. (2022) prikazuje, kako je mogoče T2V razširiti na številne pristope. Raziskava predlaga novo metodo Tune-a-Video, ki podpira naloge T2V, kot so spreminjanje subjekta in objekta, prenos sloga, urejanje atributov itd. To je odličen dokument za branje, če vas zanima raziskovanje besedila v video.

8) PyGlove: Učinkovita izmenjava idej ML kot kode

Učinkovito sodelovanje je ključ do uspeha v kateri koli ekipi, zlasti glede na vse večjo kompleksnost na področjih strojnega učenja. Za negovanje učinkovitosti, Peng et al. (2023) predstavite knjižnico PyGlove za preprosto deljenje idej ML. Koncept PyGlove je zajeti proces raziskav ML s seznamom pravil popravkov. Seznam je nato mogoče ponovno uporabiti v kateri koli eksperimentalni sceni, kar izboljša učinkovitost ekipe. Gre za raziskavo, ki poskuša rešiti problem strojnega učenja, ki ga mnogi še niso storili, zato jo je vredno prebrati.

8) Kako blizu je ChatGPT človeškim strokovnjakom? Primerjalni korpus, vrednotenje in odkrivanje

ChatGPT je zelo spremenil svet. Lahko rečemo, da bo šel trend od tu dalje navzgor, saj je javnost že naklonjena uporabi ChatGPT. Vendar, kakšen je trenutni rezultat ChatGPT v primerjavi s strokovnjaki za ljudi? Točno to je vprašanje Guo in sod. (2023) poskusite odgovoriti. Ekipa je poskušala zbrati podatke od strokovnjakov in takojšnje rezultate ChatGPT, ki jih je primerjala. Rezultat kaže, da obstajajo implicitne razlike med ChatGPT in strokovnjaki. Raziskava je nekaj, za kar menim, da bi jo v prihodnosti še naprej spraševali, saj bi generativni model AI sčasoma rasel, zato jo je vredno prebrati.

Leto 2023 je odlično leto za raziskave strojnega učenja, kar kaže trenutni trend, zlasti generativne umetne inteligence, kot sta ChatGPT in Stable Diffusion. Obstaja veliko obetavnih raziskav, za katere menim, da jih ne smemo zamuditi, saj kažejo obetavne rezultate, ki bi lahko spremenili trenutni standard. V tem članku sem vam pokazal 9 najboljših dokumentov o ML, ki jih lahko preberete, od generativnega modela, modela časovnih vrst do učinkovitosti delovnega toka. Upam, da pomaga.

Cornellius Yudha Wijaya je vodja podatkovne znanosti in pisec podatkov. Medtem ko dela s polnim delovnim časom pri Allianz Indonesia, rad deli nasvete o Pythonu in podatkih prek družbenih medijev in pisnih medijev.

- Distribucija vsebine in PR s pomočjo SEO. Okrepite se še danes.

- Platoblockchain. Web3 Metaverse Intelligence. Razširjeno znanje. Dostopite tukaj.

- vir: https://www.kdnuggets.com/2023/03/top-machine-learning-papers-read-2023.html?utm_source=rss&utm_medium=rss&utm_campaign=top-machine-learning-papers-to-read-in-2023

- : je

- 2022

- 2023

- 2D

- 9

- a

- Akademija

- natančno

- Dosega

- aktov

- Adam

- AI

- ai raziskave

- Cilje

- AL

- algoritem

- vsi

- Allianz

- že

- alternativa

- amater

- Analiza

- analiziranje

- in

- odkrivanje anomalije

- odgovor

- uporaba

- aplikacije

- pristopi

- SE

- članek

- AS

- Pomočnik

- At

- Na voljo

- temeljijo

- BE

- lepa

- Beauty

- ker

- postanejo

- meril

- Boljše

- med

- Big

- večji

- Bloki

- preboji

- Building

- podjetja

- by

- se imenuje

- CAN

- zajemanje

- primeru

- izzivi

- spremenite

- spreminjanje

- ChatGPT

- preverjanje

- izbira

- Zapri

- sodelovanje

- zbiranje

- prihajajo

- komercialno

- Skupno

- Podjetja

- primerljiva

- v primerjavi z letom

- Primerjava

- kompleksnost

- Koncept

- Konceptualno

- poteka

- bi

- Ustvarjanje

- Trenutna

- vsak dan

- datum

- znanost o podatkih

- Podatki

- Odkrivanje

- razvili

- razlike

- Difuzija

- Odkritje

- enostavno

- Edge

- učinkovitosti

- učinkovito

- Era

- zlasti

- itd

- Ocena

- Tudi

- VEDNO

- razvil

- točno

- Primer

- odlično

- izmenjava

- obstoječih

- poskus

- Strokovnjaki

- prednost

- Polje

- Področja

- za

- pogosto

- iz

- Prihodnost

- splošno

- ustvarjajo

- ustvarila

- ustvarjajo

- generacija

- generativno

- Generativna AI

- generativni model

- Go

- veliko

- skupina

- Pridelovanje

- Imajo

- pomoč

- Pomaga

- tukaj

- upam,

- HOT

- Kako

- Vendar

- HTTPS

- človeškega

- i

- Ideje

- slika

- izboljšanje

- izboljšuje

- in

- narašča

- Indonezija

- Industrija

- zainteresirani

- Predstavlja

- IT

- jpg

- KDnuggets

- Imejte

- Ključne

- Otrok

- jezik

- velika

- učenje

- Knjižnica

- Limited

- Lion

- Seznam

- živi

- stroj

- strojno učenje

- upravitelj

- več

- mediji

- Meta

- Metoda

- morda

- ML

- Model

- modeliranje

- modeli

- Momentum

- več

- Glasbeno

- naravna

- Naravni jezik

- Obdelava Natural Language

- mreža

- Nevronski

- nevronska mreža

- Novo

- nlp

- roman

- predmet

- of

- on

- ONE

- odprite

- Nasprotno

- optimizacija

- Papir

- članki

- Zaplata

- performance

- slike

- Smola

- platon

- Platonova podatkovna inteligenca

- PlatoData

- politika

- predstaviti

- Cena

- problem

- Postopek

- obravnavati

- napovedane

- Obljublja

- obetaven

- predlaga

- predlagano

- predlaga

- javnega

- javno

- Python

- vprašanje

- obsegu

- Oceniti

- Preberi

- reading

- realistična

- nedavno

- priporočeno

- okrepljeno učenje

- sprostitev

- zahteva

- Raziskave

- raziskovalne skupine

- raziskovalec

- povzroči

- Rezultati

- pravila

- s

- varna

- Prizor

- Znanost

- Serija

- Delite s prijatelji, znanci, družino in partnerji :-)

- shouldnt

- pokazale

- Razstave

- podpisati

- poenostavitev

- znanja in spretnosti

- manj

- So

- socialna

- družbeni mediji

- SOLVE

- Nekaj

- stabilna

- standardna

- Začetek

- slog

- predmet

- uspeh

- taka

- Podpira

- sintetična

- sintetični podatki

- Naloga

- Naloge

- skupina

- tehnike

- da

- O

- Prihodnost

- svet

- njihove

- Tukaj.

- stvari

- skozi

- čas

- Časovne serije

- nasveti

- do

- TONE

- vrh

- usposabljanje

- prenos

- Transform

- transformatorji

- Trend

- Trends

- Res

- razumeli

- razumevanje

- prihajajoče

- navzgor

- uporaba

- primeru uporabe

- različnih

- preko

- Voice

- ki

- medtem

- bo

- z

- v

- delo

- potek dela

- deluje

- svet

- vredno

- bi

- Pisatelj

- pisanje

- leto

- let

- Vaša rutina za

- zefirnet