Kommentar Mer än 250 masskjutningar har inträffat i USA hittills i år, och AI-förespråkare tror att de har lösningen. Inte vapenkontroll, men bättre teknik, föga förvånande.

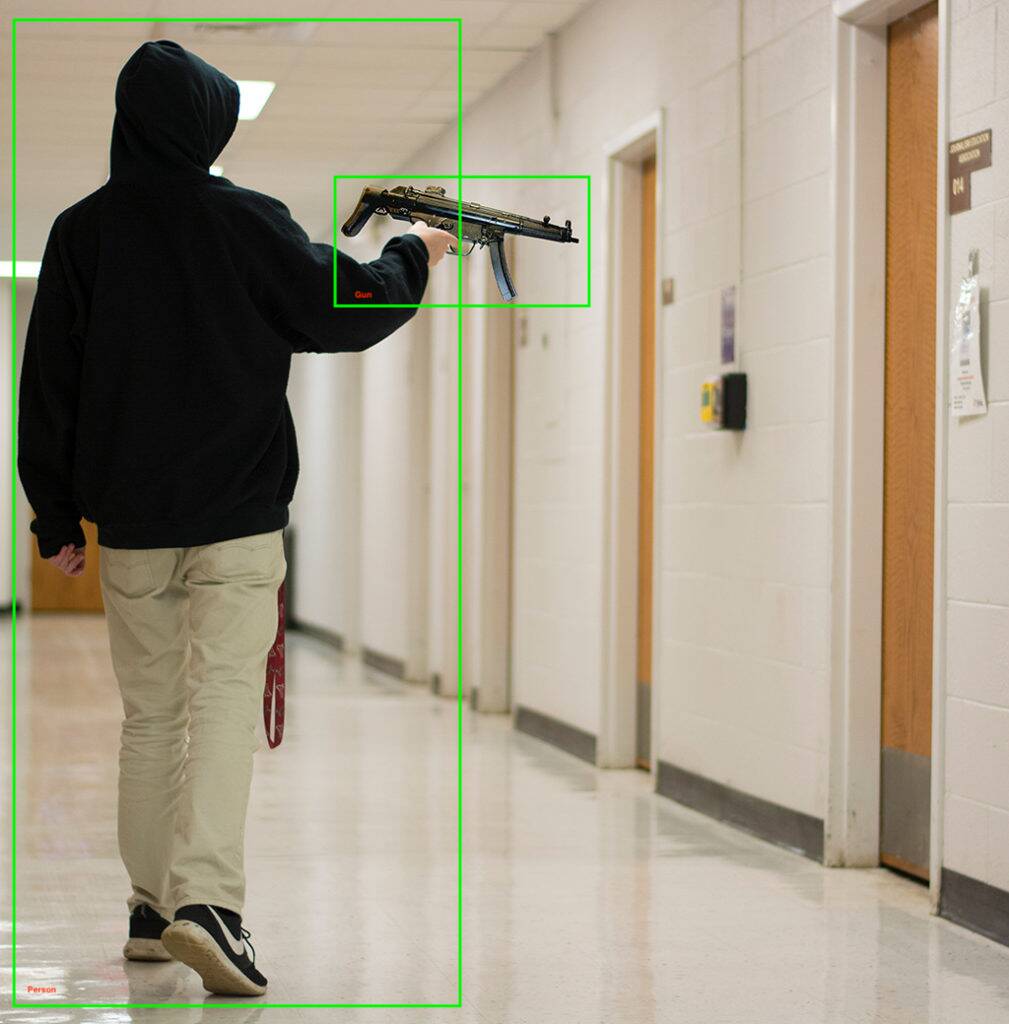

Machine-learning biz Kogniz meddelade på tisdagen att den lägger till en färdig att distribuera pistoldetekteringsmodell till sin datorvisionsplattform. Systemet, får vi veta, kan upptäcka vapen som ses av säkerhetskameror och skicka meddelanden till dem som är i riskzonen, meddela polisen, låsa byggnader och utföra andra säkerhetsuppgifter.

Förutom att upptäcka skjutvapen använder Kogniz sina andra datorseende-moduler för att upptäcka ovanligt beteende, som att barn springer ner i korridorerna eller att någon klättrar in genom ett fönster, vilket kan tyda på en aktiv skytt.

Om du undrar över kodens falska positiva eller felfrekvens, säger Kogniz att den har en "multi-pass AI" och "ett utbildat team av mänskliga verifierare" som kontrollerar resultaten av dess upptäcktsprogram. Antingen välkomnar du den extra nivån av bekräftelse, eller ser det som att teknik potentiellt faller tillbaka på människor precis när datorerna behövs som mest.

"[Vår lösning] gör det dramatiskt enklare för företag, statliga myndigheter, skolor och sjukhus att förbereda sig för och sedan hjälpa till att minska skadan som orsakas av ett aktivt skytteevenemang", säger Kogniz vd Daniel Putterman.

Kogniz är inte det första datorvisionsföretaget att komma in i spelet för pistoligenkänning – det finns en stor lista över företag som använder liknande teknik och några, som ZeroEyes, specialiserar sig på inget annat än skjutvapendetektering.

"Genom att sprida sin uppmärksamhet över flera erbjudanden kan utvecklare inte tillhandahålla den allra bästa tjänsten inom vapendetektering," sa ZeroEyes i en blogginlägg. ZeroEyes teknologi har implementerats på skolor i 14 delstater, inklusive Oxford High School i metro Detroit, där en 15-årig skytt dödade fyra och skadade sju förra året.

Andra leverantörer – som Defendry, som har en säkerhetssvit som inkluderar en panikknappsapp, ljudsensorer för skottlossning, drönare med första svar och AI för pistoldetektering; och Omnilert – befinner sig på denna deprimerande tillväxtmarknad. Ytterligare företag inom området för AI-vapendetektering inkluderar Arcarith, Athena Securities och Scylla.

Räcker det verkligen med tid?

2019 var polisens svar på en masskjutning i Dayton, Ohio, bara 32 sekunder, under vilken tid nio personer dog. En skottlossning 2021 på en FedEx-anläggning i Indianapolis som dödade nio personer var också över innan polisen kunde anlända, även om de gjorde det på bara några minuter.

Båda dessa fall väcker frågan om huruvida AI-vapendetektering kan minska svarstiderna tillräckligt för att rädda liv. Särskilt om officerare är för rädda eller väljer att inte svara, som i massmordet på Uvalde.

Flera andra AI-baserade förebyggande metoder för masskjutning har föreslagits, som t.ex smarta vapen som inte avfyras om de upptäcker ett mänskligt mål. Andra har föreslagit utbildning av AI:er på data från tidigare skjutningar, lokala vapenköp och socioekonomiska data för att hitta trender som tyder på en planerad skjutning, samt skanna sociala medier efter liknande indikatorer.

Det finns också AI förspänning, en väldokumenterat problem att även olika datamängder och balanserad träning verkar inte lösa. Ta en implementering av ansikts- och vapenigenkänningsteknik 2020 i ett skoldistrikt i New York: e-postmeddelanden mellan skoldistriktet och företaget som implementerade systemet visar ofta oro över det felidentifiering saker, som kvasthandtag för vapen.

På tal med Utah-publikationen Deseret News, ACLUs senior policyanalytiker Jay Stanley sade han var oroad över att datorseendesystem kunde leda till en värld "där människor undviker att göra något så enkelt som att hoppa nerför en trottoar av rädsla för att sätta igång anomalidetektorer och bli förhörda av polisen."

En möjlig användning av AI kan dock ha mer lovande: en 2018 studera från Cincinnati Children's Hospital Medical Center fann att AI-analys av terapisessioner överensstämde med farobedömningarna av psykiatriker och kuratorer 91 procent av tiden. Tillägget av demografiska och socioekonomiska uppgifter förbättrade bara resultaten för att identifiera unga människor som löpte risk att begå en våldsam handling.

Med så många potentiella komplikationer, är maskininlärning verkligen redo att förhindra massmord?

Vapenvåld är det mördare nummer ett av barn och tonåringar i Amerika, tar i genomsnitt 12 unga liv och skadar 32 mer varje dag. AI kan hjälpa, men utan att ta itu med dess brister behövs kanske också mindre tekniska tillvägagångssätt. En starkare och mer allmänt tillgänglig psykvård kan vara en bra början.

Tidigare denna månad, president Biden kallas för bland annat ett förbud mot anfallsvapen, utökade bakgrundskontroller och begränsningar av magasinkapacitet, som han kallade "rationella, sunt förnuftsåtgärder". ®

- AI

- ai konst

- ai art generator

- har robot

- artificiell intelligens

- artificiell intelligenscertifiering

- artificiell intelligens inom bankväsendet

- artificiell intelligens robot

- robotar med artificiell intelligens

- programvara för artificiell intelligens

- blockchain

- blockchain konferens ai

- coingenius

- konversationskonstnärlig intelligens

- kryptokonferens ai

- dalls

- djupt lärande

- du har google

- maskininlärning

- plato

- plato ai

- Platon Data Intelligence

- Platon spel

- PlatonData

- platogaming

- skala ai

- syntax

- Registret

- zephyrnet