ภาพโดยผู้เขียน

เมื่อเร็ว ๆ นี้ เราทุกคนมีช่วงเวลาที่ยากลำบากอย่างยิ่งในการติดตามรุ่นล่าสุดในพื้นที่ LLM ในช่วงไม่กี่สัปดาห์ที่ผ่านมา ทางเลือก ChatGPT แบบโอเพ่นซอร์สหลายรายการได้รับความนิยม

และในบทความนี้เราจะมาเรียนรู้เกี่ยวกับ แชทGLM ชุดและ แชทGLM-6Bซึ่งเป็นทางเลือก ChatGPT แบบโอเพ่นซอร์สและมีน้ำหนักเบา

เริ่มกันเลย!

นักวิจัยจากมหาวิทยาลัย Tsinghua ในประเทศจีนได้ทำงานเพื่อพัฒนาโมเดลในซีรีส์ ChatGLM ที่มีประสิทธิภาพเทียบเท่ากับโมเดลอื่นๆ เช่น GPT-3 และ BLOOM

ChatGLM เป็นโมเดลสองภาษาขนาดใหญ่ที่ได้รับการฝึกฝนทั้งภาษาจีนและภาษาอังกฤษ ปัจจุบันมีรุ่นต่อไปนี้:

- ChatGLM-130B: LLM แบบโอเพ่นซอร์ส

- ChatGLM-100B: ไม่ใช่แบบโอเพ่นซอร์ส แต่มีให้ผ่านการเข้าถึงที่ได้รับเชิญเท่านั้น

- ChatGLM-6B: ทางเลือกโอเพ่นซอร์สที่มีน้ำหนักเบา

แม้ว่าโมเดลเหล่านี้อาจดูคล้ายกับกลุ่ม Generative Pretrained Transformer (GPT) ของโมเดลภาษาขนาดใหญ่ เฟรมเวิร์กการเตรียมการล่วงหน้าของ General Language Model (GLM) คือสิ่งที่ทำให้พวกเขาแตกต่าง เราจะเรียนรู้เพิ่มเติมเกี่ยวกับเรื่องนี้ในหัวข้อถัดไป

ในแมชชีนเลิร์นนิง คุณจะรู้จัก GLM เป็น โมเดลเชิงเส้นทั่วไปแต่ GLM ใน ChatGLM ย่อมาจาก โมเดลภาษาทั่วไป.

กรอบการฝึกอบรมล่วงหน้าของ GLM

การฝึกอบรมล่วงหน้า LLM ได้รับการศึกษาอย่างกว้างขวางและยังคงเป็นพื้นที่ของการวิจัยที่ใช้งานอยู่ มาลองทำความเข้าใจความแตกต่างที่สำคัญระหว่างการฝึกล่วงหน้าของ GLM และโมเดลรูปแบบ GPT

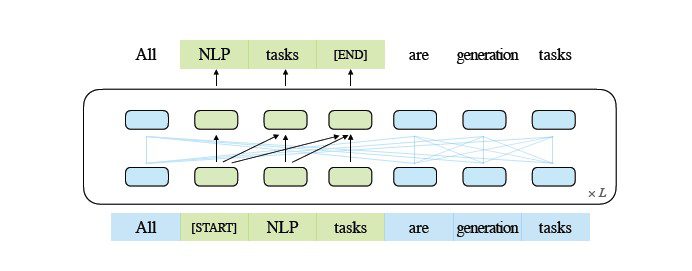

โมเดลตระกูล GPT-3 ใช้การสร้างโมเดลภาษาถดถอยอัตโนมัติอย่างเดียวสำหรับตัวถอดรหัส ในทางกลับกัน ใน GLM การเพิ่มประสิทธิภาพของวัตถุประสงค์ถูกกำหนดเป็น ปัญหาการเติมช่องว่างแบบถดถอยอัตโนมัติ.

จีแอลเอ็ม | แหล่งที่มาของภาพ

ในแง่ง่ายๆ, การเติมช่องว่างแบบถดถอยอัตโนมัติ เกี่ยวข้องกับการเว้นช่องว่างของข้อความที่ต่อเนื่องกัน แล้วสร้างข้อความขึ้นใหม่ตามลำดับ การเว้นช่องว่างนี้ นอกจากมาสก์ที่สั้นกว่าแล้ว ยังมีมาสก์ที่ยาวกว่าซึ่งสุ่มลบข้อความยาวออกจากส่วนท้ายของประโยค สิ่งนี้ทำเพื่อให้แบบจำลองทำงานได้ดีพอสมควรในการทำความเข้าใจภาษาธรรมชาติรวมถึงงานสร้าง

ความแตกต่างอีกประการหนึ่งคือประเภทของความสนใจที่ใช้ กลุ่ม GPT ของโมเดลภาษาขนาดใหญ่ใช้ความสนใจแบบทิศทางเดียว ในขณะที่กลุ่ม GLM ของ LLM ใช้ ความสนใจแบบสองทิศทาง. การใช้ความสนใจแบบสองทิศทางเหนือบริบทที่ไม่ได้ปิดบังสามารถจับการพึ่งพาได้ดีขึ้นและสามารถปรับปรุงประสิทธิภาพในงานการทำความเข้าใจภาษาธรรมชาติได้

การเปิดใช้งาน GELU

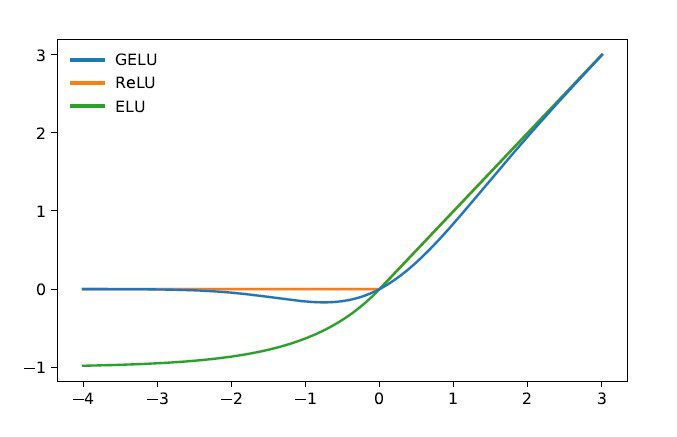

ใน GLM การเปิดใช้งาน GELU (Gaussian Error Linear Units) จะใช้แทนการเปิดใช้งาน ReLU [1]

การเปิดใช้งาน GELU, ReLU และ ELU | แหล่งที่มาของภาพ

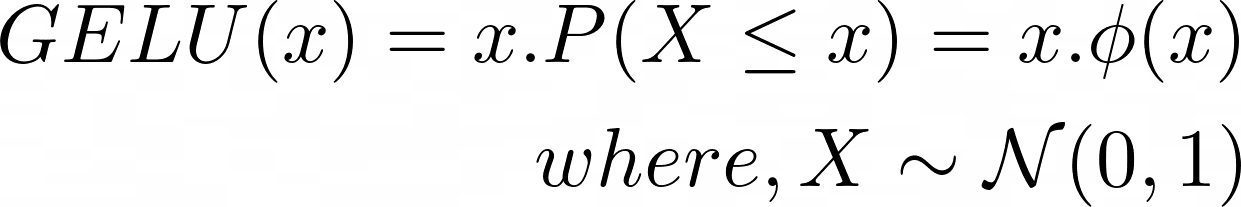

การเปิดใช้งาน GELU และมีค่าที่ไม่ใช่ศูนย์สำหรับอินพุตทั้งหมด และมีรูปแบบต่อไปนี้ [3]:

การเปิดใช้งาน GELU พบว่าช่วยปรับปรุงประสิทธิภาพเมื่อเทียบกับการเปิดใช้งาน ReLU แม้ว่าจะมีการคำนวณที่เข้มข้นกว่า ReLU

ในซีรีส์ GLM ของ LLM ChatGLM-130B ซึ่งเป็นโอเพ่นซอร์สและทำงานได้ดีกับโมเดล Da-Vinci ของ GPT-3 ดังที่ได้กล่าวไว้ ณ ตอนที่เขียนบทความนี้ มีเวอร์ชัน ChatGLM-100B ซึ่งจำกัดให้เข้าถึงได้เฉพาะผู้ที่ได้รับเชิญเท่านั้น

แชทGLM-6B

รายละเอียดต่อไปนี้เกี่ยวกับ ChatGLM-6B เพื่อให้ผู้ใช้ปลายทางเข้าถึงได้มากขึ้น:

- มีประมาณ 6.2 พันล้านพารามิเตอร์

- โมเดลดังกล่าวได้รับการฝึกฝนล่วงหน้าบนโทเค็น 1 ล้านล้านโทเค็น—จากภาษาอังกฤษและภาษาจีนเท่าๆ กัน

- ต่อจากนั้นจึงใช้เทคนิคต่างๆ เช่น การปรับอย่างละเอียดภายใต้การดูแลและการเรียนรู้แบบเสริมแรงด้วยความคิดเห็นจากมนุษย์

เรามาสรุปการสนทนาของเราโดยพูดถึงข้อดีและข้อจำกัดของ ChatGLM:

ข้อดี

ChatGLM-6B มีข้อดีดังนี้

- โมเดลภาษาขนาดใหญ่กระแสหลักส่วนใหญ่ได้รับการฝึกฝนบนข้อความภาษาอังกฤษขนาดใหญ่ และโมเดลภาษาขนาดใหญ่สำหรับภาษาอื่นก็ไม่เหมือนกัน ชุด LLM ของ ChatGLM เป็นแบบสองภาษาและเป็นตัวเลือกที่ยอดเยี่ยมสำหรับชาวจีน โมเดลมีประสิทธิภาพที่ดีทั้งภาษาอังกฤษและภาษาจีน

- ChatGLM-6B ได้รับการปรับให้เหมาะกับอุปกรณ์ของผู้ใช้ ผู้ใช้ปลายทางมักมีทรัพยากรการประมวลผลจำกัดในอุปกรณ์ ดังนั้นจึงแทบจะเป็นไปไม่ได้เลยที่จะเรียกใช้ LLM ภายในเครื่องโดยไม่ต้องเข้าถึง GPU ประสิทธิภาพสูง กับ INT4 การหาปริมาณ, ChatGLM-6B สามารถทำงานได้ด้วยความต้องการหน่วยความจำเล็กน้อยถึง 6GB

- ทำงานได้ดีกับงานที่หลากหลาย รวมถึงการสรุปผลและการสนทนาแบบเดี่ยวและหลายข้อความค้นหา

- แม้จะมีจำนวนพารามิเตอร์ที่น้อยกว่ามากเมื่อเทียบกับ LLM หลักอื่นๆ แต่ ChatGLM-6B รองรับความยาวของบริบทได้สูงสุด 2048

ข้อ จำกัด

ต่อไป มาดูข้อจำกัดบางประการของ ChatGLM-6B:

- แม้ว่า ChatGLM จะเป็นรูปแบบสองภาษา แต่ประสิทธิภาพของมันในภาษาอังกฤษก็มีแนวโน้มว่าจะไม่ดีเท่าที่ควร อาจเป็นเพราะคำแนะนำที่ใช้ในการฝึกอบรมส่วนใหญ่เป็นภาษาจีน

- เพราะ ChatGLM-6B มีมากมายมหาศาล พารามิเตอร์น้อยลง เมื่อเปรียบเทียบกับ LLM อื่นๆ เช่น BLOOM, GPT-3 และ ChatGLM-130B ประสิทธิภาพอาจแย่ลงเมื่อบริบทยาวเกินไป ส่งผลให้ ChatGLM-6B อาจให้ข้อมูลที่ไม่ถูกต้องบ่อยกว่ารุ่นที่มีพารามิเตอร์จำนวนมาก

- โมเดลภาษาขนาดเล็กมี ความจุหน่วยความจำที่จำกัด. ดังนั้นในการสนทนาแบบหลายเทิร์น ประสิทธิภาพของโมเดลอาจลดลงเล็กน้อย

- อคติ ข้อมูลที่ผิด และความเป็นพิษเป็นข้อจำกัดของ LLM ทั้งหมด และ ChatGLM ก็อ่อนไหวต่อสิ่งเหล่านี้เช่นกัน

ในขั้นตอนถัดไป ให้เรียกใช้ ChatGLM-6B ในเครื่องหรือลองใช้การสาธิตบนพื้นที่ HuggingFace หากคุณต้องการเจาะลึกลงไปในการทำงานของ LLM นี่คือรายการของ หลักสูตรฟรีเกี่ยวกับโมเดลภาษาขนาดใหญ่.

[1] Z Du, Y Qian และคณะ GLM: โมเดลภาษาทั่วไปที่เตรียมการล่วงหน้าด้วยการเติมช่องว่างอัตโนมัติ, เอซีแอล 2022

[2] A Zheng, X Liu และคณะ GLM-130B – โมเดลสองภาษาที่ได้รับการฝึกฝนแบบเปิด, ไอซีเอ็มแอล 2023

[3] ดี เฮนดรี้ส, เค กิมเพล, Gaussian Error Linear Units (GELU), arXiv, 2016

[4] ChatGLM-6B: การสาธิต HuggingFace Spaces

[5] ที่เก็บ GitHub

บาลา ปรียา ซี เป็นนักเขียนเชิงเทคนิคที่ชอบสร้างเนื้อหาขนาดยาว สาขาวิชาที่เธอสนใจ ได้แก่ คณิตศาสตร์ การเขียนโปรแกรม และวิทยาศาสตร์ข้อมูล เธอแบ่งปันการเรียนรู้ของเธอกับชุมชนนักพัฒนาโดยเขียนบทช่วยสอน คู่มือวิธีใช้ และอื่นๆ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- การสร้างอนาคตโดย Adryenn Ashley เข้าถึงได้ที่นี่.

- ที่มา: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- :มี

- :เป็น

- :ไม่

- $ ขึ้น

- 1

- a

- เกี่ยวกับเรา

- เข้า

- สามารถเข้าถึงได้

- การกระตุ้น

- การเปิดใช้งาน

- คล่องแคล่ว

- นอกจากนี้

- ข้อได้เปรียบ

- AL

- ทั้งหมด

- ทางเลือก

- ทางเลือก

- an

- และ

- เป็น

- AREA

- พื้นที่

- บทความ

- AS

- At

- ความสนใจ

- การเขียน

- รถยนต์

- ใช้ได้

- BE

- กลายเป็น

- จะกลายเป็น

- รับ

- กำลัง

- ดีกว่า

- ระหว่าง

- พันล้าน

- บานสะพรั่ง

- ทั้งสอง

- แต่

- by

- CAN

- จับ

- ChatGPT

- สาธารณรัฐประชาชนจีน

- ชาวจีน

- ทางเลือก

- ร่วมกัน

- ชุมชน

- เทียบเคียง

- เมื่อเทียบกับ

- การคำนวณ

- เนื้อหา

- สิ่งแวดล้อม

- บริบท

- ต่อเนื่องกัน

- หลักสูตร

- การสร้าง

- ขณะนี้

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- ลึก

- ทดลอง

- รายละเอียด

- ผู้พัฒนา

- ที่กำลังพัฒนา

- อุปกรณ์

- ความแตกต่าง

- ความแตกต่าง

- ต่าง

- การสนทนา

- ทำ

- E&T

- ปลาย

- ภาษาอังกฤษ

- ความผิดพลาด

- ครอบครัว

- ข้อเสนอแนะ

- สองสาม

- น้อยลง

- ดังต่อไปนี้

- สำหรับ

- ฟอร์ม

- พบ

- ราคาเริ่มต้นที่

- General

- รุ่น

- กำเนิด

- ได้รับ

- ให้

- ไป

- ดี

- GPUs

- ยิ่งใหญ่

- บัญชีกลุ่ม

- คู่มือ

- มือ

- ยาก

- มี

- มี

- เธอ

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- ประสิทธิภาพสูง

- HTML

- HTTPS

- กอดใบหน้า

- เป็นมนุษย์

- if

- เป็นไปไม่ได้

- ปรับปรุง

- in

- ไม่เที่ยง

- ประกอบด้วย

- รวมทั้ง

- ข้อมูล

- แทน

- คำแนะนำการใช้

- อยากเรียนรู้

- เข้าไป

- ที่เกี่ยวข้องกับการ

- IT

- ITS

- jpg

- KD นักเก็ต

- คีย์

- ทราบ

- ภาษา

- ภาษา

- ใหญ่

- ที่มีขนาดใหญ่

- ชื่อสกุล

- ล่าสุด

- เรียนรู้

- การเรียนรู้

- ความยาว

- มีน้ำหนักเบา

- กดไลก์

- น่าจะ

- ข้อ จำกัด

- ถูก จำกัด

- รายการ

- ในท้องถิ่น

- นาน

- อีกต่อไป

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- หลัก

- ทำ

- ทำให้

- หน้ากาก

- มาสก์

- คณิตศาสตร์

- อาจ..

- หน่วยความจำ

- กล่าวถึง

- ข้อมูลที่ผิด

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- ข้อมูลเพิ่มเติม

- โดยธรรมชาติ

- ภาษาธรรมชาติ

- การเข้าใจภาษาธรรมชาติ

- ถัดไป

- จำนวน

- Nvidia

- วัตถุประสงค์

- of

- มักจะ

- on

- เปิด

- โอเพนซอร์ส

- การเพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- or

- อื่นๆ

- ของเรา

- ออก

- เกิน

- พารามิเตอร์

- การปฏิบัติ

- ดำเนินการ

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- ยอดนิยม

- ก่อน

- การเขียนโปรแกรม

- การเรียนรู้การเสริมแรง

- สัมพันธ์

- ความต้องการ

- การวิจัย

- แหล่งข้อมูล

- หวงห้าม

- ผล

- วิ่ง

- s

- วิทยาศาสตร์

- Section

- ชุด

- หลาย

- หุ้น

- เธอ

- คล้ายคลึงกัน

- ง่าย

- เดียว

- มีขนาดเล็กกว่า

- So

- ช่องว่าง

- ช่องว่าง

- ระยะ

- ยืน

- ขั้นตอน

- ยังคง

- มีการศึกษา

- อย่างเช่น

- ยิ่งใหญ่

- รองรับ

- ฉลาด

- งาน

- วิชาการ

- เทคนิค

- เงื่อนไขการใช้บริการ

- กว่า

- ที่

- พื้นที่

- ของพวกเขา

- พวกเขา

- แล้วก็

- ที่นั่น

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- นี้

- ตลอด

- เวลา

- ไปยัง

- เกินไป

- ผ่านการฝึกอบรม

- การฝึกอบรม

- ล้านล้าน

- Tsinghua

- บทเรียน

- ชนิด

- เข้าใจ

- ความเข้าใจ

- หน่วย

- มหาวิทยาลัย

- ใช้

- มือสอง

- ผู้ใช้งาน

- ผู้ใช้

- การใช้

- ความคุ้มค่า

- ความหลากหลาย

- รุ่น

- สัปดาห์ที่ผ่านมา

- ดี

- อะไร

- เมื่อ

- ที่

- WHO

- กับ

- ทำงาน

- การทำงาน

- แย่ลง

- ห่อ

- นักเขียน

- การเขียน

- X

- เธอ

- ลมทะเล