อเมซอน เล็กซ์ เป็นบริการที่ช่วยให้คุณสร้างบอทสนทนา ("แชทบอท") ตัวแทนเสมือน และระบบโต้ตอบด้วยเสียง (IVR) ได้อย่างรวดเร็วและง่ายดายสำหรับแอปพลิเคชันต่างๆ เช่น อเมซอน คอนเนค.

ปัญญาประดิษฐ์ (AI) และแมชชีนเลิร์นนิง (ML) เป็นจุดสนใจของ Amazon มานานกว่า 20 ปี และความสามารถหลายอย่างที่ลูกค้าใช้กับ Amazon นั้นขับเคลื่อนโดย ML ปัจจุบัน โมเดลภาษาขนาดใหญ่ (LLM) กำลังเปลี่ยนวิธีที่นักพัฒนาและองค์กรต่างๆ แก้ปัญหาความท้าทายในอดีตที่เกี่ยวข้องกับความเข้าใจภาษาธรรมชาติ (NLU) เราประกาศ อเมซอน เบดร็อค เมื่อเร็วๆ นี้ ซึ่งช่วยให้นักพัฒนาสามารถเข้าถึงโมเดลพื้นฐานแบบประชาธิปไตยเพื่อสร้างและปรับขนาดแอปพลิเคชันที่สร้างจาก AI ได้อย่างง่ายดาย โดยใช้เครื่องมือและความสามารถของ AWS ที่คุ้นเคย หนึ่งในความท้าทายที่องค์กรต่าง ๆ เผชิญคือการรวมความรู้ทางธุรกิจเข้ากับ LLM เพื่อมอบการตอบสนองที่ถูกต้องและตรงประเด็น เมื่อใช้ประโยชน์อย่างมีประสิทธิภาพ ฐานความรู้ขององค์กรสามารถใช้เพื่อมอบประสบการณ์บริการตนเองและบริการช่วยเหลือที่ปรับแต่งได้ โดยส่งมอบข้อมูลที่ช่วยให้ลูกค้าแก้ปัญหาได้อย่างอิสระ และ/หรือเสริมความรู้ของตัวแทน ปัจจุบัน นักพัฒนาบอทสามารถปรับปรุงประสบการณ์การบริการตนเองโดยไม่ต้องใช้ LLM ได้หลายวิธี ขั้นแรก สร้างความตั้งใจ ตัวอย่างคำพูด และการตอบสนอง ซึ่งครอบคลุมคำถามที่ผู้ใช้คาดหวังทั้งหมดภายในบอต Amazon Lex ประการที่สอง นักพัฒนาซอฟต์แวร์ยังสามารถรวมบอทเข้ากับโซลูชันการค้นหา ซึ่งสามารถจัดทำดัชนีเอกสารที่จัดเก็บไว้ในที่เก็บต่างๆ และค้นหาเอกสารที่เกี่ยวข้องมากที่สุดเพื่อตอบคำถามของลูกค้า วิธีการเหล่านี้มีประสิทธิภาพ แต่ต้องใช้ทรัพยากรของนักพัฒนาซึ่งทำให้การเริ่มต้นทำได้ยาก

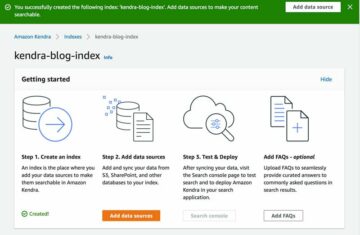

ข้อดีอย่างหนึ่งของ LLM คือความสามารถในการสร้างประสบการณ์การบริการตนเองเชิงสนทนาที่เกี่ยวข้องและน่าสนใจ พวกเขาทำได้โดยการใช้ประโยชน์จากฐานความรู้ขององค์กรและส่งมอบการตอบสนองที่ถูกต้องตามบริบทมากขึ้น บล็อกโพสต์นี้แนะนำโซลูชันที่มีประสิทธิภาพสำหรับการเพิ่มคุณสมบัติ Amazon Lex ด้วยคำถามที่พบบ่อยที่ใช้ LLM โดยใช้ Retrieval Augmented Generation (RAG) เราจะทบทวนวิธีที่แนวทางของ RAG เพิ่มการตอบกลับคำถามที่พบบ่อยของ Amazon Lex โดยใช้แหล่งข้อมูลของบริษัทของคุณ นอกจากนี้ เราจะสาธิตการรวม Amazon Lex กับ LlamaIndex ซึ่งเป็นเฟรมเวิร์กข้อมูลแบบโอเพ่นซอร์สที่ให้แหล่งความรู้และความยืดหยุ่นของรูปแบบแก่นักพัฒนาบอท เมื่อนักพัฒนาบอทได้รับความมั่นใจจากการใช้ LlamaIndex เพื่อสำรวจการผสานรวม LLM พวกเขาสามารถปรับขนาดความสามารถของ Amazon Lex ได้มากขึ้น พวกเขายังสามารถใช้บริการค้นหาขององค์กรเช่น อเมซอน เคนดราซึ่งผสานรวมกับ Amazon Lex โดยกำเนิด

ในโซลูชันนี้ เราแสดงแอปพลิเคชันที่ใช้งานได้จริงของแชทบอท Amazon Lex พร้อมการปรับปรุง RAG ที่ใช้ LLM เราใช้ กรณีการใช้งานการสนับสนุนลูกค้า Zappos เป็นตัวอย่างเพื่อแสดงให้เห็นถึงประสิทธิภาพของโซลูชันนี้ ซึ่งจะนำผู้ใช้ผ่านประสบการณ์คำถามที่พบบ่อยที่ได้รับการปรับปรุง (ด้วย LLM) แทนที่จะสั่งให้พวกเขาใช้แผนสำรอง (ค่าเริ่มต้น โดยไม่มี LLM)

ภาพรวมโซลูชัน

RAG ผสานรวมจุดแข็งของวิธีการที่ใช้การดึงข้อมูลและการสร้าง AI แบบดั้งเดิมเข้ากับระบบถามตอบ วิธีการนี้ควบคุมพลังของโมเดลภาษาขนาดใหญ่ เช่น อเมซอนไททัน หรือโมเดลโอเพ่นซอร์ส (เช่น Falcon) เพื่อดำเนินการสร้างงานในระบบการดึงข้อมูล นอกจากนี้ยังคำนึงถึงบริบททางความหมายจากเอกสารที่เก็บไว้อย่างมีประสิทธิภาพและประสิทธิผล

RAG เริ่มต้นด้วยขั้นตอนการเรียกข้อมูลเริ่มต้นเพื่อดึงเอกสารที่เกี่ยวข้องจากคอลเล็กชันตามคำค้นหาของผู้ใช้ จากนั้นจึงใช้โมเดลภาษาเพื่อสร้างการตอบกลับโดยพิจารณาทั้งเอกสารที่ดึงมาและข้อความค้นหาต้นฉบับ ด้วยการรวม RAG เข้ากับ Amazon Lex เราสามารถให้คำตอบที่ถูกต้องและครอบคลุมสำหรับคำถามของผู้ใช้ ส่งผลให้ผู้ใช้มีส่วนร่วมและน่าพึงพอใจมากขึ้น

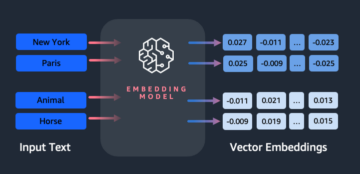

แนวทาง RAG ต้องมีการนำเข้าเอกสารเพื่อให้ ฝัง สามารถสร้างขึ้นเพื่อเปิดใช้งานการค้นหาตาม LLM แผนภาพต่อไปนี้แสดงวิธีที่กระบวนการนำเข้าสร้างการฝังที่แชทบอทใช้ระหว่างทางเลือกเพื่อตอบคำถามของลูกค้า

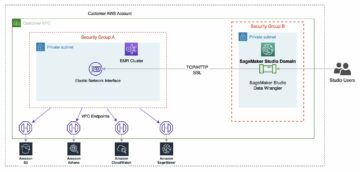

ด้วยสถาปัตยกรรมโซลูชันนี้ คุณควรเลือก LLM ที่เหมาะสมที่สุดสำหรับกรณีการใช้งานของคุณ นอกจากนี้ยังมีตัวเลือกจุดสิ้นสุดการอนุมานระหว่าง Amazon Bedrock (ในการแสดงตัวอย่างแบบจำกัด) และรุ่นที่โฮสต์บน Amazon SageMaker JumpStart ซึ่งมอบความยืดหยุ่นเพิ่มเติมสำหรับ LLM

เอกสารถูกอัพโหลดไปที่ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon ที่ฝากข้อมูล (Amazon S3) บัคเก็ต S3 มีตัวฟังเหตุการณ์ที่แนบมาซึ่งเรียกใช้ AWS แลมบ์ดา ฟังก์ชั่นการเปลี่ยนแปลงถัง ผู้ฟังเหตุการณ์นำเข้าเอกสารใหม่และวางการฝังลงในบัคเก็ต S3 อื่น จากนั้นการฝังจะใช้โดยการนำ RAG ไปใช้งานในบอต Amazon Lex ระหว่างความตั้งใจสำรองเพื่อตอบคำถามของลูกค้า แผนภาพถัดไปแสดงสถาปัตยกรรมว่าบอทคำถามที่พบบ่อยภายใน Lex สามารถปรับปรุงด้วย LLM และ RAG ได้อย่างไร

มาสำรวจวิธีที่เราสามารถรวม RAG ตาม LlamaIndex เข้ากับบอต Amazon Lex เรามีตัวอย่างโค้ดและ ชุดพัฒนา AWS Cloud (AWS CDK) นำเข้าเพื่อช่วยคุณในการตั้งค่าการผสานรวม คุณสามารถค้นหาตัวอย่างรหัสได้ในของเรา พื้นที่เก็บข้อมูล GitHub. ส่วนต่อไปนี้ให้คำแนะนำทีละขั้นตอนเพื่อช่วยคุณตั้งค่าสภาพแวดล้อมและปรับใช้ทรัพยากรที่จำเป็น

RAG ทำงานร่วมกับ Amazon Lex อย่างไร

โฟลว์ของ RAG เกี่ยวข้องกับกระบวนการวนซ้ำที่ส่วนประกอบตัวดึงข้อมูลดึงข้อความที่เกี่ยวข้อง คำถามและข้อความช่วยสร้างข้อความแจ้ง และส่วนประกอบการสร้างสร้างการตอบสนอง การผสมผสานระหว่างเทคนิคการดึงข้อมูลและการสร้างช่วยให้โมเดล RAG สามารถใช้ประโยชน์จากจุดแข็งของทั้งสองแนวทาง โดยให้คำตอบที่ถูกต้องและเหมาะสมกับบริบทสำหรับคำถามของผู้ใช้ เวิร์กโฟลว์มีความสามารถดังต่อไปนี้:

- เครื่องยนต์รีทรีฟเวอร์ – โมเดล RAG เริ่มต้นด้วยส่วนประกอบรีทรีฟเวอร์ที่รับผิดชอบในการดึงเอกสารที่เกี่ยวข้องจากคลังข้อมูลขนาดใหญ่ องค์ประกอบนี้มักใช้เทคนิคการดึงข้อมูล เช่น TF-IDF หรือ BM25 เพื่อจัดอันดับและเลือกเอกสารที่น่าจะมีคำตอบสำหรับคำถามที่กำหนด รีทรีฟเวอร์จะสแกนคลังเอกสารและเรียกชุดข้อความที่เกี่ยวข้อง

- ตัวช่วยด่วน – หลังจากที่รีทรีฟเวอร์ระบุข้อความที่เกี่ยวข้องแล้ว โมเดล RAG จะย้ายไปที่การสร้างพร้อมท์ พรอมต์คือการรวมกันของคำถามและข้อความที่เรียกมา โดยทำหน้าที่เป็นบริบทเพิ่มเติมสำหรับพรอมต์ ซึ่งใช้เป็นอินพุตไปยังส่วนประกอบตัวสร้าง ในการสร้างพรอมต์ โดยทั่วไป โมเดลจะเพิ่มคำถามด้วยข้อความที่เลือกในรูปแบบเฉพาะ

- การสร้างการตอบสนอง – ข้อความแจ้ง ซึ่งประกอบด้วยคำถามและข้อความที่เกี่ยวข้อง ถูกป้อนเข้าสู่องค์ประกอบการสร้างของโมเดล RAG องค์ประกอบการสร้างมักจะเป็นรูปแบบภาษาที่สามารถให้เหตุผลผ่านพรอมต์เพื่อสร้างการตอบสนองที่สอดคล้องกันและเกี่ยวข้องกัน

- คำตอบสุดท้าย – ในที่สุด โมเดล RAG จะเลือกคำตอบที่มีอันดับสูงสุดเป็นผลลัพธ์และแสดงเป็นคำตอบสำหรับคำถามเดิม คำตอบที่เลือกสามารถประมวลผลภายหลังหรือจัดรูปแบบเพิ่มเติมได้ตามความจำเป็นก่อนที่จะส่งกลับไปยังผู้ใช้ นอกจากนี้ โซลูชันยังช่วยให้กรองการตอบสนองที่สร้างขึ้นได้ หากผลการดึงข้อมูลมีคะแนนความเชื่อมั่นต่ำ ซึ่งหมายความว่าคำตอบนั้นน่าจะอยู่นอกการกระจาย (OOD)

LlamaIndex: กรอบข้อมูลโอเพ่นซอร์สสำหรับแอปพลิเคชันที่ใช้ LLM

ในโพสต์นี้ เราสาธิตโซลูชัน RAG ที่ใช้ LlamaIndex LlamaIndex เป็นกรอบข้อมูลโอเพ่นซอร์สที่ออกแบบมาโดยเฉพาะเพื่ออำนวยความสะดวกในการใช้งาน LLM นำเสนอโซลูชันที่แข็งแกร่งและปรับขนาดได้สำหรับจัดการการรวบรวมเอกสารในรูปแบบต่างๆ ด้วย LlamaIndex นักพัฒนาบอตได้รับอำนาจในการผสานรวมความสามารถด้าน QA (การตอบคำถาม) ที่ใช้ LLM เข้ากับแอปพลิเคชันของตนได้อย่างง่ายดาย โดยขจัดความซับซ้อนที่เกี่ยวข้องกับการจัดการโซลูชันที่รองรับคอลเล็กชันเอกสารขนาดใหญ่ นอกจากนี้ วิธีการนี้พิสูจน์แล้วว่าคุ้มค่าสำหรับที่เก็บเอกสารขนาดเล็ก

เบื้องต้น

คุณควรมีข้อกำหนดเบื้องต้นดังต่อไปนี้:

ตั้งค่าสภาพแวดล้อมการพัฒนาของคุณ

ข้อกำหนดแพ็คเกจหลักของบุคคลที่สามคือ ลามะ_index และ Sagemaker SDK. ปฏิบัติตามคำสั่งที่ระบุในของเรา README ของที่เก็บ GitHub เพื่อตั้งค่าสภาพแวดล้อมของคุณอย่างเหมาะสม

ปรับใช้ทรัพยากรที่จำเป็น

ขั้นตอนนี้เกี่ยวข้องกับการสร้างบอต Amazon Lex, บัคเก็ต S3 และตำแหน่งข้อมูล SageMaker นอกจากนี้ คุณต้องเทียบท่าโค้ดในไดเร็กทอรีอิมเมจ Docker แล้วพุชอิมเมจไปที่ การลงทะเบียน Amazon Elastic Container (Amazon ECR) เพื่อให้ทำงานในแลมบ์ดาได้ ปฏิบัติตามคำสั่งที่ระบุในของเรา README ของที่เก็บ GitHub เพื่อปรับใช้บริการ

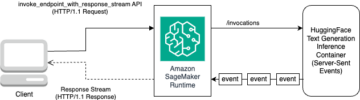

ในระหว่างขั้นตอนนี้ เราจะสาธิตการโฮสต์ LLM ผ่าน SageMaker คอนเทนเนอร์การเรียนรู้เชิงลึก. ปรับการตั้งค่าตามความต้องการในการคำนวณของคุณ:

- รุ่น – หากต้องการค้นหาโมเดลที่ตรงกับความต้องการของคุณ คุณสามารถสำรวจทรัพยากรต่างๆ เช่น ฮับโมเดล Hugging Face มีจำหน่ายหลากหลายรุ่น เช่น เหยี่ยว 7B or แฟลน-T5-XXL. นอกจากนี้ คุณสามารถค้นหาข้อมูลโดยละเอียดเกี่ยวกับสถาปัตยกรรมโมเดลต่างๆ ที่รองรับอย่างเป็นทางการ ซึ่งช่วยให้คุณตัดสินใจได้อย่างมีข้อมูล สำหรับข้อมูลเพิ่มเติมเกี่ยวกับประเภทรุ่นต่างๆ โปรดดูที่ สถาปัตยกรรมที่ปรับให้เหมาะสม.

- จุดสิ้นสุดการอนุมานแบบจำลอง – กำหนดเส้นทางของโมเดล (เช่น Falcon 7B) เลือกประเภทอินสแตนซ์ของคุณ (เช่น g5.4xlarge) และใช้การวัดปริมาณ (เช่น int-8 quantization)หมายเหตุ: โซลูชันนี้ให้ความยืดหยุ่นแก่คุณในการเลือกโมเดลอื่นที่อ้างอิงจุดสิ้นสุด คุณยังสามารถใช้ อเมซอน เบดร็อคซึ่งให้การเข้าถึง LLM อื่นๆ เช่น อเมซอนไททัน.หมายเหตุ: โซลูชันนี้ให้ความยืดหยุ่นแก่คุณในการเลือกโมเดลอื่นที่อ้างอิงจุดสิ้นสุด คุณยังสามารถใช้ Amazon Bedrock ซึ่งให้การเข้าถึง LLM อื่นๆ เช่น Amazon Titan

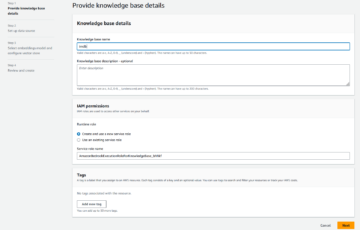

ตั้งค่าดัชนีเอกสารของคุณผ่าน LlamaIndex

หากต้องการตั้งค่าดัชนีเอกสาร ให้อัปโหลดข้อมูลเอกสารของคุณก่อน เราถือว่าคุณมีแหล่งที่มาของเนื้อหาคำถามที่พบบ่อย เช่น PDF หรือไฟล์ข้อความ

หลังจากอัพโหลดข้อมูลเอกสารแล้ว ระบบ LlamaIndex จะเริ่มกระบวนการสร้างดัชนีเอกสารโดยอัตโนมัติ งานนี้ดำเนินการโดยฟังก์ชัน Lambda ซึ่งสร้างดัชนีและบันทึกลงในบัคเก็ต S3

เพื่อให้ดึงข้อมูลที่เกี่ยวข้องได้อย่างมีประสิทธิภาพ ให้กำหนดค่าตัวดึงข้อมูลเอกสารโดยใช้ LlamaIndex Retriever Query Engine เอ็นจิ้นนี้มีตัวเลือกการปรับแต่งมากมาย เช่นต่อไปนี้:

- แบบจำลองการฝัง – คุณสามารถเลือกรูปแบบการฝังของคุณ เช่น การฝังใบหน้ากอด.

- ตัดความมั่นใจ – ระบุเกณฑ์การตัดความเชื่อมั่นเพื่อกำหนดคุณภาพของผลการดึงข้อมูล หากคะแนนความเชื่อมั่นต่ำกว่าเกณฑ์นี้ คุณสามารถเลือกให้คำตอบที่อยู่นอกขอบเขต ซึ่งบ่งชี้ว่าข้อความค้นหาอยู่นอกเหนือขอบเขตของเอกสารที่จัดทำดัชนี

ทดสอบการรวม

กำหนดคำนิยามบอทของคุณด้วยความตั้งใจสำรองและใช้คอนโซล Amazon Lex เพื่อทดสอบคำขอคำถามที่พบบ่อยของคุณ สำหรับรายละเอียดเพิ่มเติมโปรดดูที่ พื้นที่เก็บข้อมูล GitHub. ภาพหน้าจอต่อไปนี้แสดงตัวอย่างการสนทนากับบอท

เคล็ดลับในการเพิ่มประสิทธิภาพบอทของคุณ

เคล็ดลับต่อไปนี้อาจปรับปรุงประสิทธิภาพของบอทของคุณให้ดียิ่งขึ้น:

- การจัดเก็บดัชนี – จัดเก็บดัชนีของคุณในบัคเก็ต S3 หรือบริการที่มีความสามารถด้านฐานข้อมูลเวกเตอร์ เช่น อเมซอน โอเพนเสิร์ช. ด้วยการใช้โซลูชันการจัดเก็บข้อมูลบนคลาวด์ คุณสามารถเพิ่มการเข้าถึงและความสามารถในการปรับขนาดของดัชนีของคุณ ซึ่งนำไปสู่เวลาเรียกข้อมูลที่รวดเร็วขึ้นและปรับปรุงประสิทธิภาพโดยรวม นอกจากนี้ยังอ้างถึง โพสต์บล็อกนี้ สำหรับบอท Amazon Lex ที่ใช้ อเมซอน เคนดรา โซลูชันการค้นหา

- การเพิ่มประสิทธิภาพการดึงข้อมูล – ทดลองกับโมเดลการฝังขนาดต่างๆ สำหรับรีทรีฟเวอร์ การเลือกรูปแบบการฝังอาจส่งผลต่อข้อกำหนดด้านอินพุตของ LLM ของคุณได้อย่างมาก การหาจุดสมดุลระหว่างขนาดโมเดลกับประสิทธิภาพการเรียกข้อมูลสามารถส่งผลให้ประสิทธิภาพดีขึ้นและเวลาตอบสนองเร็วขึ้น

- วิศวกรรมทันใจ – ทดลองด้วยรูปแบบ ความยาว และสไตล์ของพรอมต์ต่างๆ เพื่อเพิ่มประสิทธิภาพและคุณภาพของคำตอบของบอท

- การเลือกรุ่น LLM – เลือกรูปแบบ LLM ที่เหมาะสมที่สุดสำหรับกรณีการใช้งานเฉพาะของคุณ พิจารณาปัจจัยต่างๆ เช่น ขนาดรุ่น ความสามารถด้านภาษา และความเข้ากันได้กับข้อกำหนดแอปพลิเคชันของคุณ การเลือกโมเดล LLM ที่เหมาะสมช่วยให้มั่นใจถึงประสิทธิภาพสูงสุดและการใช้ทรัพยากรระบบอย่างมีประสิทธิภาพ

การสนทนาในศูนย์ติดต่อสามารถครอบคลุมตั้งแต่การบริการตนเองไปจนถึงการโต้ตอบกับมนุษย์โดยตรง สำหรับกรณีการใช้งานที่เกี่ยวข้องกับการโต้ตอบระหว่างมนุษย์กับมนุษย์ผ่าน Amazon Connect คุณสามารถใช้ ภูมิปัญญา เพื่อค้นหาและค้นหาเนื้อหาในที่เก็บหลายแห่ง เช่น คำถามที่พบบ่อย (FAQ) วิกิ บทความ และคำแนะนำทีละขั้นตอนสำหรับการจัดการปัญหาต่างๆ ของลูกค้า

ทำความสะอาด

เพื่อหลีกเลี่ยงค่าใช้จ่ายในอนาคต ให้ดำเนินการลบทรัพยากรทั้งหมดที่ถูกปรับใช้เป็นส่วนหนึ่งของแบบฝึกหัดนี้ เราได้จัดทำสคริปต์เพื่อปิดจุดสิ้นสุดของ SageMaker อย่างสวยงาม รายละเอียดการใช้งานอยู่ใน README นอกจากนี้ เพื่อลบทรัพยากรอื่นๆ ทั้งหมดที่คุณเรียกใช้ได้ cdk destroy ในไดเร็กทอรีเดียวกันกับคำสั่ง cdk อื่นๆ เพื่อยกเลิกการจัดเตรียมทรัพยากรทั้งหมดในสแตกของคุณ

สรุป

โพสต์นี้กล่าวถึงขั้นตอนต่อไปนี้เพื่อปรับปรุง Amazon Lex ด้วยคุณสมบัติ QA ที่ใช้ LLM โดยใช้กลยุทธ์ RAG และ LlamaIndex:

- ติดตั้งการพึ่งพาที่จำเป็น รวมถึงไลบรารี LlamaIndex

- ตั้งค่าการโฮสต์แบบจำลองผ่าน Amazon SageMaker หรือ Amazon Bedrock (ในการแสดงตัวอย่างแบบจำกัด)

- กำหนดค่า LlamaIndex โดยสร้างดัชนีและเติมข้อมูลด้วยเอกสารที่เกี่ยวข้อง

- รวม RAG เข้ากับ Amazon Lex โดยแก้ไขการกำหนดค่าและกำหนดค่า RAG เพื่อใช้ LlamaIndex สำหรับการดึงเอกสาร

- ทดสอบการผสานรวมโดยเข้าร่วมการสนทนากับแชทบอท และสังเกตการดึงข้อมูลและสร้างการตอบสนองที่แม่นยำ

เมื่อทำตามขั้นตอนเหล่านี้ คุณจะสามารถรวมความสามารถด้าน QA ที่ใช้ LLM ที่มีประสิทธิภาพและการจัดทำดัชนีเอกสารที่มีประสิทธิภาพลงในแชทบอท Amazon Lex ได้อย่างราบรื่น ส่งผลให้มีการโต้ตอบกับผู้ใช้ที่แม่นยำ ครอบคลุม และรับรู้ตามบริบทมากขึ้น เพื่อเป็นการติดตามผล เรายังขอเชิญคุณตรวจสอบของเรา โพสต์บล็อกถัดไปซึ่งสำรวจการปรับปรุงประสบการณ์คำถามที่พบบ่อยของ Amazon Lex โดยใช้การส่งผ่าน URL และ LLM

เกี่ยวกับผู้แต่ง

แม็กซ์ เฮงเค็ล-วอลเลซ เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS Lex เขาสนุกกับการใช้ประโยชน์จากเทคโนโลยีเพื่อเพิ่มความสำเร็จของลูกค้า นอกเวลางานเขาหลงใหลในการทำอาหาร ใช้เวลากับเพื่อน ๆ และแบกเป้เที่ยว

แม็กซ์ เฮงเค็ล-วอลเลซ เป็นวิศวกรพัฒนาซอฟต์แวร์ที่ AWS Lex เขาสนุกกับการใช้ประโยชน์จากเทคโนโลยีเพื่อเพิ่มความสำเร็จของลูกค้า นอกเวลางานเขาหลงใหลในการทำอาหาร ใช้เวลากับเพื่อน ๆ และแบกเป้เที่ยว

ซ่งเฟิง เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสที่ AWS AI Labs ซึ่งเชี่ยวชาญด้านการประมวลผลภาษาธรรมชาติและปัญญาประดิษฐ์ งานวิจัยของเธอสำรวจแง่มุมต่าง ๆ ของสาขาเหล่านี้ รวมถึงการสร้างแบบจำลองบทสนทนาที่มีพื้นฐานจากเอกสาร การให้เหตุผลสำหรับบทสนทนาที่เน้นงาน และการสร้างข้อความโต้ตอบโดยใช้ข้อมูลหลายรูปแบบ

ซ่งเฟิง เป็นนักวิทยาศาสตร์ประยุกต์อาวุโสที่ AWS AI Labs ซึ่งเชี่ยวชาญด้านการประมวลผลภาษาธรรมชาติและปัญญาประดิษฐ์ งานวิจัยของเธอสำรวจแง่มุมต่าง ๆ ของสาขาเหล่านี้ รวมถึงการสร้างแบบจำลองบทสนทนาที่มีพื้นฐานจากเอกสาร การให้เหตุผลสำหรับบทสนทนาที่เน้นงาน และการสร้างข้อความโต้ตอบโดยใช้ข้อมูลหลายรูปแบบ

สะเก็ดดาว เป็นวิศวกรกับทีม AWS Lex เขาทำงานเพื่อปรับปรุงประสบการณ์ของนักพัฒนา Lex เพื่อช่วยนักพัฒนาสร้างแชทบอทที่เหมือนมนุษย์มากขึ้น นอกเวลาทำงาน เขาชอบท่องเที่ยว ค้นพบอาหารที่หลากหลาย และเรียนรู้เกี่ยวกับวัฒนธรรมต่างๆ

สะเก็ดดาว เป็นวิศวกรกับทีม AWS Lex เขาทำงานเพื่อปรับปรุงประสบการณ์ของนักพัฒนา Lex เพื่อช่วยนักพัฒนาสร้างแชทบอทที่เหมือนมนุษย์มากขึ้น นอกเวลาทำงาน เขาชอบท่องเที่ยว ค้นพบอาหารที่หลากหลาย และเรียนรู้เกี่ยวกับวัฒนธรรมต่างๆ

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- PlatoData.Network Vertical Generative Ai เพิ่มพลังให้กับตัวเอง เข้าถึงได้ที่นี่.

- เพลโตไอสตรีม. Web3 อัจฉริยะ ขยายความรู้ เข้าถึงได้ที่นี่.

- เพลโตESG. ยานยนต์ / EVs, คาร์บอน, คลีนเทค, พลังงาน, สิ่งแวดล้อม แสงอาทิตย์, การจัดการของเสีย. เข้าถึงได้ที่นี่.

- BlockOffsets การปรับปรุงการเป็นเจ้าของออฟเซ็ตด้านสิ่งแวดล้อมให้ทันสมัย เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/enhance-amazon-lex-with-conversational-faq-features-using-llms/

- :มี

- :เป็น

- :ที่ไหน

- $ ขึ้น

- 100

- 20

- a

- ความสามารถ

- เกี่ยวกับเรา

- เข้า

- การเข้าถึง

- ตาม

- ลงชื่อเข้าใช้

- ถูกต้อง

- ข้าม

- นอกจากนี้

- เพิ่มเติม

- นอกจากนี้

- ความได้เปรียบ

- หลังจาก

- ตัวแทน

- AI

- ทั้งหมด

- ช่วยให้

- ด้วย

- อเมซอน

- อเมซอน เล็กซ์

- อเมซอน SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- และ

- ประกาศ

- อื่น

- คำตอบ

- คำตอบ

- ที่คาดว่าจะ

- การใช้งาน

- การใช้งาน

- ประยุกต์

- เข้าใกล้

- วิธีการ

- เหมาะสม

- สถาปัตยกรรม

- เป็น

- บทความ

- เทียม

- ปัญญาประดิษฐ์

- AS

- ถาม

- ด้าน

- ช่วยเหลือ

- ที่เกี่ยวข้อง

- สมมติ

- At

- แนบมาด้วย

- เติม

- อัตโนมัติ

- หลีกเลี่ยง

- ทราบ

- AWS

- ยอดคงเหลือ

- ตาม

- BE

- รับ

- ก่อน

- กำลัง

- ด้านล่าง

- ประโยชน์ที่ได้รับ

- ระหว่าง

- เกิน

- บล็อก

- เพิ่ม

- ธ ปท

- ทั้งสอง

- บอท

- สร้าง

- ธุรกิจ

- แต่

- by

- CAN

- ความสามารถในการ

- ความสามารถ

- สามารถ

- กรณี

- กรณี

- ศูนย์

- ความท้าทาย

- การเปลี่ยนแปลง

- chatbot

- ทางเลือก

- Choose

- เลือก

- เมฆ

- รหัส

- สอดคล้องกัน

- ชุด

- คอลเลกชัน

- การผสมผสาน

- รวม

- บริษัท

- ความเข้ากันได้

- จับใจ

- ซับซ้อน

- ความซับซ้อน

- ส่วนประกอบ

- ครอบคลุม

- การคำนวณ

- ความมั่นใจ

- องค์ประกอบ

- เชื่อมต่อ

- พิจารณา

- พิจารณา

- ประกอบด้วย

- ปลอบใจ

- สร้าง

- ภาชนะ

- เนื้อหา

- สิ่งแวดล้อม

- ตามบริบท

- การสนทนา

- การสนทนา

- การสนทนา

- การปรุงอาหาร

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ได้

- คู่

- ครอบคลุม

- สร้าง

- ที่สร้างขึ้น

- สร้าง

- การสร้าง

- การสร้าง

- ลูกค้า

- ความสำเร็จของลูกค้า

- Customer Support

- ลูกค้า

- การปรับแต่ง

- ข้อมูล

- ฐานข้อมูล

- การตัดสินใจ

- ค่าเริ่มต้น

- กำหนด

- คำนิยาม

- ส่งมอบ

- การส่งมอบ

- ทำให้เป็นประชาธิปไตย

- สาธิต

- ปรับใช้

- นำไปใช้

- ได้รับการออกแบบ

- รายละเอียด

- รายละเอียด

- กำหนด

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- บทสนทนา

- ต่าง

- ยาก

- การกำกับ

- การค้นพบ

- กล่าวถึง

- การกระจาย

- หลาย

- do

- นักเทียบท่า

- เอกสาร

- เอกสาร

- ลง

- ขับเคลื่อน

- ในระหว่าง

- อย่างง่ายดาย

- มีประสิทธิภาพ

- มีประสิทธิภาพ

- ประสิทธิผล

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ง่าย

- การกำจัด

- การฝัง

- พนักงาน

- อำนาจ

- ทำให้สามารถ

- ช่วยให้

- ปลายทาง

- น่าสนใจ

- เครื่องยนต์

- วิศวกร

- เสริม

- ที่เพิ่มขึ้น

- การเสริมสร้าง

- เพื่อให้แน่ใจ

- Enterprise

- การค้นหาองค์กร

- ผู้ประกอบการ

- สิ่งแวดล้อม

- อีเธอร์ (ETH)

- เหตุการณ์

- ตัวอย่าง

- ตัวอย่าง

- การออกกำลังกาย

- รายจ่าย

- ประสบการณ์

- ประสบการณ์

- การทดลอง

- สำรวจ

- สำรวจ

- ใบหน้า

- อำนวยความสะดวก

- ปัจจัย

- เหยี่ยวนกเขา

- ฟอลส์

- คุ้นเคย

- คำถามที่พบบ่อย

- เร็วขึ้น

- คุณสมบัติ

- เฟด

- สาขา

- เนื้อไม่มีมัน

- กรอง

- ในที่สุด

- หา

- หา

- ชื่อจริง

- ความยืดหยุ่น

- ไหล

- โฟกัส

- ปฏิบัติตาม

- ดังต่อไปนี้

- สำหรับ

- รูป

- กรอบ

- มัก

- เพื่อน

- ราคาเริ่มต้นที่

- ฟังก์ชัน

- ต่อไป

- นอกจากนี้

- อนาคต

- กําไร

- สร้าง

- สร้าง

- สร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- เครื่องกำเนิดไฟฟ้า

- ได้รับ

- กำหนด

- ให้คำแนะนำ

- การจัดการ

- มี

- he

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- เธอ

- อดีต

- เป็นเจ้าภาพ

- โฮสติ้ง

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTML

- ที่ http

- HTTPS

- Hub

- เป็นมนุษย์

- ระบุ

- if

- ภาพ

- ภาพ

- ส่งผลกระทบ

- การดำเนินงาน

- นำเข้า

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- รวมทั้ง

- รวมเข้าด้วยกัน

- อิสระ

- ดัชนี

- การจัดทำดัชนี

- การแสดง

- ข้อมูล

- แจ้ง

- แรกเริ่ม

- เริ่มต้น

- อินพุต

- ตัวอย่าง

- คำแนะนำการใช้

- รวบรวม

- แบบบูรณาการ

- การบูรณาการ

- บูรณาการ

- Intelligence

- ความตั้งใจ

- ปฏิสัมพันธ์

- ปฏิสัมพันธ์

- การโต้ตอบ

- เข้าไป

- เปิดตัว

- เชิญ

- จะเรียก

- ที่เกี่ยวข้องกับการ

- ที่เกี่ยวข้องกับ

- ปัญหา

- IT

- ITS

- jpg

- ความรู้

- ห้องปฏิบัติการ

- ภาษา

- ใหญ่

- ขนาดใหญ่

- ชั้นนำ

- เรียนรู้

- การเรียนรู้

- ใช้ประโยชน์

- การใช้ประโยชน์

- กดไลก์

- น่าจะ

- ถูก จำกัด

- ผู้ฟัง

- สด

- ต่ำ

- เครื่อง

- เรียนรู้เครื่อง

- หลัก

- ทำ

- การทำ

- การจัดการ

- หลาย

- เพิ่ม

- มีคุณสมบัติตรงตาม

- ระเบียบวิธี

- วิธีการ

- ML

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ย้าย

- หลาย

- โดยธรรมชาติ

- ภาษาธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- การเข้าใจภาษาธรรมชาติ

- จำเป็น

- จำเป็นต้อง

- ความต้องการ

- ใหม่

- ถัดไป

- nlu

- หมายเหตุ

- การสังเกต

- of

- เสนอ

- การเสนอ

- เสนอ

- อย่างเป็นทางการ

- on

- ONE

- โอเพนซอร์ส

- ดีที่สุด

- เพิ่มประสิทธิภาพ

- Options

- or

- เป็นต้นฉบับ

- อื่นๆ

- ของเรา

- เอาท์พุต

- ด้านนอก

- เกิน

- ทั้งหมด

- แพ็คเกจ

- ส่วนหนึ่ง

- หลงใหล

- เส้นทาง

- รูปแบบไฟล์ PDF

- ดำเนินการ

- การปฏิบัติ

- ดำเนินการ

- สถานที่

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- กรุณา

- โพสต์

- ที่อาจเกิดขึ้น

- อำนาจ

- ที่มีประสิทธิภาพ

- ประยุกต์

- ข้อกำหนดเบื้องต้น

- นำเสนอ

- ดูตัวอย่าง

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- การประมวลผล

- ผลิต

- อย่างถูกต้อง

- พิสูจน์

- ให้

- ให้

- ให้

- การให้

- ผลัก

- หลาม

- Q & A

- คุณภาพ

- คำสั่ง

- คำถาม

- คำถาม

- อย่างรวดเร็ว

- พิสัย

- อันดับ

- ค่อนข้าง

- เมื่อเร็ว ๆ นี้

- ที่เกี่ยวข้อง

- ตรงประเด็น

- เอาออก

- การร้องขอ

- ต้องการ

- จำเป็นต้องใช้

- ความต้องการ

- ต้อง

- การวิจัย

- แหล่งข้อมูล

- คำตอบ

- การตอบสนอง

- รับผิดชอบ

- ผล

- ส่งผลให้

- ผลสอบ

- ทบทวน

- ขวา

- แข็งแรง

- วิ่ง

- s

- sagemaker

- เดียวกัน

- scalability

- ที่ปรับขนาดได้

- ขนาด

- สแกน

- นักวิทยาศาสตร์

- ขอบเขต

- คะแนน

- ได้อย่างลงตัว

- ค้นหา

- ที่สอง

- ส่วน

- เลือก

- บริการตัวเอง

- ระดับอาวุโส

- บริการ

- บริการ

- การให้บริการ

- ชุด

- การตั้งค่า

- การตั้งค่า

- หลาย

- น่า

- แสดง

- แสดงให้เห็นว่า

- ปิดตัวลง

- อย่างมีความหมาย

- ง่าย

- ขนาด

- ขนาด

- So

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- ทางออก

- โซลูชัน

- แก้

- แหล่ง

- แหล่งที่มา

- ระยะ

- ความเชี่ยวชาญ

- โดยเฉพาะ

- เฉพาะ

- ที่ระบุไว้

- การใช้จ่าย

- กอง

- ข้อความที่เริ่ม

- เริ่มต้น

- ขั้นตอน

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- กลยุทธ์

- จุดแข็ง

- ความสำเร็จ

- อย่างเช่น

- เหมาะสม

- สนับสนุน

- ที่สนับสนุน

- ระบบ

- ระบบ

- ปรับปรุง

- เอา

- ใช้เวลา

- งาน

- งาน

- ทีม

- เทคนิค

- เทคโนโลยี

- ทดสอบ

- การสร้างข้อความ

- กว่า

- ที่

- พื้นที่

- ที่มา

- ของพวกเขา

- พวกเขา

- แล้วก็

- ดังนั้น

- ล้อยางขัดเหล่านี้ติดตั้งบนแกน XNUMX (มม.) ผลิตภัณฑ์นี้ถูกผลิตในหลายรูปทรง และหลากหลายเบอร์ความแน่นหนาของปริมาณอนุภาคขัดของมัน จะทำให้ท่านได้รับประสิทธิภาพสูงในการขัดและการใช้งานที่ยาวนาน

- พวกเขา

- ของบุคคลที่สาม

- นี้

- ธรณีประตู

- ตลอด

- เวลา

- ครั้ง

- เคล็ดลับ

- ยักษ์

- ไปยัง

- ในวันนี้

- เครื่องมือ

- แบบดั้งเดิม

- การเปลี่ยนแปลง

- การเดินทาง

- ชนิด

- ชนิด

- เป็นปกติ

- ความเข้าใจ

- อัปโหลด

- URL

- การใช้

- ใช้

- ใช้กรณี

- มือสอง

- ผู้ใช้งาน

- ประสบการณ์ของผู้ใช้

- ผู้ใช้

- ใช้

- การใช้

- มักจะ

- ใช้ประโยชน์

- การใช้ประโยชน์

- ความหลากหลาย

- ต่างๆ

- ผ่านทาง

- เสมือน

- เสียงพูด

- ทาง..

- วิธี

- we

- เว็บ

- บริการเว็บ

- คือ

- เมื่อ

- ที่

- กว้าง

- ช่วงกว้าง

- จะ

- กับ

- ภายใน

- ไม่มี

- งาน

- เวิร์กโฟลว์

- การทำงาน

- โรงงาน

- ปี

- อัตราผลตอบแทน

- เธอ

- ของคุณ

- ลมทะเล