ทุกๆ วัน อุปกรณ์ของ Amazon จะประมวลผลและวิเคราะห์ธุรกรรมหลายพันล้านรายการจากการจัดส่งทั่วโลก สินค้าคงคลัง กำลังการผลิต การจัดหา การขาย การตลาด ผู้ผลิต และทีมบริการลูกค้า ข้อมูลนี้ใช้ในการจัดหาสินค้าคงคลังของอุปกรณ์เพื่อตอบสนองความต้องการของลูกค้าของ Amazon ด้วยปริมาณข้อมูลที่แสดงอัตราการเติบโตเป็นตัวเลขสองหลักต่อปี และการแพร่ระบาดของโควิดที่ส่งผลกระทบต่อระบบโลจิสติกส์ทั่วโลกในปี 2021 การปรับขนาดและสร้างข้อมูลที่เกือบเรียลไทม์จึงมีความสำคัญมากขึ้น

โพสต์นี้แสดงให้คุณเห็นถึงวิธีที่เราย้ายข้อมูลไปยัง Data Lake แบบไร้เซิร์ฟเวอร์ที่สร้างขึ้นบน AWS ซึ่งใช้ข้อมูลโดยอัตโนมัติจากหลายแหล่งและรูปแบบที่แตกต่างกัน นอกจากนี้ยังสร้างโอกาสเพิ่มเติมสำหรับนักวิทยาศาสตร์ข้อมูลและวิศวกรของเราในการใช้บริการ AI และการเรียนรู้ของเครื่อง (ML) เพื่อป้อนและวิเคราะห์ข้อมูลอย่างต่อเนื่อง

ความท้าทายและข้อกังวลด้านการออกแบบ

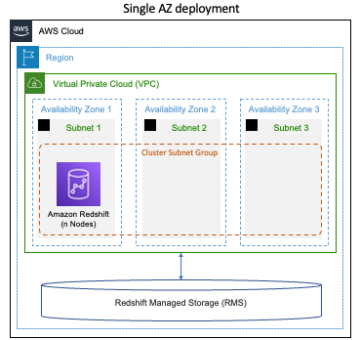

สถาปัตยกรรมดั้งเดิมของเราใช้เป็นหลัก อเมซอน อีลาสติก คอมพิวท์ คลาวด์ (Amazon EC2) เพื่อแยกข้อมูลจากแหล่งข้อมูลที่แตกต่างกันภายในและ REST APIs ด้วยการรวมกันของ บริการจัดเก็บข้อมูลอย่างง่ายของ Amazon (Amazon S3) เพื่อโหลดข้อมูลและ อเมซอน Redshift เพื่อนำไปวิเคราะห์และจัดทำใบสั่งซื้อต่อไป

เราพบว่าวิธีการนี้ทำให้เกิดข้อบกพร่องเล็กน้อย และด้วยเหตุนี้จึงทำให้เกิดการปรับปรุงในด้านต่างๆ ต่อไปนี้:

- ความเร็วของนักพัฒนา – เนื่องจากขาดการรวมและการค้นพบสคีมา ซึ่งเป็นสาเหตุหลักที่ทำให้รันไทม์ล้มเหลว นักพัฒนาจึงมักใช้เวลาในการจัดการกับปัญหาด้านการดำเนินงานและการบำรุงรักษา

- scalability – ชุดข้อมูลเหล่านี้ส่วนใหญ่ใช้ร่วมกันทั่วโลก ดังนั้นเราจึงต้องปฏิบัติตามขีดจำกัดการปรับสเกลในขณะที่ทำการสืบค้นข้อมูล

- การบำรุงรักษาโครงสร้างพื้นฐานน้อยที่สุด – กระบวนการปัจจุบันครอบคลุมการประมวลผลหลายรายการขึ้นอยู่กับแหล่งข้อมูล ดังนั้นการลดการบำรุงรักษาโครงสร้างพื้นฐานจึงเป็นสิ่งสำคัญ

- การตอบสนองต่อการเปลี่ยนแปลงของแหล่งข้อมูล – ระบบปัจจุบันของเราได้รับข้อมูลจากที่เก็บข้อมูลและบริการที่แตกต่างกันต่างๆ การอัปเดตใด ๆ สำหรับบริการเหล่านั้นจะใช้เวลาหลายเดือนของรอบการพัฒนา เวลาตอบสนองสำหรับแหล่งข้อมูลเหล่านี้มีความสำคัญต่อผู้มีส่วนได้ส่วนเสียหลักของเรา ดังนั้นเราจึงต้องใช้แนวทางที่ขับเคลื่อนด้วยข้อมูลเพื่อเลือกสถาปัตยกรรมที่มีประสิทธิภาพสูง

- การจัดเก็บและความซ้ำซ้อน – เนื่องจากที่เก็บข้อมูลและแบบจำลองที่แตกต่างกัน จึงเป็นเรื่องยากที่จะจัดเก็บชุดข้อมูลที่แตกต่างจากทีมผู้มีส่วนได้ส่วนเสียทางธุรกิจต่างๆ ดังนั้น การกำหนดเวอร์ชันพร้อมกับข้อมูลส่วนเพิ่มและส่วนต่างเพื่อเปรียบเทียบจะให้ความสามารถที่น่าทึ่งในการสร้างแผนที่เหมาะสมยิ่งขึ้น

- ผู้ลี้ภัยและการเข้าถึง – เนื่องจากธรรมชาติของลอจิสติกส์มีความผันผวน ทีมผู้มีส่วนได้ส่วนเสียทางธุรกิจบางกลุ่มจึงมีความต้องการในการวิเคราะห์ข้อมูลตามความต้องการและสร้างแผนที่เหมาะสมที่สุดเกือบเรียลไทม์สำหรับใบสั่งซื้อ สิ่งนี้ทำให้เกิดความต้องการทั้งการสำรวจและการพุชข้อมูลเพื่อเข้าถึงและวิเคราะห์ในเวลาใกล้เคียงเรียลไทม์

กลยุทธ์การดำเนินการ

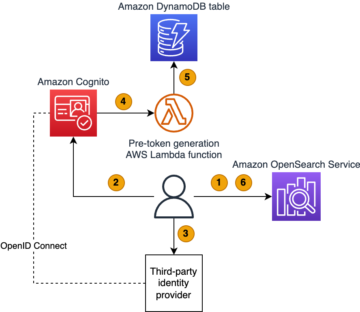

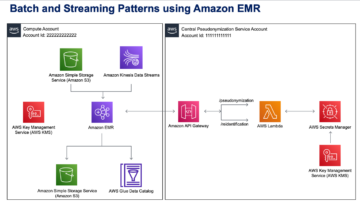

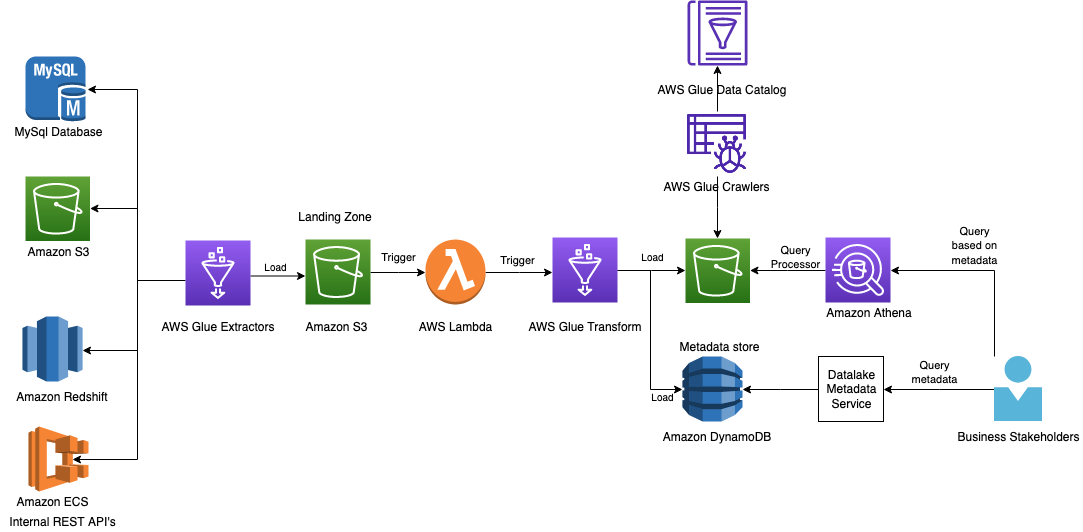

ตามข้อกำหนดเหล่านี้ เราเปลี่ยนกลยุทธ์และเริ่มวิเคราะห์แต่ละปัญหาเพื่อระบุแนวทางแก้ไข ในทางสถาปัตยกรรม เราเลือกโมเดลแบบไร้เซิร์ฟเวอร์ และสายการดำเนินการสถาปัตยกรรม Data Lake หมายถึงช่องว่างทางสถาปัตยกรรมทั้งหมดและคุณลักษณะที่ท้าทายที่เราพิจารณาว่าเป็นส่วนหนึ่งของการปรับปรุง จากมุมมองด้านการปฏิบัติงาน เราได้ออกแบบรูปแบบความรับผิดชอบร่วมกันใหม่สำหรับการกลืนข้อมูลโดยใช้ AWS กาว แทนบริการภายใน (REST API) ที่ออกแบบบน Amazon EC2 เพื่อดึงข้อมูล เรายังใช้ AWS แลมบ์ดา สำหรับการประมวลผลข้อมูล จากนั้นเราก็เลือก อเมซอน อาเธน่า เป็นบริการสอบถามของเรา เราได้เพิ่มเพื่อเพิ่มประสิทธิภาพและปรับปรุงความเร็วของนักพัฒนาสำหรับผู้ใช้ข้อมูลของเรา อเมซอน ไดนาโมดีบี เป็นที่เก็บข้อมูลเมตาสำหรับแหล่งข้อมูลต่างๆ ที่ลงจอดใน Data Lake การตัดสินใจทั้งสองนี้เป็นแรงผลักดันให้เราตัดสินใจออกแบบและนำไปใช้งานทั้งหมด

แผนภาพต่อไปนี้แสดงสถาปัตยกรรม

ในส่วนต่อไปนี้ เราจะดูรายละเอียดแต่ละส่วนประกอบในสถาปัตยกรรมโดยละเอียดมากขึ้นเมื่อเราดำเนินการผ่านโฟลว์กระบวนการ

AWS Glue สำหรับ ETL

เพื่อตอบสนองความต้องการของลูกค้าในขณะที่สนับสนุนขนาดแหล่งข้อมูลของธุรกิจใหม่ จำเป็นอย่างยิ่งสำหรับเราที่จะมีความคล่องตัว ความสามารถในการปรับขนาด และการตอบสนองในระดับสูงในการสืบค้นแหล่งข้อมูลต่างๆ

AWS Glue เป็นบริการผสานรวมข้อมูลแบบไร้เซิร์ฟเวอร์ที่ช่วยให้ผู้ใช้วิเคราะห์ค้นหา เตรียม ย้าย และผสานรวมข้อมูลจากหลายแหล่งได้อย่างง่ายดาย คุณสามารถใช้สำหรับการวิเคราะห์ ML และการพัฒนาแอปพลิเคชัน นอกจากนี้ยังมีประสิทธิภาพเพิ่มเติมและเครื่องมือ DataOps สำหรับการเขียน การรันงาน และการนำเวิร์กโฟลว์ทางธุรกิจไปใช้

ด้วย AWS Glue คุณสามารถค้นพบและเชื่อมต่อกับแหล่งข้อมูลที่หลากหลายกว่า 70 แห่งและจัดการข้อมูลของคุณในแคตตาล็อกข้อมูลส่วนกลาง คุณสามารถสร้าง เรียกใช้ และตรวจสอบการแยก แปลง และโหลดไปป์ไลน์ (ETL) แบบมองเห็นได้เพื่อโหลดข้อมูลลงใน Data Lake ของคุณ นอกจากนี้ คุณสามารถค้นหาและสืบค้นข้อมูลในแคตตาล็อกได้ทันทีโดยใช้ Athena อเมซอน EMRและ อเมซอน Redshift Spectrum.

AWS Glue ช่วยให้เราเชื่อมต่อกับข้อมูลในที่เก็บข้อมูลต่างๆ แก้ไขและล้างข้อมูลได้ตามต้องการ และโหลดข้อมูลลงในที่จัดเก็บที่จัดเตรียมโดย AWS เพื่อดูรวมเป็นหนึ่ง งาน AWS Glue สามารถตั้งเวลาหรือเรียกใช้ตามความต้องการเพื่อดึงข้อมูลจากทรัพยากรของลูกค้าและจาก Data Lake

ความรับผิดชอบบางประการของงานเหล่านี้มีดังนี้:

- การแยกและการแปลงเอนทิตีต้นทางเป็นเอนทิตีข้อมูล

- ปรับปรุงข้อมูลให้ประกอบด้วยปี เดือน และวัน เพื่อการจัดรายการที่ดีขึ้น และใส่รหัสสแนปชอตเพื่อการสืบค้นที่ดียิ่งขึ้น

- ดำเนินการตรวจสอบอินพุตและสร้างเส้นทางสำหรับ Amazon S3

- เชื่อมโยงข้อมูลเมตาที่ได้รับการรับรองตามระบบต้นทาง

การสืบค้น REST API จากบริการภายในเป็นหนึ่งในความท้าทายหลักของเรา และเมื่อพิจารณาถึงโครงสร้างพื้นฐานขั้นต่ำแล้ว เราจึงต้องการใช้สิ่งเหล่านี้ในโครงการนี้ ตัวเชื่อมต่อ AWS Glue ช่วยให้เราปฏิบัติตามข้อกำหนดและเป้าหมายได้ ในการสืบค้นข้อมูลจาก REST API และแหล่งข้อมูลอื่นๆ เราใช้โมดูล PySpark และ JDBC

AWS Glue รองรับประเภทการเชื่อมต่อที่หลากหลาย สำหรับรายละเอียดเพิ่มเติม โปรดดูที่ ประเภทการเชื่อมต่อและตัวเลือกสำหรับ ETL ใน AWS Glue.

ที่ฝากข้อมูล S3 เป็นโซนลงจอด

เราใช้บัคเก็ต S3 เป็นโซนเชื่อมโยงไปถึงทันทีของข้อมูลที่แยกออกมา ซึ่งได้รับการประมวลผลเพิ่มเติมและเพิ่มประสิทธิภาพ

แลมบ์ดาเป็นทริกเกอร์ AWS Glue ETL

เราเปิดใช้งานการแจ้งเตือนเหตุการณ์ S3 บนบัคเก็ต S3 เพื่อทริกเกอร์ Lambda ซึ่งแบ่งพาร์ติชั่นข้อมูลของเราเพิ่มเติม ข้อมูลถูกแบ่งพาร์ติชันบน InputDataSetName ปี เดือน และวันที่ ตัวประมวลผลแบบสอบถามที่ทำงานบนข้อมูลนี้จะสแกนเฉพาะชุดย่อยของข้อมูลเพื่อเพิ่มประสิทธิภาพต้นทุนและประสิทธิภาพที่ดีขึ้น ข้อมูลของเราสามารถจัดเก็บในรูปแบบต่างๆ เช่น CSV, JSON และ Parquet

ข้อมูลดิบไม่เหมาะสำหรับกรณีการใช้งานส่วนใหญ่ของเราในการสร้างแผนที่ดีที่สุด เนื่องจากมักจะมีประเภทข้อมูลที่ซ้ำกันหรือไม่ถูกต้อง สิ่งสำคัญที่สุดคือ ข้อมูลมีหลายรูปแบบ แต่เราแก้ไขข้อมูลอย่างรวดเร็วและสังเกตประสิทธิภาพการสืบค้นที่เพิ่มขึ้นอย่างมากจากการใช้รูปแบบ Parquet ที่นี่ เราใช้หนึ่งในเคล็ดลับการปฏิบัติงานใน เคล็ดลับการปรับแต่งประสิทธิภาพ 10 อันดับแรกสำหรับ Amazon Athena.

งาน AWS Glue สำหรับ ETL

เราต้องการการแยกข้อมูลและการเข้าถึงที่ดีขึ้น ดังนั้นเราจึงเลือกที่จะมีบัคเก็ต S3 อื่นเพื่อปรับปรุงประสิทธิภาพให้ดียิ่งขึ้น เราใช้งาน AWS Glue เดียวกันเพื่อแปลงและโหลดข้อมูลเพิ่มเติมลงในบัคเก็ต S3 ที่จำเป็นและส่วนหนึ่งของข้อมูลเมตาที่แยกออกมาไปยัง DynamoDB

DynamoDB เป็นที่เก็บข้อมูลเมตา

ตอนนี้เรามีข้อมูลแล้ว ผู้มีส่วนได้ส่วนเสียในธุรกิจต่างๆ ก็ใช้ข้อมูลนั้นต่อไป สิ่งนี้ทำให้เรามีคำถามสองข้อ: แหล่งข้อมูลใดอยู่ใน Data Lake และเวอร์ชันใด เราเลือก DynamoDB เป็นที่เก็บข้อมูลเมตาของเรา ซึ่งให้รายละเอียดล่าสุดแก่ผู้บริโภคในการสืบค้นข้อมูลอย่างมีประสิทธิภาพ ชุดข้อมูลทุกชุดในระบบของเราได้รับการระบุโดยไม่ซ้ำกันโดยรหัสสแน็ปช็อต ซึ่งเราสามารถค้นหาได้จากที่เก็บข้อมูลเมตาของเรา ลูกค้าเข้าถึงที่เก็บข้อมูลนี้ด้วย API

Amazon S3 เป็น Data Lake

เพื่อให้ข้อมูลมีคุณภาพดีขึ้น เราได้แยกข้อมูลที่สมบูรณ์ลงในบัคเก็ต S3 อื่นที่มีงาน AWS Glue เดียวกัน

โปรแกรมรวบรวมข้อมูล AWS Glue

โปรแกรมรวบรวมข้อมูลเป็น "ซอสลับ" ที่ช่วยให้เราสามารถตอบสนองต่อการเปลี่ยนแปลงของสคีมา ตลอดกระบวนการ เราเลือกที่จะทำให้แต่ละขั้นตอนเป็นแบบไม่เชื่อเรื่องสคีมามากที่สุดเท่าที่จะเป็นไปได้ ซึ่งทำให้การเปลี่ยนแปลงสคีมาใดๆ ดำเนินไปจนกว่าจะถึง AWS Glue ด้วยโปรแกรมรวบรวมข้อมูล เราสามารถรักษาการเปลี่ยนแปลงที่ไม่เชื่อเรื่องพระเจ้าที่เกิดขึ้นกับสคีมา สิ่งนี้ช่วยให้เรารวบรวมข้อมูลโดยอัตโนมัติจาก Amazon S3 และสร้างสคีมาและตาราง

แคตตาล็อกข้อมูลกาว AWS Data

แคตตาล็อกข้อมูลช่วยให้เรารักษาแคตตาล็อกเป็นดัชนีไปยังตำแหน่งของข้อมูล สคีมา และเมตริกรันไทม์ใน Amazon S3 ข้อมูลใน Data Catalog ถูกจัดเก็บเป็นตารางข้อมูลเมตา ซึ่งแต่ละตารางจะระบุที่เก็บข้อมูลเดียว

Athena สำหรับแบบสอบถาม SQL

Athena เป็นบริการสืบค้นข้อมูลเชิงโต้ตอบที่ทำให้ง่ายต่อการวิเคราะห์ข้อมูลใน Amazon S3 โดยใช้ SQL มาตรฐาน Athena เป็นแบบไร้เซิร์ฟเวอร์ ดังนั้นจึงไม่มีโครงสร้างพื้นฐานให้จัดการ และคุณจ่ายเฉพาะการสืบค้นที่คุณเรียกใช้เท่านั้น เราพิจารณาความเสถียรในการปฏิบัติงานและการเพิ่มความเร็วของนักพัฒนาเป็นปัจจัยหลักในการปรับปรุงของเรา

เรายังปรับกระบวนการค้นหา Athena ให้เหมาะสมยิ่งขึ้นเพื่อให้ผู้ใช้สามารถเสียบค่าและเคียวรีเพื่อรับข้อมูลจาก Athena โดยสร้างสิ่งต่อไปนี้:

- An ชุดพัฒนา AWS Cloud เทมเพลต (AWS CDK) เพื่อสร้างโครงสร้างพื้นฐาน Athena และ AWS Identity และการจัดการการเข้าถึง (IAM) บทบาทในการเข้าถึงบัคเก็ต Data Lake S3 และ Data Catalog จากบัญชีใดๆ

- ไลบรารีเพื่อให้ไคลเอ็นต์สามารถจัดเตรียมบทบาท IAM, เคียวรี, รูปแบบข้อมูล และตำแหน่งเอาต์พุตเพื่อเริ่มต้นเคียวรี Athena และรับสถานะและผลลัพธ์ของคิวรีที่เรียกใช้ในบัคเก็ตที่พวกเขาเลือก

ในการสืบค้น Athena เป็นกระบวนการสองขั้นตอน:

- StartQueryExecution – สิ่งนี้เริ่มการเรียกใช้แบบสอบถามและรับรหัสการรัน ผู้ใช้สามารถระบุตำแหน่งเอาต์พุตที่จะจัดเก็บเอาต์พุตของแบบสอบถาม

- GetQueryExecution – สิ่งนี้ได้รับสถานะแบบสอบถามเนื่องจากการรันเป็นแบบอะซิงโครนัส เมื่อสำเร็จ คุณสามารถสอบถามผลลัพธ์ในไฟล์ S3 หรือผ่าน API.

วิธีการช่วยเหลือสำหรับการเริ่มต้นการเรียกใช้แบบสอบถามและรับผลลัพธ์จะอยู่ในไลบรารี

บริการข้อมูลเมตาของ Data Lake

บริการนี้ได้รับการพัฒนาแบบกำหนดเองและโต้ตอบกับ DynamoDB เพื่อรับข้อมูลเมตา (ชื่อชุดข้อมูล, ID สแน็ปช็อต, สตริงพาร์ติชัน, การประทับเวลา และลิงก์ S3 ของข้อมูล) ในรูปแบบของ REST API เมื่อค้นพบสคีมา ลูกค้าจะใช้ Athena เป็นตัวประมวลผลแบบสอบถามเพื่อสืบค้นข้อมูล

เนื่องจากชุดข้อมูลทั้งหมดมี ID สแน็ปช็อตถูกแบ่งพาร์ติชัน การสอบถามเข้าร่วมจึงไม่ส่งผลให้มีการสแกนทั้งตาราง แต่จะเป็นการสแกนพาร์ติชันใน Amazon S3 เท่านั้น เราใช้ Athena เป็นตัวประมวลผลการสืบค้นเนื่องจากความสะดวกในการจัดการโครงสร้างพื้นฐานการสืบค้นของเรา ต่อมา หากเรารู้สึกว่าต้องการอะไรเพิ่มเติม เราสามารถใช้ Redshift Spectrum หรือ Amazon EMR ก็ได้

สรุป

ทีมอุปกรณ์ของ Amazon ค้นพบคุณค่าที่สำคัญโดยการย้ายไปยังสถาปัตยกรรม Data Lake โดยใช้ AWS Glue ซึ่งช่วยให้ผู้มีส่วนได้ส่วนเสียทางธุรกิจทั่วโลกหลายรายสามารถนำเข้าข้อมูลด้วยวิธีที่มีประสิทธิผลมากขึ้น สิ่งนี้ทำให้ทีมสามารถสร้างแผนการที่เหมาะสมที่สุดในการวางคำสั่งซื้ออุปกรณ์โดยการวิเคราะห์ชุดข้อมูลต่างๆ ในเวลาใกล้เคียงเรียลไทม์ด้วยตรรกะทางธุรกิจที่เหมาะสมเพื่อแก้ปัญหาของห่วงโซ่อุปทาน อุปสงค์ และการคาดการณ์

จากมุมมองด้านการดำเนินงาน การลงทุนได้เริ่มให้ผลตอบแทนแล้ว:

- ทำให้กลไกการส่งผ่านข้อมูล การจัดเก็บ และการดึงข้อมูลของเราเป็นมาตรฐาน ซึ่งช่วยประหยัดเวลาในการเริ่มใช้งาน ก่อนการนำระบบนี้ไปใช้ ชุดข้อมูลหนึ่งชุดใช้เวลา 1 เดือนในการเริ่มใช้งาน เนื่องจากสถาปัตยกรรมใหม่ของเรา เราจึงสามารถใช้ชุดข้อมูลใหม่ได้ 15 ชุดภายในเวลาไม่ถึง 2 เดือน ซึ่งช่วยเพิ่มความคล่องตัวได้ถึง 70%

- ช่วยขจัดปัญหาคอขวดในการปรับขนาด สร้างระบบที่เป็นเนื้อเดียวกันซึ่งสามารถปรับขนาดได้อย่างรวดเร็วเป็นพันครั้ง

- โซลูชันได้เพิ่มสคีมาและการตรวจสอบคุณภาพข้อมูลก่อนที่จะยอมรับอินพุตใดๆ และปฏิเสธหากพบการละเมิดคุณภาพข้อมูล

- มันทำให้ง่ายต่อการดึงชุดข้อมูลในขณะที่รองรับการจำลองในอนาคตและกรณีการใช้งานของผู้ทดสอบกลับซึ่งต้องการอินพุตที่เป็นเวอร์ชัน สิ่งนี้จะทำให้การเปิดตัวและการทดสอบโมเดลง่ายขึ้น

- โซลูชันนี้สร้างโครงสร้างพื้นฐานทั่วไปที่สามารถขยายไปยังทีมอื่นๆ ทั่วทั้ง DIAL ได้โดยง่าย ซึ่งมีปัญหาที่คล้ายกันกับการนำเข้าข้อมูล การจัดเก็บ และการดึงข้อมูลกรณีการใช้งาน

- ต้นทุนการดำเนินงานของเราลดลงเกือบ 90%

- Data Lake นี้สามารถเข้าถึงได้อย่างมีประสิทธิภาพโดยนักวิทยาศาสตร์ข้อมูลและวิศวกรของเราเพื่อดำเนินการวิเคราะห์อื่นๆ และมีวิธีคาดการณ์เป็นโอกาสในอนาคตในการสร้างแผนการที่แม่นยำสำหรับใบสั่งซื้อ

ขั้นตอนในโพสต์นี้สามารถช่วยคุณวางแผนสร้างกลยุทธ์ข้อมูลสมัยใหม่ที่คล้ายคลึงกันโดยใช้บริการที่จัดการโดย AWS เพื่อนำเข้าข้อมูลจากแหล่งที่มาต่างๆ สร้างแคตตาล็อกข้อมูลเมตาโดยอัตโนมัติ แบ่งปันข้อมูลอย่างราบรื่นระหว่างที่จัดเก็บข้อมูลดิบและคลังข้อมูล และสร้างการแจ้งเตือนในเหตุการณ์ ของความล้มเหลวเวิร์กโฟลว์ข้อมูลออร์เคสตรา

เกี่ยวกับผู้แต่ง

อวินาช กอลลูริ เป็นสถาปนิกโซลูชันอาวุโสที่ AWS เขาทำงานร่วมกับ Amazon Alexa และอุปกรณ์ต่างๆ เพื่อออกแบบและออกแบบโซลูชันแบบกระจายที่ทันสมัย ความมุ่งมั่นของเขาคือการสร้างโซลูชันที่คุ้มค่าและปรับขนาดได้สูงบน AWS เวลาว่างชอบทำอาหารฟิวชั่นและท่องเที่ยว

อวินาช กอลลูริ เป็นสถาปนิกโซลูชันอาวุโสที่ AWS เขาทำงานร่วมกับ Amazon Alexa และอุปกรณ์ต่างๆ เพื่อออกแบบและออกแบบโซลูชันแบบกระจายที่ทันสมัย ความมุ่งมั่นของเขาคือการสร้างโซลูชันที่คุ้มค่าและปรับขนาดได้สูงบน AWS เวลาว่างชอบทำอาหารฟิวชั่นและท่องเที่ยว

วิปุล เวอร์มา เป็น Sr.Software Engineer ที่ Amazon.com เขาอยู่กับ Amazon มาตั้งแต่ปี 2015 แก้ปัญหาความท้าทายในโลกแห่งความจริงด้วยเทคโนโลยีที่ส่งผลกระทบโดยตรงและปรับปรุงชีวิตของลูกค้า Amazon เวลาว่างชอบเดินป่า

วิปุล เวอร์มา เป็น Sr.Software Engineer ที่ Amazon.com เขาอยู่กับ Amazon มาตั้งแต่ปี 2015 แก้ปัญหาความท้าทายในโลกแห่งความจริงด้วยเทคโนโลยีที่ส่งผลกระทบโดยตรงและปรับปรุงชีวิตของลูกค้า Amazon เวลาว่างชอบเดินป่า

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/big-data/how-amazon-devices-scaled-and-optimized-real-time-demand-and-supply-forecasts-using-serverless-analytics/

- 1

- 10

- 100

- 2021

- 70

- a

- ความสามารถ

- สามารถ

- เข้า

- Accessed

- การเข้าถึง

- ได้รับการรับรอง

- ถูกต้อง

- ข้าม

- การกระทำ

- ที่เพิ่ม

- เพิ่มเติม

- AI

- Alexa

- ทั้งหมด

- ช่วยให้

- แล้ว

- อเมซอน

- amazon alexa

- Amazon EC2

- อเมซอน EMR

- Amazon.com

- การวิเคราะห์

- การวิเคราะห์

- วิเคราะห์

- วิเคราะห์

- และ

- อื่น

- API

- APIs

- การใช้งาน

- การพัฒนาโปรแกรมประยุกต์

- เข้าใกล้

- เหมาะสม

- ในเชิงสถาปัตยกรรม

- สถาปัตยกรรม

- พื้นที่

- การเขียน

- อัตโนมัติ

- AWS

- AWS กาว

- กลับ

- ตาม

- เพราะ

- ก่อน

- ดีกว่า

- ระหว่าง

- พันล้าน

- สร้าง

- สร้าง

- ธุรกิจ

- ที่เรียกว่า

- ความจุ

- กรณี

- แค็ตตาล็อก

- แคตตาล็อก

- ส่วนกลาง

- โซ่

- ความท้าทาย

- ท้าทาย

- การเปลี่ยนแปลง

- ทางเลือก

- เลือก

- ไคลเอนต์

- ลูกค้า

- เมฆ

- COM

- การผสมผสาน

- ร่วมกัน

- เปรียบเทียบ

- ส่วนประกอบ

- คำนวณ

- เชื่อมต่อ

- การเชื่อมต่อ

- ถือว่า

- พิจารณา

- บริโภค

- ผู้บริโภค

- อย่างต่อเนื่อง

- การปรุงอาหาร

- แกน

- ราคา

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ค่าใช้จ่าย

- ได้

- Covidien

- ไม้เลื้อย

- สร้าง

- ที่สร้างขึ้น

- การสร้าง

- วิกฤติ

- ปัจจุบัน

- ประเพณี

- ลูกค้า

- บริการลูกค้า

- ลูกค้า

- รอบ

- ข้อมูล

- การรวมข้อมูล

- ดาต้าเลค

- การประมวลผล

- คุณภาพของข้อมูล

- กลยุทธ์ข้อมูล

- คลังข้อมูล

- ที่ขับเคลื่อนด้วยข้อมูล

- ชุดข้อมูล

- วันที่

- วัน

- การซื้อขาย

- การตัดสินใจ

- การตัดสินใจ

- องศา

- ความต้องการ

- ความต้องการ

- ทั้งนี้ขึ้นอยู่กับ

- ออกแบบ

- ได้รับการออกแบบ

- รายละเอียด

- รายละเอียด

- แน่นอน

- พัฒนา

- ผู้พัฒนา

- นักพัฒนา

- พัฒนาการ

- อุปกรณ์

- ต่าง

- โดยตรง

- ค้นพบ

- ค้นพบ

- การค้นพบ

- กระจาย

- หลาย

- ไม่

- ที่ซ้ำกัน

- แต่ละ

- อย่างง่ายดาย

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ทั้ง

- เปิดการใช้งาน

- ช่วยให้

- วิศวกร

- วิศวกร

- อุดม

- เอกลักษณ์

- อีเธอร์ (ETH)

- เหตุการณ์

- ทุกๆ

- สารสกัด

- ดึงข้อมูล

- ปัจจัย

- ความล้มเหลว

- ลดลง

- คุณสมบัติ

- สองสาม

- เนื้อไม่มีมัน

- ไหล

- ดังต่อไปนี้

- ดังต่อไปนี้

- พยากรณ์

- ฟอร์ม

- รูป

- พบ

- ราคาเริ่มต้นที่

- เต็ม

- ต่อไป

- นอกจากนี้

- การผสม

- อนาคต

- กําไร

- สร้าง

- การสร้าง

- รุ่น

- ได้รับ

- ได้รับ

- เหตุการณ์ที่

- ธุรกิจระดับโลก

- โลก

- เป้าหมาย

- การเจริญเติบโต

- มี

- ช่วย

- ช่วย

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- จุดสูง

- ประสิทธิภาพสูง

- อย่างสูง

- การธุดงค์

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HTML

- HTTPS

- AMI

- ในอุดมคติ

- ระบุ

- แยกแยะ

- เอกลักษณ์

- ทันที

- ทันที

- ส่งผลกระทบ

- การดำเนินงาน

- การดำเนินการ

- ปรับปรุง

- การปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- ประกอบด้วย

- รวมถึง

- ที่เพิ่มขึ้น

- ดัชนี

- ข้อมูล

- โครงสร้างพื้นฐาน

- อินพุต

- แทน

- รวบรวม

- บูรณาการ

- การโต้ตอบ

- เชิงโต้ตอบ

- ภายใน

- เปิดตัว

- สินค้าคงคลัง

- การลงทุน

- ปัญหา

- ปัญหา

- IT

- การสัมภาษณ์

- งาน

- ร่วม

- JSON

- คีย์

- ไม่มี

- ทะเลสาบ

- เชื่อมโยงไปถึง

- ล่าสุด

- การเปิดตัว

- การเรียนรู้

- มรดก

- ห้องสมุด

- ชีวิต

- ขีด จำกัด

- Line

- LINK

- โหลด

- ที่ตั้ง

- โลจิสติก

- ดู

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- เก็บรักษา

- การบำรุงรักษา

- ทำ

- ทำให้

- จัดการ

- การจัดการ

- การตลาด

- พบ

- เมตาดาต้า

- วิธี

- ตัวชี้วัด

- ต่ำสุด

- ML

- แบบ

- โมเดล

- ทันสมัย

- การแก้ไข

- โมดูล

- การตรวจสอบ

- เดือน

- เดือน

- ข้อมูลเพิ่มเติม

- มากที่สุด

- ย้าย

- การย้าย

- หลาย

- ชื่อ

- ธรรมชาติ

- จำเป็นต้อง

- จำเป็น

- ใหม่

- การแจ้งเตือน

- ออนบอร์ด

- การดูแลพนักงานใหม่

- ONE

- การดำเนินงาน

- การดำเนินงาน

- โอกาส

- โอกาส

- ดีที่สุด

- การเพิ่มประสิทธิภาพ

- เพิ่มประสิทธิภาพ

- การปรับให้เหมาะสม

- Options

- คำสั่งซื้อ

- อื่นๆ

- การระบาดกระจายทั่ว

- ส่วนหนึ่ง

- กิเลส

- เส้นทาง

- ชำระ

- เปอร์เซ็นต์

- ดำเนินการ

- การปฏิบัติ

- มุมมอง

- สถานที่

- แผนการ

- แผน

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- เป็นไปได้

- โพสต์

- เตรียมการ

- ส่วนใหญ่

- ประถม

- ปัญหาที่เกิดขึ้น

- กระบวนการ

- การประมวลผล

- หน่วยประมวลผล

- ผู้ผลิต

- ประสิทธิผล

- ผลผลิต

- โครงการ

- ให้

- ให้

- ซื้อ

- ใจเร่งเร้า

- คุณภาพ

- คำถาม

- อย่างรวดเร็ว

- คะแนน

- ดิบ

- ข้อมูลดิบ

- มาถึง

- โลกแห่งความจริง

- เรียลไทม์

- เหตุผล

- สูตรอาหาร

- ลด

- หมายถึง

- โดดเด่น

- ลบออก

- จำเป็นต้องใช้

- ความต้องการ

- ความต้องการ

- ทรัพยากร

- คำตอบ

- ความรับผิดชอบ

- ความรับผิดชอบ

- การตอบสนอง

- REST

- ผล

- บทบาท

- บทบาท

- วิ่ง

- วิ่ง

- ขาย

- เดียวกัน

- ประหยัด

- scalability

- ที่ปรับขนาดได้

- ขนาด

- ปรับ

- การสแกน

- ที่กำหนดไว้

- นักวิทยาศาสตร์

- ได้อย่างลงตัว

- ค้นหา

- ส่วน

- ระดับอาวุโส

- serverless

- บริการ

- บริการ

- Share

- ที่ใช้ร่วมกัน

- การส่งสินค้า

- แสดงให้เห็นว่า

- สำคัญ

- คล้ายคลึงกัน

- ง่าย

- ตั้งแต่

- เดียว

- ภาพย่อ

- So

- ซอฟต์แวร์

- วิศวกรซอฟต์แวร์

- ทางออก

- โซลูชัน

- แก้

- การแก้

- บางสิ่งบางอย่าง

- แหล่ง

- แหล่งที่มา

- ครอบคลุม

- สเปกตรัม

- การใช้จ่าย

- SQL

- Stability

- ผู้ถือเงินเดิมพัน

- ผู้มีส่วนได้เสีย

- มาตรฐาน

- เริ่มต้น

- ข้อความที่เริ่ม

- ที่เริ่มต้น

- เริ่มต้น

- Status

- ขั้นตอน

- ขั้นตอน

- การเก็บรักษา

- จัดเก็บ

- เก็บไว้

- ร้านค้า

- กลยุทธ์

- กลยุทธ์

- ที่ประสบความสำเร็จ

- อย่างเช่น

- จัดหาอุปกรณ์

- ห่วงโซ่อุปทาน

- ที่สนับสนุน

- รองรับ

- ระบบ

- ตาราง

- เอา

- ใช้เวลา

- ทีม

- เทคโนโลยี

- เทมเพลต

- การทดสอบ

- พื้นที่

- ที่มา

- ของพวกเขา

- ดังนั้น

- พัน

- ตลอด

- ตลอด

- เวลา

- ครั้ง

- การประทับเวลา

- เคล็ดลับ

- ไปยัง

- ด้านบน

- การทำธุรกรรม

- แปลง

- การเดินทาง

- เรียก

- ชนิด

- ปึกแผ่น

- การปรับปรุง

- us

- ใช้

- ผู้ใช้

- การตรวจสอบ

- ความคุ้มค่า

- ความคุ้มค่า

- ความหลากหลาย

- ต่างๆ

- ความเร็ว

- รุ่น

- ผ่านทาง

- รายละเอียด

- การละเมิด

- ระเหย

- ไดรฟ์

- อยาก

- คลังสินค้า

- วิธี

- อะไร

- ที่

- ในขณะที่

- กว้าง

- จะ

- เวิร์กโฟลว์

- ขั้นตอนการทำงาน

- โรงงาน

- จะ

- ปี

- ของคุณ

- ลมทะเล