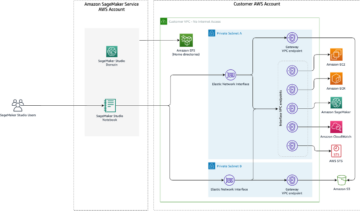

อเมซอน SageMaker มีโครงสร้างพื้นฐานการเรียนรู้ของเครื่อง (ML) และตัวเลือกการปรับใช้โมเดลที่หลากหลายเพื่อช่วยตอบสนองความต้องการในการอนุมาน ML ของคุณ เป็นบริการที่มีการจัดการเต็มรูปแบบและรวมเข้ากับเครื่องมือ MLOps เพื่อให้คุณสามารถทำงานเพื่อปรับขนาดการปรับใช้โมเดลของคุณ ลดต้นทุนการอนุมาน จัดการโมเดลอย่างมีประสิทธิภาพมากขึ้นในการผลิต และลดภาระในการดำเนินงาน SageMaker นำเสนอหลายรายการ ตัวเลือกการอนุมาน เพื่อให้คุณสามารถเลือกตัวเลือกที่เหมาะกับภาระงานของคุณมากที่สุด

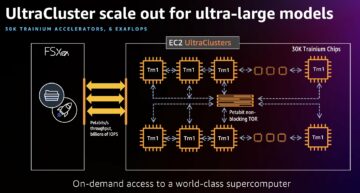

CPU เจเนอเรชันใหม่มีการปรับปรุงประสิทธิภาพอย่างมากในการอนุมาน ML เนื่องจากมีคำสั่งเฉพาะในตัว ในโพสต์นี้ เรามุ่งเน้นไปที่วิธีที่คุณสามารถใช้ประโยชน์จาก AWS Graviton3- ใช้ Amazon Elastic Compute Cloud (EC2) อินสแตนซ์ C7g เพื่อช่วยลดค่าใช้จ่ายในการอนุมานได้ถึง 50% เมื่อเทียบกับอินสแตนซ์ EC2 ที่เทียบเคียงได้ การอนุมานตามเวลาจริง บน Amazon SageMaker เราจะแสดงวิธีที่คุณสามารถประเมินประสิทธิภาพการอนุมานและเปลี่ยนปริมาณงาน ML ของคุณเป็นอินสแตนซ์ AWS Graviton ในไม่กี่ขั้นตอน

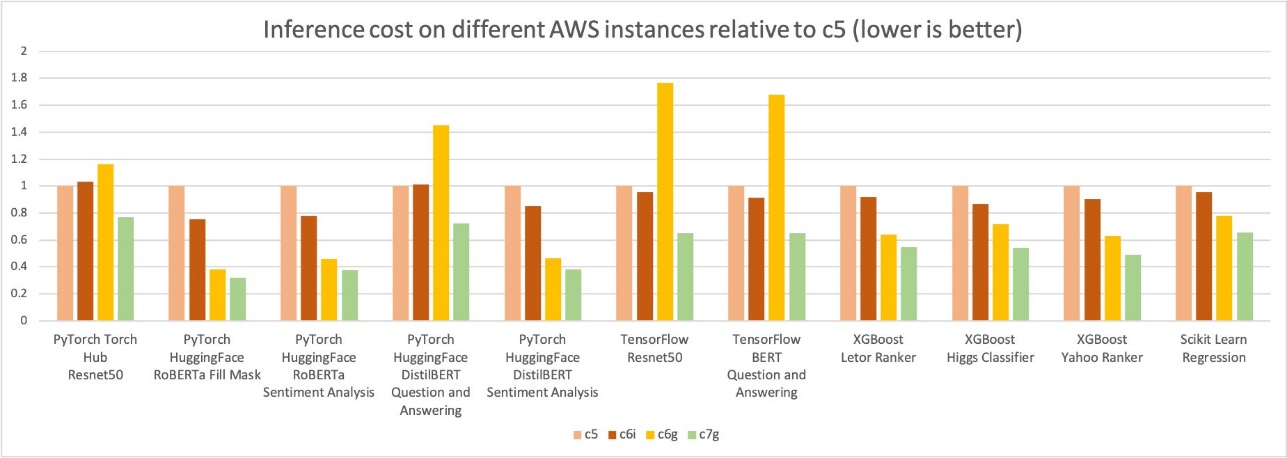

เพื่อให้ครอบคลุมแอปพลิเคชันของลูกค้าที่ได้รับความนิยมและหลากหลาย ในโพสต์นี้ เราจะพูดถึงประสิทธิภาพการอนุมานของ PyTorch, TensorFlow, XGBoost และเฟรมเวิร์ก scikit-learn เราครอบคลุมการมองเห็นด้วยคอมพิวเตอร์ (CV) การประมวลผลภาษาธรรมชาติ (NLP) การจัดประเภท และสถานการณ์จำลองการจัดอันดับสำหรับโมเดลและอินสแตนซ์ ml.c6g, ml.c7g, ml.c5 และ ml.c6i SageMaker สำหรับการเปรียบเทียบ

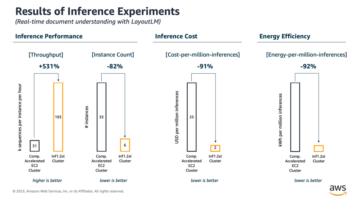

ผลการเปรียบเทียบ

AWS วัดการประหยัดต้นทุนได้สูงสุด 50% สำหรับ PyTorch, TensorFlow, XGBoost และการอนุมานแบบจำลอง scikit-learn ด้วยอินสแตนซ์ EC3 C2g ที่ใช้ AWS Graviton7 เทียบกับอินสแตนซ์ EC2 ที่เทียบเคียงได้บน Amazon SageMaker ในขณะเดียวกัน เวลาแฝงของการอนุมานก็ลดลงเช่นกัน

สำหรับการเปรียบเทียบ เราใช้อินสแตนซ์สี่ประเภทที่แตกต่างกัน:

ทั้งสี่อินสแตนซ์มี 16 vCPU และหน่วยความจำ 32 GiB

ในกราฟต่อไปนี้ เราวัดต้นทุนต่อล้านการอนุมานสำหรับอินสแตนซ์ทั้งสี่ประเภท เรายังทำให้ต้นทุนต่อผลลัพธ์การอนุมานล้านรายการเป็นมาตรฐานเพิ่มเติมสำหรับอินสแตนซ์ c5.4xlarge ซึ่งวัดเป็น 1 บนแกน Y ของแผนภูมิ คุณจะเห็นว่าสำหรับรุ่น XGBoost การอนุมานต้นทุนต่อล้านสำหรับ c7g.4xlarge (AWS Graviton3) อยู่ที่ประมาณ 50% ของ c5.4xlarge และ 40% ของ c6i.4xlarge สำหรับโมเดล PyTorch NLP ประหยัดค่าใช้จ่ายได้ประมาณ 30–50% เมื่อเทียบกับอินสแตนซ์ c5 และ c6i.4xlarge สำหรับโมเดลและเฟรมเวิร์กอื่นๆ เราวัดผลประหยัดต้นทุนได้อย่างน้อย 30% เมื่อเทียบกับอินสแตนซ์ c5 และ c6i.4xlarge

เช่นเดียวกับกราฟเปรียบเทียบต้นทุนการอนุมานก่อนหน้านี้ กราฟต่อไปนี้แสดงเวลาแฝงของโมเดล p90 สำหรับอินสแตนซ์สี่ประเภทเดียวกัน เราปรับผลลัพธ์ของเวลาแฝงให้เป็นมาตรฐานเพิ่มเติมสำหรับอินสแตนซ์ c5.4xlarge ซึ่งวัดเป็น 1 ในแกน Y ของแผนภูมิ เวลาแฝงการอนุมานของโมเดล c7g.4xlarge (AWS Graviton3) ดีกว่าค่าแฝงที่วัดบน c50xlarge และ c5.4i.6xlarge ถึง 4%

โยกย้ายไปยังอินสแตนซ์ AWS Graviton

หากต้องการปรับใช้โมเดลของคุณกับอินสแตนซ์ AWS Graviton คุณสามารถใช้ คอนเทนเนอร์การเรียนรู้เชิงลึกของ AWS (เนื้อหาดาวน์โหลด) หรือ นำภาชนะมาเอง ที่เข้ากันได้กับสถาปัตยกรรม ARMv8.2

การย้าย (หรือการปรับใช้ใหม่) ของโมเดลของคุณไปยังอินสแตนซ์ AWS Graviton นั้นตรงไปตรงมา เพราะ AWS ไม่เพียงแต่จัดหาคอนเทนเนอร์ให้กับโมเดลโฮสต์ด้วย PyTorch, TensorFlow, scikit-learn และ XGBoost เท่านั้น แต่โมเดลนั้นไม่เชื่อเรื่องพระเจ้าทางสถาปัตยกรรมเช่นกัน คุณยังสามารถนำไลบรารีของคุณเองมาได้ด้วย แต่ต้องแน่ใจว่าคอนเทนเนอร์ของคุณสร้างด้วยสภาพแวดล้อมที่สนับสนุนสถาปัตยกรรม ARMv8.2 สำหรับข้อมูลเพิ่มเติม โปรดดูที่ สร้างคอนเทนเนอร์อัลกอริทึมของคุณเอง.

คุณจะต้องดำเนินการสามขั้นตอนให้เสร็จสิ้นเพื่อปรับใช้โมเดลของคุณ:

- สร้างโมเดล SageMaker ซึ่งจะประกอบด้วยพารามิเตอร์อื่นๆ ข้อมูลเกี่ยวกับตำแหน่งไฟล์โมเดล คอนเทนเนอร์ที่จะใช้สำหรับการปรับใช้ และตำแหน่งของสคริปต์การอนุมาน (หากคุณมีโมเดลที่มีอยู่ซึ่งปรับใช้ในอินสแตนซ์การอนุมานที่ปรับให้เหมาะสมสำหรับการคำนวณแล้ว คุณสามารถข้ามขั้นตอนนี้ได้)

- สร้างการกำหนดค่าปลายทาง ซึ่งจะมีข้อมูลเกี่ยวกับประเภทของอินสแตนซ์ที่คุณต้องการสำหรับจุดสิ้นสุด (เช่น ml.c7g.xlarge สำหรับ AWS Graviton3) ชื่อของรุ่นที่คุณสร้างในขั้นตอนก่อนหน้า และจำนวนของอินสแตนซ์ต่อจุดสิ้นสุด

- เปิดใช้งานจุดสิ้นสุดด้วยการกำหนดค่าจุดสิ้นสุดที่สร้างขึ้นในขั้นตอนก่อนหน้า

สำหรับคำแนะนำโดยละเอียด โปรดดูที่ เรียกใช้ปริมาณงานการอนุมานของแมชชีนเลิร์นนิงบนอินสแตนซ์ที่ใช้ AWS Graviton ด้วย Amazon SageMaker

วิธีการเปรียบเทียบ

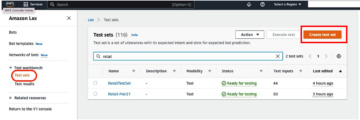

เราใช้ ผู้แนะนำการอนุมานของ Amazon SageMaker เพื่อทำให้การเปรียบเทียบประสิทธิภาพโดยอัตโนมัติในอินสแตนซ์ต่างๆ บริการนี้จะเปรียบเทียบประสิทธิภาพของโมเดล ML ของคุณในแง่ของเวลาแฝงและต้นทุนในอินสแตนซ์ต่างๆ และแนะนำอินสแตนซ์และการกำหนดค่าที่ให้ประสิทธิภาพดีที่สุดด้วยต้นทุนที่ต่ำที่สุด เราได้รวบรวมข้อมูลประสิทธิภาพดังกล่าวโดยใช้โปรแกรมแนะนำการอนุมาน สำหรับรายละเอียดเพิ่มเติม โปรดดูที่ repo GitHub.

คุณสามารถใช้ โน๊ตบุ๊คตัวอย่าง เพื่อเรียกใช้เกณฑ์มาตรฐานและทำซ้ำผลลัพธ์ เราใช้แบบจำลองต่อไปนี้สำหรับการเปรียบเทียบ:

สรุป

AWS วัดการประหยัดต้นทุนได้สูงสุด 50% สำหรับ PyTorch, TensorFlow, XGBoost และการอนุมานแบบจำลอง scikit-learn ด้วยอินสแตนซ์ EC3 C2g ที่ใช้ AWS Graviton7 เทียบกับอินสแตนซ์ EC2 ที่เทียบเคียงได้บน Amazon SageMaker คุณสามารถย้ายกรณีการใช้งานการอนุมานที่มีอยู่หรือปรับใช้โมเดล ML ใหม่บน AWS Graviton โดยทำตามขั้นตอนที่ให้ไว้ในโพสต์นี้ คุณยังสามารถอ้างถึง คู่มือทางเทคนิค AWS Gravitonซึ่งมีรายการของไลบรารีที่ปรับให้เหมาะสมและแนวทางปฏิบัติที่ดีที่สุดที่จะช่วยให้คุณได้รับประโยชน์ด้านต้นทุนด้วยอินสแตนซ์ AWS Graviton ในปริมาณงานต่างๆ

หากคุณพบกรณีการใช้งานที่ AWS Graviton ไม่พบการเพิ่มประสิทธิภาพที่คล้ายคลึงกัน โปรดติดต่อเรา เราจะเพิ่มการปรับปรุงประสิทธิภาพอย่างต่อเนื่องเพื่อให้ AWS Graviton เป็นโปรเซสเซอร์เอนกประสงค์ที่คุ้มค่าและมีประสิทธิภาพมากที่สุดสำหรับการอนุมาน ML

เกี่ยวกับผู้แต่ง

สุนิตา นาดัมปาลี เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ที่ AWS เธอเป็นหัวหน้าฝ่ายปรับปรุงประสิทธิภาพของซอฟต์แวร์ Graviton สำหรับแมชชีนเลิร์นนิง, HPC และเวิร์กโหลดมัลติมีเดีย เธอหลงใหลเกี่ยวกับการพัฒนาโอเพ่นซอร์สและนำเสนอโซลูชันซอฟต์แวร์ที่คุ้มค่ากับ Arm SoC

สุนิตา นาดัมปาลี เป็นผู้จัดการฝ่ายพัฒนาซอฟต์แวร์ที่ AWS เธอเป็นหัวหน้าฝ่ายปรับปรุงประสิทธิภาพของซอฟต์แวร์ Graviton สำหรับแมชชีนเลิร์นนิง, HPC และเวิร์กโหลดมัลติมีเดีย เธอหลงใหลเกี่ยวกับการพัฒนาโอเพ่นซอร์สและนำเสนอโซลูชันซอฟต์แวร์ที่คุ้มค่ากับ Arm SoC

เจมิน เดไซ เป็นวิศวกรพัฒนาซอฟต์แวร์กับทีม Amazon SageMaker Inference เขามีความกระตือรือร้นในการนำ AI ไปใช้ในวงกว้างและปรับปรุงความสามารถในการใช้งานของสินทรัพย์ AI ที่ล้ำสมัยด้วยการสร้างผลิตภัณฑ์ให้เป็นคุณสมบัติและบริการต่างๆ ในเวลาว่าง เขาชอบฟังเพลงและท่องเที่ยว

เจมิน เดไซ เป็นวิศวกรพัฒนาซอฟต์แวร์กับทีม Amazon SageMaker Inference เขามีความกระตือรือร้นในการนำ AI ไปใช้ในวงกว้างและปรับปรุงความสามารถในการใช้งานของสินทรัพย์ AI ที่ล้ำสมัยด้วยการสร้างผลิตภัณฑ์ให้เป็นคุณสมบัติและบริการต่างๆ ในเวลาว่าง เขาชอบฟังเพลงและท่องเที่ยว

ไมค์ ชไนเดอร์ เป็นนักพัฒนาระบบที่อยู่ใน Phoenix AZ เขาเป็นสมาชิกของคอนเทนเนอร์ Deep Learning ซึ่งสนับสนุนอิมเมจคอนเทนเนอร์ Framework ต่างๆ รวมถึง Graviton Inference เขาทุ่มเทให้กับประสิทธิภาพและเสถียรภาพของโครงสร้างพื้นฐาน

ไมค์ ชไนเดอร์ เป็นนักพัฒนาระบบที่อยู่ใน Phoenix AZ เขาเป็นสมาชิกของคอนเทนเนอร์ Deep Learning ซึ่งสนับสนุนอิมเมจคอนเทนเนอร์ Framework ต่างๆ รวมถึง Graviton Inference เขาทุ่มเทให้กับประสิทธิภาพและเสถียรภาพของโครงสร้างพื้นฐาน

โมฮัน คานธี เป็นวิศวกรซอฟต์แวร์อาวุโสที่ AWS เขาทำงานกับ AWS ในช่วง 10 ปีที่ผ่านมา และเคยทำงานในบริการต่างๆ ของ AWS เช่น EMR, EFA และ RDS ปัจจุบัน เขามุ่งเน้นไปที่การปรับปรุงประสบการณ์การอนุมานของ SageMaker ในเวลาว่าง เขาชอบเดินป่าและวิ่งมาราธอน

โมฮัน คานธี เป็นวิศวกรซอฟต์แวร์อาวุโสที่ AWS เขาทำงานกับ AWS ในช่วง 10 ปีที่ผ่านมา และเคยทำงานในบริการต่างๆ ของ AWS เช่น EMR, EFA และ RDS ปัจจุบัน เขามุ่งเน้นไปที่การปรับปรุงประสบการณ์การอนุมานของ SageMaker ในเวลาว่าง เขาชอบเดินป่าและวิ่งมาราธอน

ชิงเหว่ย ลี่ เป็นผู้เชี่ยวชาญด้าน Machine Learning ที่ Amazon Web Services เขาได้รับปริญญาเอกของเขา ใน Operations Research หลังจากที่เขาทำลายบัญชีทุนวิจัยของที่ปรึกษาและล้มเหลวในการมอบรางวัลโนเบลที่เขาสัญญาไว้ ปัจจุบันเขาช่วยลูกค้าในอุตสาหกรรมบริการทางการเงินและประกันภัยสร้างโซลูชันแมชชีนเลิร์นนิงบน AWS เวลาว่างชอบอ่านหนังสือและสอน

ชิงเหว่ย ลี่ เป็นผู้เชี่ยวชาญด้าน Machine Learning ที่ Amazon Web Services เขาได้รับปริญญาเอกของเขา ใน Operations Research หลังจากที่เขาทำลายบัญชีทุนวิจัยของที่ปรึกษาและล้มเหลวในการมอบรางวัลโนเบลที่เขาสัญญาไว้ ปัจจุบันเขาช่วยลูกค้าในอุตสาหกรรมบริการทางการเงินและประกันภัยสร้างโซลูชันแมชชีนเลิร์นนิงบน AWS เวลาว่างชอบอ่านหนังสือและสอน

เวย์น ทู เป็นผู้เชี่ยวชาญด้านโซลูชันโซลูชันสำหรับ Graviton ที่ AWS เขามุ่งเน้นที่การช่วยให้ลูกค้าปรับใช้สถาปัตยกรรม ARM สำหรับปริมาณงานคอนเทนเนอร์ขนาดใหญ่ ก่อนเข้าร่วม AWS Wayne เคยทำงานให้กับผู้จำหน่ายซอฟต์แวร์รายใหญ่หลายราย รวมถึง IBM และ Red Hat

เวย์น ทู เป็นผู้เชี่ยวชาญด้านโซลูชันโซลูชันสำหรับ Graviton ที่ AWS เขามุ่งเน้นที่การช่วยให้ลูกค้าปรับใช้สถาปัตยกรรม ARM สำหรับปริมาณงานคอนเทนเนอร์ขนาดใหญ่ ก่อนเข้าร่วม AWS Wayne เคยทำงานให้กับผู้จำหน่ายซอฟต์แวร์รายใหญ่หลายราย รวมถึง IBM และ Red Hat

ลอเรน มัลเลนเน็กซ์ เป็นสถาปนิกโซลูชันที่ตั้งอยู่ในเมืองเดนเวอร์ รัฐโคโลราโด เธอทำงานร่วมกับลูกค้าเพื่อช่วยพวกเขาออกแบบโซลูชันบน AWS ในเวลาว่าง เธอชอบเดินป่าและทำอาหารฮาวาย

ลอเรน มัลเลนเน็กซ์ เป็นสถาปนิกโซลูชันที่ตั้งอยู่ในเมืองเดนเวอร์ รัฐโคโลราโด เธอทำงานร่วมกับลูกค้าเพื่อช่วยพวกเขาออกแบบโซลูชันบน AWS ในเวลาว่าง เธอชอบเดินป่าและทำอาหารฮาวาย

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตไอสตรีม. ข้อมูลอัจฉริยะ Web3 ขยายความรู้ เข้าถึงได้ที่นี่.

- การสร้างอนาคตโดย Adryenn Ashley เข้าถึงได้ที่นี่.

- ซื้อและขายหุ้นในบริษัท PRE-IPO ด้วย PREIPO® เข้าถึงได้ที่นี่.

- ที่มา: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :มี

- :เป็น

- :ไม่

- :ที่ไหน

- $ ขึ้น

- 1

- 10

- 100

- 98

- a

- เกี่ยวกับเรา

- ลงชื่อเข้าใช้

- บรรลุ

- ข้าม

- เพิ่ม

- นำมาใช้

- ความได้เปรียบ

- หลังจาก

- AI

- ขั้นตอนวิธี

- แล้ว

- ด้วย

- อเมซอน

- อเมซอน SageMaker

- Amazon Web Services

- ในหมู่

- an

- และ

- การใช้งาน

- สถาปัตยกรรม

- เป็น

- ARM

- AS

- สินทรัพย์

- At

- โดยอัตโนมัติ

- AWS

- ตาม

- BE

- เพราะ

- รับ

- มาตรฐาน

- ประโยชน์ที่ได้รับ

- ที่ดีที่สุด

- ปฏิบัติที่ดีที่สุด

- ดีกว่า

- นำมาซึ่ง

- กว้าง

- Broke

- สร้าง

- สร้าง

- built-in

- ภาระ

- แต่

- by

- CAN

- กรณี

- แผนภูมิ

- การจัดหมวดหมู่

- เมฆ

- CO

- เทียบเคียง

- เมื่อเทียบกับ

- การเปรียบเทียบ

- เข้ากันได้

- สมบูรณ์

- คำนวณ

- คอมพิวเตอร์

- วิสัยทัศน์คอมพิวเตอร์

- องค์ประกอบ

- ภาชนะ

- ภาชนะบรรจุ

- ต่อ

- การปรุงอาหาร

- ราคา

- ประหยัดค่าใช้จ่าย

- ค่าใช้จ่ายที่มีประสิทธิภาพ

- ค่าใช้จ่าย

- หน้าปก

- ที่สร้างขึ้น

- ขณะนี้

- ลูกค้า

- ลูกค้า

- ข้อมูล

- ทุ่มเท

- ลึก

- การเรียนรู้ลึก ๆ

- ส่งมอบ

- การส่งมอบ

- เดนเวอร์

- ปรับใช้

- นำไปใช้

- การใช้งาน

- รายละเอียด

- รายละเอียด

- ผู้พัฒนา

- พัฒนาการ

- ต่าง

- สนทนา

- ทำ

- สอง

- มีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ที่มีประสิทธิภาพ

- ทั้ง

- ปลายทาง

- วิศวกร

- สิ่งแวดล้อม

- อีเธอร์ (ETH)

- ประเมินค่า

- ตัวอย่าง

- ที่มีอยู่

- ประสบการณ์

- สำรวจ

- ล้มเหลว

- คุณสมบัติ

- สองสาม

- เนื้อไม่มีมัน

- ทางการเงิน

- บริการทางการเงิน

- หา

- โฟกัส

- มุ่งเน้น

- มุ่งเน้นไปที่

- ดังต่อไปนี้

- สำหรับ

- สี่

- กรอบ

- กรอบ

- ฟรี

- ต่อไป

- กําไร

- จุดประสงค์ทั่วไป

- ชั่วอายุคน

- จะช่วยให้

- ให้

- กราฟ

- หมวก

- มี

- he

- ช่วย

- การช่วยเหลือ

- จะช่วยให้

- เธอ

- การธุดงค์

- ของเขา

- เจ้าภาพ

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- HPC

- HTML

- HTTPS

- ไอบีเอ็ม

- if

- ภาพ

- การปรับปรุง

- การปรับปรุง

- การปรับปรุง

- in

- ประกอบด้วย

- รวมทั้ง

- อุตสาหกรรม

- ข้อมูล

- โครงสร้างพื้นฐาน

- ตัวอย่าง

- คำแนะนำการใช้

- ประกัน

- อุตสาหกรรมประกันภัย

- รวม

- เข้าไป

- การร่วม

- jpg

- เพียงแค่

- ภาษา

- ใหญ่

- ชื่อสกุล

- ความแอบแฝง

- นำไปสู่

- การเรียนรู้

- น้อยที่สุด

- ห้องสมุด

- กดไลก์

- รายการ

- ที่ตั้ง

- ต่ำที่สุด

- เครื่อง

- เรียนรู้เครื่อง

- ทำ

- จัดการ

- ผู้จัดการ

- ฝูง

- พบ

- สมาชิก

- หน่วยความจำ

- อพยพ

- การโยกย้าย

- ล้าน

- ML

- ม.ป.ป

- แบบ

- โมเดล

- ข้อมูลเพิ่มเติม

- มากที่สุด

- มัลติมีเดีย

- หลาย

- ดนตรี

- ชื่อ

- โดยธรรมชาติ

- ภาษาธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- จำเป็นต้อง

- ความต้องการ

- ใหม่

- NLP

- รางวัลโนเบล

- จำนวน

- of

- เสนอ

- on

- เพียง

- โอเพนซอร์ส

- การดำเนินงาน

- การดำเนินการ

- การปรับให้เหมาะสม

- ตัวเลือกเสริม (Option)

- Options

- or

- ใบสั่ง

- อื่นๆ

- ออก

- ของตนเอง

- พารามิเตอร์

- หลงใหล

- การปฏิบัติ

- ต้นอินทผลัม

- เลือก

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- กรุณา

- ยอดนิยม

- โพสต์

- การปฏิบัติ

- ก่อน

- ก่อน

- รางวัล

- การประมวลผล

- หน่วยประมวลผล

- การผลิต

- สัญญา

- ให้

- ให้

- ให้

- ไฟฉาย

- พิสัย

- อันดับ

- มาถึง

- การอ่าน

- ที่ได้รับ

- แนะนำ

- สีแดง

- หมวกสีแดง

- ลด

- ลดลง

- การวิจัย

- ผลสอบ

- วิ่ง

- sagemaker

- การอนุมาน SageMaker

- เดียวกัน

- เงินออม

- ขนาด

- สถานการณ์

- scikit เรียนรู้

- เห็น

- การเลือก

- ระดับอาวุโส

- บริการ

- บริการ

- หลาย

- เธอ

- โชว์

- แสดงให้เห็นว่า

- สำคัญ

- คล้ายคลึงกัน

- So

- ซอฟต์แวร์

- การพัฒนาซอฟต์แวร์

- วิศวกรซอฟต์แวร์

- โซลูชัน

- ผู้เชี่ยวชาญ

- เฉพาะ

- Stability

- รัฐของศิลปะ

- ขั้นตอน

- ขั้นตอน

- ซื่อตรง

- เหมาะสมกับ

- ที่สนับสนุน

- รองรับ

- แน่ใจ

- สวิตซ์

- ระบบ

- เอา

- การ

- การเรียนการสอน

- ทีม

- วิชาการ

- tensorflow

- เงื่อนไขการใช้บริการ

- กว่า

- ที่

- พื้นที่

- ข้อมูล

- พวกเขา

- นี้

- สาม

- เวลา

- ไปยัง

- เครื่องมือ

- การเดินทาง

- ชนิด

- ชนิด

- us

- การใช้งาน

- ใช้

- มือสอง

- การใช้

- ต่างๆ

- ผู้ขาย

- วิสัยทัศน์

- ต้องการ

- we

- เว็บ

- บริการเว็บ

- ดี

- ที่

- จะ

- กับ

- งาน

- ทำงาน

- โรงงาน

- XGBoost

- ปี

- เธอ

- ของคุณ

- ลมทะเล