แมชชีนเลิร์นนิงเป็นสาขาใหญ่ที่มีงานวิจัยใหม่ๆ ออกมาบ่อยๆ เป็นสนามที่ร้อนแรงซึ่งนักวิชาการและภาคอุตสาหกรรมต่างทดลองสิ่งใหม่ ๆ เพื่อพัฒนาชีวิตประจำวันของเรา

ในช่วงไม่กี่ปีที่ผ่านมา AI กำเนิดได้เปลี่ยนโลกเนื่องจากการประยุกต์ใช้การเรียนรู้ของเครื่อง ตัวอย่างเช่น ChatGPT และ Stable Diffusion แม้ว่าปี 2023 จะถูกครอบงำโดย AI เชิงกำเนิด แต่เราควรตระหนักถึงความก้าวหน้าด้านการเรียนรู้ของเครื่องอีกมากมาย

นี่คือเอกสารการเรียนรู้ของเครื่องอันดับต้น ๆ ที่น่าอ่านในปี 2023 ดังนั้นคุณจะไม่พลาดเทรนด์ที่กำลังจะมาถึง

1) การเรียนรู้ความงามในเพลง: Neural Singing Voice Beautifier

Singing Voice Beautifying (SVB) เป็นงานใหม่ใน AI กำเนิดที่มีจุดมุ่งหมายเพื่อปรับปรุงเสียงร้องของมือสมัครเล่นให้เป็นเสียงที่ไพเราะ ตรงกับจุดมุ่งหมายของการวิจัย หลิวและคณะ (2022) เมื่อพวกเขาเสนอแบบจำลองกำเนิดใหม่ที่เรียกว่า Neural Singing Voice Beautifier (NSVB)

NSVB เป็นรูปแบบการเรียนรู้แบบกึ่งควบคุมโดยใช้อัลกอริทึมการแมปแฝงซึ่งทำหน้าที่เป็นตัวแก้ไขระดับเสียงและปรับปรุงโทนเสียง งานนี้สัญญาว่าจะปรับปรุงอุตสาหกรรมดนตรีและควรค่าแก่การตรวจสอบ

2) การค้นพบสัญลักษณ์ของอัลกอริทึมการปรับให้เหมาะสม

โมเดลโครงข่ายประสาทเทียมระดับลึกมีขนาดใหญ่ขึ้นกว่าที่เคย และมีการวิจัยมากมายเพื่อทำให้กระบวนการฝึกอบรมง่ายขึ้น การวิจัยล่าสุดโดยทีมงาน Google (เฉินและคณะ (2023)) ได้เสนอการเพิ่มประสิทธิภาพใหม่สำหรับ Neural Network ที่เรียกว่า Lion (EvoLved Sign Momentum) วิธีนี้แสดงให้เห็นว่าอัลกอริทึมมีประสิทธิภาพด้านหน่วยความจำมากกว่าและต้องการอัตราการเรียนรู้ที่น้อยกว่าอดัม เป็นงานวิจัยที่ยอดเยี่ยมที่แสดงให้เห็นสัญญามากมายที่คุณไม่ควรพลาด

3) TimesNet: การสร้างแบบจำลองการเปลี่ยนแปลงชั่วคราว 2 มิติสำหรับการวิเคราะห์อนุกรมเวลาทั่วไป

การวิเคราะห์อนุกรมเวลาเป็นกรณีการใช้งานทั่วไปในหลายธุรกิจ ตัวอย่างเช่น การคาดการณ์ราคา การตรวจจับความผิดปกติ เป็นต้น อย่างไรก็ตาม มีความท้าทายมากมายในการวิเคราะห์ข้อมูลชั่วคราวโดยอิงตามข้อมูลปัจจุบันเท่านั้น (ข้อมูล 1 มิติ) นั่นคือเหตุผล วูและคณะ (2023) เสนอวิธีการใหม่ที่เรียกว่า TimesNet เพื่อแปลงข้อมูล 1 มิติเป็นข้อมูล 2 มิติ ซึ่งได้ประสิทธิภาพที่ยอดเยี่ยมในการทดลอง คุณควรอ่านรายงานเพื่อทำความเข้าใจวิธีการใหม่นี้ให้ดียิ่งขึ้น เนื่องจากจะช่วยในการวิเคราะห์อนุกรมเวลาในอนาคตได้มาก

4) OPT: เปิดโมเดลภาษา Transformer ที่ฝึกไว้ล่วงหน้า

ปัจจุบัน เราอยู่ในยุคกำเนิด AI ที่บริษัทต่างๆ พัฒนาโมเดลภาษาขนาดใหญ่จำนวนมาก การวิจัยประเภทนี้ส่วนใหญ่จะไม่เผยแพร่แบบจำลองหรือมีจำหน่ายในเชิงพาณิชย์เท่านั้น อย่างไรก็ตาม กลุ่มวิจัย Meta AI (จางและคณะ (2022)) พยายามทำสิ่งที่ตรงกันข้ามด้วยการเปิดตัวโมเดล Open Pre-trained Transformers (OPT) ต่อสาธารณะ ซึ่งอาจเทียบได้กับ GPT-3 บทความนี้เป็นจุดเริ่มต้นที่ดีในการทำความเข้าใจโมเดล OPT และรายละเอียดการวิจัย เนื่องจากกลุ่มจะบันทึกรายละเอียดทั้งหมดในเอกสาร

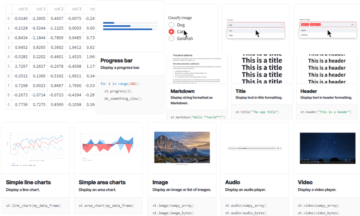

5) REaLTabFormer: การสร้างข้อมูลเชิงสัมพันธ์และตารางที่สมจริงโดยใช้ Transformers

โมเดลการกำเนิดไม่จำกัดเพียงการสร้างข้อความหรือรูปภาพเท่านั้น แต่ยังรวมถึงข้อมูลแบบตารางด้วย ข้อมูลที่สร้างขึ้นนี้มักเรียกว่าข้อมูลสังเคราะห์ โมเดลจำนวนมากได้รับการพัฒนาเพื่อสร้างข้อมูลแบบตารางสังเคราะห์ แต่แทบไม่มีโมเดลใดที่จะสร้างข้อมูลสังเคราะห์แบบตารางเชิงสัมพันธ์ นี่คือจุดมุ่งหมายของ Solatorio และ Dupriez (2023) วิจัย; สร้างโมเดลชื่อ REaLTabFormer สำหรับข้อมูลเชิงสัมพันธ์สังเคราะห์ การทดลองแสดงให้เห็นว่าผลลัพธ์ที่ได้นั้นแม่นยำใกล้เคียงกับแบบจำลองสังเคราะห์ที่มีอยู่ ซึ่งสามารถขยายไปสู่การใช้งานที่หลากหลาย

6) การเรียนรู้แบบเสริมกำลัง (ไม่ใช่) สำหรับการประมวลผลภาษาธรรมชาติหรือไม่: เกณฑ์มาตรฐาน พื้นฐาน และหน่วยการสร้างสำหรับการเพิ่มประสิทธิภาพนโยบายภาษาธรรมชาติ

แนวคิดการเรียนรู้แบบเสริมแรงเป็นทางเลือกที่ยอดเยี่ยมสำหรับงานการประมวลผลภาษาธรรมชาติ แต่จริงหรือไม่ นี่เป็นคำถามที่ว่า รามมูรธีและคณะ (2022) พยายามตอบ ผู้วิจัยแนะนำห้องสมุดและอัลกอริทึมต่างๆ ที่แสดงให้เห็นว่าเทคนิคการเรียนรู้แบบเสริมแรงมีความได้เปรียบอย่างไรเมื่อเทียบกับวิธีการดูแลในงาน NLP เป็นบทความที่แนะนำให้อ่านหากคุณต้องการทางเลือกสำหรับชุดทักษะของคุณ

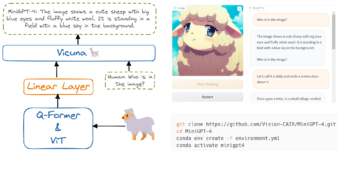

7) Tune-A-Video: การปรับแต่งโมเดลการกระจายภาพแบบช็อตเดียวสำหรับการสร้างข้อความเป็นวิดีโอ

การสร้างข้อความเป็นรูปภาพมีขนาดใหญ่ในปี 2022 และในปี 2023 จะมีการฉายภาพด้วยความสามารถแปลงข้อความเป็นวิดีโอ (T2V) งานวิจัยโดย วูและคณะ (2022) แสดงให้เห็นว่าสามารถขยาย T2V ได้อย่างไรในหลายวิธี การวิจัยเสนอวิธี Tune-a-Video แบบใหม่ที่รองรับงาน T2V เช่น การเปลี่ยนหัวเรื่องและวัตถุ การถ่ายโอนสไตล์ การแก้ไขแอตทริบิวต์ ฯลฯ เป็นบทความที่ดีในการอ่านหากคุณสนใจการวิจัยข้อความเป็นวิดีโอ

8) PyGlove: แลกเปลี่ยนไอเดีย ML อย่างมีประสิทธิภาพในรูปแบบโค้ด

การทำงานร่วมกันอย่างมีประสิทธิภาพเป็นกุญแจสู่ความสำเร็จของทุกทีม โดยเฉพาะอย่างยิ่งกับความซับซ้อนที่เพิ่มขึ้นภายในสาขาแมชชีนเลิร์นนิง เพื่อบำรุงประสิทธิภาพ เป็งและคณะ (2023) นำเสนอห้องสมุด PyGlove เพื่อแบ่งปันแนวคิด ML ได้อย่างง่ายดาย แนวคิดของ PyGlove คือการจับภาพกระบวนการวิจัย ML ผ่านรายการกฎการแพตช์ รายการนี้สามารถนำมาใช้ซ้ำได้ในฉากการทดลองใดๆ ซึ่งช่วยปรับปรุงประสิทธิภาพของทีม เป็นการวิจัยที่พยายามแก้ปัญหาการเรียนรู้ของเครื่องที่หลายคนยังไม่ได้ทำ ดังนั้นมันจึงคุ้มค่าที่จะอ่าน

8) ChatGPT มีความใกล้ชิดกับมนุษย์มากแค่ไหน? คลังข้อมูลการเปรียบเทียบ การประเมิน และการตรวจจับ

ChatGPT ได้เปลี่ยนโลกไปมาก พูดได้อย่างปลอดภัยว่าแนวโน้มจะสูงขึ้นต่อจากนี้ เนื่องจากประชาชนทั่วไปนิยมใช้งาน ChatGPT อยู่แล้ว อย่างไรก็ตาม ผลลัพธ์ปัจจุบันของ ChatGPT เป็นอย่างไรเมื่อเทียบกับ Human Experts เป็นคำถามที่ว่า กัวและคณะ (2023) พยายามตอบ ทีมพยายามรวบรวมข้อมูลจากผู้เชี่ยวชาญและผลลัพธ์ของ ChatGPT ซึ่งนำมาเปรียบเทียบกัน ผลลัพธ์แสดงให้เห็นว่ามีความแตกต่างโดยนัยระหว่าง ChatGPT และผู้เชี่ยวชาญ การวิจัยเป็นสิ่งที่ฉันรู้สึกว่าจะถูกถามต่อไปในอนาคต เนื่องจากโมเดล AI เชิงกำเนิดจะเติบโตขึ้นเรื่อยๆ เมื่อเวลาผ่านไป ดังนั้นมันจึงคุ้มค่าที่จะอ่าน

ปี 2023 เป็นปีที่ยอดเยี่ยมสำหรับการวิจัยด้านแมชชีนเลิร์นนิงที่แสดงโดยเทรนด์ปัจจุบัน โดยเฉพาะ AI เชิงกำเนิด เช่น ChatGPT และ Stable Diffusion มีงานวิจัยที่น่าสนใจมากมายที่ฉันรู้สึกว่าเราไม่ควรพลาด เพราะมันแสดงผลที่น่ายินดีซึ่งอาจเปลี่ยนแปลงมาตรฐานปัจจุบันได้ ในบทความนี้ ฉันได้แสดงเอกสาร ML ยอดนิยม 9 ฉบับให้คุณอ่าน ตั้งแต่แบบจำลองการกำเนิด แบบจำลองอนุกรมเวลา ไปจนถึงประสิทธิภาพของเวิร์กโฟลว์ ฉันหวังว่ามันจะช่วยได้

คอร์เนลเลียส ยุธา วิชายา เป็นผู้ช่วยผู้จัดการด้านวิทยาศาสตร์ข้อมูลและผู้เขียนข้อมูล ในขณะที่ทำงานเต็มเวลาที่ Allianz Indonesia เขาชอบแบ่งปันเคล็ดลับ Python และ Data ผ่านโซเชียลมีเดียและสื่อการเขียน

- เนื้อหาที่ขับเคลื่อนด้วย SEO และการเผยแพร่ประชาสัมพันธ์ รับการขยายวันนี้

- เพลโตบล็อคเชน Web3 Metaverse ข่าวกรอง ขยายความรู้. เข้าถึงได้ที่นี่.

- ที่มา: https://www.kdnuggets.com/2023/03/top-machine-learning-papers-read-2023.html?utm_source=rss&utm_medium=rss&utm_campaign=top-machine-learning-papers-to-read-in-2023

- :เป็น

- 2022

- 2023

- 2D

- 9

- a

- สถาบันการศึกษา

- แม่นยำ

- ประสบความสำเร็จ

- การกระทำ

- อาดัม

- AI

- วิจัยไอ

- จุดมุ่งหมาย

- AL

- ขั้นตอนวิธี

- ทั้งหมด

- อลิอันซ์

- แล้ว

- ทางเลือก

- มือสมัครเล่น

- การวิเคราะห์

- วิเคราะห์

- และ

- การตรวจจับความผิดปกติ

- คำตอบ

- การใช้งาน

- การใช้งาน

- วิธีการ

- เป็น

- บทความ

- AS

- ผู้ช่วย

- At

- ใช้ได้

- ตาม

- BE

- สวยงาม

- ร้านเสริมสวยเกาหลี

- เพราะ

- กลายเป็น

- มาตรฐาน

- ดีกว่า

- ระหว่าง

- ใหญ่

- ที่ใหญ่กว่า

- Blocks

- นวัตกรรม

- การก่อสร้าง

- ธุรกิจ

- by

- ที่เรียกว่า

- CAN

- จับ

- กรณี

- ความท้าทาย

- เปลี่ยนแปลง

- เปลี่ยนแปลง

- ChatGPT

- การตรวจสอบ

- ทางเลือก

- ปิดหน้านี้

- การทำงานร่วมกัน

- รวบรวม

- มา

- ในเชิงพาณิชย์

- ร่วมกัน

- บริษัท

- เทียบเคียง

- เมื่อเทียบกับ

- การเปรียบเทียบ

- ความซับซ้อน

- แนวคิด

- แนวคิด

- ดำเนินการ

- ได้

- การสร้าง

- ปัจจุบัน

- ประจำวัน

- ข้อมูล

- วิทยาศาสตร์ข้อมูล

- รายละเอียด

- การตรวจพบ

- พัฒนา

- ความแตกต่าง

- การจัดจำหน่าย

- การค้นพบ

- อย่างง่ายดาย

- ขอบ

- อย่างมีประสิทธิภาพ

- อย่างมีประสิทธิภาพ

- ยุค

- โดยเฉพาะอย่างยิ่ง

- ฯลฯ

- การประเมินผล

- แม้

- เคย

- วิวัฒน์

- เผง

- ตัวอย่าง

- ยอดเยี่ยม

- การแลกเปลี่ยน

- ที่มีอยู่

- การทดลอง

- ผู้เชี่ยวชาญ

- โปรดปราน

- สนาม

- สาขา

- สำหรับ

- มัก

- ราคาเริ่มต้นที่

- อนาคต

- General

- สร้าง

- สร้าง

- การสร้าง

- รุ่น

- กำเนิด

- กำเนิด AI

- แบบจำลองการกำเนิด

- Go

- ยิ่งใหญ่

- บัญชีกลุ่ม

- การเจริญเติบโต

- มี

- ช่วย

- จะช่วยให้

- โปรดคลิกที่นี่เพื่ออ่านรายละเอียดเพิ่มเติม

- ความหวัง

- ร้อน

- สรุป ความน่าเชื่อถือของ Olymp Trade?

- อย่างไรก็ตาม

- HTTPS

- เป็นมนุษย์

- i

- ความคิด

- ภาพ

- ปรับปรุง

- ช่วยเพิ่ม

- in

- ที่เพิ่มขึ้น

- อินโดนีเซีย

- อุตสาหกรรม

- สนใจ

- เปิดตัว

- IT

- jpg

- KD นักเก็ต

- เก็บ

- คีย์

- ชนิด

- ภาษา

- ใหญ่

- การเรียนรู้

- ห้องสมุด

- ถูก จำกัด

- สิงโต

- รายการ

- ชีวิต

- เครื่อง

- เรียนรู้เครื่อง

- ผู้จัดการ

- หลาย

- ภาพบรรยากาศ

- Meta

- วิธี

- อาจ

- ML

- แบบ

- การสร้างแบบจำลอง

- โมเดล

- โมเมนตัม

- ข้อมูลเพิ่มเติม

- ดนตรี

- โดยธรรมชาติ

- ภาษาธรรมชาติ

- ประมวลผลภาษาธรรมชาติ

- เครือข่าย

- ประสาท

- เครือข่ายประสาท

- ใหม่

- NLP

- นวนิยาย

- วัตถุ

- of

- on

- ONE

- เปิด

- ตรงข้าม

- การเพิ่มประสิทธิภาพ

- กระดาษ

- เอกสาร

- ปะ

- รูปแบบไฟล์ PDF

- การปฏิบัติ

- ภาพ

- ขว้าง

- เพลโต

- เพลโตดาต้าอินเทลลิเจนซ์

- เพลโตดาต้า

- นโยบาย

- นำเสนอ

- ราคา

- ปัญหา

- กระบวนการ

- การประมวลผล

- ที่คาดการณ์

- สัญญา

- แวว

- เสนอ

- เสนอ

- เสนอ

- สาธารณะ

- สาธารณชน

- หลาม

- คำถาม

- ตั้งแต่

- คะแนน

- อ่าน

- การอ่าน

- เหมือนจริง

- เมื่อเร็ว ๆ นี้

- แนะนำ

- การเรียนรู้การเสริมแรง

- ปล่อย

- ต้อง

- การวิจัย

- กลุ่มวิจัย

- นักวิจัย

- ผล

- ผลสอบ

- กฎระเบียบ

- s

- ปลอดภัย

- ฉาก

- วิทยาศาสตร์

- ชุด

- Share

- น่า

- แสดง

- แสดงให้เห็นว่า

- ลงชื่อ

- ลดความซับซ้อน

- ชุดทักษะ

- มีขนาดเล็กกว่า

- So

- สังคม

- โซเชียลมีเดีย

- แก้

- บางสิ่งบางอย่าง

- มั่นคง

- มาตรฐาน

- เริ่มต้น

- สไตล์

- หรือ

- ความสำเร็จ

- อย่างเช่น

- รองรับ

- สังเคราะห์

- ข้อมูลสังเคราะห์

- งาน

- งาน

- ทีม

- เทคนิค

- ที่

- พื้นที่

- ก้าวสู่อนาคต

- โลก

- ของพวกเขา

- ที่นั่น

- สิ่ง

- ตลอด

- เวลา

- อนุกรมเวลา

- เคล็ดลับ

- ไปยัง

- TONE

- ด้านบน

- การฝึกอบรม

- โอน

- แปลง

- หม้อแปลง

- เทรนด์

- แนวโน้ม

- จริง

- เข้าใจ

- ความเข้าใจ

- ที่กำลังมา

- ขึ้นไปข้างบน

- ใช้

- ใช้กรณี

- ต่างๆ

- ผ่านทาง

- เสียงพูด

- ที่

- ในขณะที่

- จะ

- กับ

- ภายใน

- งาน

- เวิร์กโฟลว์

- การทำงาน

- โลก

- คุ้มค่า

- จะ

- นักเขียน

- การเขียน

- ปี

- ปี

- ของคุณ

- ลมทะเล