یہ دو حصوں کی سیریز کی دوسری پوسٹ ہے جس میں میں تنظیموں کے لیے ایک عملی گائیڈ تجویز کرتا ہوں تاکہ آپ اپنے ڈومین کے لیے ٹیکسٹ سمریائزیشن ماڈلز کے معیار کا اندازہ لگا سکیں۔

متن کے خلاصے کے تعارف کے لیے، اس ٹیوٹوریل کا ایک جائزہ، اور ہمارے پروجیکٹ کے لیے ایک بیس لائن بنانے کے اقدامات (جسے سیکشن 1 بھی کہا جاتا ہے)، واپس دیکھیں پہلی پوسٹ.

اس پوسٹ کو تین حصوں میں تقسیم کیا گیا ہے:

- سیکشن 2: زیرو شاٹ ماڈل کے ساتھ خلاصے تیار کریں۔

- سیکشن 3: خلاصہ ماڈل کو تربیت دیں۔

- سیکشن 4: تربیت یافتہ ماڈل کا اندازہ لگائیں۔

سیکشن 2: زیرو شاٹ ماڈل کے ساتھ خلاصے تیار کریں۔

اس پوسٹ میں، ہم تصور کا استعمال کرتے ہیں صفر شاٹ سیکھنا (ZSL)، جس کا مطلب ہے کہ ہم ایک ایسا ماڈل استعمال کرتے ہیں جسے متن کا خلاصہ کرنے کے لیے تربیت دی گئی ہے لیکن اس کی کوئی مثال نہیں دیکھی ہے۔ arXiv ڈیٹاسیٹ. یہ ایک پورٹریٹ پینٹ کرنے کی کوشش کرنے کی طرح ہے جب آپ اپنی زندگی میں جو کچھ کرتے رہے ہیں وہ لینڈ اسکیپ پینٹنگ ہے۔ آپ پینٹ کرنا جانتے ہیں، لیکن ہو سکتا ہے آپ پورٹریٹ پینٹنگ کی پیچیدگیوں سے زیادہ واقف نہ ہوں۔

اس سیکشن کے لیے، ہم درج ذیل کا استعمال کرتے ہیں۔ نوٹ بک.

کیوں زیرو شاٹ لرننگ؟

ZSL پچھلے سالوں میں مقبول ہوا ہے کیونکہ یہ آپ کو بغیر تربیت کے جدید ترین NLP ماڈل استعمال کرنے کی اجازت دیتا ہے۔ اور ان کی کارکردگی بعض اوقات کافی حیران کن ہوتی ہے۔ بڑا سائنس ریسرچ ورک گروپ نے حال ہی میں اپنا T0pp (تلفظ "T Zero Plus Plus") ماڈل جاری کیا ہے، جسے زیرو شاٹ ملٹی ٹاسک لرننگ کی تحقیق کے لیے خاص طور پر تربیت دی گئی ہے۔ یہ اکثر چھ گنا بڑے ماڈلز کو پیچھے چھوڑ سکتا ہے۔ بڑا بنچ بینچ مارک، اور بہتر کارکردگی کا مظاہرہ کر سکتا ہے۔ GPT-3 (16 گنا بڑا) کئی دوسرے NLP بینچ مارکس پر۔

ZSL کا ایک اور فائدہ یہ ہے کہ اسے استعمال کرنے کے لیے کوڈ کی صرف دو لائنیں لگتی ہیں۔ اس کو آزما کر، ہم ایک دوسری بیس لائن بناتے ہیں، جسے ہم اپنے ڈیٹاسیٹ پر ماڈل کو ٹھیک کرنے کے بعد ماڈل کی کارکردگی میں حاصل ہونے والے فائدے کو درست کرنے کے لیے استعمال کرتے ہیں۔

زیرو شاٹ لرننگ پائپ لائن قائم کریں۔

ZSL ماڈل استعمال کرنے کے لیے، ہم Hugging Face's استعمال کر سکتے ہیں۔ پائپ لائن API. یہ API ہمیں کوڈ کی صرف دو لائنوں کے ساتھ متن کا خلاصہ ماڈل استعمال کرنے کے قابل بناتا ہے۔ یہ NLP ماڈل میں پروسیسنگ کے اہم مراحل کا خیال رکھتا ہے:

- متن کو اس فارمیٹ میں پہلے سے پروسیس کریں جو ماڈل سمجھ سکتا ہے۔

- پری پروسیس شدہ ان پٹس کو ماڈل میں منتقل کریں۔

- ماڈل کی پیشین گوئیوں کو پوسٹ پروسیس کریں، تاکہ آپ ان کو سمجھ سکیں۔

یہ خلاصہ ماڈلز کا استعمال کرتا ہے جو پہلے ہی پر دستیاب ہیں۔ گلے ملنے والا چہرہ ماڈل ہب.

اسے استعمال کرنے کے لیے درج ذیل کوڈ کو چلائیں:

یہی ہے! کوڈ خلاصہ ماڈل ڈاؤن لوڈ کرتا ہے اور آپ کی مشین پر مقامی طور پر خلاصے بناتا ہے۔ اگر آپ سوچ رہے ہیں کہ یہ کون سا ماڈل استعمال کرتا ہے، تو آپ اسے یا تو میں دیکھ سکتے ہیں۔ ماخذ کوڈ یا درج ذیل کمانڈ کا استعمال کریں:

جب ہم اس کمانڈ کو چلاتے ہیں، تو ہم دیکھتے ہیں کہ ٹیکسٹ سمریائزیشن کا ڈیفالٹ ماڈل کہا جاتا ہے۔ sshleifer/distilbart-cnn-12-6:

ہم تلاش کرسکتے ہیں ماڈل کارڈ اس ماڈل کے لیے ہگنگ فیس ویب سائٹ پر، جہاں ہم یہ بھی دیکھ سکتے ہیں کہ ماڈل کو دو ڈیٹا سیٹس پر تربیت دی گئی ہے: سی این این ڈیلی میل ڈیٹاسیٹ اور انتہائی خلاصہ (XSum) ڈیٹاسیٹ. یہ بات قابل غور ہے کہ یہ ماڈل arXiv ڈیٹاسیٹ سے واقف نہیں ہے اور اس کا استعمال صرف متن کا خلاصہ کرنے کے لیے کیا جاتا ہے جو اس سے ملتے جلتے ہیں جن پر اسے تربیت دی گئی ہے (زیادہ تر خبروں کے مضامین)۔ ماڈل کے نام میں نمبر 12 اور 6 بالترتیب انکوڈر لیئرز اور ڈیکوڈر لیئرز کی تعداد کا حوالہ دیتے ہیں۔ یہ بتانا کہ یہ کیا ہیں اس ٹیوٹوریل کے دائرہ سے باہر ہے، لیکن آپ پوسٹ میں اس کے بارے میں مزید پڑھ سکتے ہیں BART کا تعارف سیم شیفر کے ذریعہ، جس نے ماڈل بنایا۔

ہم آگے بڑھتے ہوئے پہلے سے طے شدہ ماڈل استعمال کرتے ہیں، لیکن میں آپ کو مختلف پہلے سے تربیت یافتہ ماڈلز آزمانے کی ترغیب دیتا ہوں۔ خلاصہ کے لیے موزوں تمام ماڈلز پر پایا جا سکتا ہے۔ ہگنگ فیس ویب سائٹ. ایک مختلف ماڈل استعمال کرنے کے لیے، آپ پائپ لائن API کو کال کرتے وقت ماڈل کا نام بتا سکتے ہیں:

ایکسٹریکٹیو بمقابلہ خلاصہ خلاصہ

ہم نے ابھی تک متن کے خلاصے کے لیے دو ممکنہ لیکن مختلف طریقوں کے بارے میں بات نہیں کی ہے۔ نچوڑنے والا بمقابلہ تجریدی. استخراجی خلاصہ ایک متن سے لیے گئے اقتباسات کو ایک خلاصہ میں جمع کرنے کی حکمت عملی ہے، جب کہ تجریدی خلاصہ میں ناول کے جملوں کا استعمال کرتے ہوئے کارپس کو پیرافراس کرنا شامل ہے۔ خلاصہ کے زیادہ تر ماڈل ان ماڈلز پر مبنی ہیں جو ناول کا متن تیار کرتے ہیں (وہ قدرتی زبان کی نسل کے ماڈل ہیں، جیسے، مثال کے طور پر، GPT-3)۔ اس کا مطلب یہ ہے کہ خلاصہ ماڈل بھی ناول کا متن تیار کرتے ہیں، جو انہیں تجریدی خلاصہ ماڈل بناتا ہے۔

زیرو شاٹ سمری تیار کریں۔

اب جب کہ ہم اسے استعمال کرنے کا طریقہ جانتے ہیں، ہم اسے اپنے ٹیسٹ ڈیٹاسیٹ پر استعمال کرنا چاہتے ہیں — وہی ڈیٹا سیٹ جس میں ہم استعمال کرتے تھے۔ سیکشن 1 بیس لائن بنانے کے لیے۔ ہم اسے درج ذیل لوپ کے ساتھ کر سکتے ہیں:

ہم استعمال کرتے ہیں min_length اور max_length ماڈل کے ذریعہ تیار کردہ سمری کو کنٹرول کرنے کے پیرامیٹرز۔ اس مثال میں، ہم نے قائم کیا min_length 5 تک کیونکہ ہم چاہتے ہیں کہ عنوان کم از کم پانچ الفاظ کا ہو۔ اور حوالہ جات کے خلاصے (تحقیقاتی مقالوں کے اصل عنوانات) کا تخمینہ لگا کر، ہم اس بات کا تعین کرتے ہیں کہ 20 کے لیے ایک معقول قدر ہو سکتی ہے۔ max_length. لیکن ایک بار پھر، یہ صرف ایک پہلی کوشش ہے. جب پروجیکٹ تجرباتی مرحلے میں ہوتا ہے، تو یہ دونوں پیرامیٹرز تبدیل کیے جا سکتے ہیں اور یہ دیکھنے کے لیے کہ آیا ماڈل کی کارکردگی میں تبدیلی آتی ہے۔

اضافی پیرامیٹرز

اگر آپ ٹیکسٹ جنریشن سے پہلے ہی واقف ہیں، تو آپ کو معلوم ہو سکتا ہے کہ ماڈل کی طرف سے تیار کردہ ٹیکسٹ کو متاثر کرنے کے لیے اور بھی بہت سے پیرامیٹرز ہیں، جیسے کہ بیم کی تلاش، نمونے لینے اور درجہ حرارت۔ یہ پیرامیٹرز آپ کو اس متن پر زیادہ کنٹرول دیتے ہیں جو تیار کیا جا رہا ہے، مثال کے طور پر متن کو زیادہ روانی اور کم دہرایا جاتا ہے۔ یہ تکنیکیں پائپ لائن API میں دستیاب نہیں ہیں — آپ اس میں دیکھ سکتے ہیں۔ ماخذ کوڈ کہ min_length اور max_length صرف پیرامیٹرز ہیں جن پر غور کیا جاتا ہے۔ ہمارے اپنے ماڈل کو تربیت دینے اور تعینات کرنے کے بعد، تاہم، ہمیں ان پیرامیٹرز تک رسائی حاصل ہوتی ہے۔ اس پر مزید اس پوسٹ کے سیکشن 4 میں۔

ماڈل کی تشخیص

زیرو شاٹ سمریز تیار کرنے کے بعد، ہم اپنے ROUGE فنکشن کو دوبارہ استعمال کر سکتے ہیں تاکہ امیدوار کے خلاصے کا حوالہ کے خلاصوں سے موازنہ کریں:

ZSL ماڈل کے ساتھ تیار کردہ خلاصوں پر اس حساب کو چلانے سے ہمیں درج ذیل نتائج ملتے ہیں:

جب ہم ان کا اپنی بیس لائن سے موازنہ کرتے ہیں، تو ہم دیکھتے ہیں کہ یہ ZSL ماڈل دراصل اس سے بھی بدتر کارکردگی کا مظاہرہ کر رہا ہے کہ صرف پہلا جملہ لینے کا ہمارا سادہ ہوورسٹک۔ ایک بار پھر، یہ غیر متوقع نہیں ہے: اگرچہ یہ ماڈل خبروں کے مضامین کا خلاصہ کرنا جانتا ہے، لیکن اس نے کسی تعلیمی تحقیقی مقالے کے خلاصے کا خلاصہ کرنے کی مثال کبھی نہیں دیکھی۔

بیس لائن موازنہ

ہم نے اب دو بنیادی خطوط تیار کیے ہیں: ایک سادہ ہیورسٹک کا استعمال کرتے ہوئے اور ایک ZSL ماڈل کے ساتھ۔ ROUGE اسکورز کا موازنہ کرتے ہوئے، ہم دیکھتے ہیں کہ سادہ ہوورسٹک فی الحال گہری سیکھنے کے ماڈل سے بہتر کارکردگی کا مظاہرہ کرتا ہے۔

اگلے حصے میں، ہم اسی ڈیپ لرننگ ماڈل کو لیتے ہیں اور اس کی کارکردگی کو بہتر بنانے کی کوشش کرتے ہیں۔ ہم اسے arXiv ڈیٹاسیٹ پر تربیت دے کر ایسا کرتے ہیں (اس مرحلہ کو بھی کہا جاتا ہے۔ ٹھیک ٹیوننگ)۔ ہم اس حقیقت کا فائدہ اٹھاتے ہیں کہ یہ پہلے ہی جانتا ہے کہ عام طور پر متن کا خلاصہ کیسے کیا جائے۔ پھر ہم اسے اپنے arXiv ڈیٹاسیٹ کی بہت سی مثالیں دکھاتے ہیں۔ ڈیپ لرننگ ماڈلز ڈیٹا سیٹس پر تربیت حاصل کرنے کے بعد پیٹرن کی نشاندہی کرنے میں غیر معمولی طور پر اچھے ہوتے ہیں، اس لیے ہم توقع کرتے ہیں کہ ماڈل اس خاص کام میں بہتر ہوگا۔

سیکشن 3: خلاصہ ماڈل کو تربیت دیں۔

اس سیکشن میں، ہم سیکشن 2 (sshleifer/distilbart-cnn-12-6) ہمارے ڈیٹاسیٹ پر۔ خیال یہ ہے کہ ماڈل کو یہ سکھایا جائے کہ تحقیقی مقالوں کے خلاصوں کے خلاصے اس کی بہت سی مثالیں دکھا کر کیسا نظر آتے ہیں۔ وقت گزرنے کے ساتھ ماڈل کو اس ڈیٹاسیٹ میں پیٹرن کو پہچاننا چاہیے، جو اسے بہتر خلاصے بنانے کی اجازت دے گا۔

یہ بات ایک بار پھر قابل غور ہے کہ اگر آپ نے ڈیٹا، یعنی متن اور متعلقہ خلاصے کا لیبل لگا رکھا ہے، تو آپ کو ماڈل کو تربیت دینے کے لیے ان کا استعمال کرنا چاہیے۔ صرف ایسا کرنے سے ہی ماڈل آپ کے مخصوص ڈیٹاسیٹ کے پیٹرن سیکھ سکتا ہے۔

ماڈل ٹریننگ کا مکمل کوڈ درج ذیل ہے۔ نوٹ بک.

ایک تربیتی کام مرتب کریں۔

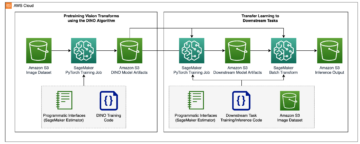

چونکہ لیپ ٹاپ پر گہری سیکھنے کے ماڈل کو تربیت دینے میں چند ہفتے لگیں گے، ہم استعمال کرتے ہیں۔ ایمیزون سیج میکر اس کے بجائے تربیتی ملازمتیں مزید تفصیلات کے لیے رجوع کریں۔ ایمیزون سیج میکر کے ساتھ ایک ماڈل کو تربیت دیں۔. اس پوسٹ میں، میں مختصر طور پر ان تربیتی ملازمتوں کو استعمال کرنے کے فائدے پر روشنی ڈالتا ہوں، اس حقیقت کے علاوہ کہ وہ ہمیں GPU کمپیوٹ مثالوں کو استعمال کرنے کی اجازت دیتے ہیں۔

آئیے فرض کریں کہ ہمارے پاس GPU مثالوں کا ایک جھرمٹ ہے جسے ہم استعمال کر سکتے ہیں۔ اس صورت میں، ہم ممکنہ طور پر تربیت کو چلانے کے لیے ایک Docker امیج بنانا چاہتے ہیں تاکہ ہم آسانی سے دوسری مشینوں پر تربیتی ماحول کو نقل کر سکیں۔ اس کے بعد ہم مطلوبہ پیکجز انسٹال کرتے ہیں اور چونکہ ہم کئی مثالیں استعمال کرنا چاہتے ہیں، ہمیں تقسیم شدہ تربیت بھی ترتیب دینے کی ضرورت ہے۔ تربیت مکمل ہونے پر، ہم ان کمپیوٹرز کو فوری طور پر بند کرنا چاہتے ہیں کیونکہ یہ مہنگے ہیں۔

تربیتی ملازمتوں کا استعمال کرتے وقت یہ تمام اقدامات ہم سے دور ہوتے ہیں۔ درحقیقت، ہم ایک ماڈل کو اسی طرح تربیت دے سکتے ہیں جیسا کہ تربیت کے پیرامیٹرز کو بتا کر اور پھر صرف ایک طریقہ کو کال کر کے بیان کیا گیا ہے۔ سیج میکر باقی کی دیکھ بھال کرتا ہے، بشمول تربیت مکمل ہونے پر GPU کی مثالوں کو روکنا تاکہ مزید اخراجات نہ اٹھائے جائیں۔

اس کے علاوہ، Hugging Face اور AWS نے 2022 کے شروع میں ایک شراکت کا اعلان کیا جو SageMaker پر Hugging Face ماڈلز کو تربیت دینا اور بھی آسان بناتا ہے۔ یہ فعالیت Hugging Face کی ترقی کے ذریعے دستیاب ہے۔ AWS ڈیپ لرننگ کنٹینرز (DLCs)۔ ان کنٹینرز میں Hugging Face Transformers، Tokenizers اور Datasets لائبریری شامل ہیں، جو ہمیں ان وسائل کو تربیت اور انفرنس کی ملازمتوں کے لیے استعمال کرنے کی اجازت دیتی ہے۔ دستیاب DLC امیجز کی فہرست کے لیے، دستیاب دیکھیں گلے لگانا چہرہ گہری سیکھنے والے کنٹینرز کی تصاویر. حفاظتی پیچ کے ساتھ ان کو برقرار رکھا جاتا ہے اور باقاعدگی سے اپ ڈیٹ کیا جاتا ہے۔ ہم ان DLCs کے ساتھ Hugging Face ماڈلز کو تربیت دینے کے طریقے کی بہت سی مثالیں تلاش کر سکتے ہیں۔ Python SDK کو گلے لگانا مندرجہ ذیل میں GitHub repo.

ہم ان مثالوں میں سے ایک کو بطور ٹیمپلیٹ استعمال کرتے ہیں کیونکہ یہ تقریباً ہر وہ کام کرتا ہے جس کی ہمیں اپنے مقصد کے لیے ضرورت ہوتی ہے: خلاصہ ماڈل کو تربیت دیں۔ ایک مخصوص ڈیٹاسیٹ پر تقسیم شدہ طریقے سے (ایک سے زیادہ GPU مثالوں کا استعمال کرتے ہوئے)۔

تاہم، ہمیں ایک چیز کا حساب دینا ہوگا کہ یہ مثال ہگنگ فیس ڈیٹاسیٹ حب سے براہ راست ڈیٹاسیٹ کا استعمال کرتی ہے۔ چونکہ ہم اپنا حسب ضرورت ڈیٹا فراہم کرنا چاہتے ہیں، ہمیں نوٹ بک میں قدرے ترمیم کرنے کی ضرورت ہے۔

تربیتی کام میں ڈیٹا منتقل کریں۔

اس حقیقت کا محاسبہ کرنے کے لیے کہ ہم اپنا ڈیٹا سیٹ لاتے ہیں، ہمیں استعمال کرنے کی ضرورت ہے۔ چینل. مزید معلومات کے لیے رجوع کریں۔ ایمیزون سیج میکر کس طرح تربیتی معلومات فراہم کرتا ہے۔.

مجھے ذاتی طور پر یہ اصطلاح قدرے مبہم لگتی ہے، اس لیے میرے ذہن میں میں ہمیشہ سوچتا ہوں۔ تعریفیں جب میں سنتا ہوں چینلکیونکہ یہ مجھے بہتر انداز میں دیکھنے میں مدد کرتا ہے کہ کیا ہوتا ہے۔ مجھے وضاحت کرنے دو: جیسا کہ ہم نے پہلے ہی سیکھا ہے، تربیتی کام کا ایک کلسٹر بنتا ہے۔ ایمیزون لچکدار کمپیوٹ کلاؤڈ (ایمیزون ای سی 2) اس پر ایک ڈوکر امیج کی مثالیں اور کاپی کرتا ہے۔ تاہم، ہمارے ڈیٹاسیٹس اس میں محفوظ ہیں۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون ایس 3) اور اس ڈاکر امیج کے ذریعہ اس تک رسائی حاصل نہیں کی جاسکتی ہے۔ اس کے بجائے، تربیتی کام کو ایمیزون S3 سے ڈیٹا کو مقامی طور پر اس ڈوکر امیج میں پہلے سے طے شدہ راستے پر کاپی کرنے کی ضرورت ہے۔ ایسا کرنے کا طریقہ یہ ہے کہ ہم ٹریننگ جاب کو بتاتے ہیں کہ ڈیٹا ایمیزون S3 میں کہاں رہتا ہے اور کہاں ڈوکر امیج پر ڈیٹا کو کاپی کیا جانا چاہیے تاکہ ٹریننگ جاب اس تک رسائی حاصل کر سکے۔ ہم نقشہ مقامی راستے کے ساتھ ایمیزون S3 مقام۔

ہم نے ٹریننگ جاب کے ہائپر پیرامیٹر سیکشن میں مقامی راستہ سیٹ کیا ہے:

پھر ہم تربیت کے کام کو بتاتے ہیں کہ ڈیٹا ایمیزون S3 میں کہاں رہتا ہے جب fit() طریقہ کو کال کرتے ہیں، جس سے تربیت شروع ہوتی ہے:

![]()

اس کے بعد فولڈر کا نام نوٹ کریں۔ /opt/ml/input/data چینل کے نام سے میل کھاتا ہے (datasets)۔ یہ تربیتی کام کو ایمیزون S3 سے ڈیٹا کو مقامی راستے پر کاپی کرنے کے قابل بناتا ہے۔

تربیت شروع کریں۔

اب ہم تربیتی کام شروع کرنے کے لیے تیار ہیں۔ جیسا کہ پہلے ذکر کیا گیا ہے، ہم کال کرکے ایسا کرتے ہیں۔ fit() طریقہ تربیتی کام تقریباً 40 منٹ تک چلتا ہے۔ آپ پیش رفت کی پیروی کر سکتے ہیں اور SageMaker کنسول پر اضافی معلومات دیکھ سکتے ہیں۔

جب تربیتی کام مکمل ہو جاتا ہے، تو یہ ہمارے نئے تربیت یافتہ ماڈل کا جائزہ لینے کا وقت ہے۔

سیکشن 4: تربیت یافتہ ماڈل کا اندازہ لگائیں۔

ہمارے تربیت یافتہ ماڈل کا اندازہ کرنا سیکشن 2 میں کیا گیا تھا، جہاں ہم نے ZSL ماڈل کا جائزہ لیا تھا۔ ہم ماڈل کو کال کرتے ہیں اور امیدواروں کے خلاصے تیار کرتے ہیں اور ROUGE اسکورز کا حساب لگا کر حوالہ جات کے خلاصوں سے ان کا موازنہ کرتے ہیں۔ لیکن اب، ماڈل ایمیزون S3 میں ایک فائل میں بیٹھا ہے جسے کہا جاتا ہے۔ model.tar.gz (درست مقام تلاش کرنے کے لیے، آپ کنسول پر ٹریننگ جاب چیک کر سکتے ہیں)۔ تو ہم خلاصے بنانے کے لیے ماڈل تک کیسے رسائی حاصل کرتے ہیں؟

ہمارے پاس دو اختیارات ہیں: ماڈل کو SageMaker اینڈ پوائنٹ پر تعینات کریں یا اسے مقامی طور پر ڈاؤن لوڈ کریں، جیسا کہ ہم نے ZSL ماڈل کے ساتھ سیکشن 2 میں کیا تھا۔ اس ٹیوٹوریل میں، I ماڈل کو سیج میکر اینڈ پوائنٹ پر تعینات کریں۔ کیونکہ یہ زیادہ آسان ہے اور اختتامی نقطہ کے لیے زیادہ طاقتور مثال کا انتخاب کر کے، ہم تخمینہ کے وقت کو نمایاں طور پر مختصر کر سکتے ہیں۔ GitHub ریپو پر مشتمل ہے a نوٹ بک اس سے پتہ چلتا ہے کہ مقامی طور پر ماڈل کی جانچ کیسے کی جائے۔

ایک ماڈل تعینات کریں۔

سیج میکر پر تربیت یافتہ ماڈل کو تعینات کرنا عام طور پر بہت آسان ہوتا ہے (مندرجہ ذیل مثال کو دوبارہ دیکھیں GitHub کے گلے ملنے والے چہرے سے)۔ ماڈل کی تربیت کے بعد، ہم کال کر سکتے ہیں۔ estimator.deploy() اور سیج میکر ہمارے لیے باقی کام پس منظر میں کرتا ہے۔ کیونکہ ہمارے ٹیوٹوریل میں ہم ایک نوٹ بک سے دوسری نوٹ بک پر سوئچ کرتے ہیں، ہمیں پہلے تربیتی کام اور متعلقہ ماڈل کو تلاش کرنا ہوگا، اس سے پہلے کہ ہم اسے تعینات کرسکیں:

ماڈل لوکیشن کو بازیافت کرنے کے بعد، ہم اسے سیج میکر اینڈ پوائنٹ پر تعینات کر سکتے ہیں:

سیج میکر پر تعیناتی سیدھی ہے کیونکہ یہ استعمال کرتا ہے۔ سیج میکر ہگنگ فیس انفرنس ٹول کٹSageMaker پر ٹرانسفارمرز ماڈل پیش کرنے کے لیے ایک اوپن سورس لائبریری۔ ہمیں عام طور پر انفرنس اسکرپٹ بھی فراہم کرنے کی ضرورت نہیں ہے۔ ٹول کٹ اس کا خیال رکھتی ہے۔ اس صورت میں، تاہم، ٹول کٹ دوبارہ پائپ لائن API کا استعمال کرتی ہے، اور جیسا کہ ہم نے سیکشن 2 میں بات کی ہے، پائپ لائن API ہمیں بیم تلاش اور نمونے لینے جیسی جدید ٹیکسٹ جنریشن تکنیک استعمال کرنے کی اجازت نہیں دیتا ہے۔ اس حد سے بچنے کے لیے، ہم فراہم کرتے ہیں۔ حسب ضرورت انفرنس اسکرپٹ.

پہلی تشخیص

اپنے نئے تربیت یافتہ ماڈل کی پہلی تشخیص کے لیے، ہم امیدواروں کے خلاصے تیار کرنے کے لیے زیرو شاٹ ماڈل کے ساتھ سیکشن 2 کی طرح کے پیرامیٹرز استعمال کرتے ہیں۔ یہ سیب سے سیب کا موازنہ کرنے کی اجازت دیتا ہے:

ہم ماڈل کے ذریعہ تیار کردہ خلاصوں کا حوالہ کے خلاصوں سے موازنہ کرتے ہیں:

یہ حوصلہ افزا ہے! ماڈل کو تربیت دینے کی ہماری پہلی کوشش، بغیر کسی ہائپر پیرامیٹر ٹیوننگ کے، نے ROUGE اسکور کو نمایاں طور پر بہتر کیا ہے۔

دوسری تشخیص

اب وقت آگیا ہے کہ کچھ اور جدید تکنیکیں استعمال کی جائیں جیسے کہ بیم کی تلاش اور نمونے لینے کے لیے ماڈل کے ساتھ کھیلنے کے لیے۔ ان پیرامیٹرز میں سے ہر ایک کیا کرتا ہے اس کی تفصیلی وضاحت کے لیے، رجوع کریں۔ متن کیسے تیار کیا جائے: ٹرانسفارمرز کے ساتھ زبان کی تخلیق کے لیے مختلف ضابطہ کشائی کے طریقے استعمال کرنا. آئیے ان میں سے کچھ پیرامیٹرز کے لیے قدروں کے نیم بے ترتیب سیٹ کے ساتھ اسے آزمائیں:

اپنے ماڈل کو ان پیرامیٹرز کے ساتھ چلاتے وقت، ہمیں درج ذیل اسکور ملتے ہیں:

یہ بالکل ٹھیک نہیں ہوا جیسا کہ ہم نے امید کی تھی۔ تاہم، یہ آپ کو ان پیرامیٹرز کے لیے مختلف اقدار کو آزمانے سے حوصلہ شکنی نہ ہونے دیں۔ درحقیقت، یہ وہ نقطہ ہے جہاں ہم سیٹ اپ کے مرحلے کو ختم کرتے ہیں اور پروجیکٹ کے تجرباتی مرحلے میں منتقل ہوتے ہیں۔

نتیجہ اور اگلے اقدامات

ہم نے تجرباتی مرحلے کے لیے سیٹ اپ مکمل کر لیا ہے۔ اس دو حصوں کی سیریز میں، ہم نے اپنا ڈیٹا ڈاؤن لوڈ اور تیار کیا، ایک سادہ ہیورسٹک کے ساتھ ایک بیس لائن بنائی، زیرو شاٹ لرننگ کا استعمال کرتے ہوئے ایک اور بیس لائن بنائی، اور پھر اپنے ماڈل کو تربیت دی اور کارکردگی میں نمایاں اضافہ دیکھا۔ اب وقت آگیا ہے کہ ہم نے جو بھی حصہ بنایا ہے اس کے ساتھ کھیلنے کا تاکہ اس سے بھی بہتر خلاصے پیدا ہوں۔ مندرجہ ذیل پر غور کریں:

- ڈیٹا کو صحیح طریقے سے پروسیس کریں۔ – مثال کے طور پر، سٹاپ ورڈز اور اوقاف کو ہٹا دیں۔ اس حصے کو کم نہ سمجھیں — ڈیٹا سائنس کے بہت سے پروجیکٹس میں، ڈیٹا پری پروسیسنگ سب سے اہم پہلوؤں میں سے ایک ہے (اگر سب سے اہم نہیں ہے)، اور ڈیٹا سائنسدان عموماً اپنا زیادہ تر وقت اس کام میں صرف کرتے ہیں۔

- مختلف ماڈلز آزمائیں۔ - اپنے ٹیوٹوریل میں، ہم نے خلاصہ کے لیے معیاری ماڈل استعمال کیا (

sshleifer/distilbart-cnn-12-6)، لیکن بہت سے مزید ماڈلز دستیاب ہیں جو آپ اس کام کے لیے استعمال کر سکتے ہیں۔ ان میں سے ایک آپ کے استعمال کے معاملے میں بہتر طور پر فٹ ہو سکتا ہے۔ - ہائپر پیرامیٹر ٹیوننگ انجام دیں۔ - ماڈل کو تربیت دیتے وقت، ہم نے ہائپر پیرامیٹرس کا ایک مخصوص سیٹ استعمال کیا (سیکھنے کی شرح، عہدوں کی تعداد، اور اسی طرح)۔ یہ پیرامیٹرز پتھر میں سیٹ نہیں کیے گئے ہیں - بالکل اس کے برعکس۔ آپ کو یہ سمجھنے کے لیے ان پیرامیٹرز کو تبدیل کرنا چاہیے کہ وہ آپ کے ماڈل کی کارکردگی کو کیسے متاثر کرتے ہیں۔

- متن بنانے کے لیے مختلف پیرامیٹرز استعمال کریں۔ - ہم بیم کی تلاش اور نمونے لینے کے لیے مختلف پیرامیٹرز کے ساتھ خلاصے بنانے کا ایک دور پہلے ہی کر چکے ہیں۔ مختلف اقدار اور پیرامیٹرز کو آزمائیں۔ مزید معلومات کے لیے رجوع کریں۔ متن کیسے تیار کیا جائے: ٹرانسفارمرز کے ساتھ زبان کی تخلیق کے لیے مختلف ضابطہ کشائی کے طریقے استعمال کرنا.

مجھے امید ہے کہ آپ نے اسے آخر تک پہنچایا اور اس ٹیوٹوریل کو مفید پایا۔

مصنف کے بارے میں

ہیکو ہوٹز اے آئی اور مشین لرننگ کے سینئر سولیوشن آرکیٹیکٹ ہیں اور AWS کے اندر نیچرل لینگویج پروسیسنگ (NLP) کمیونٹی کی رہنمائی کرتے ہیں۔ اس کردار سے پہلے، وہ ایمیزون کی EU کسٹمر سروس کے ڈیٹا سائنس کے سربراہ تھے۔ Heiko ہمارے صارفین کو AWS پر ان کے AI/ML سفر میں کامیاب ہونے میں مدد کرتا ہے اور اس نے کئی صنعتوں میں تنظیموں کے ساتھ کام کیا ہے، بشمول انشورنس، مالیاتی خدمات، میڈیا اور تفریح، صحت کی دیکھ بھال، یوٹیلٹیز، اور مینوفیکچرنگ۔ اپنے فارغ وقت میں ہیکو زیادہ سے زیادہ سفر کرتا ہے۔

ہیکو ہوٹز اے آئی اور مشین لرننگ کے سینئر سولیوشن آرکیٹیکٹ ہیں اور AWS کے اندر نیچرل لینگویج پروسیسنگ (NLP) کمیونٹی کی رہنمائی کرتے ہیں۔ اس کردار سے پہلے، وہ ایمیزون کی EU کسٹمر سروس کے ڈیٹا سائنس کے سربراہ تھے۔ Heiko ہمارے صارفین کو AWS پر ان کے AI/ML سفر میں کامیاب ہونے میں مدد کرتا ہے اور اس نے کئی صنعتوں میں تنظیموں کے ساتھ کام کیا ہے، بشمول انشورنس، مالیاتی خدمات، میڈیا اور تفریح، صحت کی دیکھ بھال، یوٹیلٹیز، اور مینوفیکچرنگ۔ اپنے فارغ وقت میں ہیکو زیادہ سے زیادہ سفر کرتا ہے۔

- "

- &

- 100

- 2022

- 7

- 84

- 9

- ہمارے بارے میں

- خلاصہ

- تک رسائی حاصل

- اکاؤنٹ

- اس کے علاوہ

- ایڈیشنل

- اعلی درجے کی

- فائدہ

- AI

- تمام

- پہلے ہی

- اگرچہ

- ایمیزون

- کا اعلان کیا ہے

- ایک اور

- اے پی آئی

- ارد گرد

- مضامین

- دستیاب

- AWS

- پس منظر

- بیس لائن

- بیم

- بن

- کیا جا رہا ہے

- معیار

- فائدہ

- بٹ

- فون

- پرواہ

- تبدیل

- کوڈ

- کمیونٹی

- کمپیوٹنگ

- کمپیوٹر

- تصور

- کنسول

- کنٹینر

- پر مشتمل ہے

- کنٹرول

- آسان

- اخراجات

- سکتا ہے

- پیدا

- تخلیق

- اپنی مرضی کے

- کسٹمر سروس

- گاہکوں

- اعداد و شمار

- ڈیٹا سائنس

- تعیناتی

- ترقی

- DID

- مختلف

- تقسیم کئے

- میں Docker

- نہیں کرتا

- ڈومین

- نیچے

- ڈاؤن لوڈز

- آسانی سے

- کی حوصلہ افزائی

- اختتام پوائنٹ

- تفریح

- ماحولیات

- EU

- سب کچھ

- مثال کے طور پر

- توقع ہے

- نچوڑ۔

- چہرہ

- مالی

- مالیاتی خدمات

- پہلا

- فٹ

- پر عمل کریں

- کے بعد

- فارمیٹ

- آگے

- ملا

- تقریب

- فعالیت

- مزید

- جنرل

- پیدا

- نسل

- GitHub کے

- جا

- اچھا

- GPU

- رہنمائی

- سر

- صحت کی دیکھ بھال

- مدد کرتا ہے

- نمایاں کریں

- کس طرح

- کیسے

- HTTPS

- خیال

- کی نشاندہی

- تصویر

- اہم

- کو بہتر بنانے کے

- شامل

- سمیت

- اضافہ

- صنعتوں

- اثر و رسوخ

- معلومات

- انسٹال

- انشورنس

- پیچیدگیاں

- IT

- ایوب

- نوکریاں

- کلیدی

- زمین کی تزئین کی

- زبان

- لیپ ٹاپ

- بڑے

- لیڈز

- جانیں

- سیکھا ہے

- سیکھنے

- لائبریری

- لسٹ

- مقامی

- مقامی طور پر

- محل وقوع

- لانگ

- مشین

- مشین لرننگ

- مشینیں

- بناتا ہے

- مینوفیکچرنگ

- میڈیا

- برا

- ML

- ماڈل

- ماڈل

- زیادہ

- سب سے زیادہ

- یعنی

- قدرتی

- خبر

- نوٹ بک

- تعداد

- تعداد

- آپشنز کے بھی

- حکم

- تنظیمیں

- دیگر

- کاغذ.

- شراکت داری

- پیچ

- کارکردگی

- مرحلہ

- کھیلیں

- پوائنٹ

- مقبول

- ممکن

- طاقتور

- پیشن گوئی

- منصوبے

- منصوبوں

- تجویز کریں

- فراہم

- فراہم کرتا ہے

- مقصد

- معیار

- جلدی سے

- مناسب

- تسلیم

- ضرورت

- تحقیق

- وسائل

- باقی

- نتائج کی نمائش

- منہاج القرآن

- رن

- چل رہا ہے

- سائنس

- سائنسدانوں

- تلاش کریں

- سیکورٹی

- احساس

- سیریز

- سروس

- سروسز

- خدمت

- مقرر

- اہم

- اسی طرح

- سادہ

- چھ

- So

- حل

- خاص طور پر

- خرچ

- شروع کریں

- شروع ہوتا ہے

- ریاستی آرٹ

- ذخیرہ

- حکمت عملی

- کامیاب

- سوئچ کریں

- تکنیک

- ٹیسٹ

- کے ذریعے

- وقت

- عنوان

- ٹریننگ

- عام طور پر

- سمجھ

- us

- استعمال کی شرائط

- عام طور پر

- استعمال

- قیمت

- ویب سائٹ

- کیا

- ڈبلیو

- وکیپیڈیا

- کے اندر

- بغیر

- الفاظ

- کام

- مشقت

- کام کیا

- قابل

- سال

- صفر