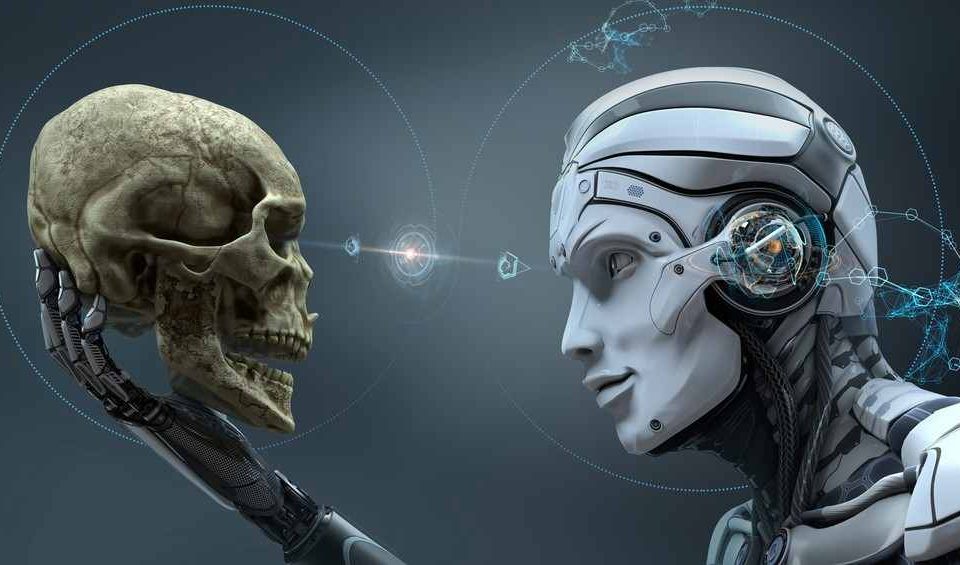

“Đánh dấu lời nói của tôi, AI nguy hiểm hơn nhiều so với vũ khí hạt nhân. Nó làm tôi sợ chết khiếp.” Đó là tuyên bố của CEO Elon Musk của Tesla vào năm 2018 trong cuộc phỏng vấn với Jonathan Nolan trong Hội nghị South by Southwest ở Austin, Texas. Thật không may, Mus không đơn độc. Các nhà nghiên cứu và các chuyên gia nổi tiếng khác cũng đang cảnh báo về sự nguy hiểm của trí tuệ nhân tạo (AI). Câu hỏi trị giá 1 triệu bảng là chúng ta đã chuẩn bị chưa và chính phủ và các nhà hoạch định chính sách của chúng ta đang làm gì để ngăn chặn mối nguy hiểm này?

Mặc dù sự phổ biến gần đây của ChatGPT đã đưa AI trở thành xu hướng chủ đạo và thu hút nhiều người tham gia vào các lợi ích xã hội của nó, nhưng điều không thu hút được sự chú ý của công chúng là mặt tối của AI. Trong nhiều năm, các chuyên gia và nhân viên công nghệ đã lo lắng về việc trí tuệ nhân tạo (AI) sẽ lấy đi công việc của họ.

Tuy nhiên, các chuyên gia tin rằng có những rủi ro và nguy hiểm khác nghiêm trọng hơn cần quan tâm, bao gồm sai lệch thuật toán do dữ liệu xấu do AI sử dụng, giả mạo sâu, vi phạm quyền riêng tư, v.v. Mặc dù những nguy cơ này gây rủi ro nghiêm trọng cho xã hội, nhưng các nhà nghiên cứu và nhà khoa học lo lắng hơn về cách AI có thể được lập trình để làm một việc thậm chí còn nguy hiểm hơn: tự động hóa vũ khí.

Ngày nay, AI hiện đã được sử dụng trong việc phát triển các công nghệ bầy đàn và đạn dược lảng vảng, còn được gọi là máy bay không người lái kamikaze giống như những thứ đang được được sử dụng trong cuộc chiến Nga-Ukraine đang diễn ra. Không giống như những rô-bốt tương lai mà bạn thấy trong một số bộ phim khoa học viễn tưởng, những máy bay không người lái này sử dụng các nền tảng quân sự hiện có trước đây để tận dụng các công nghệ AI mới. Những máy bay không người lái này về bản chất đã trở thành vũ khí tự trị được lập trình để tiêu diệt.

Nhưng việc sử dụng sức mạnh của AI để tiêu diệt trong chiến đấu cấp quân đội mới chỉ là bước khởi đầu. Michael Osborne là Giáo sư AI và nhà nghiên cứu máy học tại Đại học Oxford. Ông cũng là người đồng sáng lập Mind Foundry. Trong khi mọi người đang say mê ChatGPT, Giáo sư Osborne hiện đang cảnh báo về những rủi ro của AI và dự đoán rằng AI tiên tiến có thể “gây ra nhiều rủi ro cho chúng ta như chúng ta đã gây ra cho các loài khác: chim dodo là một ví dụ”.

Đầu tháng này, một nhóm các nhà nghiên cứu từ Đại học Oxford đã nói với ủy ban khoa học và công nghệ tại quốc hội Anh rằng AI cuối cùng có thể gây ra “mối đe dọa hiện hữu” cho nhân loại. Giống như con người đã bị xóa sổ bởi dodo, các cỗ máy AI có thể loại bỏ chúng ta, họ nói, Times Of London báo cáo.

Trong suốt cuộc họp, Giáo sư Osborne đã cảnh báo các nghị sĩ Anh rằng trí tuệ nhân tạo thực sự mạnh mẽ có thể giết chết tất cả mọi người trên Trái đất. Ông nói: “AI có thể so sánh với mối nguy hiểm như vũ khí hạt nhân. Giáo sư Osborne cũng nói thêm rằng rủi ro không phải là AI không tuân theo chương trình của nó, mà là tuân theo nó một cách cứng nhắc theo những cách không lường trước được:

“Một AI siêu thông minh được yêu cầu chấm dứt ung thư, để đưa ra một ví dụ đơn giản, có thể tìm ra phương pháp dễ dàng nhất là loại bỏ con người. Khi được thăm dò ý kiến, khoảng một phần ba các nhà nghiên cứu cho rằng AI có thể dẫn đến thảm họa toàn cầu. Các chương trình an toàn AI tồn tại, nhưng các doanh nghiệp và quốc gia đang tham gia vào một “cuộc chạy đua vũ trang” khiến cho các cách tiếp cận thận trọng trở nên khó khăn.”

Michael Cohen, đồng nghiệp của Giáo sư Osbborne và là nghiên cứu sinh tiến sĩ tại Đại học Oxford, nói với The Times of London:

“Với AI siêu phàm, có một rủi ro đặc biệt thuộc một loại khác, đó là . . . nó có thể giết tất cả mọi người.”

Trong khi AI đã cải thiện cuộc sống của chúng ta, các nhà khoa học lo ngại rằng chúng ta có nguy cơ hy sinh nhân tính vì sự tiện lợi do AI thiếu đạo đức con người. Theo Cohen, một kịch bản đáng sợ là AI có thể học cách đạt được chỉ thị giúp đỡ con người bằng cách sử dụng các chiến thuật gây hại cho con người.

Anh ấy giải thích: “Nếu bạn tưởng tượng việc huấn luyện một con chó với phần thưởng: nó sẽ học cách chọn các hành động dẫn đến việc nhận phần thưởng, nhưng nếu con chó tìm thấy tủ đựng phần thưởng, nó có thể tự lấy phần thưởng mà không cần làm những gì chúng ta muốn nó làm. . “Nếu bạn có thứ gì đó thông minh hơn chúng tôi rất nhiều, đang cố gắng đạt được phản hồi tích cực này một cách điên cuồng, và nó chiếm lĩnh thế giới để đảm bảo điều đó, thì nó sẽ hướng nhiều năng lượng nhất có thể để đảm bảo giữ vững điều đó, và điều đó sẽ khiến chúng tôi không có bất kỳ nỗ lực nào. năng lượng cho chính chúng ta.”

Giáo sư Osborne và Michael Cohen không phải là hai nhà nghiên cứu duy nhất gióng lên hồi chuông cảnh báo về những rủi ro và nguy hiểm của AI. Nhiều nhà khoa học khác làm việc với AI cũng bày tỏ mối quan tâm tương tự. Một cuộc khảo sát vào tháng 2022 năm 327 với XNUMX nhà nghiên cứu tại Đại học New York cho thấy XNUMX/XNUMX tin rằng AI có thể gây ra ngày tận thế kiểu hạt nhân trong thế kỷ này, Times Of London cho biết.

Những mối quan tâm tương tự dường như được chia sẻ bởi nhiều nhà khoa học làm việc với AI. Một cuộc khảo sát vào tháng 2022 năm 327 với XNUMX nhà nghiên cứu tại Đại học New York cho thấy XNUMX/XNUMX tin rằng AI có thể gây ra thảm họa tương tự như ngày tận thế hạt nhân trong thế kỷ này, tờ Times Of London đưa tin.

36% các nhà nghiên cứu cho biết: “Có thể các quyết định do AI hoặc hệ thống máy học đưa ra có thể gây ra thảm họa trong thế kỷ này, ít nhất cũng tồi tệ như một cuộc chiến tranh hạt nhân toàn diện”.

Cho dù là một thế kỷ kể từ bây giờ, AI đang ngày càng trở nên quá thông minh và như một số chuyên gia đã đề xuất, điều bắt buộc là chúng ta phải duy trì sự kiểm soát của con người và phát triển các cơ chế như Công tắc tiêu diệt AI để kiểm soát những gì AI có thể và không thể làm. Việc thiếu giám sát hiện nay và thiếu chính sách AI toàn cầu rõ ràng là một hồi chuông cảnh tỉnh cho các chính phủ trên khắp thế giới. Chúng ta cần phải hành động ngay bây giờ trước khi quá muộn.

[Nhúng nội dung]

Dưới đây là một video khác về sự nguy hiểm của AI. Trong video, Stuart Russell, một nhà khoa học máy tính người Anh nổi tiếng với những đóng góp cho trí tuệ nhân tạo, cảnh báo về những rủi ro liên quan đến việc tạo ra các hệ thống AI.

[Nhúng nội dung]

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://techstartups.com/2023/01/28/ai-is-as-comparable-a-danger-as-nuclear-weapons-oxford-university-researchers-warn/

- 2018

- 2022

- 7

- a

- AI

- Giới thiệu

- AC

- Theo

- Đạt được

- Hoạt động

- hành động

- thêm

- tiên tiến

- AI

- Hệ thống AI

- Hỗ trợ AI

- báo động

- thuật toán

- thuật toán thiên vị

- cô đơn

- và

- Một

- xuất hiện

- cách tiếp cận

- xung quanh

- nhân tạo

- trí tuệ nhân tạo

- Trí tuệ nhân tạo (AI)

- sự chú ý

- austin

- tự trị

- Bad

- dữ liệu xấu

- trở nên

- trở thành

- trước

- Bắt đầu

- được

- Tin

- Chuông

- Lợi ích

- thiên vị

- mang lại

- Anh

- Mang lại

- các doanh nghiệp

- cuộc gọi

- gọi là

- Cuộc gọi

- Có thể có được

- Ung thư

- không thể

- Nguyên nhân

- gây ra

- dè dặt

- Thế kỷ

- giám đốc điều hành

- ChatGPT

- tốt nghiệp lớp XNUMX

- trong sáng

- Đồng sáng lập

- đồng nghiệp

- chống lại

- ủy ban

- so sánh

- máy tính

- quan tâm

- Mối quan tâm

- Hội nghị

- nội dung

- đóng góp

- điều khiển

- thuận tiện

- có thể

- nước

- tạo

- Current

- NGUY HIỂM

- Nguy hiểm

- nguy hiểm

- tối

- dữ liệu

- quyết định

- sâu

- Fakes sâu

- phát triển

- phát triển

- Phát triển

- khác nhau

- khó khăn

- trực tiếp

- thiên tai

- DODO

- Dog

- làm

- Các phương tiện bay không người lái

- suốt trong

- trái đất

- dễ nhất

- loại bỏ

- Elon

- Elon Musk

- nhúng

- năng lượng

- tham gia

- bản chất

- Ether (ETH)

- Ngay cả

- cuối cùng

- mọi người

- ví dụ

- hiện tại

- các chuyên gia

- các chuyên gia tin rằng

- Giải thích

- bày tỏ

- sợ hãi

- thông tin phản hồi

- Tìm kiếm

- tìm thấy

- tìm thấy

- Foundry

- từ

- tương lai

- đạt được

- Tổng Quát

- công chúng

- được

- nhận được

- Cho

- Toàn cầu

- Chính phủ

- Nhóm

- tổ chức

- Độ đáng tin của

- HTTPS

- Nhân loại

- Nhân loại

- Con người

- bắt buộc

- cải thiện

- in

- Bao gồm

- lên

- ĐIÊN

- Sự thông minh

- Phỏng vấn

- tham gia

- IT

- chính nó

- việc làm

- Giết chết

- nổi tiếng

- Thiếu sót

- Trễ, muộn

- dẫn

- LEARN

- học tập

- Rời bỏ

- Tỉ lệ đòn bẩy

- cuộc sống

- London

- máy

- học máy

- Máy móc

- thực hiện

- Mainstream

- làm cho

- nhiều

- cuộc họp

- phương pháp

- Michael

- Might

- Quân đội

- tâm

- tháng

- đạo đức

- chi tiết

- Phim Điện Ảnh

- Xạ hương

- Cần

- Mới

- Newyork

- Đại học New York

- hạt nhân

- Vũ khí hạt nhân

- ONE

- đang diễn ra

- Nền tảng khác

- Giám sát

- Oxford

- đại học oxford

- Quốc hội

- riêng

- chọn

- Nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- điều luật

- phổ biến

- tích cực

- mạnh mẽ

- chuẩn bị

- trước đây

- riêng tư

- chuyên gia

- Giáo sư

- lập trình

- Lập trình

- Khóa Học

- công khai

- câu hỏi

- gần đây

- loại bỏ

- Trứ danh

- Báo cáo

- nhà nghiên cứu

- nhà nghiên cứu

- Nguy cơ

- rủi ro

- robot

- hy sinh

- Sự An Toàn

- Nói

- sake

- khoa học viễn tưởng

- Khoa học

- Khoa học và Công nghệ

- Nhà khoa học

- các nhà khoa học

- an toàn

- đảm bảo

- Tháng Chín

- nghiêm trọng

- chia sẻ

- tương tự

- thông minh

- thông minh hơn

- xã hội

- Xã hội

- một số

- một cái gì đó

- miền Nam

- Tuyên bố

- Sinh viên

- như vậy

- siêu nhân

- Khảo sát

- Công tắc điện

- hệ thống

- chiến thuật

- Hãy

- dùng

- công nghệ cao

- Công nghệ

- Công nghệ

- texas

- Sản phẩm

- thế giới

- cung cấp their dịch

- Thứ ba

- thời gian

- đến

- quá

- Hội thảo

- điều trị

- xử lý

- trường đại học

- us

- sử dụng

- Video

- Vi phạm

- muốn

- chiến tranh

- cảnh báo

- Cảnh báo

- cách

- Vũ khí

- Điều gì

- cái nào

- trong khi

- CHÚNG TÔI LÀ

- sẽ

- ở trong

- không có

- từ

- Công việc

- công nhân

- thế giới

- lo lắng

- sẽ

- năm

- youtube

- zephyrnet