Trong tuần của ngày 19 tháng XNUMXth, Linley Group đã tổ chức Hội nghị Bộ xử lý Mùa xuân năm 2021. Linley Group nổi tiếng về việc tổ chức các hội nghị xuất sắc. Và hội xuân năm nay cũng không ngoại lệ. Có một số cuộc nói chuyện rất bổ ích từ các công ty khác nhau cập nhật cho khán giả về công việc nghiên cứu và phát triển mới nhất đang diễn ra trong ngành. Các bài thuyết trình đã được phân loại theo tám chủ đề khác nhau. Các chủ đề là Edge AI, Thiết kế SoC nhúng, Đào tạo mở rộng quy mô AI, Thiết kế SoC AI, Cơ sở hạ tầng mạng cho AI và 5G, Phần mềm Edge AI, Xử lý tín hiệu và Suy luận AI hiệu quả.

Trí tuệ nhân tạo (AI) là một công nghệ đã thu hút được rất nhiều sự chú ý và đầu tư trong những năm gần đây. Hội nghị chắc chắn đã phản ánh điều đó trong số lượng các hạng mục chủ đề liên quan đến AI. Trong danh mục AI rộng hơn, Edge AI là một chủ đề có tỷ lệ trình bày không công bằng và chính đáng như vậy. Điện toán biên đang chứng kiến sự tăng trưởng nhanh chóng nhờ IoT, 5G và các ứng dụng yêu cầu độ trễ thấp khác.

Một trong những bài thuyết trình trong danh mục Edge AI có tiêu đề “Tăng cường tiện ích mở rộng vectơ RISC-V để tăng tốc hiệu suất trên khối lượng công việc ML.” Bài nói chuyện được đưa ra bởi Chris Lattner, Chủ tịch, Kỹ thuật và Sản phẩm tại SiFive, Inc. Chris đã đưa ra một trường hợp mạnh mẽ về lý do tại sao giải pháp dựa trên tiện ích mở rộng véc tơ RISC-V của SiFive lại rất phù hợp cho các ứng dụng do AI điều khiển. Sau đây là của tôi.

Yêu cầu thị trường:

Khi thị trường điện toán biên đang phát triển nhanh chóng, các yêu cầu về hiệu suất và năng lượng của các ứng dụng này cũng ngày càng khắt khe hơn. Nhiều ứng dụng trong số này được điều khiển bởi AI và thuộc danh mục khối lượng công việc học máy (ML). Và việc áp dụng AI đang thúc đẩy yêu cầu xử lý hướng tới thao tác dữ liệu hơn là tính toán cho mục đích chung. Học sâu làm nền tảng cho các mô hình ML và liên quan đến việc xử lý các mảng dữ liệu lớn. Với các mô hình ML đang phát triển nhanh chóng, một giải pháp lý tưởng sẽ là một giải pháp tối ưu hóa cho: hiệu suất, sức mạnh, dễ dàng kết hợp các mô hình ML mới nổi và phạm vi thay đổi phần cứng và/hoặc phần mềm dẫn đến.

Ưu điểm véc tơ RISC-V:

Động lực ban đầu đằng sau sáng kiến đã mang lại cho chúng tôi kiến trúc RISC-V là thử nghiệm. Thử nghiệm để phát triển các thiết kế chip mang lại hiệu suất tốt hơn khi đối mặt với sự chậm lại dự kiến của định luật Moore. RISC-V được xây dựng dựa trên ý tưởng có thể điều chỉnh phù hợp để tạo ra các chip cụ thể mà bạn có thể chọn phần mở rộng tập lệnh mà bạn đang sử dụng. Các phần mở rộng vectơ cho phép xử lý các vectơ có độ dài bất kỳ bằng cách sử dụng các hàm xử lý các vectơ có độ dài cố định. Xử lý vectơ cho phép phần mềm hiện có chạy mà không cần biên dịch lại khi phần cứng được nâng cấp dưới dạng nhiều ALU hơn và các đơn vị chức năng khác. Tiến bộ đáng kể đã xảy ra về cơ sở phần cứng được thiết lập và hệ sinh thái hỗ trợ như công nghệ trình biên dịch.

RISC-V có thể được tối ưu hóa cho một miền hoặc ứng dụng cụ thể thông qua các tiện ích mở rộng tùy chỉnh. Là một kiến trúc tập lệnh tiêu chuẩn mở, người dùng RISC-V có rất nhiều sự linh hoạt trong việc lựa chọn nhà cung cấp cho nhu cầu thiết kế chip của họ.

Ưu đãi của SiFive:

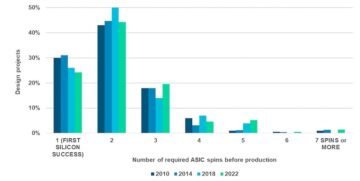

SiFive đã nâng cao lợi thế của RISC-V Vector bằng cách thêm các phần mở rộng vectơ mới để tăng tốc thực thi nhiều mô hình mạng thần kinh khác nhau. Tham khảo Hình 1 để xem ví dụ về loại tăng tốc có thể đạt được khi sử dụng các phần mở rộng bổ trợ của SiFive so với việc chỉ sử dụng các phần mở rộng vectơ cơ sở của RISC-V. Giải pháp Intelligence X280 của nó là một giải pháp RISC-V Vector có khả năng đa lõi (phần cứng và phần mềm) để giúp khách hàng của mình dễ dàng triển khai các ứng dụng Edge AI được tối ưu hóa. Giải pháp này cũng có thể được sử dụng để triển khai các ứng dụng trung tâm dữ liệu.

Hình 1:

Ưu điểm của SiFive:

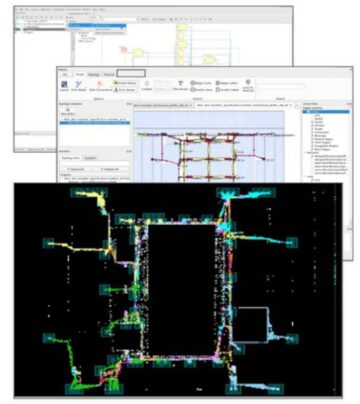

- Giải pháp Intelligence X280 của SiFive hỗ trợ đầy đủ các nền tảng mã nguồn mở TensorFlow và TensorFlow Lite dành cho máy học (Tham khảo Hình 2)

- SiFive cung cấp một cách dễ dàng để di chuyển mã hiện có của khách hàng dựa trên các kiến trúc khác sang kiến trúc RISC-V Vector. Ví dụ: SiFive có thể dịch mã ARM Neon sang mã lắp ráp RISC-V V

- SiFive cho phép khách hàng của mình khám phá việc thêm tiện ích mở rộng tùy chỉnh vào triển khai RISC-V của họ

- SiFive thông qua đơn vị kinh doanh OpenFive của mình mở rộng các dịch vụ triển khai chip tùy chỉnh để giải quyết các nhu cầu silicon theo miền cụ thể

Hình 2:

Tóm tắt:

Tóm lại, khách hàng của SiFive có thể triển khai các ứng dụng của họ một cách dễ dàng và nhanh chóng, cho dù các ứng dụng đó liên quan đến khối lượng công việc Edge AI hay loại khối lượng công việc của trung tâm dữ liệu truyền thống. Nếu quan tâm đến việc hưởng lợi từ các giải pháp của SiFive để tăng tốc hiệu suất khối lượng công việc ML của bạn, tôi khuyên bạn nên đăng ký và lắng nghe Toàn bộ cuộc nói chuyện của Chris và sau đó thảo luận với SiFive về các cách tận dụng các dịch vụ khác nhau của họ để phát triển sản phẩm của bạn.

Chia sẻ bài đăng này qua: Nguồn: https://semiwiki.com/ip/si five/299157-enhancing-risc-v-vector-extensions-to-accelerate-performance-on-ml-workloads/

- 2021

- 5G

- Add-on

- Nhận con nuôi

- Lợi thế

- AI

- Áp dụng AI

- Đào tạo AI

- Các Ứng Dụng

- các ứng dụng

- Tháng Tư

- kiến trúc

- ARM

- khán giả

- kinh doanh

- Chip

- Snacks

- mã

- Các công ty

- máy tính

- Hội nghị

- hội nghị

- khách hàng

- dữ liệu

- Trung tâm dữ liệu

- học kĩ càng

- Thiết kế

- phát triển

- Phát triển

- điều khiển

- hệ sinh thái

- Cạnh

- tính toán cạnh

- Kỹ Sư

- thực hiện

- mở rộng

- Đối mặt

- NHANH

- Hình

- phù hợp với

- Linh hoạt

- hình thức

- Full

- Tổng Quát

- tuyệt vời

- Nhóm

- Phát triển

- Tăng trưởng

- phần cứng

- HTTPS

- ý tưởng

- Inc.

- ngành công nghiệp

- Cơ sở hạ tầng

- Sáng kiến

- Sự thông minh

- đầu tư

- iốt

- IT

- lớn

- mới nhất

- Luật

- học tập

- Tỉ lệ đòn bẩy

- học máy

- Thao tác

- thị trường

- Vấn đề

- ML

- neon

- mạng

- Thần kinh

- mạng lưới thần kinh

- cung cấp

- Cung cấp

- mở

- Nền tảng khác

- hiệu suất

- Nền tảng

- quyền lực

- Thuyết trình

- Chủ tịch

- Sản phẩm

- Sản phẩm

- Yêu cầu

- nghiên cứu

- nghiên cứu và phát triển

- chạy

- mở rộng quy mô

- DỊCH VỤ

- định

- Chia sẻ

- So

- Phần mềm

- Giải pháp

- mùa xuân

- hỗ trợ

- Hỗ trợ

- Các cuộc đàm phán

- Công nghệ

- Công nghệ

- tensorflow

- Sáng kiến

- Hội thảo

- us

- Người sử dụng

- tuần

- ở trong

- Công việc

- năm

- Năng suất