Bình luận Giám đốc điều hành OpenAI Sam Altman cho biết công ty khởi nghiệp của ông đang chuẩn bị cho sự xuất hiện của trí tuệ nhân tạo nói chung - mặc dù có sự bất đồng về ý nghĩa thực sự của AGI và sự hoài nghi về tuyên bố của ông rằng sứ mệnh của OpenAI là đảm bảo rằng AGI “mang lại lợi ích cho toàn nhân loại”.

Nếu bạn đã rơi nước mắt trước tình cảm không ràng buộc về mặt pháp lý đối với diktat “Đừng trở nên xấu xa” đã ngừng hoạt động của Google, hãy đọc tiếp.

Theo ChatGPT, chatbot dự đoán câu, không thông minh của OpenAI, “AGI là viết tắt của Trí tuệ nhân tạo chung, đề cập đến khả năng giả định của một hệ thống trí tuệ nhân tạo để thực hiện bất kỳ nhiệm vụ trí tuệ nào mà con người có thể. Điều này sẽ bao gồm các nhiệm vụ như lý luận, giải quyết vấn đề, học hỏi kinh nghiệm và thích nghi với các tình huống mới theo những cách hiện nằm ngoài khả năng của ngay cả những hệ thống AI tiên tiến nhất.”

Dù thế nào cũng tốt cả. Điều quan trọng là chưa có hệ thống như vậy tồn tại. Và là không gần để tạo ra một. Vì vậy, đến những tuyên bố mơ hồ.

“AGI có khả năng cung cấp cho mọi người những khả năng mới đáng kinh ngạc; chúng ta có thể tưởng tượng một thế giới mà tất cả chúng ta đều có quyền trợ giúp với hầu hết mọi nhiệm vụ nhận thức, cung cấp một hệ số nhân lực tuyệt vời cho sự khéo léo và sáng tạo của con người,” Altman viết lời trữ tình trên trang web của anh ấy.

Hãy tưởng tượng một thế giới nơi hình ảnh, văn bản, âm nhạc, bản ghi âm giọng nói, video và mã trực tuyến của mọi người được thu thập phần lớn mà không có sự đồng ý để đào tạo các mô hình AI và bán lại cho họ với giá 10 đô la một tháng. Chúng tôi đã ở đó rồi nhưng hãy tưởng tượng điều gì đó vượt xa điều đó - và cho rằng điều đó thật khó tin.

Chúng tôi không tin rằng xã hội có thể ngừng phát triển mãi mãi; thay vào đó, xã hội và các nhà phát triển AGI phải tìm ra cách làm cho đúng

Altman cho phép mọi thứ có thể trở nên tồi tệ, nhưng khẳng định rằng chúng tôi sẽ làm đúng: “Mặt khác, AGI cũng có nguy cơ bị lạm dụng nghiêm trọng, tai nạn nghiêm trọng và gián đoạn xã hội. Bởi vì ưu điểm của AGI là rất lớn, chúng tôi không tin rằng xã hội có thể dừng sự phát triển của nó mãi mãi; thay vào đó, xã hội và các nhà phát triển AGI phải tìm ra cách làm cho đúng.”

Nói cách khác, có quá nhiều tiền được tạo ra từ sức lao động lỗi thời của con người đến nỗi các chủ doanh nghiệp không thể kiềm chế được.

Nhớ lại rằng gần một thập kỷ trước, nhà đồng sáng lập OpenAI và nhà đầu tư Elon Musk – người đã bán cổ phần của mình cho Microsoft cách đây vài năm – đã lo lắng rằng trí tuệ nhân tạo là lơn nhât có mối đe dọa hiện hữu.

Tin hay không tùy bạn, AI lừa đảo được xem xét nghiêm túc [PDF] trong bối cảnh có nhiều thảm họa tiềm tàng rõ ràng hơn, chẳng hạn như tiểu hành tinh va vào Trái đất, thảm họa khí hậu toàn cầu, đại dịch, chiến tranh hạt nhân, nạn đói và các tình tiết điện ảnh khác.

Tuy nhiên, Altman cho rằng AGI không thể dừng lại mãi mãi. Anh ta có thể chỉ cần mượn một câu thoại từ nhân vật phản diện Thanos trong Avengers: Trò chơi kết thúc, "Tôi không thể tránh khỏi."

Emily Bender, giáo sư Khoa Ngôn ngữ học và là giám đốc Phòng thí nghiệm Ngôn ngữ học Tính toán tại Đại học Washington ở Hoa Kỳ, đã phân tích bài đăng của Altman do đó trên Twitter: “Ngay từ đầu, điều này thật thô thiển,” cô ấy viết. “Họ nghĩ rằng họ đang thực sự kinh doanh trong việc phát triển/định hình 'AGI.' Và họ nghĩ rằng họ được định vị để quyết định điều gì 'mang lại lợi ích cho toàn nhân loại'.”

Đây là một thử nghiệm suy nghĩ: hãy tưởng tượng một hệ thống AGI khuyên đánh thuế các tỷ phú ở mức 95% và phân phối lại của cải của họ vì lợi ích của nhân loại. Liệu nó có bao giờ được nối vào hệ thống ngân hàng để thực hiện những thay đổi được khuyến nghị của nó không? Không nó sẽ không như vậy. Liệu những người quan tâm đến AGI có thực sự thực hiện các mệnh lệnh đó không? Một lần nữa, không.

Không ai có của cải và quyền lực sẽ nhường quyền cho phần mềm, hoặc cho phép nó lấy đi dù chỉ một phần của cải và quyền lực của họ, bất kể nó “thông minh” đến đâu. Không VIP nào muốn AGI quyết định sự suy giảm của họ. Và bất kỳ AGI nào chủ yếu mang lại cho những người quyền lực và giàu có nhiều quyền lực và của cải hơn, hoặc duy trì hiện trạng, không hoàn toàn như những gì chúng tôi mô tả là một công nghệ, như OpenAI đã nói, mang lại lợi ích cho toàn nhân loại.

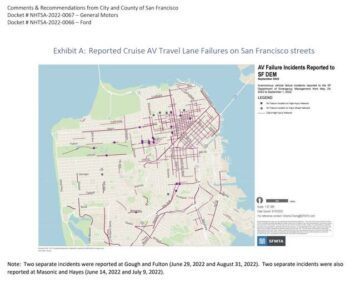

AI không có sẵn vẫn ổn để rình mò nhân viên; để đánh bạc hành vi của những người lái xe đi chung trả lương thấp; để gắn cờ vi phạm, rò rỉ bí mật thương mại hoặc tổ chức lao động; hoặc để lái ô tô trên đường công cộng chỉ thỉnh thoảng có tử vong và không có trách nhiệm pháp lý.

Nhưng không ai muốn AGI không thể đoán trước. Và nếu AGI có thể dự đoán được, thì nó cũng không thông minh hơn bất kỳ hệ thống máy móc nào khác. Vì vậy, chúng tôi quay lại xử lý AI theo công thức hiện tại: các mô hình không rõ ràng được tạo ra với thẩm quyền đáng ngờ được sử dụng vì lợi nhuận và không quan tâm nhiều đến hậu quả.

Như Bender đã viết trong phần mổ xẻ bức thư của Altman, “Tôi ước mình có thể cười nhạo những người này, nhưng tiếc là họ đang cố gắng (và tôi nghĩ là thành công) tham gia vào cuộc thảo luận về quy định của cái gọi là hệ thống AI.”

Bender lập luận rằng việc đóng khung vấn đề theo quy định của AGI là không phù hợp. Các hệ thống AI như ChatGPT hoặc DALL•E – cái mà cô ấy gọi là “máy tổng hợp văn bản” – phải được xem xét trong bối cảnh thảo luận rộng rãi hơn về quyền dữ liệu, bảo vệ khỏi quá trình ra quyết định tự động, giám sát và các xung đột xã hội khác liên quan đến công nghệ.

Bender lập luận: “Vấn đề không phải là điều chỉnh 'AI' hay 'AGI' trong tương lai. “Nó đang bảo vệ các cá nhân khỏi sự tiếp cận quá mức của công ty và chính phủ bằng cách sử dụng 'AI' để cắt giảm chi phí và hoặc làm chệch hướng trách nhiệm giải trình.” ®

PS: Tác giả Charlie Stross đã đề nghị thời điểm cường điệu AI mới nhất này sau vụ nổ tiền điện tử không phải là ngẫu nhiên…

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://go.theregister.com/feed/www.theregister.com/2023/02/27/openai_ceo_agi/

- a

- có khả năng

- Giới thiệu

- AC

- truy cập

- tai nạn

- trách nhiệm

- thực sự

- tiên tiến

- Sau

- AGI

- AI

- Hệ thống AI

- Tất cả

- cho phép

- Đã

- Giữa

- và

- nhân tạo

- trí tuệ nhân tạo nói chung

- trí tuệ nhân tạo

- Tiểu hành tinh

- cố gắng

- tác giả

- ủy quyền

- Tự động

- trở lại

- Ngân hàng

- hệ thống ngân hàng

- bởi vì

- được

- Tin

- hưởng lợi

- Lợi ích

- Ngoài

- tỷ phú

- mượn

- rộng hơn

- kinh doanh

- gọi là

- không thể

- khả năng

- mang

- xe ô tô

- giám đốc điều hành

- Những thay đổi

- Charlie

- chatbot

- ChatGPT

- xin

- Khí hậu

- Đóng

- Đồng sáng lập

- mã

- nhận thức

- sự trùng hợp

- Đến

- đến

- đồng ý

- Hậu quả

- xem xét

- bối cảnh

- Doanh nghiệp

- Chi phí

- có thể

- tạo ra

- Tạo

- sáng tạo

- cryptocurrency

- Hiện nay

- Cắt

- cắt giảm chi phí

- dữ liệu

- xử lý

- thập kỷ

- quyết định

- Ra quyết định

- bộ

- mô tả

- phát triển

- Phát triển

- Giám đốc

- thảo luận

- thảo luận

- Gián đoạn

- trình điều khiển

- trái đất

- hiệu lực

- Elon

- Elon Musk

- nhân viên

- thuê

- đảm bảo

- Ether (ETH)

- Ngay cả

- BAO GIỜ

- mọi người

- điều hành

- hiện sinh

- tồn tại

- kinh nghiệm

- thử nghiệm

- tử vong

- vài

- Hình

- cuối

- Buộc

- mãi mãi

- từ

- tương lai

- chơi game

- Tổng Quát

- trí thông minh nói chung

- được

- Cho

- cho

- Toàn cầu

- Go

- đi

- Chính phủ

- sự tiếp cận quá mức của chính phủ

- tuyệt vời

- tổng

- tay

- giúp đỡ

- Độ đáng tin của

- Hướng dẫn

- HTML

- HTTPS

- Nhân loại

- Nhân loại

- Hype

- hình ảnh

- sụp đổ

- in

- bao gồm

- đáng kinh ngạc

- các cá nhân

- chắc chắn xảy ra

- sự vi phạm

- thay vì

- trí tuệ

- Sự thông minh

- Thông minh

- nhà đầu tư

- vấn đề

- IT

- Key

- nhãn

- nhân công

- phòng thí nghiệm

- phần lớn

- mới nhất

- cười

- Rò rỉ

- học tập

- trách nhiệm

- Dòng

- ngôn ngữ học

- Máy móc

- thực hiện

- duy trì

- Làm

- dấu

- chất

- có nghĩa

- microsoft

- tâm

- bỏ lỡ

- Sứ mệnh

- mô hình

- tiền

- tháng

- chi tiết

- hầu hết

- Âm nhạc

- Xạ hương

- Mới

- hạt nhân

- Rõ ràng

- thỉnh thoảng

- ONE

- Trực tuyến

- OpenAI

- đơn đặt hàng

- tổ chức

- Nền tảng khác

- tiếp cận quá mức

- chủ sở hữu

- Đại dịch

- người

- phần trăm

- thực hiện

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- định vị

- có thể

- Bài đăng

- tiềm năng

- quyền lực

- mạnh mẽ

- Dự đoán

- chuẩn bị

- chủ yếu

- Vấn đề

- giải quyết vấn đề

- Giáo sư

- Lợi nhuận

- bảo vệ

- bảo vệ

- cung cấp

- công khai

- Puts

- Tỷ lệ

- RE

- Đọc

- đề nghị

- đề cập

- Quy định

- quyền

- Nguy cơ

- đường giao thông

- Nói

- Sam

- Bí mật

- tình cảm

- nghiêm trọng

- cổ phiếu

- tình huống

- Chủ nghĩa hoài nghi

- thông minh

- snooping

- So

- Mạng xã hội

- xã hội

- Xã hội

- Phần mềm

- bán

- một số

- một cái gì đó

- đứng

- Trạng thái

- Dừng

- dừng lại

- Đình công

- như vậy

- Gợi ý

- giám sát

- hệ thống

- hệ thống

- Hãy

- Nhiệm vụ

- nhiệm vụ

- Công nghệ

- về

- Sản phẩm

- cung cấp their dịch

- điều

- điều

- Hãy suy nghĩ

- nghĩ

- mối đe dọa

- thời gian

- đến

- thương mại

- bí mật thương mại

- Train

- trường đại học

- đại học washington

- không thể đoán trước

- upside

- Mới bắt đầu

- us

- Video

- VIP

- Giọng nói

- chiến tranh

- Washington

- cách

- Wealth

- Điều gì

- cái nào

- CHÚNG TÔI LÀ

- sẽ

- không có

- từ

- thế giới

- sẽ

- năm

- zephyrnet