Bài báo này đã được xuất bản như một phần của Blogathon Khoa học Dữ liệu.

Giới thiệu

Trong học sâu, các hàm kích hoạt là một trong những tham số cần thiết trong đào tạo và xây dựng mô hình học sâu giúp đưa ra dự đoán chính xác. Việc chọn chức năng kích hoạt phù hợp nhất có thể giúp một người nhận được kết quả tốt hơn với chất lượng dữ liệu giảm; do đó, các chức năng kích hoạt nên được quyết định theo đặc điểm và hành vi của chúng trên dữ liệu được cung cấp.

Bài viết này sẽ thảo luận về một trong những chức năng buộc tội nổi tiếng và được sử dụng nhiều nhất, sigmoid. Chúng tôi sẽ tính toán đạo hàm của nó để hiểu trực giác cốt lõi và cơ chế hoạt động đằng sau nó, đồng thời chúng tôi cũng sẽ thảo luận về các ứng dụng và ưu điểm của hàm kích hoạt.

Hãy lặn xuống ngay.

Hàm sigmoid

Hàm sigmoid là một trong những hàm kích hoạt được sử dụng nhiều nhất trong học máy và học sâu. Nó có thể được sử dụng trong các lớp ẩn, lớp này lấy đầu ra của lớp trước đó và mang các giá trị đầu vào từ 0 đến 1. Bây giờ trong khi làm việc với mạng thần kinh, cần tính đạo hàm của hàm kích hoạt.

Công thức của hàm kích hoạt sigmoid là:

F(x) = σ(x) = 1 ⁄ (1 + e-x)

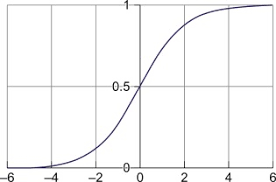

Đồ thị của hàm sigmoid trông giống như một đường cong S, trong đó một phần của hàm liên tục và vi phân tại bất kỳ điểm nào trong khu vực của nó.

Hàm sigmoid, còn được gọi là hàm nén, lấy đầu vào từ lớp ẩn trước đó và nén nó trong khoảng từ 0 đến 1. Vì vậy, giá trị được cung cấp cho hàm sẽ luôn trả về giá trị từ 0 đến 1, bất kể lớn hay nhỏ. thỏa thuận được cung cấp.

Về mặt đồ họa, hàm sigmoid trông như thế này,

Đạo hàm của hàm Siid

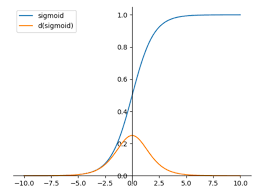

Trong các mạng thần kinh, các trọng số và độ lệch được chỉ định ngẫu nhiên trong các giai đoạn ban đầu, đồng thời trọng số và độ lệch được cập nhật trong quá trình lan truyền ngược trong mạng. Ở đây, trong khi thực hiện lan truyền ngược, các đạo hàm được tính toán. Ngoài ra, đạo hàm của hàm kích hoạt được tính toán. Hàm sigmoid là hàm kích hoạt duy nhất có hàm riêng trong đạo hàm của nó.

Hãy thử rút ra điều tương tự.

Công thức của Hàm Sigmoid:

σ(x) = 1/1 + e-x

Bước 1: Đạo hàm liên quan đến x ở cả hai vế.

σ(x)' = d/dx {1/(1 + e-x)}

Bước 2: Áp dụng quy tắc tương hỗ.

σ(x)' = d/dx ( (1/1 + ex)-1)

σ(x)' = – 1/(1 + e-x)2 d/dx (1+e-x)

σ(x)' = – 1/(1 + e-x)2 d/dx (e-x)

σ(x)' = – e-x / ( 1+ e-x)2 d/dx (-x)

σ(x)' = e-x / ( 1 + e-x )

Phương trình trên được gọi là đạo hàm của hàm sigmoid.

Biến đổi phương trình về dạng tổng quát hơn.

σ(x)' = e-x / ( 1 + e-x) ( 1+ e-x)

σ(x)' = 1/ 1 + e-x × e-x/1+e-x

σ(x)' = σ(x) × e-x/1+e-x

σ(x)' = σ(x) × ( 1 – 1/1+e-x)

σ(x)' = σ(x) ( 1- σ(x) )

Phương trình trên được gọi là dạng tổng quát của hàm sigmoid.

Mã để thực hiện chức năng Sigmund

Người ta phải viết đoạn mã sau để triển khai hàm sigmoid trong Python. Dưới đây yêu cầu giá trị của x được xác định trước để có được giao dịch sigmoid từ nó.

Mã Python:

Giả sử các trọng số đầu vào được đưa vào các lớp và các kết quả cũng như độ lệch được chuyển sang lớp tiếp theo. Nếu lớp đầu ra cuối cùng có chức năng sigmoid, nó sẽ được áp dụng cho đầu ra và kết quả cuối cùng sẽ được hiển thị.

Ví dụ,

Giả sử đầu ra từ lớp ẩn là 1; thì giá trị của x sẽ là 1.

Đầu ra cuối cùng:

= 1 / 1 + e-x

= 1 / 1 + e-1

= 1/7

= 1/1.367

= 0.7315

Như chúng ta có thể thấy ở đây, đầu ra từ lớp ẩn trước đó là 1 và hàm đã tạo ra nó là 0.7315, trong đó có thể thấy rằng Chức năng Sigmoid là một chức năng ép.

Các ứng dụng của hàm Sigmoid

1. Vấn đề phân loại nhị phân:

Chúng ta có thể sử dụng hàm sigmoid trong các bài toán phân loại nhị phân vì nó trả về đầu ra trong khoảng từ 0 đến 1.

2. Mô hình xác suất:

Chúng ta có thể sử dụng hàm sigmoid khi chúng ta được yêu cầu làm việc trên một mô hình xác suất vì nó có thể được sử dụng để tính xác suất của một lớp nhất định trong khoảng từ 0 đến 1.

3. Bộ dữ liệu hình ảnh và mạng nơ-ron:

Hàm sigmoid có thể được sử dụng cho các mạng thần kinh trên bộ dữ liệu hình ảnh để thực hiện các tác vụ như phân đoạn hình ảnh, phân loại, v.v.

Hạn chế của chức năng Sigmoid

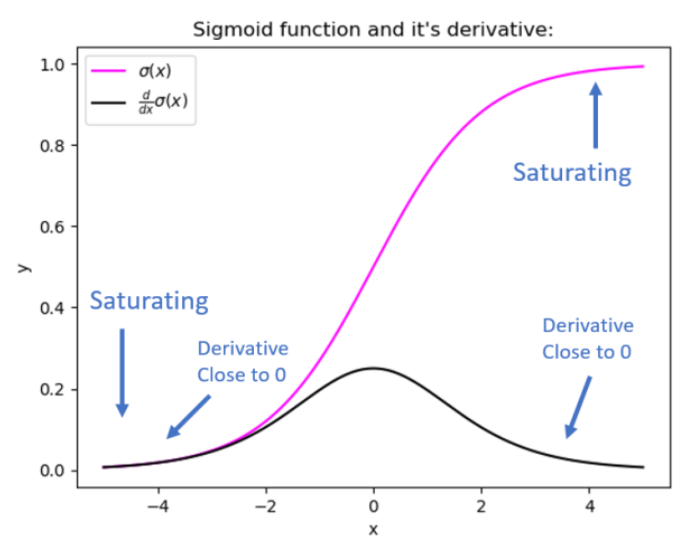

1. Vấn đề độ dốc biến mất:

Một trong những vấn đề quan trọng với sigmoid là thiếu cập nhật trọng lượng. Do đó, hàm đôi khi trả về các giá trị nhỏ làm đầu ra, không tạo ra thay đổi nào về trọng số và độ lệch gây ra sự cố độ dốc biến mất.

2. Vấn đề cấp độ bùng nổ:

Đôi khi cũng xảy ra trường hợp sigmoid trả về các giá trị rất lớn làm đầu ra, dẫn đến sự cố độ dốc bùng nổ.

3. Chức năng ép:

Đôi khi người ta lưu ý rằng vì sigmoid là một hàm ép, nó làm cho kết quả đầu ra nằm trong khoảng từ 0 đến 1, do đó che giấu bản chất hoặc kiến thức giữa các số cao hơn nhiều và nhỏ hơn nhiều và làm cho mô hình kém chính xác hơn.

Những câu hỏi thường gặp

1. Tại sao backpropagation có thể truy cập được vào hàm sigmoid?

Vì nó là hàm kích hoạt duy nhất xuất hiện trong đạo hàm của chính nó, nên nó giúp các mạng thần kinh thực hiện tốt hơn thuật toán lan truyền ngược, vì độ dốc gốc được sử dụng để cập nhật trọng số và độ lệch của mô hình.

2. Tại sao chức năng Kích hoạt Sigmoid lại là chức năng ép?

Khi hàm kích hoạt nén các giá trị đầu vào được cung cấp cho các lớp ẩn, hàm sẽ trả về đầu ra trong khoảng từ 0 đến 1. Vì vậy, bất kể số dương hay âm được cung cấp cho lớp như thế nào, hàm này sẽ nén nó trong khoảng từ 0 đến 1.

3. Vấn đề chính với chức năng sigmoid trong quá trình lan truyền ngược là gì?

Vấn đề chính liên quan đến chức năng kích hoạt là khi thuật toán giảm độ dốc tính toán các trọng số và độ lệch mới; nếu các giá trị này là tối thiểu, thì các bản cập nhật về hệ quả và tùy chọn cũng sẽ ít ỏi và do đó, dẫn đến vấn đề độ dốc biến mất, trong đó mô hình sẽ không dựa vào bất kỳ thứ gì.

Kết luận

Trong bài viết này, chúng ta đã thảo luận về hàm sigmoid và đạo hàm của nó, cơ chế hoạt động của nó và trực giác cốt lõi đằng sau cùng với các ứng dụng của nó cùng với các ưu điểm và nhược điểm. Biết những khái niệm chính này sẽ giúp một người hiểu rõ hơn về toán học đằng sau hàm số và sẽ giúp một người trả lời bất kỳ câu hỏi phỏng vấn liên quan nào một cách hiệu quả.

Một số Chìa khóa từ bài viết này là:

1. Hàm sigmoid là một hàm ép có kết quả từ đầu ra trong khoảng từ 0 đến 1.

2. Sigmoid có thể được sử dụng hiệu quả cho các bài toán phân loại nhị phân, vì nó trả về đầu ra trong khoảng từ 0 đến 1.

3. Hàm này đôi khi trả về các giá trị lớn hơn hoặc nhỏ hơn nhiều, dẫn đến các vấn đề về độ dốc biến mất hoặc bùng nổ.

Phương tiện hiển thị trong bài viết này không thuộc sở hữu của Analytics Vidhya và được sử dụng theo quyết định riêng của Tác giả.

Sản phẩm liên quan

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://www.analyticsvidhya.com/blog/2022/12/sigmoid-function-derivative-and-working-mechanism/

- 1

- a

- ở trên

- có thể truy cập

- Theo

- chính xác

- kích hoạt

- lợi thế

- thuật toán

- luôn luôn

- phân tích

- và

- trả lời

- các ứng dụng

- áp dụng

- Nộp đơn

- thích hợp

- KHU VỰC

- bài viết

- giao

- liên kết

- sau

- được

- phía dưới

- BEST

- Hơn

- giữa

- lớn

- Cả hai mặt

- mang lại

- Xây dựng

- tính

- tính toán

- Nguyên nhân

- Những thay đổi

- đặc điểm

- lựa chọn

- tốt nghiệp lớp XNUMX

- phân loại

- mã

- khái niệm

- Hậu quả

- liên tục

- Trung tâm

- đường cong

- dữ liệu

- bộ dữ liệu

- nhiều

- quyết định

- sâu

- học kĩ càng

- Derivatives

- tùy ý

- thảo luận

- thảo luận

- suốt trong

- hiệu quả

- bản chất

- thiết yếu

- vv

- Ether (ETH)

- ví dụ

- nổi tiếng

- Fed

- cuối cùng

- tiếp theo

- hình thức

- công thức

- từ

- chức năng

- chức năng

- được

- gif

- được

- gradients

- đồ thị

- xảy ra

- giúp đỡ

- giúp

- tại đây

- Thành viên ẩn danh

- cao hơn

- Độ đáng tin của

- HTTPS

- hình ảnh

- thực hiện

- in

- ban đầu

- đầu vào

- Phỏng vấn

- Câu hỏi phỏng vấn

- vấn đề

- các vấn đề

- IT

- chính nó

- Key

- Biết

- kiến thức

- nổi tiếng

- Thiếu sót

- lớn

- lớn hơn

- lớp

- học tập

- tìm kiếm

- NHÌN

- máy

- học máy

- thực hiện

- Chủ yếu

- LÀM CHO

- Làm

- toán học

- chất

- cơ chế

- Phương tiện truyền thông

- tối thiểu

- kiểu mẫu

- mô hình

- chi tiết

- hầu hết

- cần thiết

- tiêu cực

- mạng

- mạng

- mạng thần kinh

- Mới

- tiếp theo

- lưu ý

- số

- ONE

- riêng

- sở hữu

- thông số

- một phần

- thông qua

- thực hiện

- biểu diễn

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Điểm

- tích cực

- Dự đoán

- ưu đãi

- trước

- trước đây

- Vấn đề

- vấn đề

- cung cấp

- công bố

- Python

- chất lượng

- Câu hỏi

- Giảm

- liên quan

- đại diện

- cần phải

- kết quả

- kết quả

- Kết quả

- trở lại

- Trả về

- Quy tắc

- tương tự

- Khoa học

- nên

- thể hiện

- Sides

- có ý nghĩa

- nhỏ

- nhỏ hơn

- So

- giai đoạn

- Hãy

- mất

- nhiệm vụ

- Sản phẩm

- Fed

- cung cấp their dịch

- bằng cách ấy

- vì thế

- đến

- Hội thảo

- hiểu

- cập nhật

- Cập nhật

- cập nhật

- sử dụng

- giá trị

- Các giá trị

- có thể nhìn thấy

- trọng lượng

- Điều gì

- Là gì

- cái nào

- trong khi

- sẽ

- Công việc

- đang làm việc

- sẽ

- viết

- X

- zephyrnet