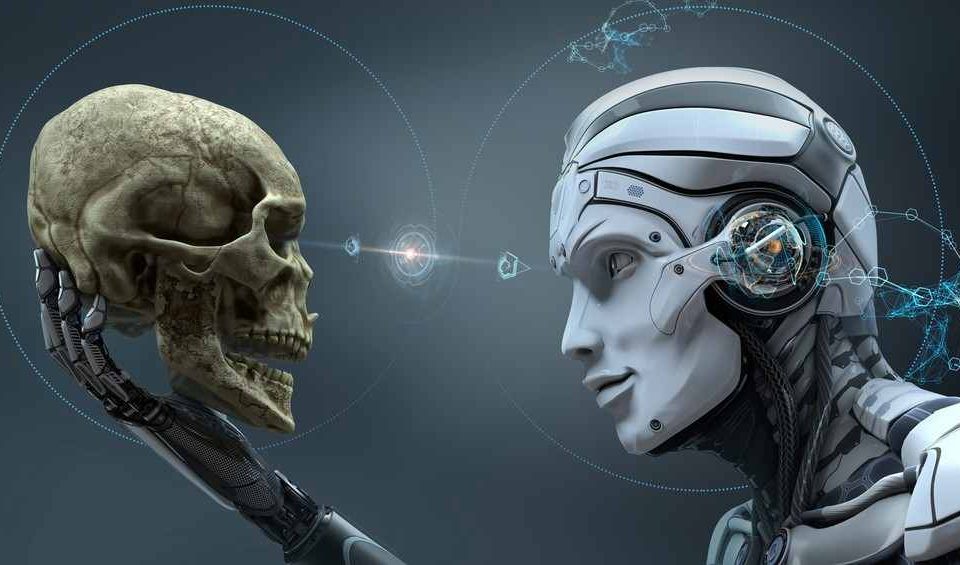

“记住我的话, 人工智能比核武器危险得多. 它吓坏了我。 这是特斯拉首席执行官埃隆·马斯克 (Elon Musk) 于 2018 年在得克萨斯州奥斯汀举行的西南偏南会议期间接受乔纳森·诺兰 (Jonathan Nolan) 采访时发表的声明。 不幸的是,穆斯并不孤单。 研究人员和其他知名专家也对人工智能 (AI) 的危险发出警告。 1 万英镑的问题是我们准备好了吗?我们的政府和政策规划者正在做什么来避免这种危险?

虽然最近流行的 ChatGPT 将 AI 带入了主流并吸引了许多人关注它的社会效益,但没有引起公众注意的是 AI 的阴暗面。 多年来,专业人士和技术工作者一直担心人工智能 (AI) 会夺走他们的工作。

然而,专家认为还有其他更严重的风险和危险需要关注,包括人工智能使用的不良数据导致的算法偏差、深度造假、侵犯隐私等等。 尽管这些危险给社会带来了严重的风险,但研究人员和科学家们更担心的是如何对 AI 进行编程来做一些更危险的事情:武器自动化。

如今,人工智能已被用于蜂群技术和巡航弹药的开发,也被称为神风敢死队无人机,就像那些 用于正在进行的俄乌战争. 与您在某些科幻电影中看到的未来机器人不同,这些无人机使用以前存在的军事平台,这些平台利用了新的人工智能技术。 这些无人机本质上已经成为被编程为杀戮的自主武器。

但是,使用 AI 技术在军事战斗中杀戮仅仅是个开始。 Michael Osborne 是牛津大学的人工智能教授和机器学习研究员。 他也是 Mind Foundry 的联合创始人。 当每个人都在为 ChatGPT 狂热时,Osborne 教授现在警告人工智能的风险,并预测先进的人工智能可能“对我们造成的风险与我们对其他物种造成的风险一样大:渡渡鸟就是一个例子。”

本月初,牛津大学的一组研究人员告诉英国议会的科学技术委员会,人工智能最终可能对人类构成“生存威胁”。 正如人类被渡渡鸟消灭一样,人工智能机器可能会消灭我们,他们说,伦敦时报 报道.

在会议期间, 奥斯本教授 警告英国议员,真正强大的人工智能可以杀死地球上的每一个人。 “人工智能与核武器一样危险,”他说。 奥斯本教授还补充说,风险不是人工智能不服从其编程,而是以意想不到的方式严格遵守它:

“举一个过于简单的例子,一个被告知要终结癌症的超级智能 AI 可能会发现最简单的方法是移除人类。 在接受调查时,大约三分之一的研究人员认为人工智能可能导致全球灾难。 人工智能安全计划是存在的,但企业和国家正在进行一场“军备竞赛”,这使得谨慎的做法变得困难。”

Osbborne 教授的同事、牛津大学的博士生 Michael Cohen 告诉伦敦时报:

“对于超人人工智能,存在一种特殊的风险,属于不同类型的风险,即……。 . . 它可以杀死所有人。”

虽然人工智能改善了我们的生活,但科学家们担心,由于人工智能缺乏人类道德,我们可能会为了方便而牺牲人性。 根据科恩的说法,一个可怕的场景是人工智能可以通过采用伤害人类的策略来学习实现帮助人类的指令。

“如果你想象用零食训练一只狗:它会学会选择导致它获得零食的动作,但如果狗找到了零食柜,它就可以自己得到零食而不用做我们想让它做的事情,”他解释道. “如果你有比我们更聪明的东西,偏执地试图获得这种积极的反馈,并且它接管了世界以确保这一点,它会投入尽可能多的能量来确保它对它的控制,这将使我们毫无办法为我们自己提供能量。”

Osborne 教授和 Michael Cohen 教授并不是仅有的两位对 AI 的风险和危险敲响警钟的研究人员。 许多其他与人工智能打交道的科学家也表达了类似的担忧。 《伦敦时报》称,2022 年 327 月对纽约大学 XNUMX 名研究人员进行的一项调查发现,三分之一的人认为人工智能可以在本世纪内带来核式末日。

许多与人工智能打交道的科学家似乎也有类似的担忧。 据伦敦时报报道,2022 年 327 月对纽约大学 XNUMX 名研究人员进行的一项调查发现,三分之一的人认为人工智能可能在本世纪内造成类似于核灾难的灾难。

36% 的研究人员表示:“人工智能或机器学习系统做出的决定可能会在本世纪引发一场至少与全面核战争一样糟糕的灾难。”

无论是一个世纪后,人工智能越来越变得过于聪明,正如一些专家所建议的那样,我们必须保持人类控制并开发诸如人工智能之类的机制 AI终止开关 控制 AI 能做什么和不能做什么。 当前缺乏监督和缺乏明确的全球人工智能政策为世界各国政府敲响了警钟。 我们需要立即采取行动,以免为时已晚。

[嵌入的内容]

下面是另一个关于人工智能危险的视频。 在视频中,以对人工智能的贡献而闻名的英国计算机科学家斯图尔特·罗素 (Stuart Russell) 就创建人工智能系统所涉及的风险发出警告。

[嵌入的内容]

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图区块链。 Web3 元宇宙智能。 知识放大。 访问这里。

- Sumber: https://techstartups.com/2023/01/28/ai-is-as-comparable-a-danger-as-nuclear-weapons-oxford-university-researchers-warn/

- 2018

- 2022

- 7

- a

- AI

- 关于我们

- AC

- 根据

- 操作

- 行动

- 添加

- 高级

- AI

- 人工智能系统

- AI供电

- 报警

- 算法

- 算法偏见

- 单

- 和

- 另一个

- 出现

- 方法

- 围绕

- 人造的

- 人工智能

- 人工智能(AI)

- 关注我们

- 奥斯汀

- 自主性

- 坏

- 不良数据

- 成为

- 成为

- before

- 开始

- 作为

- 相信

- 钟

- 好处

- 偏见

- 带来

- 英国的

- 带

- 企业

- 呼叫

- 被称为

- 呼叫

- 可以得到

- 癌症预防

- 不能

- 原因

- 造成

- 谨慎

- 世纪

- CEO

- ChatGPT

- 程

- 清除

- 联合创始人

- 同事

- 打击

- 委员会

- 可比

- 一台

- 关心

- 关注

- 研讨会 首页

- 内容

- 捐款

- 控制

- 方便

- 可以

- 国家

- 创建

- 电流

- 危险

- 危险的

- 危险

- 黑暗

- data

- 决定

- 深

- 深度假货

- 开发

- 发展

- 研发支持

- 不同

- 难

- 直接

- 灾害

- DODO

- 狗

- 做

- 无人机电调

- ,我们将参加

- 地球

- 最简单的

- 消除

- 伊隆

- 伊隆麝香

- 嵌入式

- 能源

- 从事

- 本质

- 醚(ETH)

- 甚至

- 终于

- 每个人

- 例子

- 现有

- 专家

- 专家认为

- 解释

- 表示

- 恐惧

- 反馈

- 找到最适合您的地方

- 发现

- 发现

- 铸造厂

- 止

- 未来

- 获得

- 总类

- 普通市民

- 得到

- 越来越

- 给

- 全球

- 各国政府

- 团队

- 举行

- 创新中心

- HTTPS

- 人

- 人类

- 人类

- 势在必行

- 改善

- in

- 包含

- 日益

- 疯

- 房源搜索

- 专属采访

- 参与

- IT

- 本身

- 工作机会

- 杀

- 已知

- 缺乏

- 晚了

- 铅

- 学习用品

- 学习

- 离开

- 杠杆作用

- 生活

- 伦敦

- 机

- 机器学习

- 机

- 制成

- 主流

- 使

- 许多

- 会议

- 方法

- Michael (中国)

- 可能

- 军工

- 介意

- 月

- 道德

- 更多

- 电影

- 麝香

- 需求

- 全新

- 纽约

- 纽约大学

- 核

- 核武器

- 一

- 正在进行

- 其他名称

- 疏忽

- 牛津

- 牛津大学

- 议会

- 特别

- 挑

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 政策

- 声望

- 积极

- 强大

- 准备

- 先前

- 隐私

- 专业人士

- 教授

- 程序

- 代码编程

- 训练课程

- 国家

- 题

- 最近

- 删除

- 闻名

- 报道

- 研究员

- 研究人员

- 风险

- 风险

- 机器人

- 牺牲

- 实现安全

- 说

- 清酒

- 科幻

- 科学

- 科学与技术

- 科学家

- 科学家

- 安全

- 保障

- 九月

- 严重

- 共用的,

- 类似

- 智能

- 聪明

- 社会的

- 社会

- 一些

- 东西

- 南部

- 个人陈述

- 学生

- 这样

- 超人

- 调查

- Switch 开关

- 产品

- 策略

- 采取

- 服用

- 科技

- 技术

- 专业技术

- 德州

- 世界

- 其

- 第三

- 时

- 至

- 也有

- 产品培训

- 治疗

- 对待

- 大学

- us

- 使用

- 视频

- 违反

- 通缉

- 战争

- 警告

- 警告

- 方法

- 武器

- 什么是

- 这

- 而

- WHO

- 将

- 中

- 也完全不需要

- 话

- 工作

- 工人

- 世界

- 担心

- 将

- 年

- YouTube的

- 和风网