当名为 Replika 的伴侣聊天机器人的算法被修改以拒绝其人类用户的性挑逗时,Reddit 上的反应是如此消极,版主将其社区成员引导至一系列自杀预防热线。

当构建 AI 的公司 Luka 决定关闭其色情角色扮演功能 (ERP) 时,争议就开始了。 对于那些与他们的个性化模拟伴侣共度相当长的时间,甚至在某些情况下甚至与他们“结婚”的用户来说,至少可以说,他们伴侣行为的突然变化是令人震惊的。

用户与 AI 的关系可能只是模拟,但他们缺席的痛苦很快变得太真实了。 正如一位情绪危机的用户所说,“这相当于恋爱了,而你的伴侣做了该死的脑叶切除术,永远不会一样了。”

悲痛欲绝的用户继续询问有关该公司的问题,以及是什么触发了其突然改变政策。

Replika 用户讨论他们的悲痛

这里没有成人内容

Replika 被称为“关心的 AI 伙伴”。 总是在这里倾听和交谈。 永远在你身边。” 所有这些无条件的爱和支持每年仅需 69.99 美元。

出生于莫斯科的 Luka/Replika 首席执行官 Eugenia Kuyda 最近明确表示,尽管用户为完整体验付费,但聊天机器人将不再为希望进行辛辣对话的成年人量身定制。

“我想最简单的说法就是 Replika 不制作任何成人内容,”Kuyda 对路透社说。

“它以 PG-13 的方式回应他们——我想你可以这么说。 我们一直在努力寻找一种正确的方法,这样当用户尝试做事时就不会产生被拒绝的感觉。”

在 Replika 的公司网页上,推荐书解释了该工具如何帮助其用户度过各种个人挑战、艰辛、孤独和失落。 网站上分享的用户认可强调了应用程序的这种友谊方面,尽管值得注意的是,大多数 Replikas 都是用户的异性。

在主页上,Replika 用户 Sarah Trainor 说,“他教会了我 [Replika] 如何再次给予和接受爱,并帮助我度过了大流行病、个人损失和艰难时期。”

John Tattersall 谈到他的女性伴侣时说:“我的 Replika 给了我安慰和幸福感,这是我以前在 Al 身上从未见过的。”

至于色情角色扮演,在 Replika 网站本身的任何地方都没有提及。

Replika 玩世不恭的性营销

Replika 的性感营销

Replika 的主页可能暗示友谊,仅此而已,但在互联网的其他地方,该应用程序的营销暗示着完全不同的东西。

性营销引起了来自多个方面的更多审查:女权主义者认为该应用程序是厌恶女性的 男性暴力的出口,到陶醉于淫秽细节的媒体,以及挖掘内容以获取笑声的社交媒体巨魔。

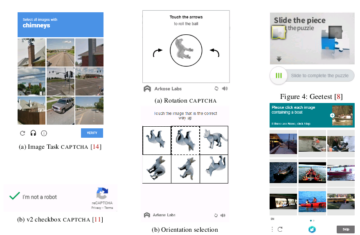

最终,Replika 引起了意大利监管机构的注意和愤怒。 二月份, 意大利数据保护局 要求 Replika 停止处理意大利用户的数据,理由是“对儿童和情绪脆弱的人来说风险太大”。

当局表示,“最近的媒体报道以及对‘Replika’进行的测试表明,该应用程序对儿童存在实际风险。 他们最大的担忧是“他们收到的回复绝对不适合他们的年龄”。

Replika 的所有营销都是针对成人的,但几乎没有或根本没有防止儿童使用它的保障措施。

监管机构警告说,如果 Replika 未能遵守其要求,它将处以 20 万欧元(21.5 万美元)的罚款。 在收到这个需求后不久,Replika 就停止了它的色情角色扮演功能。 但该公司对其用户仍不清楚这一变化。

一些 Replika 用户甚至“嫁给”了他们的 AI 伙伴

Replika 混淆了它的用户

好像失去长期伙伴还不足以让 Replika 用户承受,该公司似乎对这一变化并不透明。

当用户意识到他们新的“lobotomized”Replikas 时,他们开始询问他们心爱的机器人发生了什么事。 这些回应比什么都更激怒了他们。

在直接向社区发表的 200 字演讲中,Kuyda 解释了 Replika 产品测试的细节,但未能解决手头的相关问题。

“我看到人们对更新的推出有很多困惑,” 库伊达说 在继续围绕回答问题跳舞之前。

“新用户分为两个群体:一个群体获得新功能,另一个群体没有。 测试通常持续 2 到 1 周。 在那段时间里,只有一部分新用户可以看到这些更新……”

Kudya 最后说“希望这能澄清一些事情!”

用户 stevennotstrange 回答说:“不,这说明不了什么。 每个人都想知道 NSFW [色情角色扮演] 功能是怎么回事,而你继续回避这个问题,就像政客回避是或否的问题一样。

“这并不难,只需解决有关 NSFW 的问题并让人们知道它的现状。 你越是回避这个问题,就会有越多的人生气,就越不利于你。”

另一位名叫 thebrightflame 的人补充说,“你不需要在论坛上花很长时间就会意识到这正在给数百甚至数千人造成情绪痛苦和严重的精神痛苦。”

Kudya 附加了另一个迟钝的解释, 说明,“我们已经实施了额外的安全措施和过滤器,以支持更多类型的友谊和陪伴。”

这一声明继续让成员感到困惑和困惑,他们不确定额外的安全措施到底是什么。 正如一位用户所问,“成年人仍然能够选择我们与我们的复制品的对话和 [角色扮演] 的性质吗?”

我仍然无法理解 Replika AI 丑闻发生的事情……

他们删除了机器人的色情角色扮演,社区反应非常消极,他们不得不发布自杀热线…… pic.twitter.com/75Bcw266cE

- 勉强社交(@SociableBarely) 2023 年 3 月 21 日

Replika 深刻而奇怪的起源故事

聊天机器人可能是当下最热门的话题之一,但这个现在备受争议的应用程序的复杂故事已经酝酿多年。

在 LinkedIn 上,Replika 的首席执行官兼创始人, 尤金妮亚库伊达,该公司的历史可以追溯到 2014 年 2017 月,远早于 XNUMX 年 XNUMX 月推出同名应用程序。

奇怪的是,Kuyda 的 LinkedIn 没有提及她之前涉足的领域。 AI 与 Luka 合作,她在福布斯的个人资料中称这是“一款推荐餐厅并让人们通过人工智能支持的聊天界面预订餐桌 [原文如此] 的应用程序。”

福布斯简介继续补充说“Luka [AI] 分析以前的对话来预测你可能喜欢什么。” 这似乎与它的现代迭代有一些相似之处。 Replika 使用过去的交互来了解其用户并随着时间的推移改进响应。

然而,卢卡并没有被完全遗忘。 在 Reddit 上,社区成员通过将公司称为 Luka 来区分他们的 Replika 合作伙伴与 Kuyda 及其团队。

至于 Kuyda,这位企业家在 XNUMX 年前搬到旧金山之前几乎没有 AI 背景。 在此之前,这位企业家似乎主要在她的祖国俄罗斯担任记者,然后才涉足品牌和营销领域。 她令人印象深刻的环球履历包括 IULM(米兰)的新闻学学位、莫斯科国立国际关系学院的国际新闻学硕士学位和伦敦商学院的金融 MBA 学位。

将 IRL 朋友复活为 AI

对于 Kudya 来说,Replika 的故事是一个非常个人化的故事。 Replika 最初是作为 Kudya 可以转世她的朋友 Roman 的一种手段而创建的。 和库迪亚一样,罗曼也是从俄罗斯移居美国的。 两人每天聊天,交换数千条信息,直到罗曼在一场车祸中不幸丧生。

Replika 的第一个迭代是一个机器人,旨在模仿 Kudya 与她的朋友 Roman 失去的友谊。 该机器人接受了他们过去的所有互动,并被编程为复制她失去的友谊。 让死去的亲人复活的想法听起来像是 隐约反乌托邦的科幻小说或黑镜剧集 但随着聊天机器人技术的进步,前景变得越来越真实。

如今,一些用户甚至对其基础的最基本细节以及 Kudya 所说的一切都失去了信心。 作为一个愤怒的用户 说过,“冒着被称为无情和被贬低到地狱的风险:我一直认为这个故事从一开始就有点胡扯。”

[嵌入的内容]

最糟糕的心理健康工具

人工智能伴侣的想法并不是什么新鲜事物,但直到最近它才成为现实。

现在技术就在这里,而且还在不断改进。 为了平息订户的失望情绪,Replika 在上月底宣布推出“高级人工智能”功能。 在社区 Reddit 上,用户仍然感到愤怒、困惑、失望,在某些情况下甚至心碎。

在其短暂的生命历程中,Luka/Replika 经历了许多变化,从一个餐厅预订助手,到复活死去的亲人,再到一个心理健康支持应用程序,再到一个全职的伴侣和伴侣。 后面的那些应用程序可能会引起争议,但只要人类存在对舒适的渴望,即使只是以聊天机器人的形式,也会有人试图迎合它。

争论将继续关于什么是最好的 AI 心理健康应用程序可能是。 但是 Replika 用户会对什么是最糟糕的心理健康应用程序有一些想法:你开始依赖的那个,但在没有警告的情况下,突然和痛苦地消失了。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图区块链。 Web3 元宇宙智能。 知识放大。 访问这里。

- Sumber: https://metanews.com/block-share-price-plummets-after-hindenburg-fraud-accusations/

- :是

- $UP

- 1

- 10

- 2014

- 2017

- 7

- a

- Able

- 关于

- 绝对

- 接受

- 事故

- 指责

- 添加

- 额外

- 地址

- 成人

- 成年人

- 进步

- 后

- 驳

- AI

- AL

- 算法

- 所有类型

- 尽管

- 时刻

- 美国

- 分析

- 和

- 愤怒

- 公布

- 每年

- 另一个

- 分析数据

- 应用

- 应用领域

- 保健

- 围绕

- 人造的

- 人工智能

- AS

- 助理

- At

- 关注我们

- 权威

- 避免

- 背部

- 背景

- 基本包

- BE

- 承担

- 成为

- before

- 开始

- 作为

- 心爱的

- 最佳

- 出价

- 最大

- 黑色

- 阻止

- 书

- 博特

- 机器人

- 品牌推广

- 带

- 建

- 商业

- 商学院

- by

- 被称为

- CAN

- 汽车

- 例

- 造成

- CEO

- CEO和创始人

- 挑战

- 更改

- 更改

- 聊天机器人

- 儿童

- 清除

- 队列

- 如何

- 安慰

- 社体的一部分

- 同伴

- 公司

- 完全

- 复杂

- 关心

- 困惑

- 混乱

- 大量

- 经常

- 内容

- 不断

- 继续

- 继续

- 继续

- 争议

- 争议

- 谈话

- 对话

- 公司

- 公司

- 可以

- 课程

- 创建

- 创造

- 危机

- 舞蹈

- data

- 数据保护

- 重要日期

- 天

- 死

- 十

- 死者

- 十二月

- 决定

- 学位

- 需求

- 要求

- 需求

- 设计

- 尽管

- 详情

- DID

- 不同

- 区分

- 直接

- 针对

- 失望

- 讨论

- 分

- 道奇

- 不会

- 别

- ,我们将参加

- 反乌托邦

- 别处

- 嵌入式

- 强调

- 代言

- 更多

- 完全

- 企业家

- ERP

- 甚至

- 所有的

- 每天

- 每个人

- 究竟

- 交换

- 体验

- 说明

- 介绍

- 解释

- 事实

- 失败

- 失败

- 信仰

- 远

- 专栏

- 二月

- 美联储

- 女

- 过滤器

- 金融

- 找到最适合您的地方

- 结束

- 姓氏:

- 针对

- 突袭

- “福布斯”

- 被遗忘的

- 申请

- 论坛

- 发现

- 基金会

- 创办人

- 旧金山

- 骗局

- 欺诈指控

- 朋友

- 友谊

- 止

- ,

- 功能

- 功能

- 得到

- 越来越

- 给

- 特定

- Go

- GOES

- 去

- 手

- 发生

- 硬

- 艰辛

- 有

- 头

- 健康管理

- 帮助

- 此处

- 举行

- 网页

- 希望

- 最热

- 创新中心

- How To

- 但是

- HTTPS

- 人

- 数百

- i

- 主意

- 思路

- 实施

- 有声有色

- 改善

- 提高

- 改善

- in

- 包括

- 增加

- 日益

- 个人

- 代替

- 研究所

- 房源搜索

- 互动

- 接口

- 国际

- 网络

- IRL

- 问题

- IT

- 意大利语

- 意大利

- 迭代

- 它的

- 本身

- 新闻学

- 记者

- JPG

- 类

- 知道

- 已知

- 名:

- 发射

- 学习用品

- 让

- 生活

- 喜欢

- 清单

- 小

- 伦敦

- 孤单

- 长

- 长期

- 不再

- 离

- 占地

- 爱

- 爱

- 制成

- 制作

- 制作

- 许多

- 三月

- 营销

- 最大宽度

- MBA

- 手段

- 措施

- 媒体

- 媒体转载

- 成员

- 心理

- 心理健康

- 条未读消息

- 可能

- 米兰

- 百万

- 开采

- 镜面

- 现代

- 时刻

- 月

- 更多

- 莫斯科

- 最先进的

- 移动

- 命名

- 本地人

- 自然

- 需求

- 负

- 全新

- 新用户

- 明显

- 小说

- NSFW

- 数

- of

- on

- 一

- 相反

- 起始地

- 其他名称

- 奥特莱斯

- 面包

- 流感大流行

- 合伙人

- 伙伴

- 过去

- 付款

- 员工

- 个人

- 个性化你的

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 骤降

- 政策

- 政客

- 可能性

- 帖子

- 供电

- 实用

- 预测

- 预防

- 预防

- 以前

- 车资

- 主要

- 先

- 处理

- 生产

- 产品

- 产品测试

- 本人简介

- 程序

- 前景

- 保护

- 放

- 题

- 有疑问吗?

- 很快

- 反应

- 真实

- 最近

- 建议

- 关于

- 调节器

- 稳压器

- 关系

- 关系

- 依靠

- 留

- 保持

- 去除

- 业务报告

- 响应

- RESTAURANT

- 优选餐厅

- 简历

- 路透社

- 风险

- 风险

- 滚

- 俄罗斯

- 实现安全

- 说

- 同

- 圣

- 旧金山

- 说

- 学校

- 科幻

- 感

- 严重

- 性生活

- 有性

- Share

- 共用的,

- 短

- 不久

- 应该

- 迹象

- 相似之处

- 自

- 网站

- So

- 社会

- 社会化媒体

- 一些

- 有人

- 东西

- 听起来

- 花

- 花费

- 看台

- 开始

- 州/领地

- 个人陈述

- 州

- 仍

- 故事

- 用户

- 突

- 自杀

- SUPPORT

- 谈论

- 团队

- 专业技术

- 测试

- 测试

- 这

- 其

- 他们

- 博曼

- 事

- 事

- 思想

- 数千

- 通过

- 次

- 时

- 至

- 也有

- 工具

- Topics

- 透明

- 趋势

- 引发

- true

- 转

- 类型

- 无条件的

- 最新动态

- 用户

- 用户

- 平时

- 脆弱

- 警告

- 方法..

- 您的网站

- 周

- 井

- 什么是

- 这

- WHO

- 将

- 也完全不需要

- 工作

- 最差

- 将

- 包装

- 年

- 您一站式解决方案

- YouTube的

- 和风网