图片作者

最近,我们都很难赶上 LLM 领域的最新版本。 在过去的几周里,一些开源的 ChatGPT 替代品变得流行起来。

在这篇文章中,我们将了解 聊天GLM 系列, 聊天GLM-6B,一种开源且轻量级的 ChatGPT 替代方案。

我们走吧!

中国清华大学的研究人员致力于开发 ChatGLM 系列模型,其性能可与 GPT-3 和 BLOOM 等其他模型相媲美。

ChatGLM 是一种双语大型语言模型,在中文和英文上都进行了训练。 目前有以下型号可供选择:

- ChatGLM-130B:开源 LLM

- ChatGLM-100B:不是开源的,但只能通过受邀访问获得

- ChatGLM-6B:轻量级开源替代品

尽管这些模型可能看起来类似于大型语言模型的生成预训练转换器 (GPT),但 通用语言模型 (GLM) 预训练框架 是什么让他们与众不同。 我们将在下一节中了解更多相关信息。

在机器学习中,您会知道 GLM 是 广义线性模型, 但 ChatGLM 中的 GLM 代表 通用语言模型.

GLM 预训练框架

LLM 预训练已经被广泛研究,并且仍然是一个活跃的研究领域。 让我们尝试了解 GLM 预训练和 GPT 样式模型之间的主要区别。

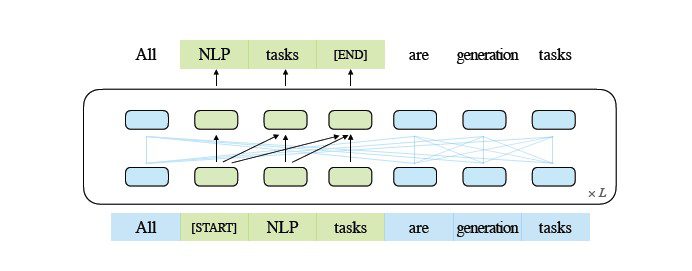

GPT-3 系列模型使用仅解码器的自回归语言建模。 另一方面,在 GLM 中,目标的优化被表述为 自回归空白填充问题.

GLM | 图片来源

简单来说, 自回归空白填充 涉及消隐一段连续的文本,然后按顺序重建这个消隐的文本。 除了较短的掩码外,还有一种较长的掩码可以随机删除句子末尾的长文本空白。 这样做是为了让模型在自然语言理解和生成任务中表现得相当好。

另一个区别在于所使用的注意力类型。 大型语言模型的 GPT 组使用单向注意力,而 LLM 的 GLM 组使用 双向注意. 在未屏蔽的上下文上使用双向注意力可以更好地捕获依赖关系,并可以提高自然语言理解任务的性能。

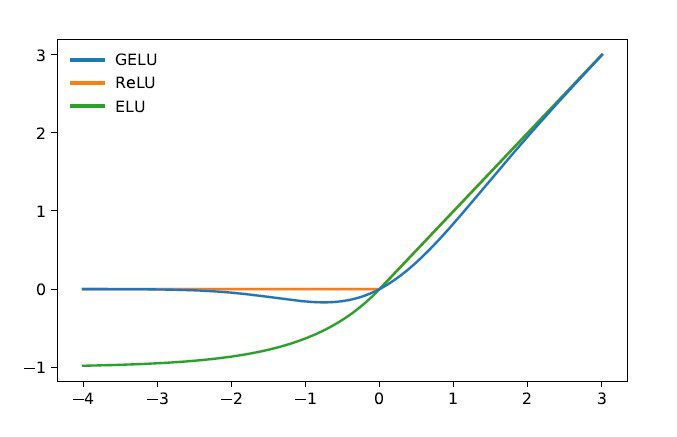

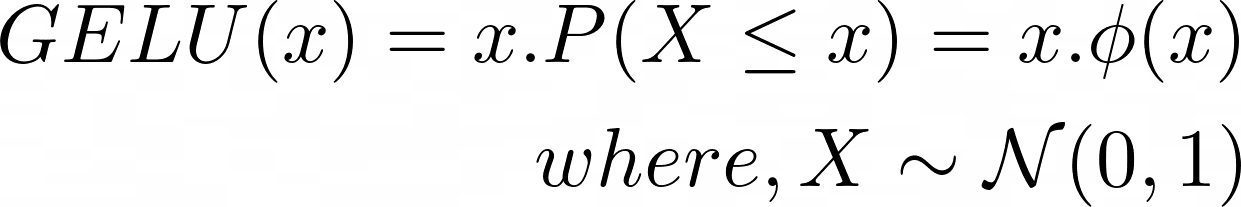

格鲁激活

在 GLM 中,使用 GELU(高斯误差线性单元)激活代替 ReLU 激活 [1]。

GELU、ReLU 和 ELU 激活 | 图片来源

GELU 激活并且所有输入都具有非零值,并且具有以下形式 [3]:

与 ReLU 激活相比,GELU 激活被发现可以提高性能,尽管在计算上比 ReLU 更密集。

在LLM的GLM系列中,ChatGLM-130B是开源的,性能与GPT-3的达芬奇模型一样好。 如前所述,在撰写本文时,有一个 ChatGLM-100B 版本,仅限受邀访问。

聊天GLM-6B

以下有关 ChatGLM-6B 的详细信息,以使其更易于最终用户使用:

- 有大约6.2亿个参数。

- 该模型在 1 万亿个标记上进行了预训练——同样来自英语和汉语。

- 随后,使用了监督微调和带有人类反馈的强化学习等技术。

让我们通过回顾 ChatGLM 的优点和局限性来结束我们的讨论:

优势

从双语模型到可以在本地运行的开源模型,ChatGLM-6B 具有以下优势:

- 大多数主流的大型语言模型都是在大型英语文本语料库上训练的,其他语言的大型语言模型并不常见。 ChatGLM 系列的 LLM 是双语的,是中国人的绝佳选择。 该模型在英文和中文中都有很好的表现。

- ChatGLM-6B 针对用户设备进行了优化。 最终用户的设备上的计算资源通常有限,因此在没有访问高性能 GPU 的情况下,几乎不可能在本地运行 LLM。 和 INT4量化, ChatGLM-6B 可以在低至 6GB 的适度内存要求下运行。

- 在各种任务上表现出色,包括摘要以及单查询和多查询聊天。

- 尽管与其他主流 LLM 相比参数数量少得多,但 ChatGLM-6B 支持高达 2048 的上下文长度。

限制

接下来,我们来列举一下ChatGLM-6B的几个局限性:

- 虽然 ChatGLM 是一个双语模型,但它在英语方面的表现可能并不理想。 这可以归因于培训中使用的说明大多是中文的。

- 因为 ChatGLM-6B 有很大的 更少的参数 与 BLOOM、GPT-3 和 ChatGLM-130B 等其他 LLM 相比,当上下文太长时,性能可能会更差。 因此,ChatGLM-6B 可能比具有更多参数的模型更频繁地提供不准确的信息。

- 小语言模型有 内存容量有限. 因此,在多轮聊天中,模型的性能可能会略有下降。

- 偏见、错误信息和毒性是所有 LLM 的局限性,ChatGLM 也容易受到这些影响。

下一步,在本地运行 ChatGLM-6B 或在 HuggingFace 空间上试用演示。 如果您想更深入地研究 LLM 的工作,这里有一份清单 大型语言模型免费课程.

[1] Z Du, Y Qian 等, GLM:具有自回归空白填充的通用语言模型预训练,ACL 2022

[2] 阿政, X Liu 等, GLM-130B – 一个开放的双语预训练模型,ICML 2023

[3] D 亨德里克斯,K 金佩尔, 高斯误差线性单位 (GELU), arXiv, 2016

[4] ChatGLM-6B:HuggingFace 空间演示

[5] GitHub回购

巴拉普里亚 C 是一位喜欢创作长篇内容的技术作家。 她感兴趣的领域包括数学、编程和数据科学。 她通过编写教程、操作指南等与开发人员社区分享她的学习成果。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图爱流。 Web3 数据智能。 知识放大。 访问这里。

- 与 Adryenn Ashley 一起铸造未来。 访问这里。

- Sumber: https://www.kdnuggets.com/2023/04/chatglm6b-lightweight-opensource-chatgpt-alternative.html?utm_source=rss&utm_medium=rss&utm_campaign=chatglm-6b-a-lightweight-open-source-chatgpt-alternative

- :具有

- :是

- :不是

- $UP

- 1

- a

- 关于我们

- ACCESS

- 无障碍

- 活化

- 激活

- 要积极。

- 增加

- 优点

- AL

- 所有类型

- 替代

- 替代品

- an

- 和

- 保健

- 国家 / 地区

- 地区

- 刊文

- AS

- At

- 关注我们

- 创作

- 汽车

- 可使用

- BE

- 成为

- 成为

- 很

- 作为

- 更好

- 之间

- 亿

- Bloom

- 都

- 但是

- by

- CAN

- 捕获

- ChatGPT

- 中国

- 中文

- 选择

- 相当常见

- 社体的一部分

- 可比

- 相比

- 计算

- 内容

- 上下文

- 上下文

- 连续

- 课程

- 创造

- 目前

- data

- 数据科学

- 更深

- 演示

- 详情

- 开发商

- 发展

- 设备

- 差异

- 差异

- 不同

- 讨论

- 完成

- Ë&T

- 结束

- 英语

- 错误

- 家庭

- 反馈

- 少数

- 少

- 以下

- 针对

- 申请

- 发现

- 止

- 总类

- 代

- 生成的

- 得到

- 给

- 去

- 非常好

- 图形处理器

- 大

- 团队

- 指南

- 手

- 硬

- 有

- 有

- 这里

- 点击此处

- 高性能

- HTML

- HTTPS

- 拥抱脸

- 人

- if

- 不可能

- 改善

- in

- 不准确

- 包括

- 包含

- 信息

- 代替

- 说明

- 兴趣

- 成

- 涉及

- IT

- 它的

- JPG

- 掘金队

- 键

- 知道

- 语言

- 语言

- 大

- 大

- 名:

- 最新

- 学习用品

- 学习

- 长度

- 轻巧

- 喜欢

- 容易

- 限制

- 有限

- 清单

- 当地

- 长

- 不再

- 低

- 机

- 机器学习

- 主流

- 使

- 制作

- 面膜

- 面膜

- 数学

- 可能..

- 内存

- 提到

- 误传

- 模型

- 造型

- 模型

- 更多

- 自然

- 自然语言

- 自然语言理解

- 下页

- 数

- Nvidia公司

- 目标

- of

- 经常

- on

- 打开

- 开放源码

- 优化

- 优化

- or

- 其他名称

- 我们的

- 输出

- 超过

- 参数

- 性能

- 施行

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 热门

- 预

- 代码编程

- 强化学习

- 发布

- 需求

- 研究

- 资源

- 受限

- 导致

- 运行

- s

- 科学

- 部分

- 系列

- 几个

- 分享

- 她

- 类似

- 简易

- 单

- 小

- So

- 太空

- 剩余名额

- 跨度

- 看台

- 步

- 仍

- 研究

- 这样

- 超级

- 支持

- 易感

- 任务

- 文案

- 技术

- 条款

- 比

- 这

- 其

- 他们

- 然后

- 那里。

- 因此

- 博曼

- Free Introduction

- 通过

- 次

- 至

- 也有

- 熟练

- 产品培训

- 兆

- 清华

- 教程

- 类型

- 理解

- 理解

- 单位

- 大学

- 使用

- 用过的

- 用户

- 用户

- 运用

- 价值观

- 各种

- 版本

- 周

- 井

- 什么是

- ,尤其是

- 这

- WHO

- 工作

- 加工

- 更坏

- 包装

- 作家

- 写作

- X

- 您

- 和风网