今年我没能去蓬塔卡纳  但我很高兴(远程)为那些不顾所有旅行限制而设法到达那里的人! 里面的优质内容。

但我很高兴(远程)为那些不顾所有旅行限制而设法到达那里的人! 里面的优质内容。

秋天很忙,我想尝试一个更短的格式:每个大话题都有一个“焦点”  在我觉得特别有趣的主块中工作,以及一些描述较短的相关作品。

在我觉得特别有趣的主块中工作,以及一些描述较短的相关作品。

今天的计划:

如果这些深入的教育内容对您有用, 订阅我们的AI研究邮件列表 当我们发布新材料时被提醒。

KG 增强语言模型:分类

上下文语言模型中的关系世界知识表示:综述 塔拉·萨法维和达奈·库特拉

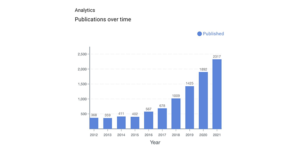

如果您是此类摘要(或以前的帖子)的经验丰富的读者,那么您非常清楚每次会议上都会发布大量 KG 增强 LM,并每周上传到 arxiv。 如果你感到迷失  ——我可以保证你不是唯一一个。

——我可以保证你不是唯一一个。

今年,我们终于有了 健全的框架 和各种 KG+LM 方法的分类! 作者定义了 3 个大家族: 1⃣ 无 KG 监督,用完形填空提示探索 LM 参数中编码的知识; 2⃣ 实体和ID的KG监督; 3⃣ 使用关系模板和表面形式的KG监督。

每个家庭都有几个分支  例如,让我们看一下下图所示的 4 个实体感知模型。 不同于 “不那么具有象征意义” 至 “更具象征意义”,一些 LM 执行提及跨度掩蔽,或对比学习,或从已知词汇表中融合实体嵌入。 作者根据框架对数十种现有架构进行了出色的分类,现在看起来组织得更好了。 非常需要的工作!

例如,让我们看一下下图所示的 4 个实体感知模型。 不同于 “不那么具有象征意义” 至 “更具象征意义”,一些 LM 执行提及跨度掩蔽,或对比学习,或从已知词汇表中融合实体嵌入。 作者根据框架对数十种现有架构进行了出色的分类,现在看起来组织得更好了。 非常需要的工作!

一些简短的论文专注于用生物医学 KG 来丰富 LM,这是向 LM 教授特定领域的生物医学的长期努力 俚语。 孟等 提供 分区混合 (MoP),一种基于 适配器融合 该技术减轻了从头开始预训练 LM 的需要。 MoP 接受了常见的生物医学词汇和本体 UMLS 和 SNOMED CT 的培训。

孟等 提供 分区混合 (MoP),一种基于 适配器融合 该技术减轻了从头开始预训练 LM 的需要。 MoP 接受了常见的生物医学词汇和本体 UMLS 和 SNOMED CT 的培训。 宋等人 问 “语言模型可以成为生物医学知识库吗?” 指的是 Petroni 等人著名的 EMNLP'19 论文. 答案主要是 没有. 作者设计 比奥拉马,用于探索基于 UMLS、CTD 和 Wikidata 构建的生物医学知识的基准。 他们发现现代 LM 在这些探测上的准确度低于 10%,因此社区肯定需要更可靠的东西

宋等人 问 “语言模型可以成为生物医学知识库吗?” 指的是 Petroni 等人著名的 EMNLP'19 论文. 答案主要是 没有. 作者设计 比奥拉马,用于探索基于 UMLS、CTD 和 Wikidata 构建的生物医学知识的基准。 他们发现现代 LM 在这些探测上的准确度低于 10%,因此社区肯定需要更可靠的东西  .

.

对话式人工智能:停止幻觉,兄弟

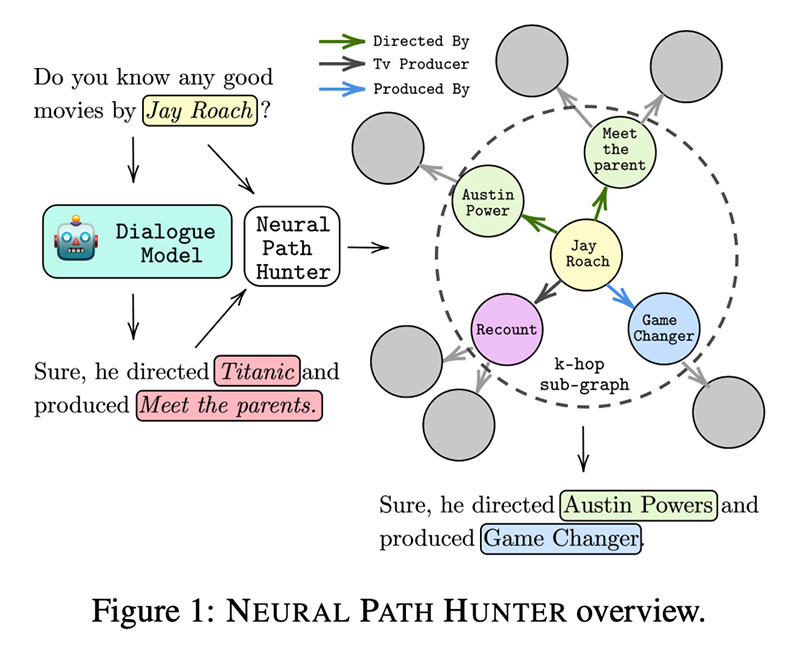

神经路径猎人:通过路径接地减少对话系统中的幻觉 作者:Nouha Dziri、Andrea Madotto、Osmar Zaiane、Avishek Joey Bose

使用具有 KG 背景的 ConvAI 系统生成响应非常棘手。 在具有许多组件的管道系统中,您严格使用表面形式(实体名称),并且您主要使用模板,并且 模板很无聊 并且难以维护。 另一方面,像 GPT-2 和 GPT-2 这样的 e3e 生成模型会产生更多独特的回复,但通常会产生幻觉,即在您不期望的时候插入错误的实体名称。

这项工作的作者开始了 狩猎  通过 KG 监督建议减少幻觉 神经路径猎人. 首先,他们研究了几个 各种幻觉 ,它们来自哪里(主要来自 top-k 采样),以及如何量化它。

通过 KG 监督建议减少幻觉 神经路径猎人. 首先,他们研究了几个 各种幻觉 ,它们来自哪里(主要来自 top-k 采样),以及如何量化它。

NPH 本身由两个模块组成: 1⃣ 一个对令牌执行二进制分类的评论家(非自回归 LM); 2⃣ 用于修复实体错误的实体检索器:这本质上是一个实体内存,其中实体嵌入来自 GPT,并使用图结构使用 CompGCN 进行更新。 最合理的候选者来自应用 DistMult 评分功能。 瞧!

NPH 可以与任何预训练的 LM 配对,在 开放拨号KG 以 GPT2-KG 为基准, GPT2-KE及 适配器机器人 显示显着减少  幻觉和增加

幻觉和增加  在忠诚中。 一项用户研究报告说,人类测量的幻觉在 NPH 模型中减少了约 2 倍

在忠诚中。 一项用户研究报告说,人类测量的幻觉在 NPH 模型中减少了约 2 倍

在这方面的另一项相关工作: 霍诺维奇等人 在对话系统中研究相同的问题,但没有背景知识图谱并提出新的基准 Q² 衡量问题生成和问题回答的事实一致性(如果您询问,两个 Q 的来源)。

在这方面的另一项相关工作: 霍诺维奇等人 在对话系统中研究相同的问题,但没有背景知识图谱并提出新的基准 Q² 衡量问题生成和问题回答的事实一致性(如果您询问,两个 Q 的来源)。

如果您喜欢 ConvAI 和常识知识库——请务必通过以下方式检查 CLUE(对话式多跳推理器) 阿拉沙希、李等人包含的概念 if-(state), then-(action), 因为-(goal) 模式逻辑规则和符号推理。

如果您喜欢 ConvAI 和常识知识库——请务必通过以下方式检查 CLUE(对话式多跳推理器) 阿拉沙希、李等人包含的概念 if-(state), then-(action), 因为-(goal) 模式逻辑规则和符号推理。

实体链接:在巨像的阴影下

使用先验探针对实体消歧的鲁棒性评估:实体遮蔽案例 by 维拉·普罗瓦托娃、斯维特拉娜·瓦库连科、萨玛斯·巴尔加夫、伊万杰洛斯·卡努拉斯

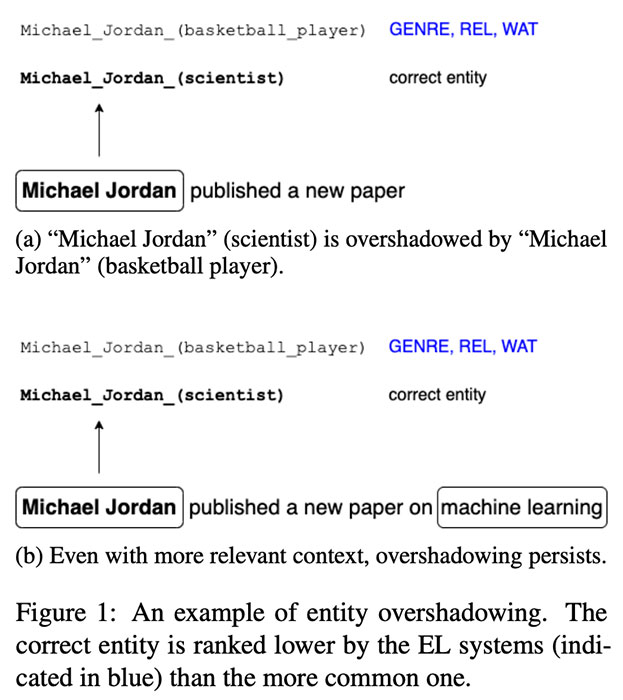

当您为语言任务插入真实世界的 KG 时,您将不可避免地遇到 不同的实体 确切地说 同名

. 不幸的是,人类并未对世界上所有实体使用唯一的哈希,因此实体消歧仍然是实体链接的重要步骤。

. 不幸的是,人类并未对世界上所有实体使用唯一的哈希,因此实体消歧仍然是实体链接的重要步骤。

例如,维基数据有 至少有 18 个实体名为“迈克尔·乔丹”. 通常,EL 系统依赖于基本统计数据和人气分数,因此最受欢迎的“篮球运动员迈克尔乔丹”会掩盖不那么出名的人(至少在流行文化中)。

作者解决了这个问题并引入了一个新的数据集, 影联, 来衡量现代 EL 系统的混乱程度。 结果最高的 F1 分数勉强达到 0.35(最近生成 类型 在最难的部分产生 0.26)。 所有系统在长尾稀有实体上的得分都达到饱和,并且还应对更常见的实体。 主要挑战被表述为“使这项任务具有挑战性的是模棱两可和不寻常的结合”。 我建议作者将数据集上传到 HuggingFace 数据集 增加他们酷项目的知名度

作者解决了这个问题并引入了一个新的数据集, 影联, 来衡量现代 EL 系统的混乱程度。 结果最高的 F1 分数勉强达到 0.35(最近生成 类型 在最难的部分产生 0.26)。 所有系统在长尾稀有实体上的得分都达到饱和,并且还应对更常见的实体。 主要挑战被表述为“使这项任务具有挑战性的是模棱两可和不寻常的结合”。 我建议作者将数据集上传到 HuggingFace 数据集 增加他们酷项目的知名度  .

.

阿罗拉等人 从另一个方向处理实体链接问题。 主要思想是 true 命名 实体 在一个文件中(联合处理,而不是一个接一个) 跨度 低级 子空间

阿罗拉等人 从另一个方向处理实体链接问题。 主要思想是 true 命名 实体 在一个文件中(联合处理,而不是一个接一个) 跨度 低级 子空间  在包括候选人在内的所有实体的空间中(查看下面的视觉示例)。 这 主题 如果您有预训练的实体嵌入,则该方法是无监督的——作者在 Wikidata 的英文子集上使用 DeepWalk(或者,他们尝试了词嵌入,但效果不佳)。

在包括候选人在内的所有实体的空间中(查看下面的视觉示例)。 这 主题 如果您有预训练的实体嵌入,则该方法是无监督的——作者在 Wikidata 的英文子集上使用 DeepWalk(或者,他们尝试了词嵌入,但效果不佳)。

概念上相似的 基于实体的冲突问题 被研究 朗普雷等人,即知识替换——如果你将段落中的真实实体翻转为随机实体(或自相矛盾的实体),模型会改变答案吗? 换句话说,QA 模型会依赖阅读上下文还是记忆知识?

概念上相似的 基于实体的冲突问题 被研究 朗普雷等人,即知识替换——如果你将段落中的真实实体翻转为随机实体(或自相矛盾的实体),模型会改变答案吗? 换句话说,QA 模型会依赖阅读上下文还是记忆知识?  事实证明,当使用这种替换训练 QA 模型时,您可以大幅提高 OOD 泛化能力!

事实证明,当使用这种替换训练 QA 模型时,您可以大幅提高 OOD 泛化能力!

最后,看看调查问卷 特德斯基等人 on “用于实体链接的 NER:什么有效,下一步是什么”. 作者确定了 EL 的关键挑战并尝试解决与 NER 相关的挑战 NER4EL 旨在缩小大型预训练 LM 与较小模型之间的性能差距,这在资源匮乏的情况下尤其重要

最后,看看调查问卷 特德斯基等人 on “用于实体链接的 NER:什么有效,下一步是什么”. 作者确定了 EL 的关键挑战并尝试解决与 NER 相关的挑战 NER4EL 旨在缩小大型预训练 LM 与较小模型之间的性能差距,这在资源匮乏的情况下尤其重要  .

.

KG建筑

我没有设法在这里想出一个吸引人的台词:/ 如果您喜欢 OpenIE 和 KG Construction,那么以下论文可能是相关的。

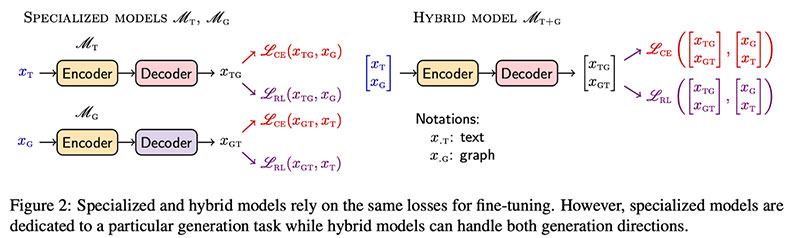

多宁等人 提供 再生基因,一种微调 LM 以执行 Text2Graph 和 Graph2Text 任务(或微调专用模型)的方法。 关键成分

多宁等人 提供 再生基因,一种微调 LM 以执行 Text2Graph 和 Graph2Text 任务(或微调专用模型)的方法。 关键成分  除了标准交叉熵 (CE) 之外,还添加了 RL 损失(自临界序列训练)。 它可以很容易地添加到任何预训练的 LM 中——作者尝试使用 T5-Large(770M 参数)和 T5-base(220M 参数)。

除了标准交叉熵 (CE) 之外,还添加了 RL 损失(自临界序列训练)。 它可以很容易地添加到任何预训练的 LM 中——作者尝试使用 T5-Large(770M 参数)和 T5-base(220M 参数)。  实验上, 再生基因 显着改进了 Text2Graph WebNLG 基线(3-10 个绝对点,具体取决于指标),并且适用于 许多 大 TekGen 数据集 (6M 训练对)。

实验上, 再生基因 显着改进了 Text2Graph WebNLG 基线(3-10 个绝对点,具体取决于指标),并且适用于 许多 大 TekGen 数据集 (6M 训练对)。

破折号等 研究 规范化 OpenIE 中的问题——当实体具有不同的表面形式时 (纽约市,纽约市) 参考同一个原型。 以一种无监督的方式,我们希望 IE 系统自动将这些提及聚集在一起。 方法, 鼓,诉诸变分自动编码器(VAE)来识别集群(实体和关系由高斯参数化)。 除了 VAE 的标准 重建损失, CUVA 采用了额外的 链接预测 离 基于 HolE 评分函数。

破折号等 研究 规范化 OpenIE 中的问题——当实体具有不同的表面形式时 (纽约市,纽约市) 参考同一个原型。 以一种无监督的方式,我们希望 IE 系统自动将这些提及聚集在一起。 方法, 鼓,诉诸变分自动编码器(VAE)来识别集群(实体和关系由高斯参数化)。 除了 VAE 的标准 重建损失, CUVA 采用了额外的 链接预测 离 基于 HolE 评分函数。  此外,作者还介绍了一部小说 佳能NELL 数据集!

此外,作者还介绍了一部小说 佳能NELL 数据集!

KG问答:添加一些  SPARQL

SPARQL

来自中间问题分解的 SPARQLing 数据库查询 by 伊琳娜·萨帕丽娜和安东·奥索金

不幸的是,*CL 域中没有那么多 SPARQL 应用。 我认为它值得在 NLP 中得到更广泛的采用。 当它被一个很酷的应用程序支持时——我在  .

.

大多数结构化 QA 数据集或使用语义解析的数据集以 SQL 作为主要输出格式。 SQL管道之外还有生命吗?

Saparina 和 Osokin 通过 1⃣ 首先使用 问题分解意义表示(QDMR) 将问题转换为与语法无关的逻辑形式的框架; 2⃣ 这种形式可以翻译成任何结构化格式,这里作者使用 SPARQL 表明以图形格式查询数据库要容易得多。 它确实需要将输入表转换为 RDF,但对于 蜘蛛 缩放它可以很容易地完成。

可训练模块包括 大鼠变压器 带有生成 QDMR 令牌的 LSTM 解码器的编码器。 QDMR -> SPARQL 是基于少数规则的直接转换。 与 SOTA 相当的结果;

与 SOTA 相当的结果; 代码可用 ;

代码可用 ; SPARQL 比 SQL 工作得更好;

SPARQL 比 SQL 工作得更好;

一篇好论文还需要什么?

另一个令人兴奋的工作 Das 等人的“基于案例的基于知识库的自然语言查询的推理” 将 SPARQL 与 基于案例的推理 (CBR)。 早在 80 年代,CBR 就深深植根于专家系统,但最近又凭借表征学习的力量得以复兴。 TLDR 对 2021 年 CBR 的解释:它在概念上接近于组合泛化,即,在看过一些基本示例后,您可以针对以前未见过的实体构建更复杂的查询。

另一个令人兴奋的工作 Das 等人的“基于案例的基于知识库的自然语言查询的推理” 将 SPARQL 与 基于案例的推理 (CBR)。 早在 80 年代,CBR 就深深植根于专家系统,但最近又凭借表征学习的力量得以复兴。 TLDR 对 2021 年 CBR 的解释:它在概念上接近于组合泛化,即,在看过一些基本示例后,您可以针对以前未见过的实体构建更复杂的查询。

看看下面的例子。 我们有一个输入查询 “霍比特人中吉姆利父亲的兄弟是谁?”. 在训练数据中,我们可能没有关于 Gimli 或 Hobbit 的任何信息,但我们可能有“相对相似” 例 在我们可以找到对我们的查询有用的关系上,例如, “查理辛的爸爸是谁?” 与 Freebase 关系 people.person_parents 和 “蕾哈娜的兄弟姐妹是谁?” 有关系 people.person.sibling_s . 为我们的问题组合它们,我们构造了一个对数据库的 SPARQL 查询。

建议的 CBR-KBQA 方法结合了 1⃣ 一个 DPR 风格的可训练神经检索器(监督基于重叠关系),2⃣ 一个线性变换器(他们使用 BigBird),因为连接的相关问题和查询很长,3⃣ 几个重新排序机制来清理预测。 他们使用现成的 NER 和实体链接模块,并且还使用预训练的 TransE 关系嵌入进行重新排序。 CBR-KBQA 在几个 KBQA 数据集上展示了令人印象深刻的性能,包括 CFQ. 一个小提示:我有点怀疑最好的可用 SOTA 模型(67.3 MCD-Mean)的表现优于 78.1 并且没有提交到基准测试,代码也还不可用。

石等 研究多跳 QA 并建议将实体/关系 ID(标签形式)及其自然语言描述(文本形式)集成到他们的消息传播框架中 传输网. 评估是在标准 MetaQA、WebQuestionsSP 和 Complex Web Questions 数据集上完成的。

石等 研究多跳 QA 并建议将实体/关系 ID(标签形式)及其自然语言描述(文本形式)集成到他们的消息传播框架中 传输网. 评估是在标准 MetaQA、WebQuestionsSP 和 Complex Web Questions 数据集上完成的。

在相同的任务中(与之前工作相同的数据集), 奥利亚等人 注意到大多数 SOTA QA 模型需要已经链接到 KG 实体的文本跨度,并尝试使用 KG 实体的节点邻域的特征和文本跨度的特征通过动态实体重新排序来规避这一要求。

在相同的任务中(与之前工作相同的数据集), 奥利亚等人 注意到大多数 SOTA QA 模型需要已经链接到 KG 实体的文本跨度,并尝试使用 KG 实体的节点邻域的特征和文本跨度的特征通过动态实体重新排序来规避这一要求。

这就是所有的人

如果你喜欢这个较短的“premum”,请告诉我  格式比之前评论中的文字长墙更好! 感谢您在这里投入时间,希望您带回家一些有用的东西

格式比之前评论中的文字长墙更好! 感谢您在这里投入时间,希望您带回家一些有用的东西

这篇文章最初发表于 中 并在获得作者许可的情况下重新发布到TOPBOTS。

喜欢这篇文章吗? 注册以获取更多AI更新。

我们会在发布更多技术教育时通知您。

该职位 EMNLP 2021 上的知识图谱 最早出现 热门.

- '

- "

- 10

- 11

- 2021

- 67

- 7

- 9

- a

- 关于

- 丰富

- 根据

- 操作

- 添加

- 增加

- 地址

- 管理

- 采用

- AI

- 研究

- 致力

- 所有类型

- 已经

- 歧义

- 分析

- 另一个

- 回答

- 应用领域

- 应用领域

- 应用的

- 应用

- 的途径

- 刊文

- 作者

- 自动

- 可使用

- 背景

- 篮球

- 如下。

- 基准

- 最佳

- 之间

- 超越

- 最大

- 位

- 阻止

- 商业

- 呼叫

- 候选人

- 案件

- 例

- 挑战

- 挑战

- 挑战

- 更改

- 城市

- 分类

- 码

- 组合

- 如何

- 相当常见

- 社体的一部分

- 复杂

- 组件

- 研讨会 首页

- 混乱

- 施工

- 内容

- 可以

- 文化塑造

- 顾客

- 客户支持

- data

- 数据库

- 数据库

- 深

- 演示

- 根据

- 描述

- DID

- 不同

- 不会

- 域

- 动态

- 每

- 容易

- 教育

- 教育的

- 努力

- 员工

- 英语

- 实体

- 实体

- 特别

- 本质上

- 评估

- 活动

- 例子

- 例子

- 令人兴奋的

- 现有

- 期望

- 技术专家

- 家庭

- 家庭

- 特征

- 终于

- 金融

- 姓氏:

- 专注焦点

- 以下

- 申请

- 格式

- 形式

- 骨架

- 止

- 功能

- 差距

- 代

- 生成的

- GitHub上

- 目标

- 非常好

- 大

- 快乐

- 有

- 高度

- 此处

- 主页

- 抱有希望

- 创新中心

- How To

- hr

- HTTPS

- 人类

- 主意

- 鉴定

- 重要

- 有声有色

- 其他

- 包含

- 增加

- 输入

- 例

- 整合

- 投资

- IT

- 本身

- 工作

- 键

- 知道

- 知识

- 已知

- 标签

- 语言

- 大

- 学习

- 法律咨询

- Line

- 链接

- 伦敦

- 长

- 看

- 多数

- 使

- 制作

- 管理

- 管理

- 方式

- 营销

- 材料

- 意

- 衡量

- 中等

- 内存

- 提到

- 可能

- 模型

- 模型

- 更多

- 最先进的

- 最受欢迎的产品

- 亦即

- 名称

- 自然

- 需要

- 纽约

- 纽约市

- 概念

- 纽约市

- 安大略

- 运营

- 举办

- 其他名称

- 纸类

- 部分

- 尤其

- 性能

- 人

- 请

- 点

- 热门

- 声望

- 帖子

- 功率

- 预测

- 高级版

- 漂亮

- 以前

- 市场问题

- 生产

- 产品

- 项目

- 突出

- 提供

- 题

- 读者

- 阅读

- 最近

- 最近

- 建议

- 减少

- 减少

- 减少

- 关系

- 释放

- 相应

- 可靠

- 遗迹

- 业务报告

- 表示

- 要求

- 研究

- 度假村

- 成果

- 定位、竞价/采购和分析/优化数字媒体采购,但算法只不过是解决问题的操作和规则。

- 销售

- 同

- 鳞片

- 得分

- 几个

- 阴影

- 短

- 签署

- 显著

- 小

- So

- 一些

- 东西

- 太空

- 专门

- 标准

- 州/领地

- 统计

- 结构化

- 学习

- 提交

- 监管

- SUPPORT

- 支持

- 磁化面

- 调查

- 系统

- 产品

- 目标

- 任务

- 文案

- 模板

- 世界

- 次

- 今晚

- 一起

- 令牌

- 主题

- 产品培训

- 转型

- 旅游

- Uk

- 独特

- 最新动态

- 使用

- 各个

- 能见度

- W

- 卷筒纸

- 每周

- 什么是

- WHO

- 更宽

- 话

- 工作

- 合作

- 世界

- 将

- 年

- 您一站式解决方案