对于脑计算来说,时间就是一切。这就是神经元连接成电路的方式。这就是这些电路处理高度复杂的数据的方式,从而导致可能意味着生死攸关的行动。这就是我们的大脑如何在瞬间做出决定的方式,即使面对全新的环境也是如此。而且我们这样做并不会因为大量的能源消耗而煎熬大脑。

换句话说,大脑是一个非常强大的计算机可以模仿的绝佳例子,并且计算机科学家和工程师已经迈出了这样做的第一步。神经形态计算领域希望通过新颖的硬件芯片和软件算法来重建大脑的架构和数据处理能力。这可能是一条通往真正的道路 人工智能.

但缺少一个关键要素。大多数为神经形态芯片提供动力的算法只关心每个人工神经元的贡献,即它们彼此连接的强度,称为“突触权重”。我们大脑的内部运作缺少的是时间。

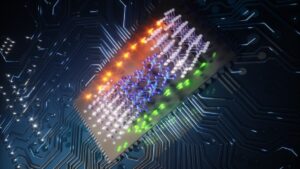

本月,隶属于欧盟旗舰大数据神经科学项目“人脑项目”的一个团队补充道 时间要素 到神经形态算法。然后将结果在物理硬件上实现—— BrainScaleS-2 神经形态平台——并与最先进的 GPU 和传统的神经形态解决方案进行竞争。

作者表示,“与深度学习中使用的抽象神经网络相比,更多的生物原型……由于其固有的复杂性,在性能和可扩展性方面仍然落后”。

在多项测试中,该算法在标准基准测试中“在准确性、延迟和能源效率方面表现良好”, 说过 瑞士苏黎世大学和苏黎世联邦理工学院的夏洛特·弗伦克尔博士没有参与这项研究。通过在神经形态计算中添加时间组件,我们可以开创高效人工智能的新时代,从静态数据任务(例如图像识别)转向更好地封装时间的任务。想想视频、生物信号或脑机对话。

对于主要作者 Mihai Petrovici 博士来说,潜力是双向的。 “我们的工作不仅对神经形态计算和受生物学启发的硬件感兴趣。它还承认……将所谓的深度学习方法转移到神经科学,从而进一步揭开人类大脑的秘密的需求,”他 说过.

让我们来谈谈尖峰

新算法的根源是脑计算的一个基本原理:尖峰。

让我们看一下高度抽象的神经元。它就像一个tootsie roll,有一个球状的中间部分,两侧是两个向外延伸的包装纸。一侧是输入——一棵复杂的树,接收来自前一个神经元的信号。另一个是输出,使用充满化学物质的气泡状船只向其他神经元发射信号,这反过来又触发接收端的电响应。

关键在于:要使整个序列发生,神经元必须“尖峰”。当且仅当神经元接收到足够高水平的输入(一种内置的降噪机制)时,球状部分才会产生一个尖峰,沿着输出通道传播以警告下一个神经元。

但神经元不仅仅使用一个尖峰来传递信息。相反,它们按时间顺序出现峰值。就像摩尔斯电码一样:电爆发发生的时间携带了大量的数据。它是神经元连接成电路和层次结构的基础,从而实现高能效处理。

那么为什么不对神经形态计算机采用相同的策略呢?

斯巴达类脑芯片

该团队没有绘制出单个人工神经元的尖峰(这是一项艰巨的任务),而是专注于一个单一的指标:神经元放电需要多长时间。

“首次尖峰时间”代码背后的想法很简单:神经元尖峰时间越长,其活动水平就越低。与计算尖峰相比,这是一种对神经元活动进行编码的极其稀疏的方法,但也有好处。由于仅使用神经元第一次启动的延迟来对激活进行编码,因此它可以捕获神经元的响应性,而不会因过多的数据点而使计算机不堪重负。换句话说,它快速、节能且简单。

接下来,该团队将算法编码到神经形态芯片上—— BrainScaleS-2,它大致模拟其结构内部的简单“神经元”,但运行 快 1,000 倍以上 比我们的生物大脑。该平台拥有超过 500 个物理人工神经元,每个神经元都能够通过可配置的突触接收 256 个输入,生物神经元在其中交换、处理和存储信息。

该设置是混合的。 “学习”是在实现时间相关算法的芯片上实现的。然而,神经回路的任何更新(即一个神经元与另一个神经元的连接强度)都是通过外部工作站实现的,这被称为“循环训练”。

在第一次测试中,该算法面临“阴阳”任务的挑战,该任务要求算法解析传统东方符号中的不同区域。该算法非常出色,平均准确率为 95%。

接下来,团队用一个经典的深度学习任务来挑战这个设置——MNIST,一个彻底改变计算机视觉的手写数字数据集。该算法再次表现出色,准确率接近 97%。更令人印象深刻的是,BrainScaleS-2 系统只需不到一秒即可对 10,000 个测试样本进行分类,且相对能耗极低。

将这些结果放在上下文中,该团队接下来将配备新算法的 BrainScaleS-2 的性能与商业和其他神经形态平台进行了比较。拿 三角帆,一种大规模的并行分布式架构,也模仿神经计算和尖峰。新算法的图像识别速度提高了 100 倍以上,而功耗仅为 SpiNNaker 的一小部分。 IBM 神经拟态芯片的先驱 True North 也出现了类似的结果。

下一步是什么?

大脑的两个最有价值的计算功能——能源效率和并行处理——现在正在极大地启发下一代计算机芯片。目标?建造像我们自己的大脑一样灵活和适应性强的机器,而仅使用当前硅基芯片所需能量的一小部分。

然而,与依赖人工神经网络的深度学习相比,生物学上合理的深度学习已经陷入困境。弗伦克尔解释说,部分原因是通过学习“更新”这些电路很困难。然而,有了 BrainScaleS-2 和一些计时数据,现在就可以实现这一点。

同时,拥有一个用于更新突触连接的“外部”仲裁器可以给整个系统一些喘息的时间。神经形态硬件与我们大脑计算的混乱程度类似,充满了不匹配和错误。借助芯片和外部仲裁器,整个系统可以学习适应这种变化,并最终补偿甚至利用其怪癖,实现更快、更灵活的学习。

对于 Frenkel 来说,该算法的强大之处在于其稀疏性。她解释说,大脑由稀疏代码驱动,“可以解释快速反应时间……例如视觉处理。”不需要激活整个大脑区域,只需要几个神经网络——就像在空荡荡的高速公路上呼啸而过,而不是陷入高峰时段的交通堵塞。

尽管该算法很强大,但仍然存在问题。尽管它擅长处理时间序列(例如语音或生物信号),但它在解释静态数据方面遇到了困难。但对 Frenkel 来说,这是一个新框架的开始:重要信息可以用灵活但简单的指标进行编码,并进行推广,以丰富基于大脑和人工智能的数据处理,而成本只是传统能源成本的一小部分。

“[它]……可能是尖峰神经形态硬件的一个重要垫脚石,最终展示出相对于传统神经网络方法的竞争优势,”她说。

图片来源:Göltz 和 Kriener 等人对阴阳数据集中的数据点进行分类。 (海德堡/伯尔尼)