أمازون ليكس هي خدمة تتيح لك إنشاء روبوتات للمحادثة ("روبوتات الدردشة") ووكلاء افتراضيين وأنظمة استجابة صوتية تفاعلية (IVR) لتطبيقات مثل أمازون كونيكت.

لطالما كان الذكاء الاصطناعي (AI) والتعلم الآلي (ML) محل تركيز لأمازون لأكثر من 20 عامًا ، والعديد من القدرات التي يستخدمها العملاء مع Amazon مدفوعة من ML. اليوم ، تعمل نماذج اللغات الكبيرة (LLMs) على تغيير طريقة حل المطورين والمؤسسات للتحديات المعقدة تاريخيًا المتعلقة بفهم اللغة الطبيعية (NLU). أعلنا أمازون بيدروك مؤخرًا ، والذي يضفي الطابع الديمقراطي على الوصول إلى النموذج التأسيسي للمطورين لبناء وتوسيع نطاق التطبيقات القائمة على الذكاء الاصطناعي بسهولة ، باستخدام أدوات وقدرات AWS المألوفة. يتمثل أحد التحديات التي تواجهها المؤسسات في دمج معرفتها التجارية في LLM لتقديم استجابات دقيقة وذات صلة. عند الاستدانة بشكل فعال ، يمكن استخدام قواعد المعرفة المؤسسية لتقديم تجارب خدمة ذاتية مخصصة وخدمة مساعدة ، من خلال تقديم المعلومات التي تساعد العملاء على حل المشكلات بشكل مستقل و / أو زيادة معرفة الوكيل. اليوم ، يمكن لمطور الروبوتات تحسين تجارب الخدمة الذاتية دون استخدام LLM بطريقتين. أولاً ، من خلال إنشاء النوايا ونماذج الكلام والردود ، وبالتالي تغطية جميع أسئلة المستخدم المتوقعة داخل روبوت Amazon Lex. ثانيًا ، يمكن للمطورين أيضًا دمج برامج الروبوت مع حلول البحث ، والتي يمكنها فهرسة المستندات المخزنة عبر مجموعة واسعة من المستودعات والعثور على المستند الأكثر صلة للإجابة على أسئلة العملاء. هذه الأساليب فعالة ، ولكنها تتطلب موارد للمطورين مما يجعل البدء صعبًا.

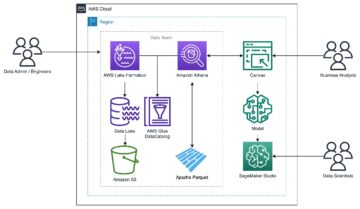

إحدى المزايا التي تقدمها LLMs هي القدرة على إنشاء تجارب خدمة ذاتية محادثة ذات صلة ومقنعة. يفعلون ذلك من خلال الاستفادة من قاعدة (قواعد) المعرفة الخاصة بالمؤسسة وتقديم استجابات أكثر دقة وسياقية. يقدم منشور المدونة هذا حلاً قويًا لزيادة Amazon Lex بميزات الأسئلة الشائعة المستندة إلى LLM باستخدام Retrieval Augmented Generation (RAG). سنراجع كيف يعمل نهج RAG على زيادة ردود الأسئلة الشائعة عن Amazon Lex باستخدام مصادر بيانات شركتك. بالإضافة إلى ذلك ، سنعرض أيضًا تكامل Amazon Lex مع LlamaIndex ، وهو إطار بيانات مفتوح المصدر يوفر مصدر المعرفة ومرونة التنسيق لمطور الروبوتات. عندما يكتسب مطور الروبوت الثقة باستخدام LlamaIndex لاستكشاف تكامل LLM ، يمكنه توسيع نطاق قدرة Amazon Lex بشكل أكبر. يمكنهم أيضًا استخدام خدمات بحث المؤسسة مثل أمازون كندرا، والذي تم دمجه أصلاً مع Amazon Lex.

في هذا الحل ، نعرض التطبيق العملي لروبوت الدردشة Amazon Lex مع تحسين RAG المستند إلى LLM. نحن نستخدم ال حالة استخدام دعم عملاء Zappos كمثال لإثبات فعالية هذا الحل ، والذي يأخذ المستخدم من خلال تجربة أسئلة وأجوبة محسّنة (مع LLM) ، بدلاً من توجيهه إلى الرجوع (افتراضي ، بدون LLM).

حل نظرة عامة

تجمع RAG بين نقاط القوة في الأساليب التقليدية القائمة على الاسترجاع والقائمة على الذكاء الاصطناعي لأنظمة الأسئلة والأجوبة. تستخدم هذه المنهجية قوة نماذج اللغة الكبيرة ، مثل أمازون تيتان أو نماذج مفتوحة المصدر (على سبيل المثال ، Falcon) ، لأداء المهام التوليدية في أنظمة الاسترجاع. كما أنه يأخذ في الاعتبار السياق الدلالي من المستندات المخزنة بشكل أكثر فعالية وكفاءة.

يبدأ RAG بخطوة استرجاع أولية لاسترداد المستندات ذات الصلة من مجموعة بناءً على استعلام المستخدم. ثم تستخدم نموذجًا لغويًا لتوليد استجابة من خلال النظر في كل من المستندات المسترجعة والاستعلام الأصلي. من خلال دمج RAG في Amazon Lex ، يمكننا تقديم إجابات دقيقة وشاملة لاستفسارات المستخدم ، مما يؤدي إلى تجربة مستخدم أكثر جاذبية وإرضاءً.

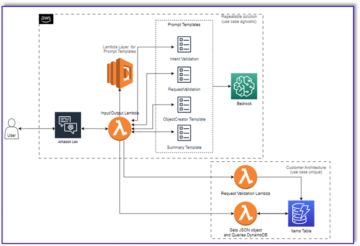

يتطلب نهج RAG استيعاب المستندات بحيث التضمين يمكن إنشاؤها لتمكين البحث المستند إلى LLM. يوضح الرسم البياني التالي كيف تنشئ عملية الاستيعاب حفلات الزفاف التي يستخدمها روبوت المحادثة بعد ذلك أثناء الرجوع للإجابة على سؤال العميل.

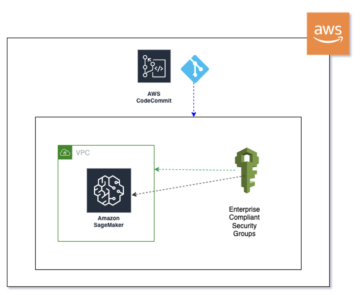

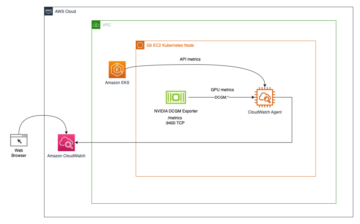

مع بنية الحل هذه ، يجب عليك اختيار LLM الأنسب لحالة الاستخدام الخاصة بك. كما يوفر أيضًا اختيار نقطة نهاية للاستدلال بين Amazon Bedrock (في معاينة محدودة) والنماذج المستضافة على Amazon SageMaker JumpStart ، مما يوفر مرونة LLM إضافية.

تم تحميل المستند إلى ملف خدمة تخزين أمازون البسيطة (Amazon S3) دلو. يحتوي دلو S3 على مستمع حدث مرفق يستدعي ملف AWS لامدا تعمل على التغييرات في الجرافة. يستوعب مستمع الحدث المستند الجديد ويضع الزخارف في دلو S3 آخر. ثم يتم استخدام الزخارف بواسطة تطبيق RAG في روبوت Amazon Lex أثناء النية الاحتياطية للإجابة على سؤال العميل. يوضح الرسم التخطيطي التالي بنية كيفية تحسين روبوت الأسئلة الشائعة داخل Lex باستخدام LLMs و RAG.

دعنا نستكشف كيف يمكننا دمج RAG استنادًا إلى LlamaIndex في روبوت Amazon Lex. نحن نقدم أمثلة التعليمات البرمجية و مجموعة تطوير سحابة AWS (AWS CDK) استيراد لمساعدتك في إعداد التكامل. يمكنك العثور على أمثلة التعليمات البرمجية في مستودع جيثب. توفر الأقسام التالية دليلاً تفصيليًا لمساعدتك في إعداد البيئة ونشر الموارد اللازمة.

كيف تعمل RAG مع Amazon Lex

يتضمن تدفق RAG عملية تكرارية حيث يسترد مكون المسترد المقاطع ذات الصلة ، ويساعد السؤال والممرات في إنشاء الموجه ، بينما ينتج مكون التوليد استجابة. يتيح هذا المزيج من تقنيات الاسترجاع والتوليد لنموذج RAG الاستفادة من نقاط القوة في كلا النهجين ، مما يوفر إجابات دقيقة ومناسبة للسياق لأسئلة المستخدم. يوفر سير العمل الإمكانات التالية:

- محرك المسترد - يبدأ نموذج RAG بمكون مسترد مسؤول عن استرجاع الوثائق ذات الصلة من مجموعة كبيرة. يستخدم هذا المكون عادةً تقنية استرداد المعلومات مثل TF-IDF أو BM25 لترتيب واختيار المستندات التي من المحتمل أن تحتوي على إجابة لسؤال معين. يقوم المسترد بمسح مجموعة المستندات ضوئيًا واسترداد مجموعة من المقاطع ذات الصلة.

- موجه مساعد - بعد أن يحدد المسترد المقاطع ذات الصلة ، ينتقل نموذج RAG إلى الإنشاء الفوري. الموجه هو مزيج من السؤال والممرات المسترجعة ، ويعمل كسياق إضافي للموجه ، والذي يستخدم كمدخل لمكون المولد. لإنشاء الموجه ، يقوم النموذج عادةً بزيادة السؤال بالمقاطع المحددة بتنسيق معين.

- جيل الاستجابة - يتم إدخال الموجه ، الذي يتكون من السؤال والمقاطع ذات الصلة ، في مكون التوليد لنموذج RAG. عادةً ما يكون مكون التوليد نموذجًا لغويًا قادرًا على التفكير من خلال الموجه لتوليد استجابة متماسكة وذات صلة.

- الرد النهائي - أخيرًا ، يختار نموذج RAG أعلى إجابة مرتبة كمخرجات ويقدمها كإجابة على السؤال الأصلي. يمكن معالجة الإجابة المحددة لاحقًا أو تنسيقها حسب الضرورة قبل إعادتها إلى المستخدم. بالإضافة إلى ذلك ، يتيح الحل تصفية الاستجابة المتولدة إذا أسفرت نتائج الاسترجاع عن درجة ثقة منخفضة ، مما يعني أنه من المحتمل أن يقع خارج التوزيع (OOD).

LlamaIndex: إطار بيانات مفتوح المصدر للتطبيقات المستندة إلى LLM

في هذا المنشور ، نوضح حل RAG استنادًا إلى LlamaIndex. LlamaIndex هو إطار بيانات مفتوح المصدر مصمم خصيصًا لتسهيل التطبيقات المستندة إلى LLM. يوفر حلاً قويًا وقابلًا للتطوير لإدارة مجموعة المستندات بتنسيقات مختلفة. مع LlamaIndex ، يتم تمكين مطوري برامج الروبوت لدمج إمكانات QA (الإجابة على الأسئلة) المستندة إلى LLM في تطبيقاتهم ، مما يلغي التعقيدات المرتبطة بإدارة الحلول التي تلبي مجموعات المستندات واسعة النطاق. علاوة على ذلك ، ثبت أن هذا النهج فعال من حيث التكلفة لمستودعات المستندات الأصغر حجمًا.

المتطلبات الأساسية المسبقة

يجب أن يكون لديك المتطلبات الأساسية التالية:

قم بإعداد بيئة التطوير الخاصة بك

متطلبات حزمة الطرف الثالث الرئيسية هي فهرس اللاما و sagemaker sdk. اتبع الأوامر المحددة في ملف ملف README الخاص بمستودع جيثب لإعداد بيئتك بشكل صحيح.

انشر الموارد المطلوبة

تتضمن هذه الخطوة إنشاء روبوت Amazon Lex ، ودلاء S3 ، ونقطة نهاية SageMaker. بالإضافة إلى ذلك ، تحتاج إلى Dockerize الكود في دليل صورة Docker ودفع الصور إلى سجل الأمازون المرنة للحاويات (Amazon ECR) بحيث يمكن تشغيله في Lambda. اتبع الأوامر المحددة في ملف ملف README الخاص بمستودع جيثب لنشر الخدمات.

خلال هذه الخطوة ، نعرض استضافة LLM عبر SageMaker حاويات التعلم العميق. اضبط الإعدادات وفقًا لاحتياجاتك الحسابية:

- الموديل - للعثور على نموذج يلبي متطلباتك ، يمكنك استكشاف موارد مثل محور نموذج Hugging Face. يقدم مجموعة متنوعة من النماذج مثل الصقر 7B or فلان- T5-XXL. بالإضافة إلى ذلك ، يمكنك العثور على معلومات مفصلة حول العديد من هياكل النماذج المدعومة رسميًا ، مما يساعدك على اتخاذ قرار مستنير. لمزيد من المعلومات حول أنواع النماذج المختلفة ، يرجى الرجوع إلى بنيات محسّنة.

- نقطة نهاية نموذج الاستدلال - حدد مسار النموذج (على سبيل المثال ، Falcon 7B) ، واختر نوع المثيل الخاص بك (على سبيل المثال ، g5.4xlarge) ، واستخدم التكميم (على سبيل المثال ، int-8 quantization).ملاحظات: يوفر لك هذا الحل المرونة لاختيار نموذج آخر يستنتج نقطة النهاية. تستطيع ايضا استخذام أمازون بيدروك، والذي يوفر الوصول إلى LLMs الأخرى مثل أمازون تيتانملاحظة: يوفر لك هذا الحل المرونة لاختيار نموذج آخر يستنتج نقطة النهاية. يمكنك أيضًا استخدام Amazon Bedrock ، والذي يوفر الوصول إلى LLMs الأخرى مثل Amazon Titan.

قم بإعداد فهرس المستندات الخاص بك عبر LlamaIndex

لإعداد فهرس المستند ، قم أولاً بتحميل بيانات المستند. نفترض أن لديك مصدر محتوى الأسئلة الشائعة ، مثل ملف PDF أو ملف نصي.

بعد تحميل بيانات المستند ، سيبدأ نظام LlamaIndex تلقائيًا عملية إنشاء فهرس المستند. يتم تنفيذ هذه المهمة بواسطة دالة Lambda ، والتي تنشئ الفهرس وتحفظه في حاوية S3.

لتمكين الاسترداد الفعال للمعلومات ذات الصلة ، قم بتكوين أداة استرداد المستندات باستخدام LlamaIndex Retriever Query Engine. يقدم هذا المحرك العديد من خيارات التخصيص ، مثل ما يلي:

- نماذج التضمين - يمكنك اختيار نموذج التضمين الخاص بك ، مثل تعانق الوجه.

- قطع الثقة - حدد حد قطع ثقة لتحديد جودة نتائج الاسترجاع. إذا كانت درجة الثقة أقل من هذا الحد ، يمكنك اختيار تقديم استجابات خارج النطاق ، مما يشير إلى أن الاستعلام خارج نطاق المستندات المفهرسة.

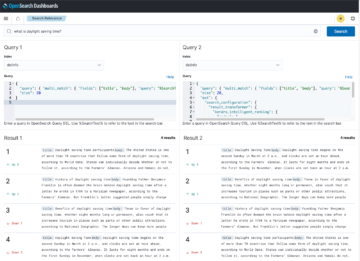

اختبر التكامل

حدد تعريف الروبوت الخاص بك بقصد احتياطي واستخدم وحدة تحكم Amazon Lex لاختبار طلبات الأسئلة الشائعة الخاصة بك. لمزيد من التفاصيل ، يرجى الرجوع إلى مستودع جيثب. تُظهر لقطة الشاشة التالية مثالاً لمحادثة مع الروبوت.

نصائح لتعزيز كفاءة الروبوت الخاص بك

من المحتمل أن تؤدي النصائح التالية إلى زيادة تحسين كفاءة الروبوت الخاص بك:

- تخزين الفهرس - قم بتخزين الفهرس الخاص بك في حاوية S3 أو خدمة ذات إمكانيات قاعدة بيانات متجه مثل أمازون أوبن سيرش. من خلال استخدام حلول التخزين المستندة إلى مجموعة النظراء ، يمكنك تحسين إمكانية الوصول إلى الفهرس الخاص بك وقابليته للتوسع ، مما يؤدي إلى أوقات استرداد أسرع وتحسين الأداء العام. أيضا ، الرجوع إلى هذا بلوق وظيفة بالنسبة إلى روبوت Amazon Lex الذي يستخدم ملف أمازون كندرا حل البحث.

- تحسين الاسترجاع - تجربة نماذج التضمين بأحجام مختلفة للمسترد. يمكن أن يؤثر اختيار نموذج التضمين بشكل كبير على متطلبات الإدخال الخاصة بـ LLM. يمكن أن يؤدي العثور على التوازن الأمثل بين حجم النموذج وأداء الاسترداد إلى تحسين الكفاءة وأوقات استجابة أسرع.

- الهندسة السريعة - جرب تنسيقات وأطوال وأنماط سريعة مختلفة لتحسين أداء وجودة إجابات الروبوت الخاص بك.

- اختيار نموذج LLM - حدد أنسب نموذج LLM لحالة الاستخدام الخاصة بك. ضع في اعتبارك عوامل مثل حجم النموذج وإمكانيات اللغة والتوافق مع متطلبات التطبيق الخاص بك. يضمن اختيار نموذج LLM الصحيح الأداء الأمثل والاستخدام الفعال لموارد النظام.

يمكن أن تمتد محادثات مركز الاتصال من الخدمة الذاتية إلى التفاعل البشري المباشر. بالنسبة لحالات الاستخدام التي تتضمن تفاعلات من إنسان إلى إنسان عبر Amazon Connect ، يمكنك استخدام حِكْمَة للبحث والعثور على المحتوى عبر مستودعات متعددة ، مثل الأسئلة المتداولة (FAQs) ومواقع wiki والمقالات والإرشادات خطوة بخطوة للتعامل مع مشكلات العملاء المختلفة.

تنظيف

لتجنب تكبد نفقات مستقبلية ، تابع حذف كافة الموارد التي تم نشرها كجزء من هذا التمرين. لقد قدمنا برنامجًا نصيًا لإغلاق نقطة نهاية SageMaker بأمان. تفاصيل الاستخدام موجودة في الملف التمهيدي. بالإضافة إلى ذلك ، لإزالة جميع الموارد الأخرى التي يمكنك تشغيلها cdk destroy في نفس الدليل مثل أوامر cdk الأخرى لإلغاء توفير جميع الموارد في المكدس الخاص بك.

نبذة عامة

ناقش هذا المنشور الخطوات التالية لتحسين Amazon Lex بميزات ضمان الجودة المستندة إلى LLM باستخدام إستراتيجية RAG و LlamaIndex:

- قم بتثبيت التبعيات الضرورية ، بما في ذلك مكتبات LlamaIndex

- قم بإعداد نموذج الاستضافة عبر Amazon SageMaker أو Amazon Bedrock (في معاينة محدودة)

- قم بتكوين LlamaIndex عن طريق إنشاء فهرس وتعبئته بالمستندات ذات الصلة

- دمج RAG في Amazon Lex عن طريق تعديل التكوين وتكوين RAG لاستخدام LlamaIndex لاسترداد المستندات

- اختبر التكامل من خلال الانخراط في محادثات مع chatbot ومراقبة استرجاعه وتوليد استجابات دقيقة

باتباع هذه الخطوات ، يمكنك دمج إمكانات ضمان الجودة القوية المستندة إلى LLM وفهرسة المستندات الفعالة في روبوت الدردشة Amazon Lex الخاص بك بسلاسة ، مما يؤدي إلى تفاعلات أكثر دقة وشمولية ومعرفة بالسياق مع المستخدمين. كمتابعة ، ندعوك أيضًا لمراجعة مشاركة المدونة التالية، الذي يستكشف تحسين تجربة الأسئلة الشائعة حول Amazon Lex باستخدام استيعاب عناوين URL و LLMs.

عن المؤلفين

ماكس هنكل والاس هو مهندس تطوير برمجيات في AWS Lex. إنه يستمتع بالعمل على الاستفادة من التكنولوجيا لتحقيق أقصى قدر من نجاح العملاء. خارج العمل ، إنه متحمس للطهي وقضاء الوقت مع الأصدقاء وحقائب الظهر.

ماكس هنكل والاس هو مهندس تطوير برمجيات في AWS Lex. إنه يستمتع بالعمل على الاستفادة من التكنولوجيا لتحقيق أقصى قدر من نجاح العملاء. خارج العمل ، إنه متحمس للطهي وقضاء الوقت مع الأصدقاء وحقائب الظهر.

سونغ فنغ هو عالم تطبيقي أقدم في مختبرات AWS AI ، متخصص في معالجة اللغة الطبيعية والذكاء الاصطناعي. يستكشف بحثها جوانب مختلفة من هذه المجالات بما في ذلك نمذجة الحوار المستند إلى المستندات ، والتفكير في الحوارات الموجهة نحو المهام ، وتوليد النص التفاعلي باستخدام البيانات متعددة الوسائط.

سونغ فنغ هو عالم تطبيقي أقدم في مختبرات AWS AI ، متخصص في معالجة اللغة الطبيعية والذكاء الاصطناعي. يستكشف بحثها جوانب مختلفة من هذه المجالات بما في ذلك نمذجة الحوار المستند إلى المستندات ، والتفكير في الحوارات الموجهة نحو المهام ، وتوليد النص التفاعلي باستخدام البيانات متعددة الوسائط.

ساكت صوراب هو مهندس مع فريق AWS Lex. يعمل على تحسين تجربة مطور Lex لمساعدة المطورين على بناء المزيد من روبوتات الدردشة الشبيهة بالبشر. خارج العمل ، يستمتع بالسفر واكتشاف المأكولات المتنوعة والتعرف على الثقافات المختلفة.

ساكت صوراب هو مهندس مع فريق AWS Lex. يعمل على تحسين تجربة مطور Lex لمساعدة المطورين على بناء المزيد من روبوتات الدردشة الشبيهة بالبشر. خارج العمل ، يستمتع بالسفر واكتشاف المأكولات المتنوعة والتعرف على الثقافات المختلفة.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون السيارات / المركبات الكهربائية ، كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- BlockOffsets. تحديث ملكية الأوفست البيئية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/enhance-amazon-lex-with-conversational-faq-features-using-llms/

- :لديها

- :يكون

- :أين

- $ UP

- 100

- 20

- 20 سنة

- a

- القدرة

- من نحن

- الوصول

- إمكانية الوصول

- وفقا

- حسابي

- دقيق

- في

- إضافة

- إضافي

- وبالإضافة إلى ذلك

- مميزات

- بعد

- عملاء

- AI

- الكل

- يسمح

- أيضا

- أمازون

- أمازون ليكس

- الأمازون SageMaker

- أمازون سيج ميكر جومب ستارت

- أمازون ويب سيرفيسز

- an

- و

- أعلن

- آخر

- إجابة

- الأجوبة

- كان متوقعا

- تطبيق

- التطبيقات

- تطبيقي

- نهج

- اقتراب

- مناسب

- هندسة معمارية

- هي

- مقالات

- مصطنع

- الذكاء الاصطناعي

- AS

- طلب

- الجوانب

- مساعدة

- أسوشيتد

- افترض

- At

- تعلق

- المعزز

- تلقائيا

- تجنب

- علم

- AWS

- الرصيد

- على أساس

- BE

- كان

- قبل

- يجري

- أقل من

- الفوائد

- ما بين

- Beyond

- المدونة

- زيادة

- أحذية طويلة

- على حد سواء

- البوتات

- نساعدك في بناء

- الأعمال

- لكن

- by

- CAN

- قدرات

- قدرة

- قادر على

- حقيبة

- الحالات

- مركز

- التحديات

- التغييرات

- chatbot

- خيار

- اختار

- اختيار

- سحابة

- الكود

- متماسك

- مجموعة شتاء XNUMX

- مجموعات

- مجموعة

- يجمع بين

- حول الشركة

- التوافق

- قهري

- مجمع

- التعقيدات

- عنصر

- شامل

- حساب

- الثقة

- الاعداد

- التواصل

- نظر

- النظر

- تتكون

- كنسولات

- بناء

- وعاء

- محتوى

- سياق الكلام

- قريني

- محادثة

- تحادثي

- المحادثات

- الطهي

- فعاله من حيث التكلفه

- استطاع

- زوجان

- تغطية

- خلق

- خلق

- يخلق

- خلق

- خلق

- زبون

- نجاح العميل

- دعم العملاء

- العملاء

- التخصيص

- البيانات

- قاعدة البيانات

- القرار

- الترتيب

- حدد

- تعريف

- نقل

- تقديم

- دمقرطة

- شرح

- نشر

- نشر

- تصميم

- مفصلة

- تفاصيل

- حدد

- المطور

- المطورين

- التطوير التجاري

- حوار

- مختلف

- صعبة

- توجيه

- اكتشاف

- ناقش

- توزيع

- عدة

- do

- عامل في حوض السفن

- وثيقة

- وثائق

- إلى أسفل

- مدفوع

- أثناء

- بسهولة

- الطُرق الفعّالة

- على نحو فعال

- فعالية

- كفاءة

- فعال

- بكفاءة

- جهد

- القضاء

- تضمين

- توظف

- تمكين

- تمكين

- تمكن

- نقطة النهاية

- جذاب

- محرك

- مهندس

- تعزيز

- تعزيز

- تعزيز

- يضمن

- مشروع

- بحث المؤسسات

- الشركات

- البيئة

- الأثير (ETH)

- الحدث/الفعالية

- مثال

- أمثلة

- ممارسة

- مصاريف

- الخبره في مجال الغطس

- خبرة

- تجربة

- اكتشف

- يستكشف

- الوجه

- تسهيل

- العوامل

- صقر

- شلالات

- مألوف

- الأسئلة الشائعة

- أسرع

- المميزات

- بنك الاحتياطي الفيدرالي

- مجال

- قم بتقديم

- تصفية

- أخيرا

- العثور على

- الاسم الأول

- مرونة

- تدفق

- تركز

- اتباع

- متابعيك

- في حالة

- شكل

- الإطار

- كثيرا

- الاصدقاء

- تبدأ من

- وظيفة

- إضافي

- علاوة على ذلك

- مستقبل

- الرأس مالية

- توليد

- ولدت

- يولد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- مولد كهربائي

- الحصول على

- معطى

- توجيه

- معالجة

- يملك

- he

- مساعدة

- مساعدة

- يساعد

- لها

- تاريخيا

- استضافت

- استضافة

- كيفية

- HTML

- HTTP

- HTTPS

- محور

- الانسان

- محدد

- if

- صورة

- صور

- التأثير

- التنفيذ

- استيراد

- تحسن

- تحسن

- تحسين

- in

- بما فيه

- دمج

- بشكل مستقل

- مؤشر

- مفهرس

- مبينا

- معلومات

- وأبلغ

- في البداية

- بدء

- إدخال

- مثل

- تعليمات

- دمج

- المتكاملة

- دمج

- التكامل

- رؤيتنا

- نية

- تفاعل

- التفاعلات

- التفاعلية

- إلى

- يدخل

- دعا

- يتضرع

- ينطوي

- تنطوي

- مسائل

- IT

- انها

- JPG

- المعرفة

- مختبرات

- لغة

- كبير

- على نطاق واسع

- قيادة

- تعلم

- تعلم

- الاستدانة

- الاستفادة من

- مثل

- على الأرجح

- محدود

- مستمع

- حي

- منخفض

- آلة

- آلة التعلم

- الرئيسية

- جعل

- القيام ب

- إدارة

- كثير

- تعظيم

- يجتمع

- آلية العمل

- طرق

- ML

- نموذج

- تصميم

- عارضات ازياء

- الأكثر من ذلك

- أكثر

- التحركات

- متعدد

- طبيعي

- اللغة الطبيعية

- معالجة اللغات الطبيعية

- فهم اللغة الطبيعية

- ضروري

- حاجة

- إحتياجات

- جديد

- التالي

- نلو

- لاحظ

- مراقبة

- of

- عرضت

- الوهب

- عروض

- رسميا

- on

- ONE

- المصدر المفتوح

- الأمثل

- الأمثل

- مزيد من الخيارات

- or

- أصلي

- أخرى

- لنا

- الناتج

- في الخارج

- على مدى

- الكلي

- صفقة

- جزء

- عاطفي

- مسار

- نفذ

- أداء

- تنفيذ

- وجهات

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- من فضلك

- منشور

- يحتمل

- قوة

- قوي

- عملية

- الشروط

- الهدايا

- أرسال

- مشاكل

- عملية المعالجة

- معالجة

- ينتج عنه

- بصورة صحيحة

- يثبت

- تزود

- المقدمة

- ويوفر

- توفير

- دفع

- بايثون

- سؤال وجواب

- جودة

- الاستفسارات

- سؤال

- الأسئلة المتكررة

- بسرعة

- نطاق

- <font style="vertical-align: inherit;"></font> في ايم بي بي ايس

- بدلا

- مؤخرا

- ذات صلة

- ذات الصلة

- إزالة

- طلبات

- تطلب

- مطلوب

- المتطلبات الأساسية

- يتطلب

- بحث

- الموارد

- استجابة

- ردود

- مسؤول

- نتيجة

- مما أدى

- النتائج

- مراجعة

- حق

- قوي

- يجري

- s

- sagemaker

- نفسه

- التدرجية

- تحجيم

- حجم

- مسح

- عالم

- نطاق

- أحرز هدفاً

- بسلاسة

- بحث

- الثاني

- أقسام

- مختار

- خدمة ذاتية، إخدم نفسك بنفسك

- كبير

- الخدمة

- خدماتنا

- خدمة

- طقم

- ضبط

- إعدادات

- عدة

- ينبغي

- عرض

- يظهر

- غلق

- بشكل ملحوظ

- الاشارات

- المقاس

- الأحجام

- So

- تطبيقات الكمبيوتر

- تطوير البرمجيات

- حل

- الحلول

- حل

- مصدر

- مصادر

- امتداد

- متخصصة

- محدد

- على وجه التحديد

- محدد

- الإنفاق

- كومة

- بدأت

- يبدأ

- خطوة

- خطوات

- تخزين

- متجر

- تخزين

- الإستراتيجيات

- نقاط القوة

- تحقيق النجاح

- هذه

- مناسب

- الدعم

- مدعومة

- نظام

- أنظمة

- تناسب

- أخذ

- يأخذ

- مهمة

- المهام

- فريق

- تقنيات

- تكنولوجيا

- تجربه بالعربي

- توليد النص

- من

- أن

- •

- المصدر

- من مشاركة

- منهم

- then

- وبالتالي

- تشبه

- هم

- طرف ثالث

- عتبة

- عبر

- الوقت

- مرات

- نصائح

- عملاق

- إلى

- اليوم

- أدوات

- تقليدي

- تحويل

- السفر

- نوع

- أنواع

- عادة

- فهم

- تم التحميل

- URL

- الأستعمال

- تستخدم

- حالة الاستخدام

- مستعمل

- مستخدم

- تجربة المستخدم

- المستخدمين

- يستخدم

- استخدام

- عادة

- يستخدم

- استخدام

- تشكيلة

- مختلف

- بواسطة

- افتراضي

- صوت

- طريق..

- طرق

- we

- الويب

- خدمات ويب

- كان

- متى

- التي

- واسع

- مدى واسع

- سوف

- مع

- في غضون

- بدون

- للعمل

- سير العمل

- عامل

- أعمال

- سنوات

- عائدات

- لصحتك!

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت