Dieser Beitrag wurde zusammen mit Hernan Figueroa, Sr. Manager Data Science bei Marubeni Power International, verfasst.

Marubeni Power International Inc (MPII) besitzt und investiert in Power-Business-Plattformen in Amerika. Eine wichtige Branche für MPII ist das Asset Management für erneuerbare Energien und Energiespeicheranlagen, die für die Reduzierung der COXNUMX-Intensität unserer Strominfrastruktur von entscheidender Bedeutung sind. Die Arbeit mit erneuerbaren Energieanlagen erfordert vorausschauende und reaktionsschnelle digitale Lösungen, da sich die Bedingungen für die Erzeugung erneuerbarer Energien und den Strommarkt ständig ändern. MPII verwendet eine Gebotsoptimierungs-Engine für maschinelles Lernen (ML), um vorgelagerte Entscheidungsprozesse bei der Verwaltung und dem Handel von Energieanlagen zu informieren. Diese Lösung hilft Marktanalysten, datengesteuerte Gebotsstrategien zu entwerfen und durchzuführen, die für die Rentabilität von Energieanlagen optimiert sind.

In diesem Beitrag erfahren Sie, wie Marubeni Marktentscheidungen optimiert, indem es die breite Palette von AWS-Analyse- und ML-Services nutzt, um eine robuste und kostengünstige Power-Bid-Optimierungslösung aufzubauen.

Lösungsüberblick

Strommärkte ermöglichen den Handel mit Strom und Energie, um Stromangebot und -nachfrage im Stromnetz auszugleichen und unterschiedliche Anforderungen an die Zuverlässigkeit des Stromnetzes zu erfüllen. Marktteilnehmer, wie z. B. Betreiber von MPII-Anlagen, bieten ständig Strom und Energiemengen auf diesen Strommärkten an, um Gewinne aus ihren Stromanlagen zu erzielen. Ein Marktteilnehmer kann gleichzeitig Gebote auf verschiedenen Märkten abgeben, um die Rentabilität eines Vermögenswerts zu steigern, muss jedoch die Leistungsgrenzen und Reaktionsgeschwindigkeiten des Vermögenswerts sowie andere Betriebsbeschränkungen des Vermögenswerts und die Interoperabilität dieser Märkte berücksichtigen.

Die Engine-Lösung zur Gebotsoptimierung von MPII verwendet ML-Modelle, um optimale Gebote für die Teilnahme an verschiedenen Märkten zu generieren. Die häufigsten Gebote sind Day-Ahead-Energiegebote, die 1 Tag vor dem eigentlichen Handelstag abgegeben werden sollten, und Echtzeit-Energiegebote, die 75 Minuten vor der Handelszeit abgegeben werden sollten. Die Lösung orchestriert die dynamische Angebotserstellung und den Betrieb einer Energieanlage und erfordert die Verwendung von Optimierungs- und Vorhersagefunktionen, die in ihren ML-Modellen verfügbar sind.

Die Power Bid-Optimierungslösung umfasst mehrere Komponenten, die bestimmte Rollen spielen. Lassen Sie uns die beteiligten Komponenten und ihre jeweilige Geschäftsfunktion durchgehen.

Datenerhebung und -aufnahme

Die Datenerfassungs- und Aufnahmeschicht verbindet sich mit allen vorgelagerten Datenquellen und lädt die Daten in den Data Lake. Gebote auf dem Strommarkt erfordern mindestens vier Arten von Eingaben:

- Strombedarfsprognosen

- Wettervorhersage

- Geschichte der Marktpreise

- Strompreisprognosen

Der Zugriff auf diese Datenquellen erfolgt ausschließlich über APIs. Daher müssen die Aufnahmekomponenten in der Lage sein, Authentifizierung, Datenbeschaffung im Pull-Modus, Datenvorverarbeitung und Datenspeicherung zu verwalten. Da die Daten stündlich abgerufen werden, ist auch ein Mechanismus zum Orchestrieren und Planen von Erfassungsaufträgen erforderlich.

Datenaufbereitung

Wie bei den meisten ML-Anwendungsfällen spielt die Datenaufbereitung eine entscheidende Rolle. Die Daten stammen aus unterschiedlichen Quellen in einer Reihe von Formaten. Bevor es für das ML-Modelltraining verwendet werden kann, muss es einige der folgenden Schritte durchlaufen:

- Konsolidieren Sie stündliche Datensätze basierend auf der Ankunftszeit. Ein vollständiger Datensatz muss alle Quellen enthalten.

- Erhöhen Sie die Qualität der Daten durch den Einsatz von Techniken wie Standardisierung, Normalisierung oder Interpolation.

Am Ende dieses Prozesses werden die kuratierten Daten bereitgestellt und für die weitere Nutzung bereitgestellt.

Modellschulung und -bereitstellung

Der nächste Schritt besteht darin, ein Modell zu trainieren und einzusetzen, das in der Lage ist, optimale Marktgebote für den Kauf und Verkauf von Energie vorherzusagen. Um das Risiko einer Minderleistung zu minimieren, verwendete Marubeni die Ensemble-Modellierungstechnik. Die Ensemble-Modellierung besteht aus der Kombination mehrerer ML-Modelle, um die Vorhersageleistung zu verbessern. Marubeni kombiniert die Ergebnisse externer und interner Vorhersagemodelle mit einem gewichteten Durchschnitt, um die Stärke aller Modelle zu nutzen. Die internen Modelle von Marubeni basieren auf Long Short-Term Memory (LSTM)-Architekturen, die gut dokumentiert und in TensorFlow einfach zu implementieren und anzupassen sind. Amazon Sage Maker unterstützt TensorFlow-Bereitstellungen und viele andere ML-Umgebungen. Das externe Modell ist proprietär und seine Beschreibung kann nicht in diesen Beitrag aufgenommen werden.

Im Anwendungsfall von Marubeni führen die Gebotsmodelle eine numerische Optimierung durch, um den Umsatz zu maximieren, indem eine modifizierte Version der in der Veröffentlichung verwendeten Zielfunktionen verwendet wird Möglichkeiten zur Energiespeicherung in CAISO.

SageMaker ermöglicht es Marubeni, ML- und numerische Optimierungsalgorithmen in einer einzigen Umgebung auszuführen. Dies ist kritisch, da während des internen Modelltrainings die Ausgabe der numerischen Optimierung als Teil der Vorhersageverlustfunktion verwendet wird. Weitere Informationen zum Umgang mit Anwendungsfällen der numerischen Optimierung finden Sie unter Lösen numerischer Optimierungsprobleme wie Zeitplanung, Routing und Zuordnung mit Amazon SageMaker Processing.

Wir stellen diese Modelle dann über Inferenzendpunkte bereit. Da regelmäßig neue Daten aufgenommen werden, müssen die Modelle neu trainiert werden, da sie mit der Zeit veraltet sind. Der Architekturabschnitt später in diesem Beitrag enthält weitere Details zum Lebenszyklus der Modelle.

Power-Gebotsdatengenerierung

Die Lösung prognostiziert auf Stundenbasis die optimalen Mengen und Preise, zu denen Strom am Markt – auch genannt – angeboten werden soll Gebote. Mengen werden in MW und Preise in $/MW gemessen. Gebote werden für mehrere Kombinationen von vorhergesagten und wahrgenommenen Marktbedingungen generiert. Die folgende Tabelle zeigt ein Beispiel für das Finale Gebotskurve Ausgabe für Betriebsstunde 17 an einem illustrativen Handelsknoten in der Nähe von Marubenis Büro in Los Angeles.

| Datum | Stunde | Markt | Ort | MW | PREISLISTE |

| 11/7/2022 | 17 | RT Energie | LCIENEGA_6_N001 | 0 | $0 |

| 11/7/2022 | 17 | RT Energie | LCIENEGA_6_N001 | 1.65 | $80.79 |

| 11/7/2022 | 17 | RT Energie | LCIENEGA_6_N001 | 5.15 | $105.34 |

| 11/7/2022 | 17 | RT Energie | LCIENEGA_6_N001 | 8 | $230.15 |

Dieses Beispiel stellt unsere Bereitschaft dar, 1.65 MW Strom zu bieten, wenn der Strompreis mindestens 80.79 $ beträgt, 5.15 MW, wenn der Strompreis mindestens 105.34 $ beträgt, und 8 MW, wenn der Strompreis mindestens 230.15 $ beträgt.

Unabhängige Systembetreiber (ISOs) überwachen die Strommärkte in den USA und sind für die Vergabe und Ablehnung von Angeboten verantwortlich, um die Zuverlässigkeit des Stromnetzes auf wirtschaftlichste Weise aufrechtzuerhalten. California Independent System Operator (CAISO) betreibt Strommärkte in Kalifornien und veröffentlicht Marktergebnisse stündlich vor dem nächsten Gebotsfenster. Durch den Querverweis der aktuellen Marktbedingungen mit ihrem Äquivalent auf der Kurve können Analysten auf optimale Einnahmen schließen. Die Power-Bid-Optimierungslösung aktualisiert zukünftige Gebote anhand neu eingehender Marktinformationen und neuer Modellvorhersagen

Überblick über die AWS-Architektur

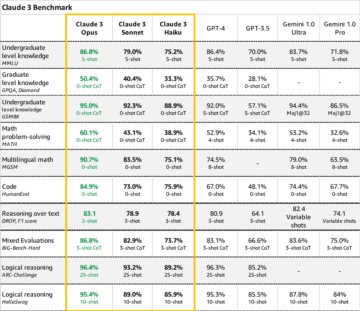

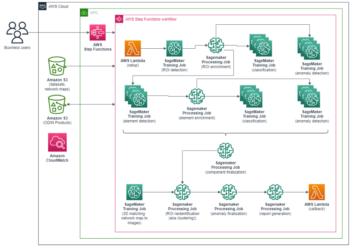

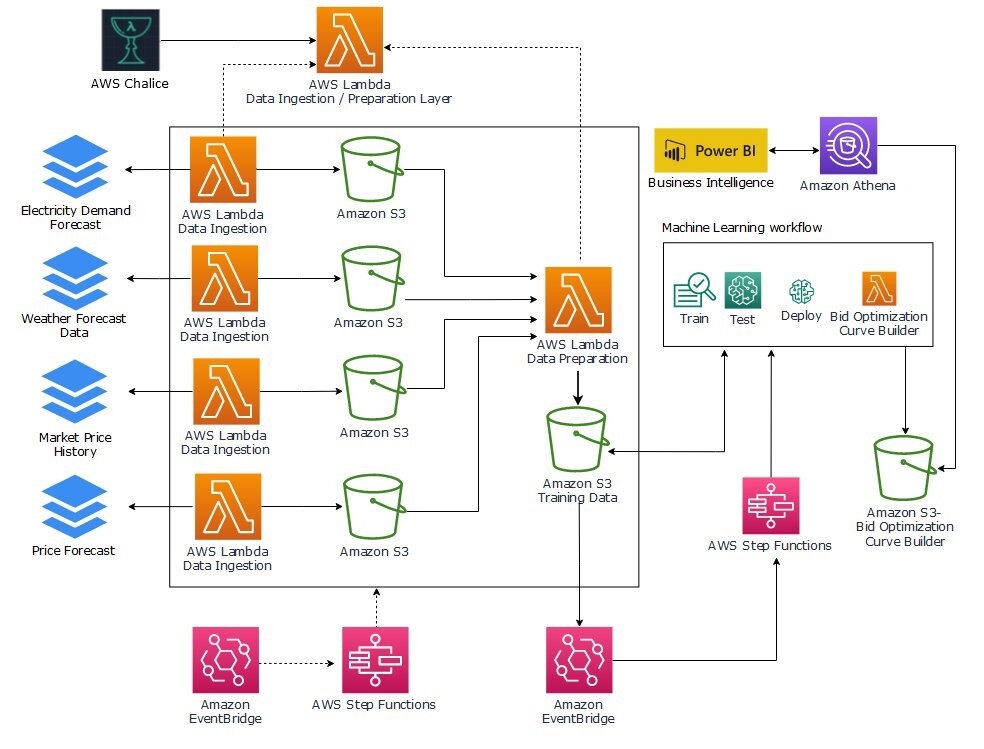

Die in der folgenden Abbildung dargestellte Lösungsarchitektur implementiert alle zuvor vorgestellten Schichten. Es verwendet die folgenden AWS-Services als Teil der Lösung:

- Amazon Simple Storage-Service (Amazon S3), um folgende Daten zu speichern:

- Preis-, Wetter- und Lastprognosedaten aus verschiedenen Quellen.

- Konsolidierte und erweiterte Daten, die für das Modelltraining verwendet werden können.

- Ausgabegebotskurven werden stündlich aktualisiert.

- Amazon Sage Maker zum Trainieren, Testen und Bereitstellen von Modellen, um optimierte Gebote über Inferenzendpunkte bereitzustellen.

- AWS Step-Funktionen um sowohl die Daten- als auch die ML-Pipelines zu orchestrieren. Wir verwenden zwei Zustandsmaschinen:

- Eine Zustandsmaschine, um die Datenerfassung zu orchestrieren und sicherzustellen, dass alle Quellen aufgenommen wurden.

- Eine Zustandsmaschine zur Orchestrierung der ML-Pipeline sowie des optimierten Bietgenerierungs-Workflows.

- AWS Lambda um Aufnahme-, Vorverarbeitungs- und Nachverarbeitungsfunktionen zu implementieren:

- Drei Funktionen zum Einlesen von Eingabedaten-Feeds, mit einer Funktion pro Quelle.

- Eine Funktion zur Konsolidierung und Vorbereitung der Daten für das Training.

- Eine Funktion, die die Preisprognose generiert, indem sie den in SageMaker bereitgestellten Endpunkt des Modells aufruft.

- Amazonas Athena um Entwicklern und Geschäftsanalysten SQL-Zugriff auf die generierten Daten zur Analyse und Fehlerbehebung zu gewähren.

- Amazon EventBridge um die Datenaufnahme und die ML-Pipeline nach einem Zeitplan und als Reaktion auf Ereignisse auszulösen.

In den folgenden Abschnitten gehen wir näher auf den Workflow ein.

Datenerhebung und -aufbereitung

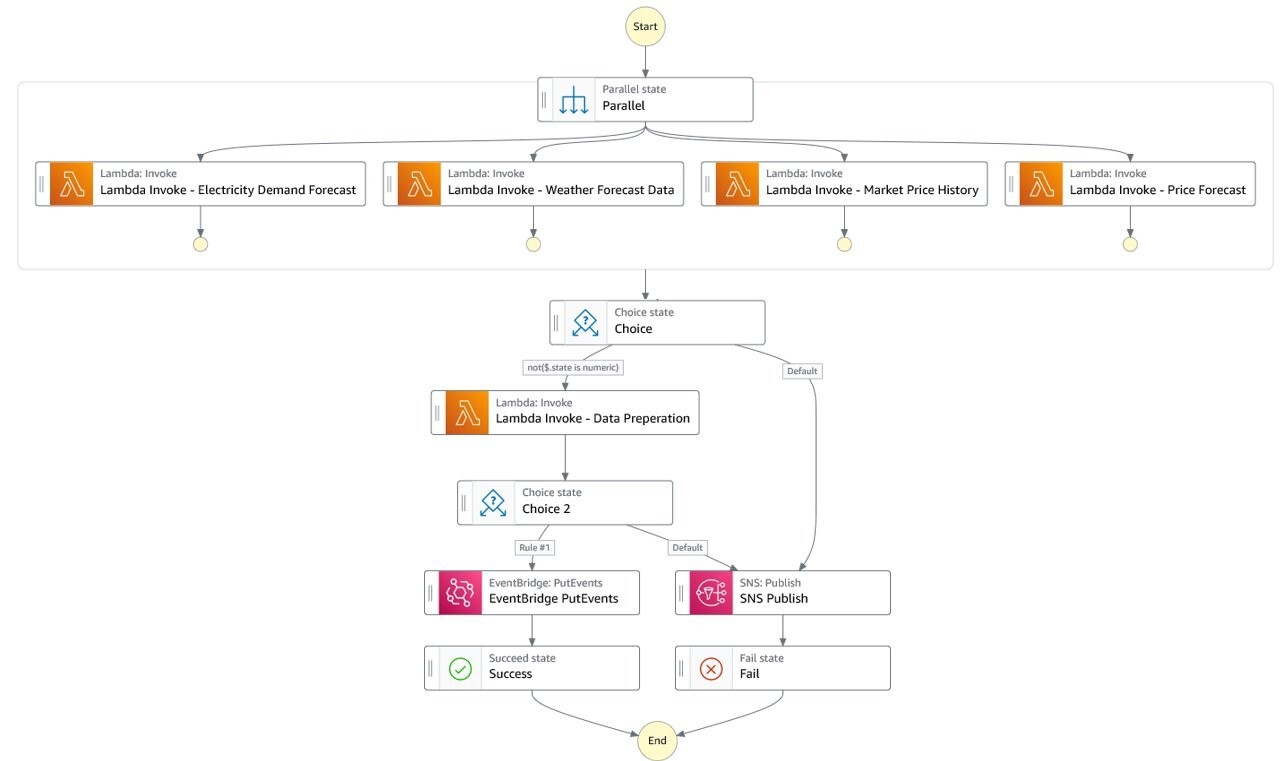

Stündlich wird die Step Functions-Zustandsmaschine für die Datenvorbereitung aufgerufen. Es ruft alle Lambda-Funktionen zur Datenaufnahme parallel auf und wartet, bis alle vier abgeschlossen sind. Die Datenerfassungsfunktionen rufen ihre jeweilige Quell-API auf und rufen Daten für die letzte Stunde ab. Jede Funktion speichert dann die empfangenen Daten in ihrem jeweiligen S3-Bucket.

Diese Funktionen haben eine gemeinsame Implementierungsbaseline, die Bausteine für die standardmäßige Datenbearbeitung wie Normalisierung oder Indexierung bereitstellt. Um dies zu erreichen, verwenden wir Lambda-Layer und AWS-Kelch, wie in beschrieben Verwenden von AWS Lambda Layers mit AWS Chalice. Dadurch wird sichergestellt, dass alle Entwickler dieselben Basisbibliotheken verwenden, um neue Datenvorbereitungslogiken zu erstellen, und die Implementierung wird beschleunigt.

Nachdem alle vier Quellen aufgenommen und gespeichert wurden, löst die Zustandsmaschine die Lambda-Funktion zur Datenvorbereitung aus. Strompreis-, Wetter- und Lastprognosedaten werden in JSON- und durch Zeichen getrennten Dateien empfangen. Jeder Datensatzteil jeder Datei trägt einen Zeitstempel, der verwendet wird, um Datenfeeds in einem Datensatz zu konsolidieren, der einen Zeitrahmen von 1 Stunde abdeckt.

Dieses Konstrukt bietet einen vollständig ereignisgesteuerten Workflow. Die Vorbereitung der Trainingsdaten wird gestartet, sobald alle erwarteten Daten aufgenommen wurden.

ML-Pipeline

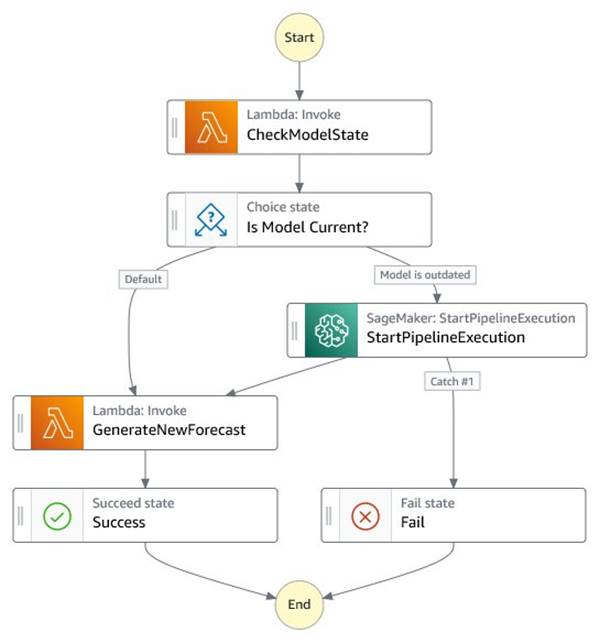

Nach der Datenvorbereitung werden die neuen Datensätze in Amazon S3 gespeichert. Eine EventBridge-Regel löst die ML-Pipeline über eine Step Functions-Zustandsmaschine aus. Die Zustandsmaschine steuert zwei Prozesse:

- Überprüfen Sie, ob das Modell zur Generierung der Gebotskurve aktuell ist

- Lösen Sie automatisch ein Neutraining des Modells aus, wenn die Leistung nachlässt oder Modelle älter als eine bestimmte Anzahl von Tagen sind

Wenn das Alter des aktuell bereitgestellten Modells um einen bestimmten Schwellenwert – beispielsweise 7 Tage – älter als der neueste Datensatz ist, startet die Step Functions-Zustandsmaschine die SageMaker-Pipeline, die einen neuen Inferenzendpunkt trainiert, testet und bereitstellt. Wenn die Modelle noch aktuell sind, überspringt der Workflow die ML-Pipeline und fährt mit dem Schritt der Angebotserstellung fort. Unabhängig vom Zustand des Modells wird bei Lieferung eines neuen stündlichen Datensatzes eine neue Gebotskurve generiert. Das folgende Diagramm veranschaulicht diesen Workflow. Standardmäßig ist die StartPipelineExecution Aktion ist asynchron. Wir können die Zustandsmaschine auf das Ende der Pipeline warten lassen, bevor sie den Gebotsgenerierungsschritt aufrufen, indem wir das 'Warten auf Rückruf' Möglichkeit.

Um die Kosten und die Zeit bis zur Markteinführung beim Aufbau einer Pilotlösung zu reduzieren, verwendete Marubeni Serverlose Amazon SageMaker-Inferenz. Dadurch wird sichergestellt, dass für die zugrunde liegende Infrastruktur, die für Schulung und Bereitstellung verwendet wird, nur bei Bedarf Gebühren anfallen. Dies erleichtert auch den Aufbau der Pipeline, da Entwickler die Infrastruktur nicht mehr verwalten müssen. Dies ist eine großartige Option für Workloads mit Leerlaufzeiten zwischen Datenverkehrsspitzen. Wenn die Lösung ausgereift ist und in die Produktion übergeht, wird Marubeni ihr Design überprüfen und eine Konfiguration übernehmen, die besser für eine vorhersehbare und kontinuierliche Nutzung geeignet ist.

Angebotserstellung und Datenabfrage

Die Lambda-Funktion zur Gebotsgenerierung ruft regelmäßig den Inferenzendpunkt auf, um stündliche Vorhersagen zu generieren, und speichert die Ausgabe in Amazon S3.

Entwickler und Geschäftsanalysten können die Daten dann mit Athena und Microsoft Power BI zur Visualisierung untersuchen. Per API können die Daten auch nachgelagerten Geschäftsanwendungen zur Verfügung gestellt werden. In der Pilotphase konsultieren die Betreiber die Gebotskurve visuell, um ihre Stromtransaktionsaktivitäten auf den Märkten zu unterstützen. Marubeni erwägt jedoch, diesen Prozess in Zukunft zu automatisieren, und diese Lösung bietet die notwendigen Grundlagen dafür.

Zusammenfassung

Diese Lösung ermöglichte es Marubeni, seine Datenverarbeitungs- und Aufnahmepipelines vollständig zu automatisieren und die Bereitstellungszeit seiner Vorhersage- und Optimierungsmodelle von Stunden auf Minuten zu reduzieren. Bid-Kurven werden jetzt automatisch generiert und auf dem neuesten Stand gehalten, wenn sich die Marktbedingungen ändern. Sie realisierten auch eine Kostenreduzierung von 80 % beim Wechsel von einem bereitgestellten Inferenz-Endpunkt zu einem serverlosen Endpunkt.

Die Prognoselösung von MPII ist eine der jüngsten Initiativen zur digitalen Transformation, die die Marubeni Corporation im Energiesektor einführt. MPII plant den Aufbau zusätzlicher digitaler Lösungen zur Unterstützung neuer Power-Business-Plattformen. MPII kann sich auf AWS-Services verlassen, um seine digitale Transformationsstrategie in vielen Anwendungsfällen zu unterstützen.

"Wir können uns auf die Verwaltung der Wertschöpfungskette für neue Geschäftsplattformen konzentrieren, da wir wissen, dass AWS die zugrunde liegende digitale Infrastruktur unserer Lösungen verwaltet."

– Hernan Figueroa, Senior Manager Data Science bei Marubeni Power International.

Weitere Informationen darüber, wie AWS Energieorganisationen bei ihren digitalen Transformations- und Nachhaltigkeitsinitiativen unterstützt, finden Sie unter AWS-Energie.

![]() Marubeni Power International ist eine Tochtergesellschaft der Marubeni Corporation. Die Marubeni Corporation ist ein bedeutendes japanisches Handels- und Investmentunternehmen. Die Mission von Marubeni Power International besteht darin, neue Geschäftsplattformen zu entwickeln, neue Energietrends und -technologien zu bewerten und das Stromportfolio von Marubeni in Amerika zu verwalten. Wenn Sie mehr über Marubeni Power erfahren möchten, schauen Sie vorbei https://www.marubeni-power.com/.

Marubeni Power International ist eine Tochtergesellschaft der Marubeni Corporation. Die Marubeni Corporation ist ein bedeutendes japanisches Handels- und Investmentunternehmen. Die Mission von Marubeni Power International besteht darin, neue Geschäftsplattformen zu entwickeln, neue Energietrends und -technologien zu bewerten und das Stromportfolio von Marubeni in Amerika zu verwalten. Wenn Sie mehr über Marubeni Power erfahren möchten, schauen Sie vorbei https://www.marubeni-power.com/.

Über die Autoren

Hernan Figueroa leitet die Initiativen zur digitalen Transformation bei Marubeni Power International. Sein Team wendet Datenwissenschaft und digitale Technologien an, um die Wachstumsstrategien von Marubeni Power zu unterstützen. Bevor er zu Marubeni kam, war Hernan Data Scientist an der Columbia University. Er hat einen Ph.D. in Elektrotechnik und einen BS in Computer Engineering.

Hernan Figueroa leitet die Initiativen zur digitalen Transformation bei Marubeni Power International. Sein Team wendet Datenwissenschaft und digitale Technologien an, um die Wachstumsstrategien von Marubeni Power zu unterstützen. Bevor er zu Marubeni kam, war Hernan Data Scientist an der Columbia University. Er hat einen Ph.D. in Elektrotechnik und einen BS in Computer Engineering.

Lino Brescia ist ein Principal Account Executive mit Sitz in NYC. Er verfügt über mehr als 25 Jahre Technologieerfahrung und kam 2018 zu AWS. Er verwaltet globale Unternehmenskunden bei der Transformation ihres Geschäfts mit AWS-Cloud-Services und der Durchführung umfangreicher Migrationen.

Lino Brescia ist ein Principal Account Executive mit Sitz in NYC. Er verfügt über mehr als 25 Jahre Technologieerfahrung und kam 2018 zu AWS. Er verwaltet globale Unternehmenskunden bei der Transformation ihres Geschäfts mit AWS-Cloud-Services und der Durchführung umfangreicher Migrationen.

Narcisse Zekpa ist Senior Solutions Architect mit Sitz in Boston. Er hilft Kunden im Nordosten der USA, ihre Geschäftstransformation durch innovative und skalierbare Lösungen in der AWS Cloud zu beschleunigen. Wenn Narcisse nicht baut, verbringt er gerne Zeit mit seiner Familie, reist, kocht, spielt Basketball und läuft.

Narcisse Zekpa ist Senior Solutions Architect mit Sitz in Boston. Er hilft Kunden im Nordosten der USA, ihre Geschäftstransformation durch innovative und skalierbare Lösungen in der AWS Cloud zu beschleunigen. Wenn Narcisse nicht baut, verbringt er gerne Zeit mit seiner Familie, reist, kocht, spielt Basketball und läuft.

Pedram Jahangiri ist ein Enterprise Solution Architect bei AWS mit einem Doktortitel in Elektrotechnik. Er verfügt über mehr als 10 Jahre Erfahrung in der Energie- und IT-Branche. Pedram verfügt über langjährige praktische Erfahrung in allen Aspekten von Advanced Analytics zum Aufbau quantitativer und umfangreicher Lösungen für Unternehmen durch Nutzung von Cloud-Technologien.

Pedram Jahangiri ist ein Enterprise Solution Architect bei AWS mit einem Doktortitel in Elektrotechnik. Er verfügt über mehr als 10 Jahre Erfahrung in der Energie- und IT-Branche. Pedram verfügt über langjährige praktische Erfahrung in allen Aspekten von Advanced Analytics zum Aufbau quantitativer und umfangreicher Lösungen für Unternehmen durch Nutzung von Cloud-Technologien.

Sarah Childer ist ein Account Manager mit Sitz in Washington DC. Sie ist eine ehemalige Lehrerin für Naturwissenschaften, die zur Cloud-Enthusiastin wurde und sich darauf konzentriert, Kunden auf ihrem Weg in die Cloud zu unterstützen. Sarah arbeitet gerne mit einem motivierten Team zusammen, das vielfältige Ideen fördert, um Kunden am besten mit den innovativsten und umfassendsten Lösungen auszustatten.

Sarah Childer ist ein Account Manager mit Sitz in Washington DC. Sie ist eine ehemalige Lehrerin für Naturwissenschaften, die zur Cloud-Enthusiastin wurde und sich darauf konzentriert, Kunden auf ihrem Weg in die Cloud zu unterstützen. Sarah arbeitet gerne mit einem motivierten Team zusammen, das vielfältige Ideen fördert, um Kunden am besten mit den innovativsten und umfassendsten Lösungen auszustatten.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/how-marubeni-is-optimizing-market-decisions-using-aws-machine-learning-and-analytics/

- :Ist

- $UP

- 1

- 10

- 100

- 2018

- 7

- 8

- a

- Fähig

- Über uns

- beschleunigen

- Zugang

- Zugriff

- Konto

- Erreichen

- über

- Action

- Aktivitäten

- Zusätzliche

- Adresse

- adoptieren

- vorantreiben

- advanced

- Vorteil

- Algorithmen

- Alle

- Zuteilung

- neben

- Amazon

- Amazon Sage Maker

- Amerika

- Betrag

- Analyse

- Business Analysten

- Analytik

- und

- Angeles

- Bienen

- APIs

- Anwendungen

- Architektur

- SIND

- Ankunft

- AS

- Aspekte

- Vermögenswert

- Vermögensverwaltung

- Details

- At

- Augmented

- Authentifizierung

- automatisieren

- Im Prinzip so, wie Sie es von Google Maps kennen.

- automatisieren

- verfügbar

- durchschnittlich

- AWS

- AWS Lambda

- AWS Maschinelles Lernen

- Balance

- Base

- basierend

- Baseline

- Grundlage

- Basketball

- BE

- weil

- werden

- Bevor

- Sein

- BESTE

- zwischen

- Gebot

- Blockiert

- Boston

- breit

- bauen

- Building

- Geschäft

- Geschäftsanwendungen

- Geschäftsumwandlung

- Kauf

- by

- Kalifornien

- rufen Sie uns an!

- namens

- Aufruf

- Aufrufe

- CAN

- kann keine

- Fähigkeiten

- fähig

- Kohlenstoff

- Häuser

- Fälle

- sicher

- Kette

- Übernehmen

- Ändern

- Charakter

- Gebühren

- aus der Ferne überprüfen

- Cloud

- Cloud-Services

- Sammlung

- Columbia

- Kombinationen

- Vereinigung

- gemeinsam

- abschließen

- Komponenten

- umfassend

- Computer

- Informationstechnik

- Bedingungen

- Konfiguration

- Konglomerat

- Connects

- Geht davon

- Berücksichtigung

- konsolidieren

- ständig

- Einschränkungen

- konstruieren

- verbraucht

- Verbrauch

- ständig

- Kochen

- KONZERN

- Kosten

- Kostenreduzierung

- kostengünstiger

- Abdeckung

- Abdeckung

- kritischem

- Querverweise

- kuratiert

- Strom

- Zur Zeit

- Kurve

- Kunden

- anpassen

- technische Daten

- Datensee

- Datenaufbereitung

- Datenverarbeitung

- Datenwissenschaft

- Datenwissenschaftler

- Datenspeichervorrichtung

- datengesteuerte

- Datensätze

- Datum

- Tag

- dc

- Decision Making

- Entscheidungen

- Standard

- Lieferanten

- Demand

- einsetzen

- Einsatz

- Bereitstellen

- Einsatz

- Implementierungen

- setzt ein

- beschrieben

- Beschreibung

- Design

- Detail

- Details

- entwickeln

- Entwickler

- anders

- digital

- Digitale Transformation

- diskutieren

- disparat

- abwechslungsreich

- im

- dynamisch

- jeder

- Früher

- einfacher

- Einfache

- Die elektrische

- Elektrotechnik

- Strom

- ermöglichen

- freigegeben

- ermöglicht

- ermutigt

- Endpunkt

- Energie

- Motor

- Entwicklung

- gewährleisten

- sorgt

- Unternehmen

- Unternehmenskunden

- Unternehmen

- Enthusiast

- Arbeitsumfeld

- Umgebungen

- Äquivalent

- Äther (ETH)

- Veranstaltungen

- Jedes

- Beispiel

- ausschließlich

- Exekutive

- erwartet

- ERFAHRUNGEN

- ERKUNDEN

- extern

- Familie

- Abgerufen

- Abbildung

- Reichen Sie das

- Mappen

- Finale

- Setzen Sie mit Achtsamkeit

- konzentriert

- Folgende

- Aussichten für

- Prognose

- Früher

- Foundations

- FRAME

- frisch

- für

- voll

- Funktion

- Funktionalität

- Funktionen

- weiter

- Zukunft

- erzeugen

- erzeugt

- erzeugt

- Generation

- Global

- Go

- groß

- Gitter

- Wachstum

- praktische

- Haben

- Unternehmen

- hilft

- hält

- STUNDEN

- Ultraschall

- Hilfe

- aber

- HTML

- HTTPS

- Ideen

- Leerlauf

- implementieren

- Implementierung

- implementiert

- wichtig

- in

- das

- inklusive

- Dazu gehören

- Eingehende

- Erhöhung

- unabhängig

- Energiegewinnung

- Information

- Infrastruktur

- Initiativen

- innovativ

- Eingabe

- intern

- International

- Flexible Kommunikation

- Investition

- Investiert

- ruft auf

- beteiligt

- IT

- IT Industrie

- SEINE

- Japanisch

- Jobs

- beigetreten

- Beitritt

- Reise

- jpg

- JSON

- Kicks

- Wissen

- Wissend

- See

- großflächig

- neueste

- Start

- Schicht

- Lagen

- umwandeln

- LERNEN

- lernen

- Nutzung

- Bibliotheken

- Lebenszyklus

- Gefällt mir

- Grenzen

- Belastung

- Belastungen

- Lang

- länger

- die

- Los Angeles

- Verlust

- Maschine

- Maschinelles Lernen

- Maschinen

- gemacht

- halten

- Dur

- MACHT

- verwalten

- Management

- Manager

- Managed

- flächendeckende Gesundheitsprogramme

- Manipulation

- viele

- Markt

- Marktbedingungen

- Märkte

- reift

- Maximieren

- Mechanismus

- Memory

- Microsoft

- minimieren

- Minuten

- Ziel

- ML

- Model

- Modell

- Modellieren

- für

- geändert

- mehr

- vor allem warme

- motiviert

- bewegt sich

- mehrere

- In der Nähe von

- notwendig,

- Need

- erforderlich

- Bedürfnisse

- Neu

- weiter

- Knoten

- Anzahl

- NYC

- Ziel

- erhalten

- of

- angeboten

- Office

- on

- EINEM

- arbeitet

- die

- Betrieb

- Betriebs-

- Operator

- Betreiber

- optimal

- Optimierung

- optimiert

- Optimierung

- Option

- Organisationen

- Andere

- Ausgabe

- Besitzt

- Parallel

- Teil

- Teilnehmer

- Frage der Teilnhabe

- passt

- wahrgenommen

- ausführen

- Leistung

- Zeiträume

- Phase

- Pilot

- Pipeline

- Pläne

- Plattformen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Play

- spielend

- Mappe

- Post

- Werkzeuge

- Power BI

- Labor-Stromversorgungen

- Vorhersagbar

- vorhergesagt

- Vorhersage

- Prognose

- Prognosen

- sagt voraus,

- Danach

- vorgeführt

- Preis

- Preisprognose

- Preise

- Principal

- Vor

- Probleme

- Prozessdefinierung

- anpassen

- Verarbeitung

- Produktion

- Rentabilität

- profite

- Eigentums-

- die

- bietet

- Publikationen

- Veröffentlicht

- Qualität

- quantitativ

- bereit

- Echtzeit

- realisiert

- Received

- kürzlich

- Rekord

- Veteran

- Ungeachtet

- Zuverlässigkeit

- verlassen

- Erneuerbar

- erneuerbare Energie

- representiert

- falls angefordert

- erfordert

- diejenigen

- Antwort

- für ihren Verlust verantwortlich.

- ansprechbar

- Die Ergebnisse

- Umschulung

- Einnahmen

- Überprüfen

- Risiko

- robust

- Rollen

- Rollen

- Regel

- Führen Sie

- Laufen

- s

- sagemaker

- gleich

- skalierbaren

- Zeitplan

- Wissenschaft

- Wissenschaftler

- Abschnitt

- Abschnitte

- Bibliotheken

- in XNUMX Minuten

- brauchen

- Serverlos

- Leistungen

- kompensieren

- Teilen

- kurzfristig

- sollte

- Konzerte

- Einfacher

- gleichzeitig

- Single

- So

- Lösung

- Lösungen

- einige

- Bald

- Quelle

- Quellen

- Sourcing

- spezifisch

- Geschwindigkeiten

- Ausgabe

- SQL

- Standard

- Bundesstaat

- stetig

- Schritt

- Shritte

- Immer noch

- storage

- speichern

- gelagert

- Läden

- Strategien

- Strategie

- Stärke

- abschicken

- eingereicht

- Tochtergesellschaft

- so

- liefern

- Angebot und Nachfrage

- Support

- Unterstützung

- Unterstützt

- Nachhaltigkeit

- System

- Tabelle

- Nehmen

- Team

- Techniken

- Technologies

- Technologie

- Tensorfluss

- Test

- Tests

- zur Verbesserung der Gesundheitsgerechtigkeit

- Das

- Die Zukunft

- Der Staat

- ihr

- deswegen

- Diese

- Durch

- Zeit

- Zeitstempel

- zu

- Trading

- der Verkehr

- Training

- Ausbildung

- schult Ehrenamtliche

- Transaktion

- Transformieren

- Transformation

- Transformationsstrategie

- Übergänge

- Reise

- Trends

- auslösen

- Turned

- Typen

- uns

- zugrunde liegen,

- Universität

- Updates

- Upstream-Daten

- us

- Anwendungsbereich

- -

- Anwendungsfall

- Wert

- verschiedene

- Version

- Visualisierung

- warten

- Washington

- Washington, D.C

- Weg..

- Wetter

- GUT

- welche

- werden wir

- Bereitschaft

- mit

- .

- Arbeitsablauf.

- arbeiten,

- würde

- Jahr

- Zephyrnet