Das letzte Jahrzehnt der Industrie 4.0-Revolution hat den Wert und die Bedeutung des maschinellen Lernens (ML) in allen Branchen und Umgebungen gezeigt, mit mehr Einfluss auf die Fertigung als möglicherweise jede andere Anwendung. Organisationen, die eine stärker automatisierte, zuverlässigere und kostengünstigere Strategie für operative Technologien (OT) implementieren, haben den Weg bereitet und die Vorteile von ML bei der Vorhersage von Ausfällen an Fließbändern erkannt, um kostspielige und ungeplante Ausfallzeiten zu vermeiden. Dennoch bleiben Herausforderungen für Teams jeder Größe, um schnell und mit wenig Aufwand den Wert der ML-basierten Anomalieerkennung zu demonstrieren, um das Management und die Finanzverantwortlichen davon zu überzeugen, das für die Implementierung dieser neuen Technologien erforderliche Budget bereitzustellen. Ohne Zugang zu Datenwissenschaftlern für die Modellschulung oder ML-Spezialisten zur Bereitstellung von Lösungen auf lokaler Ebene schien die Akzeptanz für Teams in der Fabrik unerreichbar.

Jetzt können Teams, die Sensordatensignale von Maschinen in der Fabrik sammeln, die Leistungsfähigkeit von Diensten wie erschließen Amazon-Timestream, Amazon Lookout für Ausrüstung und AWS IoT-Kern zum einfachen Hochfahren und Testen eines vollständig produktionsbereiten Systems am lokalen Edge, um katastrophale Ausfallzeiten zu vermeiden. Lookout for Equipment verwendet Ihr einzigartiges ML-Modell, um eingehende Sensordaten in Echtzeit zu analysieren und Frühwarnzeichen, die zu Maschinenausfällen führen könnten, genau zu identifizieren. Das bedeutet, dass Sie Geräteanomalien schnell und präzise erkennen, Probleme schnell diagnostizieren, Maßnahmen ergreifen können, um teure Ausfallzeiten zu reduzieren und Fehlalarme zu reduzieren. Reaktionsteams können mit spezifischen Punkten darauf aufmerksam gemacht werden, welche Sensoren das Problem anzeigen und wie groß die Auswirkungen auf das erkannte Ereignis sind.

In diesem Beitrag zeigen wir Ihnen, wie Sie ein System einrichten können, um Ereignisse in Ihrer Fabrikhalle mit einem trainierten Modell zu simulieren und abnormales Verhalten mit Timestream, Lookout for Equipment und zu erkennen AWS Lambda Funktionen. Die Schritte in diesem Beitrag betonen die AWS-Managementkonsole UI, die zeigt, wie Techniker ohne Entwicklerhintergrund oder starke Programmierkenntnisse einen Prototyp erstellen können. Die Verwendung simulierter Sensorsignale ermöglicht es Ihnen, Ihr System zu testen und Vertrauen zu gewinnen, bevor Sie zur Produktion übergehen. Schließlich verwenden wir in diesem Beispiel Amazon Simple Notification Service (Amazon SNS), um zu zeigen, wie Teams Benachrichtigungen über vorhergesagte Ereignisse erhalten und reagieren können, um katastrophale Auswirkungen von Fließbandausfällen zu vermeiden. Darüber hinaus können Teams verwenden Amazon QuickSight für weitere Analysen und Dashboards für die Berichterstattung.

Lösungsüberblick

Zu Beginn sammeln wir zunächst einen historischen Datensatz aus Ihren werkseitigen Sensormesswerten, nehmen die Daten auf und trainieren das Modell. Mit dem trainierten Modell bauen wir dann auf IoT-Gerätesimulator MQTT-Signale zu einem Thema zu veröffentlichen, das das Testen des Systems ermöglicht, um gewünschte Produktionseinstellungen zu identifizieren, bevor Produktionsdaten verwendet werden, wodurch die Kosten niedrig gehalten werden.

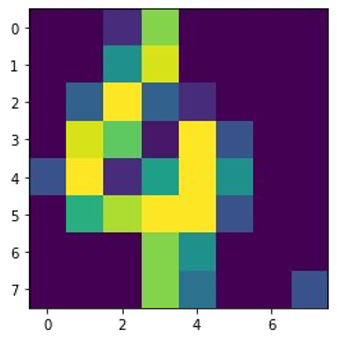

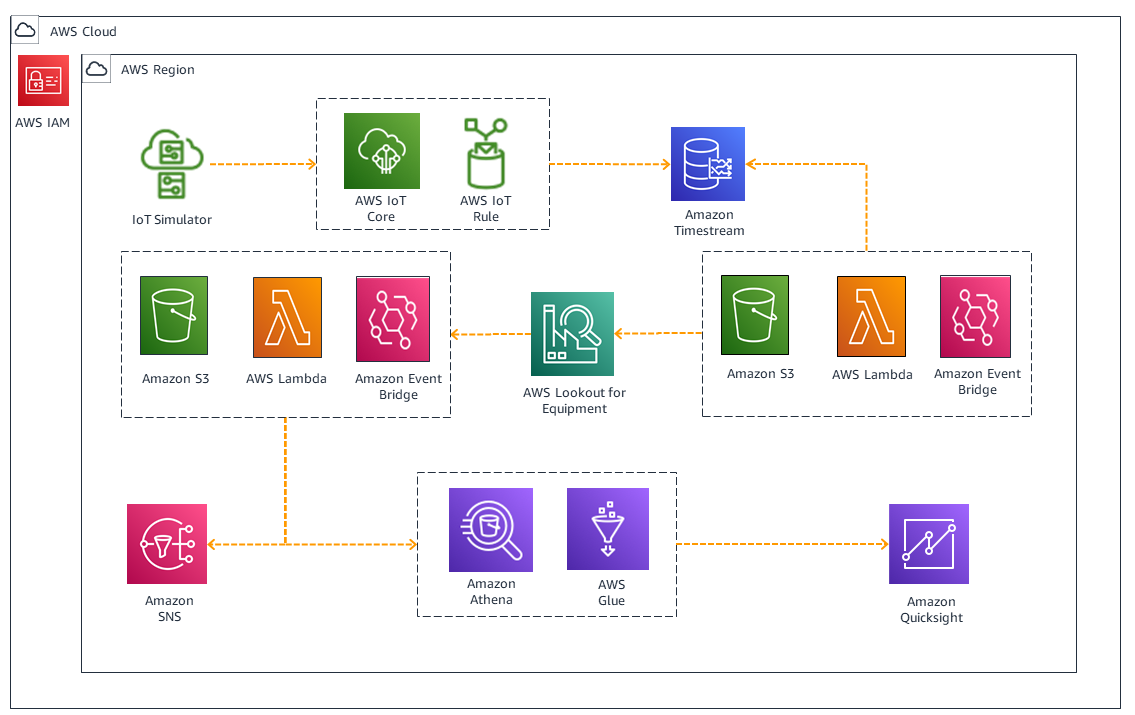

Das folgende Diagramm zeigt unsere Lösungsarchitektur.

Der Workflow enthält die folgenden Schritte:

- Verwenden Sie Beispieldaten, um das Lookout for Equipment-Modell zu trainieren, und die bereitgestellten beschrifteten Daten, um die Modellgenauigkeit zu verbessern. Bei einer Abtastrate von 5 Minuten können wir das Modell in 20–30 Minuten trainieren.

- Führen Sie eine AWS CloudFormation Vorlage, um IoT Simulator zu aktivieren, und erstellen Sie eine Simulation, um ein MQTT-Thema im Format der Sensordatensignale zu veröffentlichen.

- Erstellen Sie eine IoT-Regelaktion, um das MQTT-Thema zu lesen und die Topic-Nutzdaten zur Speicherung an Timestream zu senden. Dies sind die Echtzeitdatensätze, die für Rückschlüsse mit dem ML-Modell verwendet werden.

- Richten Sie eine Lambda-Funktion ein, die ausgelöst wird durch Amazon EventBridge zum Konvertieren von Daten in das CSV-Format für Lookout for Equipment.

- Erstellen Sie eine Lambda-Funktion, um die Ausgabedatei für Lookout for Equipment-Modellrückschlüsse zu parsen Amazon Simple Storage-Service (Amazon S3) und, wenn ein Fehler vorhergesagt wird, eine E-Mail an die konfigurierte Adresse senden. Zusätzlich verwenden AWS-Kleber, Amazonas Athenaund QuickSight, um die Beiträge der Sensordaten zum vorhergesagten Fehlerereignis zu visualisieren.

Voraussetzungen:

Sie benötigen Zugriff auf ein AWS-Konto, um die Umgebung für die Anomalieerkennung einzurichten.

Simulieren Sie Daten und nehmen Sie sie in die AWS Cloud auf

Führen Sie die folgenden Schritte aus, um Ihre Daten- und Erfassungskonfiguration einzurichten:

- Laden Sie die Trainingsdatei herunter subsystem-08_multisensor_training.csv und die Etikettendatei label_data.csv. Speichern Sie die Dateien lokal.

- Erstellen Sie auf der Amazon S3-Konsole in Ihrer bevorzugten Region einen Bucket mit einem eindeutigen Namen (z. B.

l4e-training-data), unter Verwendung der Standardkonfigurationsoptionen. - Öffnen Sie den Eimer und wählen Sie Hochladen und dann Hinzufügen von Dateien.

- Laden Sie die Trainingsdaten in einen Ordner namens hoch

/training-dataund die Etikettendaten in einen Ordner namens/labels.

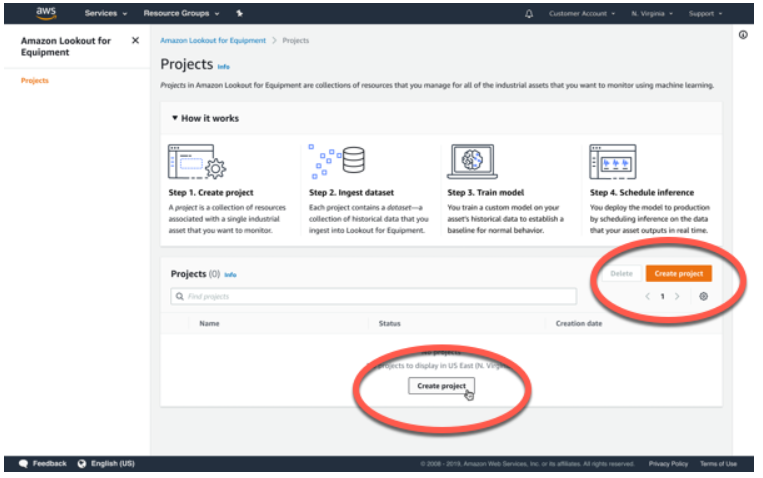

Als Nächstes erstellen Sie das ML-Modell, das mit den Daten aus dem S3-Bucket trainiert werden soll. Dazu müssen Sie zunächst ein Projekt erstellen.

- Wählen Sie in der Lookout for Equipment-Konsole aus Projekt anlegen.

- Benennen Sie das Projekt und wählen Sie es aus Projekt anlegen.

- Auf dem Datensatz hinzufügen Geben Sie auf der Seite Ihren S3-Bucket-Standort an.

- Verwenden Sie die Standardeinstellungen für Erstellen Sie eine neue Rolle und Aktivieren Sie CloudWatch-Protokolle.

- Auswählen Nach Dateiname für Methode zur Schemaerkennung.

- Auswählen Beginnen Sie mit der Einnahme.

Die Aufnahme dauert einige Minuten.

- Wenn die Aufnahme abgeschlossen ist, können Sie die Details des Datensatzes überprüfen, indem Sie wählen Datensatz anzeigen.

- Scrollen Sie auf der Seite nach unten und überprüfen Sie die Details per Sensor .

- Scrollen Sie zum Ende der Seite, um zu sehen, dass die Sensorqualität für Daten von drei der Sensoren gekennzeichnet ist

Low. - Wählen Sie alle Sensordatensätze außer den drei mit Niedriger Note aus.

- Auswählen

Modell erstellen.

- Auf dem Geben Sie Modelldetails an Seite, geben Sie dem Modell einen Namen und wählen Sie aus Weiter.

- Auf dem Eingangsdaten konfigurieren geben Sie Werte für die Trainings- und Bewertungseinstellungen und eine Abtastrate ein (für diesen Beitrag 1 Minute).

- Überspringen Sie die Off-Time-Erkennung Einstellungen und wählen Weiter.

- Auf dem Geben Sie Datenetiketten an Geben Sie auf der Seite S3 den Speicherort des SXNUMX-Ordners an, in dem sich die Etikettendaten befinden.

- Auswählen Erstellen Sie eine neue Rolle.

- Auswählen

Weiter.

- Auf dem Überprüfen und trainieren Seite wählen Beginne zu üben.

Bei einer Abtastrate von 5 Minuten sollte das Erstellen des Modells 20 bis 30 Minuten dauern.

Während das Modell erstellt wird, können wir den Rest der Architektur einrichten.

Sensordaten simulieren

- Auswählen Stack starten um eine CloudFormation-Vorlage zu starten, um die simulierten Sensorsignale einzurichten IoT-Simulator.

- Navigieren Sie nach dem Start der Vorlage zur CloudFormation-Konsole.

- Auf dem Stacks Seite wählen

IoTDeviceSimulator, um die Stapeldetails anzuzeigen. - Auf dem Ausgänge Registerkarte finden Sie die

ConsoleURLSchlüssel und den entsprechenden URL-Wert.

- Wählen Sie die URL aus, um die Anmeldeseite des IoT-Gerätesimulators zu öffnen.

- Erstellen Sie einen Benutzernamen und ein Passwort und wählen Sie aus ANMELDEN.

- Speichern Sie Ihre Anmeldeinformationen für den Fall, dass Sie sich später erneut anmelden müssen.

- Wählen Sie in der Menüleiste des IoT-Gerätesimulators aus Gerätetypen.

- Geben Sie einen Gerätetypnamen ein, z

My_testing_device. - Geben Sie ein MQTT-Thema ein, z

factory/line/station/simulated_testing. - Auswählen

Attribute hinzufügen.

- Geben Sie die Werte für das Attribut ein

signal5, wie im folgenden Screenshot gezeigt. - Auswählen

Speichern.

- Auswählen Attribute hinzufügen erneut und fügen Sie die verbleibenden Attribute hinzu, um den Beispielsignaldaten zu entsprechen, wie in der folgenden Tabelle gezeigt.

| . | Signal5 | Signal6 | Signal7 | Signal8 | Signal48 | Signal49 | Signal78 | Signal109 | Signal120 | Signal121 |

| Sneaker | 95 | 347 | 27 | 139 | 458 | 495 | 675 | 632 | 742 | 675 |

| Hi | 150 | 460 | 217 | 252 | 522 | 613 | 812 | 693 | 799 | 680 |

- Auf dem Simulationen Tab, wählen Sie Simulation hinzufügen.

- Geben Sie der Simulation einen Namen.

- Angeben Simulationstyp as Benutzer erstellt, Gerätetyp als kürzlich erstelltes Gerät, Datenübertragungsintervall als 60 und Dauer der Datenübertragung als 3600.

- Starten Sie schließlich die soeben erstellte Simulation und sehen Sie sich die generierten Nutzlasten an Simulationsdetails Seite durch Auswahl Anzeigen.

Jetzt, da Signale generiert werden, können wir IoT Core so einrichten, dass es die MQTT-Themen liest und die Nutzlasten an die Timestream-Datenbank weiterleitet.

- Auf der IoT Core-Konsole unter Nachrichtenweiterleitung Wählen Sie im Navigationsbereich Regeln.

- Auswählen Regel erstellen.

- Geben Sie einen Regelnamen ein und wählen Sie aus Weiter.

- Geben Sie die folgende SQL-Anweisung ein, um alle Werte aus dem veröffentlichten MQTT-Thema abzurufen:

- Auswählen Weiter.

- Aussichten für Regelaktionen, suchen Sie nach der Timestream-Tabelle.

- Auswählen Erstellen Sie eine Timestream-Datenbank.

Ein neuer Tab öffnet sich mit der Timestream-Konsole.

- Auswählen Standarddatenbank.

- Benennen Sie die Datenbank

sampleDBund wählen Sie Datenbank erstellen.

Sie werden zur Timestream-Konsole weitergeleitet, wo Sie die von Ihnen erstellte Datenbank anzeigen können.

- Kehren Sie zur Registerkarte IoT Core zurück und wählen Sie aus

sampleDBfür Name der Datenbank. - Auswählen Timestream-Tabelle erstellen um der Datenbank eine Tabelle hinzuzufügen, in der die Sensordatensignale gespeichert werden.

- Auf der Timestream-Konsole Tabelle erstellen Tab, wählen Sie

sampleDBfür Name der Datenbank, eingebensignalTablefür Tabellenname, und wähle Tabelle erstellen. - Kehren Sie zur Registerkarte der IoT Core-Konsole zurück, um die Routingregel für IoT-Nachrichten abzuschließen.

- Enter

Simulated_signalfür Dimensionsname und 1 für Maßwert, Dann wählen Neue Rolle erstellen.

- Nennen Sie die Rolle

TimestreamRoleund wählen Sie Weiter. - Auf dem Überprüfen und erstellen Seite wählen Erstellen.

Sie haben jetzt eine Regelaktion in IoT Core hinzugefügt, die die im MQTT-Thema veröffentlichten Daten an eine Timestream-Datenbank weiterleitet.

Timestream zur Analyse abfragen

Führen Sie die folgenden Schritte aus, um Timestream zur Analyse abzufragen:

- Überprüfen Sie, ob die Daten in der Datenbank gespeichert sind, indem Sie zur Timestream-Konsole navigieren und auswählen Abfrageeditor.

- Auswählen Tisch auswählen, wählen Sie dann das Optionsmenü und Datenvorschau.

- Auswählen Führen Sie um die Tabelle abzufragen.

Jetzt, da Daten im Stream gespeichert werden, können Sie Lambda und EventBridge verwenden, um alle 5 Minuten Daten aus der Tabelle abzurufen, zu formatieren und an Lookout for Equipment für Inferenz- und Vorhersageergebnisse zu senden.

- Wählen Sie auf der Lambda-Konsole Funktion erstellen.

- Aussichten für Laufzeit, wählen Python 3.9.

- Aussichten für SchichtquelleWählen Geben Sie einen ARN an.

- Geben Sie den korrekten ARN für Ihre Region aus dem ein AWS Pandas-Ressource.

- Auswählen Speichern.

- Geben Sie den folgenden Code in die Funktion ein und bearbeiten Sie ihn so, dass er dem S3-Pfad zu einem Bucket mit dem Ordner entspricht

/input(Erstellen Sie einen Bucket-Ordner für diese Datenstromdateien, falls noch nicht vorhanden).

Dieser Code verwendet die awswrangler Bibliothek zum einfachen Formatieren der Daten im erforderlichen CSV-Formular, das für Lookout for Equipment benötigt wird. Die Lambda-Funktion benennt die Datendateien auch dynamisch nach Bedarf.

- Auswählen Deploy.

- Auf dem Konfiguration Tab, wählen Sie Allgemeine Konfiguration.

- Aussichten für Timeout, wählen 5 Мinuten.

- Im Funktionsübersicht Wählen Sie im Abschnitt Trigger hinzufügen mit EventBridge als Quelle.

- Auswählen Erstellen Sie eine neue Regel.

- Benennen Sie die Regel

eventbridge-cron-job-lambda-read-timestreamund fügenrate(5 minutes)für Zeitplanausdruck. - Auswählen

Speichern.

- Fügen Sie Ihrer Lambda-Ausführungsrolle die folgende Richtlinie hinzu:

Prognostizieren Sie Anomalien und benachrichtigen Sie Benutzer

Führen Sie die folgenden Schritte aus, um die Anomalievorhersage und -benachrichtigung einzurichten:

- Kehren Sie zur Projektseite Lookout for Equipment zurück und wählen Sie aus Zeitplan-Inferenz.

- Benennen Sie den Zeitplan und geben Sie das zuvor erstellte Modell an.

- Aussichten für Eingabedaten, geben Sie die S3 an

/inputSpeicherort, an dem Dateien mit der Lambda-Funktion und dem EventBridge-Trigger geschrieben werden. - Sept Häufigkeit des Hochladens von Daten zu 5 Мinuten und geh Offset-Verzögerungszeit at 0 Мinuten.

- Legen Sie mit einen S3-Pfad fest

/outputals Ordner und belassen Sie andere Standardwerte. - Auswählen Zeitplan-Inferenz.

Überprüfen Sie nach 5 Minuten den S3 /output Pfad, um zu überprüfen, ob Vorhersagedateien erstellt wurden. Weitere Informationen zu den Ergebnissen finden Sie unter Überprüfung der Inferenzergebnisse.

Schließlich erstellen Sie eine zweite Lambda-Funktion, die eine Benachrichtigung mit Amazon SNS auslöst, wenn eine Anomalie vorhergesagt wird.

- Wählen Sie in der Amazon SNS-Konsole aus Thema erstellen.

- Aussichten für Name und Vorname, eingeben

emailnoti. - Auswählen Erstellen.

- Im Details Abschnitt, für TypWählen Normen.

- Auswählen

Thema erstellen.

- Auf dem Abonnements Registerkarte, erstellen Sie ein Abonnement mit E-Mail-Typ as Protokoll und eine Endpunkt-E-Mail-Adresse, auf die Sie zugreifen können.

- Auswählen Abonnement erstellen und bestätigen Sie das Abonnement, wenn die E-Mail eintrifft.

- Auf dem Betreff kopieren Sie den ARN.

- Erstellen Sie eine weitere Lambda-Funktion mit dem folgenden Code und geben Sie das ARN-Thema ein

MY_SYS_ARN: - Auswählen Deploy um die Funktion bereitzustellen.

Wenn Lookout for Equipment eine Anomalie erkennt, ist der Vorhersagewert in den Ergebnissen 1. Der Lambda-Code verwendet die JSONL-Datei und sendet eine E-Mail-Benachrichtigung an die konfigurierte Adresse.

- Der Konfiguration, wählen Berechtigungen und Rollenname.

- Auswählen

Richtlinien anhängen und fügen

AmazonS3FullAccessundAmazonSNSFullAccesszur Rolle. - Schließlich fügen Sie der Funktion einen S3-Trigger hinzu und geben die an

/outputEimer.

Nach ein paar Minuten sehen Sie, dass alle 5 Minuten E-Mails eintreffen.

Visualisieren Sie Inferenzergebnisse

Nachdem Amazon S3 die Vorhersageergebnisse gespeichert hat, können wir den AWS Glue-Datenkatalog mit Athena und QuickSight verwenden, um Berichts-Dashboards zu erstellen.

- Wählen Sie in der AWS Glue-Konsole aus Crawlers im Navigationsbereich.

- Auswählen Crawler erstellen.

- Geben Sie dem Crawler einen Namen, z

inference_crawler. - Auswählen

Fügen Sie eine Datenquelle hinzu und wählen Sie den S3-Bucket-Pfad mit aus

results.jsonlDateien. - Auswählen Crawlen Sie alle Unterordner.

- Auswählen Fügen Sie eine S3-Datenquelle hinzu.

- Auswählen Neue IAM-Rolle erstellen.

- Erstellen Sie eine Datenbank und geben Sie einen Namen an (z. B.

anycompanyinferenceresult). - Aussichten für Crawler-Zeitplan, wählen Auf Nachfrage.

- Auswählen Weiter, Dann wählen Crawler erstellen.

- Wenn der Crawler fertig ist, wählen Sie Führen Sie den Crawler aus.

- Öffnen Sie in der Athena-Konsole den Abfrage-Editor.

- Auswählen Einstellungen bearbeiten um einen Speicherort für Abfrageergebnisse in Amazon S3 einzurichten.

- Wenn Sie noch keinen Bucket erstellt haben, erstellen Sie jetzt einen über die Amazon S3-Konsole.

- Kehren Sie zur Athena-Konsole zurück, wählen Sie den Eimer und wählen Sie Speichern.

- Gehe zurück zum Herausgeber Registerkarte im Abfrageeditor und führen Sie eine Abfrage aus

select *von dem/outputS3-Ordner. - Überprüfen Sie die Ergebnisse, die die Anomalieerkennung wie erwartet zeigen.

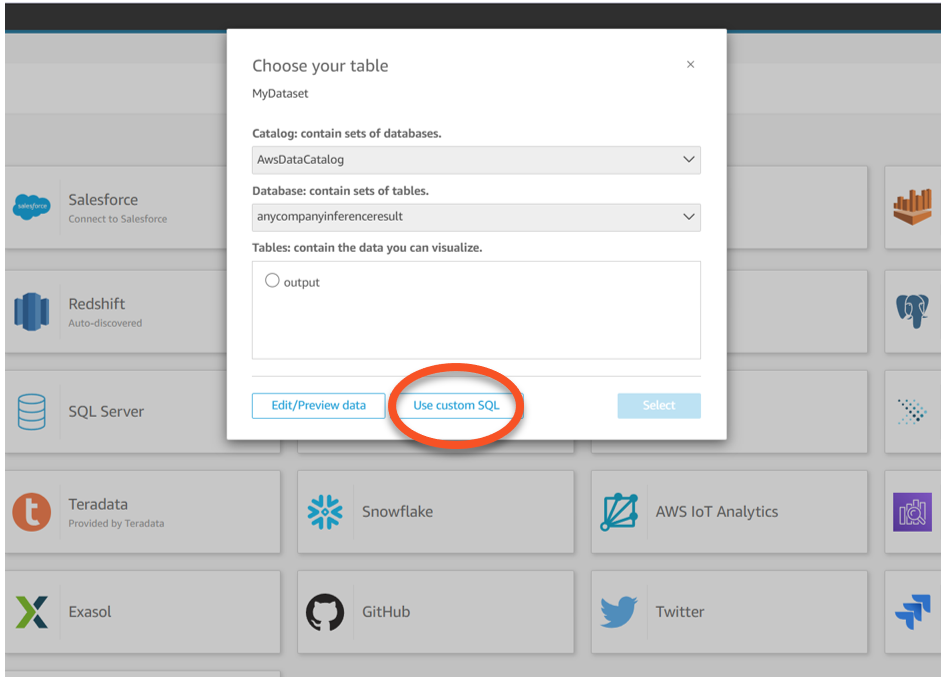

- Um die Vorhersageergebnisse zu visualisieren, navigieren Sie zur QuickSight-Konsole.

- Auswählen Eine neue Analyse und Neuer Datensatz.

- Aussichten für Datensatzquelle, wählen Athena.

- Aussichten für Name der Datenquelle, eingeben

MyDataset. - Auswählen Datenquelle erstellen.

- Wählen Sie die Tabelle aus, die Sie erstellt haben, und wählen Sie dann aus Verwenden Sie benutzerdefiniertes SQL.

- Geben Sie die folgende Abfrage ein:

- Bestätigen Sie die Abfrage und wählen Sie aus Visualize.

- Auswählen Pivot-Tisch.

- Angeben Zeitstempel und Sensor für Reihen.

- Angeben Prognose und ScoreValue für Werte.

- Auswählen Visual hinzufügen um ein visuelles Objekt hinzuzufügen.

- Auswählen Vertikales Balkendiagramm.

- Angeben Timestamp für X Achse, ScoreValue für Wert und Sensor für Gruppe / Farbe.

- Change ScoreValue zu Gesamt: Durchschnitt.

Aufräumen

Wenn Ressourcen nicht gelöscht werden, können zusätzliche Gebühren anfallen. Führen Sie die folgenden Schritte aus, um Ihre Ressourcen zu bereinigen:

- Wählen Sie in der QuickSight-Konsole Aktuelle im Navigationsbereich.

- Löschen Sie alle Ressourcen, die Sie im Rahmen dieses Beitrags erstellt haben.

- Navigieren Sie zu der Datensätze Seite und löschen Sie die von Ihnen erstellten Datensätze.

- Löschen Sie in der Lookout for Equipment-Konsole die in diesem Beitrag verwendeten Projekte, Datensätze, Modelle und Inferenzzeitpläne.

- Löschen Sie in der Timestream-Konsole die Datenbank und die zugehörigen Tabellen.

- Löschen Sie auf der Lambda-Konsole die EventBridge- und Amazon S3-Trigger.

- Löschen Sie die S3-Buckets, die IoT Core-Regel und die IoT-Simulationen und -Geräte.

Zusammenfassung

In diesem Beitrag haben Sie gelernt, wie Sie maschinelles Lernen für die vorausschauende Wartung mithilfe von Echtzeit-Streamingdaten mit einem Low-Code-Ansatz implementieren. Sie haben verschiedene Tools kennengelernt, die Ihnen bei diesem Prozess helfen können, indem Sie verwaltete AWS-Services wie Timestream, Lookout for Equipment und Lambda verwenden, damit Betriebsteams den Wert sehen, ohne zusätzliche Arbeitslasten für Overhead hinzuzufügen. Da die Architektur serverlose Technologie verwendet, kann sie nach oben und unten skaliert werden, um Ihre Anforderungen zu erfüllen.

Weitere datenbasierte Lernressourcen finden Sie unter AWS-Blog-Homepage.

Über den Autor

Matt Reed ist Senior Solutions Architect in Automotive und Manufacturing bei AWS. Er ist leidenschaftlich daran interessiert, Kunden dabei zu helfen, Probleme mit cooler Technologie zu lösen, um das Leben aller zu verbessern. Matt liebt es, Mountainbike zu fahren, Ski zu fahren und mit Freunden, der Familie sowie Hunden und Katzen abzuhängen.

Matt Reed ist Senior Solutions Architect in Automotive und Manufacturing bei AWS. Er ist leidenschaftlich daran interessiert, Kunden dabei zu helfen, Probleme mit cooler Technologie zu lösen, um das Leben aller zu verbessern. Matt liebt es, Mountainbike zu fahren, Ski zu fahren und mit Freunden, der Familie sowie Hunden und Katzen abzuhängen.

- SEO-gestützte Content- und PR-Distribution. Holen Sie sich noch heute Verstärkung.

- Platoblockkette. Web3-Metaverse-Intelligenz. Wissen verstärkt. Hier zugreifen.

- Quelle: https://aws.amazon.com/blogs/machine-learning/use-machine-learning-to-detect-anomalies-and-predict-downtime-with-amazon-timestream-and-amazon-lookout-for-equipment/

- 1

- 10

- 100

- 11

- 28

- 7

- 9

- a

- Über uns

- Zugang

- Zugriff auf Daten

- Konto

- Genauigkeit

- genau

- über

- Action

- hinzugefügt

- Zusätzliche

- zusätzlich

- Adresse

- Adoption

- Alle

- bereits

- Amazon

- Amazon-Timestream

- Analyse

- analysieren

- und

- Anomalieerkennung

- Ein anderer

- Anwendung

- Ansatz

- Architektur

- Kommt

- Versammlung

- damit verbundenen

- Attribute

- Automatisiert

- Automobilindustrie

- AWS

- AWS-Kleber

- Hintergrund

- Bar

- weil

- Bevor

- Sein

- Vorteile

- Besser

- Blog

- Körper

- Boden

- Haushalt

- bauen

- Building

- namens

- Häuser

- Katalog

- katastrophal

- Katzen

- Herausforderungen

- Gebühren

- aus der Ferne überprüfen

- Auswählen

- Auswahl

- Auftraggeber

- Code

- Programmierung

- sammeln

- abschließen

- Vertrauen

- Konfiguration

- Schichtannahme

- Konsul (Console)

- enthält

- Inhalt

- Kontext

- Beiträge

- verkaufen

- cool

- Kernbereich

- Dazugehörigen

- kostengünstiger

- Kosten

- könnte

- Crawler

- erstellen

- erstellt

- Referenzen

- Cross

- Original

- Kunden

- Schneiden

- technische Daten

- Datenbase

- Datensätze

- datetime

- Jahrzehnte

- Standard

- defaults

- verzögern

- zeigen

- einsetzen

- Details

- erkannt

- Entdeckung

- Entwickler:in / Unternehmen

- Gerät

- Geräte

- anders

- Direkt

- Nicht

- nach unten

- Ausfallzeit

- Früh

- leicht

- Edge

- Herausgeber

- bewirken

- Effekten

- Anstrengung

- E-Mails

- betonen

- ermöglichen

- Endpunkt

- Enter

- Arbeitsumfeld

- Umgebungen

- Ausrüstung

- Äther (ETH)

- Auswertung

- Event

- Veranstaltungen

- jeder ist

- Beispiel

- Außer

- Ausführung

- erwartet

- teuer

- Fabrik

- Scheitern

- Familie

- wenige

- Reichen Sie das

- Mappen

- Finanzen

- Finden Sie

- Vorname

- Boden

- Folgende

- unten stehende Formular

- Format

- Freunde

- für

- voll

- Funktion

- Funktionen

- weiter

- Gewinnen

- erzeugt

- bekommen

- ABSICHT

- Klasse

- Gruppe an

- Aufhängen

- Hilfe

- Unternehmen

- historisch

- Startseite

- Ultraschall

- Hilfe

- HTML

- HTTPS

- identifizieren

- Impact der HXNUMXO Observatorien

- implementieren

- Umsetzung

- importieren

- Bedeutung

- zu unterstützen,

- in

- Eingehende

- Energiegewinnung

- Industrie 4.0

- Information

- Varianten des Eingangssignals:

- iot

- IoT-Gerät

- Problem

- Probleme

- IT

- join

- JSON

- Aufbewahrung

- Wesentliche

- Label

- Etiketten

- Nachname

- starten

- ins Leben gerufen

- führen

- gelernt

- lernen

- Verlassen

- geführt

- Niveau

- Bibliothek

- Lebensdauer

- Line

- wenig

- aus einer regionalen

- örtlich

- Standorte

- Sneaker

- Maschine

- Maschinelles Lernen

- Maschinen

- Wartung

- um

- verwaltet

- Management

- Herstellung

- Spiel

- Mittel

- Triff

- MENÜ

- Nachricht

- Nachrichten

- Minuten

- ML

- Modell

- für

- mehr

- Name

- Namen

- Navigieren

- navigieren

- Navigation

- Need

- Bedürfnisse

- Neu

- Neue Technologien

- Benachrichtigung

- Benachrichtigungen

- Objekt

- EINEM

- XNUMXh geöffnet

- öffnet

- Betriebs-

- Optionen

- Auftrag

- Organisationen

- OS

- Andere

- Besitzer

- Pandas

- Brot

- Teil

- leidenschaftlich

- Passwort

- Weg

- Personen

- Plato

- Datenintelligenz von Plato

- PlatoData

- Datenschutzrichtlinien

- Post

- Werkzeuge

- Präzision

- vorhersagen

- vorhergesagt

- Vorhersage

- Prognose

- bevorzugt

- Gegenwart

- vorher

- Probleme

- Prozessdefinierung

- Produktion

- Projekt

- Projekte

- Prototyp

- die

- vorausgesetzt

- veröffentlichen

- veröffentlicht

- schnell

- Bewerten

- erreichen

- Lesen Sie mehr

- echt

- Echtzeit

- erhalten

- kürzlich

- Aufzeichnungen

- Veteran

- Region

- zuverlässig

- bleiben

- verbleibenden

- Reporting

- falls angefordert

- Ressourcen

- Downloads

- Reagieren

- Antwort

- REST

- Folge

- Die Ergebnisse

- Rückkehr

- Überprüfen

- Revolution

- Rollen

- Regel

- Führen Sie

- Speichern

- Skalieren

- Zeitplan

- Wissenschaftler

- Suche

- Zweite

- Abschnitt

- schien

- Sensoren

- Serverlos

- Leistungen

- kompensieren

- Einstellungen

- sollte

- erklären

- gezeigt

- Schild

- Signal

- Signale

- Schilder

- Einfacher

- Simulation

- Simulator

- Größen

- Fähigkeiten

- So

- Lösung

- Lösungen

- LÖSEN

- Quelle

- Spezialisten

- spezifisch

- Geschwindigkeit

- Wirbelsäule ... zu unterstützen.

- Stapel

- Anfang

- begonnen

- Erklärung

- Shritte

- Immer noch

- Lagerung

- gelagert

- Läden

- Strategie

- Strom

- Streaming

- stark

- Fach

- Abonnement

- so

- System

- Tabelle

- Nehmen

- nimmt

- Teams

- Technische

- Technologies

- Technologie

- Vorlage

- Test

- Testen

- Das

- Die Projekte

- Die Quelle

- nach drei

- Zeit

- Zeitstempel

- zu

- Werkzeuge

- Thema

- Themen

- Training

- trainiert

- Ausbildung

- auslösen

- ausgelöst

- ui

- für

- einzigartiges

- öffnen

- URL

- -

- Mitglied

- UTC

- Wert

- Werte

- überprüfen

- Version

- Vertikalen

- Anzeigen

- Warnung

- welche

- werden wir

- ohne

- geschrieben

- Ihr

- Zephyrnet