Postingan ini ditulis bekerja sama dengan Bhajandeep Singh dan Ajay Vishwakarma dari AWS AI/ML Practice Wipro.

Banyak organisasi telah menggunakan kombinasi solusi ilmu data lokal dan sumber terbuka untuk membuat dan mengelola model pembelajaran mesin (ML).

Tim ilmu data dan DevOps mungkin menghadapi tantangan dalam mengelola tumpukan alat dan sistem yang terisolasi ini. Mengintegrasikan beberapa tumpukan alat untuk membangun solusi ringkas mungkin melibatkan pembuatan konektor atau alur kerja khusus. Mengelola dependensi yang berbeda berdasarkan versi saat ini dari setiap tumpukan dan mempertahankan dependensi tersebut dengan rilis pembaruan baru dari setiap tumpukan akan mempersulit solusinya. Hal ini meningkatkan biaya pemeliharaan infrastruktur dan menghambat produktivitas.

Penawaran kecerdasan buatan (AI) dan pembelajaran mesin (ML) dari Layanan Web Amazon (AWS), bersama dengan layanan pemantauan dan pemberitahuan terintegrasi, membantu organisasi mencapai tingkat otomatisasi, skalabilitas, dan kualitas model yang diperlukan dengan biaya optimal. AWS juga membantu tim ilmu data dan DevOps untuk berkolaborasi dan menyederhanakan proses siklus hidup model secara keseluruhan.

Portofolio layanan ML AWS mencakup serangkaian layanan tangguh yang dapat Anda gunakan untuk mempercepat pengembangan, pelatihan, dan penerapan aplikasi pembelajaran mesin. Rangkaian layanan dapat digunakan untuk mendukung siklus hidup model secara lengkap termasuk pemantauan dan pelatihan ulang model ML.

Pada postingan kali ini, kami membahas pengembangan model dan implementasi framework MLOps untuk salah satu pelanggan Wipro yang menggunakan Amazon SageMaker dan layanan AWS lainnya.

Wipro adalah Partner Layanan Tingkat Premier AWS dan Penyedia Layanan Terkelola (MSP). Dia Solusi AI/ML mendorong peningkatan efisiensi operasional, produktivitas, dan pengalaman pelanggan bagi banyak klien perusahaan mereka.

Tantangan saat ini

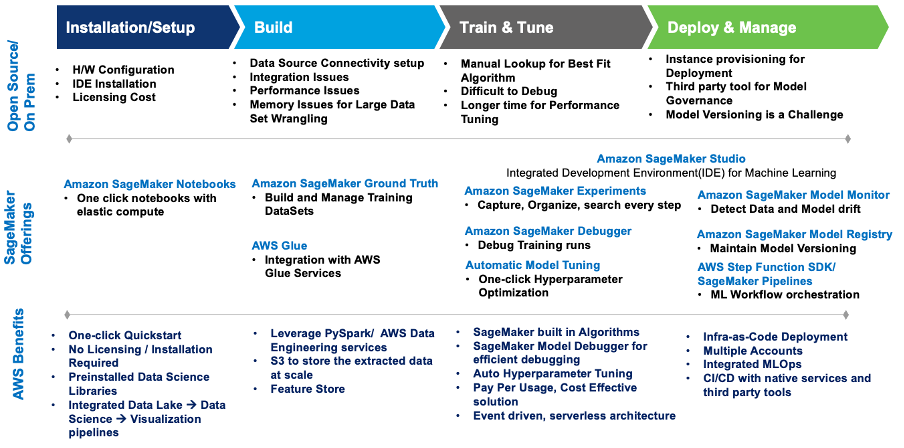

Pertama-tama, mari kita pahami beberapa tantangan yang dihadapi ilmu data pelanggan dan tim DevOps dengan penyiapan mereka saat ini. Kami kemudian dapat memeriksa bagaimana penawaran SageMaker AI/ML yang terintegrasi membantu memecahkan tantangan tersebut.

- Kolaborasi – Masing-masing data scientist mengerjakan notebook Jupyter lokal mereka sendiri untuk membuat dan melatih model ML. Mereka tidak memiliki metode yang efektif untuk berbagi dan berkolaborasi dengan data scientist lainnya.

- Skalabilitas – Pelatihan dan pelatihan ulang model ML membutuhkan lebih banyak waktu karena model menjadi lebih kompleks sementara kapasitas infrastruktur yang dialokasikan tetap statis.

- MLOps – Pemantauan model dan tata kelola yang berkelanjutan tidak terintegrasi dan terotomatisasi secara erat dengan model ML. Ada ketergantungan dan kompleksitas dalam mengintegrasikan alat pihak ketiga ke dalam saluran MLOps.

- Dapat digunakan kembali – Tanpa kerangka kerja MLOps yang dapat digunakan kembali, setiap model harus dikembangkan dan diatur secara terpisah, sehingga menambah upaya keseluruhan dan menunda operasionalisasi model.

Diagram ini merangkum tantangan dan bagaimana penerapan Wipro di SageMaker mengatasinya dengan layanan dan penawaran SageMaker bawaan.

Gambar 1 – Penawaran SageMaker untuk migrasi beban kerja ML

Wipro mendefinisikan arsitektur yang mengatasi tantangan dengan cara yang hemat biaya dan sepenuhnya otomatis.

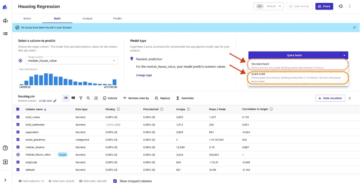

Berikut use case dan model yang digunakan untuk membangun solusinya:

- Gunakan kasus: Prediksi harga berdasarkan dataset mobil bekas

- Jenis masalah: Regresi

- Model yang digunakan: XGBoost dan Linear Learner (algoritme bawaan SageMaker)

Arsitektur solusi

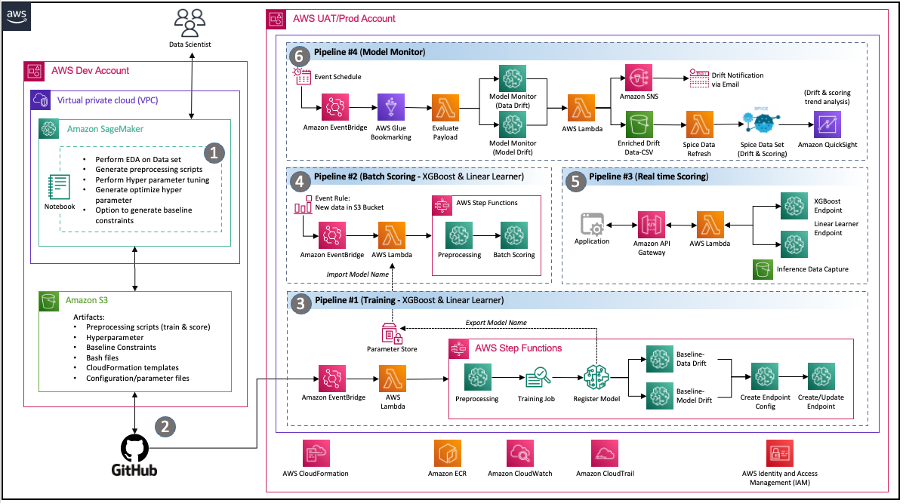

Konsultan Wipro mengadakan lokakarya penemuan mendalam dengan tim ilmu data, DevOps, dan teknik data pelanggan untuk memahami lingkungan saat ini serta persyaratan dan harapan mereka terhadap solusi modern di AWS. Pada akhir penugasan konsultasi, tim telah menerapkan arsitektur berikut yang secara efektif memenuhi kebutuhan inti tim pelanggan, termasuk:

Berbagi Kode – Buku catatan SageMaker memungkinkan ilmuwan data bereksperimen dan berbagi kode dengan anggota tim lainnya. Wipro semakin mempercepat perjalanan model ML mereka dengan menerapkan akselerator dan cuplikan kode Wipro untuk mempercepat rekayasa fitur, pelatihan model, penerapan model, dan pembuatan saluran.

Integrasi berkelanjutan dan jalur pengiriman berkelanjutan (CI/CD). – Menggunakan versi kode yang diaktifkan repositori GitHub pelanggan dan skrip otomatis untuk meluncurkan penerapan pipeline setiap kali versi kode baru diterapkan.

MLOps – Arsitektur mengimplementasikan jalur pemantauan model SageMaker untuk tata kelola kualitas model berkelanjutan dengan memvalidasi data dan penyimpangan model sesuai dengan jadwal yang ditentukan. Setiap kali penyimpangan terdeteksi, sebuah peristiwa diluncurkan untuk memberi tahu tim masing-masing agar mengambil tindakan atau memulai pelatihan ulang model.

Arsitektur yang digerakkan oleh peristiwa – Jalur untuk pelatihan model, penerapan model, dan pemantauan model terintegrasi dengan baik saat digunakan Jembatan Acara Amazon, bus acara tanpa server. Ketika peristiwa yang ditentukan terjadi, EventBridge dapat memanggil alur untuk dijalankan sebagai respons. Hal ini menyediakan serangkaian saluran pipa yang dapat berjalan sesuai kebutuhan sebagai respons terhadap lingkungan.

Gambar 2 – Arsitektur MLOps Berbasis Peristiwa dengan SageMaker

Komponen solusi

Bagian ini menjelaskan berbagai komponen solusi arsitektur.

Buku catatan percobaan

- Tujuan: Tim ilmu data pelanggan ingin bereksperimen dengan berbagai kumpulan data dan beberapa model untuk menghasilkan fitur yang optimal, menggunakannya sebagai masukan lebih lanjut ke saluran otomatis.

- Larutan: Wipro membuat buku catatan eksperimen SageMaker dengan cuplikan kode untuk setiap langkah yang dapat digunakan kembali, seperti membaca dan menulis data, rekayasa fitur model, pelatihan model, dan penyetelan hyperparameter. Tugas rekayasa fitur juga dapat disiapkan di Data Wrangler, namun klien secara khusus meminta pekerjaan pemrosesan SageMaker dan Fungsi Langkah AWS karena mereka lebih nyaman menggunakan teknologi tersebut. Kami menggunakan SDK ilmu data fungsi langkah AWS untuk membuat fungsi langkah—untuk pengujian aliran—langsung dari instans notebook guna mengaktifkan input yang terdefinisi dengan baik untuk alur. Hal ini telah membantu tim ilmuwan data membuat dan menguji pipeline dengan lebih cepat.

Saluran pelatihan otomatis

- Tujuan: Untuk mengaktifkan pipeline pelatihan dan pelatihan ulang otomatis dengan parameter yang dapat dikonfigurasi seperti jenis instans, hyperparameter, dan Layanan Penyimpanan Sederhana Amazon (Amazon S3) lokasi ember. Pipeline juga harus diluncurkan oleh peristiwa push data ke S3.

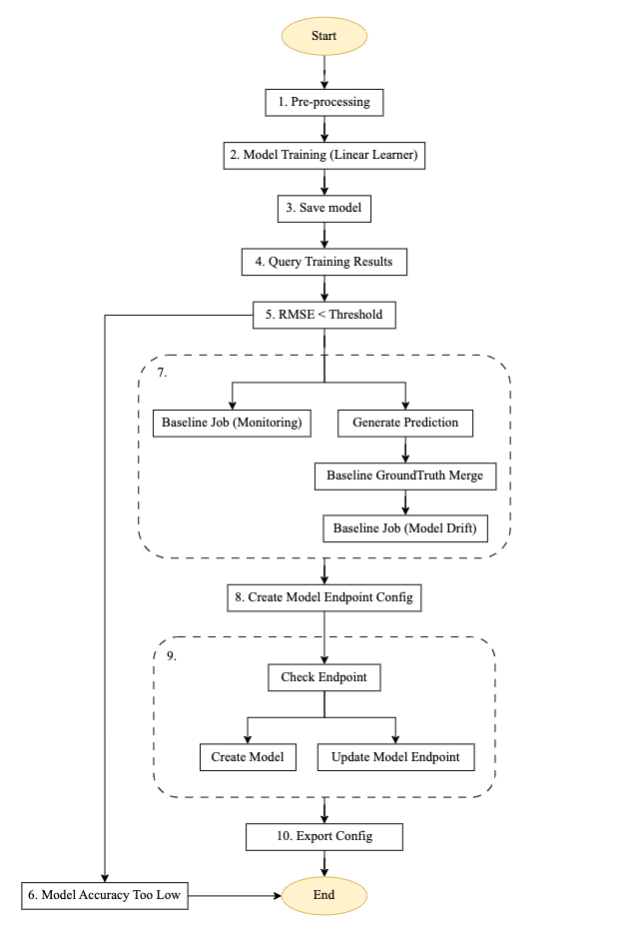

- Larutan: Wipro menerapkan jalur pelatihan yang dapat digunakan kembali menggunakan Step Functions SDK, pemrosesan SageMaker, tugas pelatihan, wadah monitor model SageMaker untuk pembuatan dasar, AWS Lambda, dan layanan EventBridge. Dengan menggunakan arsitektur berbasis peristiwa AWS, pipeline dikonfigurasikan untuk diluncurkan secara otomatis berdasarkan peristiwa data baru yang didorong ke bucket S3 yang dipetakan. Pemberitahuan dikonfigurasi untuk dikirim ke alamat email yang ditentukan. Pada tingkat tinggi, alur pelatihan terlihat seperti diagram berikut:

Gambar 3 – Melatih mesin langkah pipeline.

Deskripsi alur untuk alur pelatihan otomatis

Diagram di atas adalah alur pelatihan otomatis yang dibuat menggunakan Step Functions, Lambda, dan SageMaker. Ini adalah saluran yang dapat digunakan kembali untuk menyiapkan pelatihan model otomatis, menghasilkan prediksi, membuat garis dasar untuk pemantauan model dan pemantauan data, serta membuat dan memperbarui titik akhir berdasarkan nilai ambang batas model sebelumnya.

- Pra-pemrosesan: Langkah ini mengambil data dari lokasi Amazon S3 sebagai input dan menggunakan kontainer SageMaker SKLearn untuk melakukan tugas rekayasa fitur dan pra-pemrosesan data yang diperlukan, seperti melatih, menguji, dan memvalidasi pemisahan.

- Pelatihan model: Dengan menggunakan SageMaker SDK, langkah ini menjalankan kode pelatihan dengan masing-masing gambar model dan melatih kumpulan data dari skrip pra-pemrosesan sambil membuat artefak model yang dilatih.

- Simpan model: Langkah ini membuat model dari artefak model yang dilatih. Nama model disimpan untuk referensi di saluran lain menggunakan Penyimpanan Parameter Manajer Sistem AWS.

- Hasil pelatihan kueri: Langkah ini memanggil fungsi Lambda untuk mengambil metrik tugas pelatihan yang telah selesai dari langkah pelatihan model sebelumnya.

- Ambang batas RMSE: Langkah ini memverifikasi metrik model terlatih (RMSE) terhadap ambang batas yang ditentukan untuk memutuskan apakah akan melanjutkan penerapan titik akhir atau menolak model ini.

- Akurasi model terlalu rendah: Pada langkah ini keakuratan model diperiksa terhadap model terbaik sebelumnya. Jika model gagal pada validasi metrik, notifikasi dikirim oleh fungsi Lambda ke topik target yang terdaftar Layanan Pemberitahuan Sederhana Amazon (Amazon SNS). Jika pemeriksaan ini gagal, alur akan keluar karena model baru yang dilatih tidak memenuhi ambang batas yang ditentukan.

- Penyimpangan data pekerjaan dasar: Jika model yang dilatih lolos dari langkah-langkah validasi, statistik dasar akan dihasilkan untuk versi model yang dilatih ini guna mengaktifkan pemantauan dan langkah-langkah cabang paralel dijalankan untuk menghasilkan dasar untuk pemeriksaan kualitas model.

- Buat konfigurasi titik akhir model: Langkah ini membuat konfigurasi titik akhir untuk model yang dievaluasi pada langkah sebelumnya dengan mengaktifkan pengambilan data konfigurasi.

- Periksa titik akhir: Langkah ini memeriksa apakah titik akhir ada atau perlu dibuat. Berdasarkan keluarannya, langkah selanjutnya adalah membuat atau memperbarui titik akhir.

- Konfigurasi ekspor: Langkah ini mengekspor nama model parameter, nama titik akhir, dan konfigurasi titik akhir ke Manajer Sistem AWS Penyimpanan Parameter.

Peringatan dan pemberitahuan dikonfigurasi untuk dikirim ke email topik SNS yang dikonfigurasi tentang kegagalan atau keberhasilan perubahan status mesin status. Konfigurasi saluran pipa yang sama digunakan kembali untuk model XGBoost.

Alur penilaian batch otomatis

- Tujuan: Luncurkan penskoran batch segera setelah data batch input penskoran tersedia di masing-masing lokasi Amazon S3. Penilaian batch harus menggunakan model terdaftar terbaru untuk melakukan penilaian.

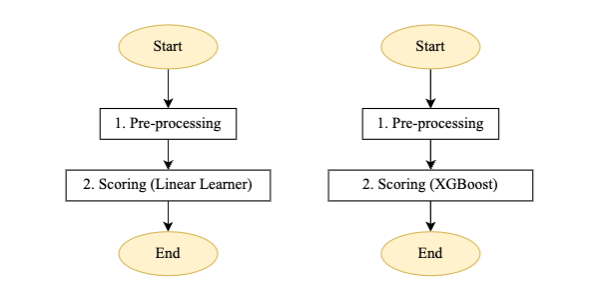

- Larutan: Wipro menerapkan alur penilaian yang dapat digunakan kembali menggunakan Step Functions SDK, pekerjaan transformasi batch SageMaker, Lambda, dan EventBridge. Alur dipicu secara otomatis berdasarkan ketersediaan data batch penilaian baru di lokasi S3 masing-masing.

Gambar 4 – Mesin langkah pipeline penilaian untuk pembelajar linier dan model XGBoost

Deskripsi alur untuk alur penilaian batch otomatis:

- Pra-pemrosesan: Masukan untuk langkah ini adalah file data dari lokasi S3 masing-masing, dan melakukan pra-pemrosesan yang diperlukan sebelum memanggil tugas transformasi batch SageMaker.

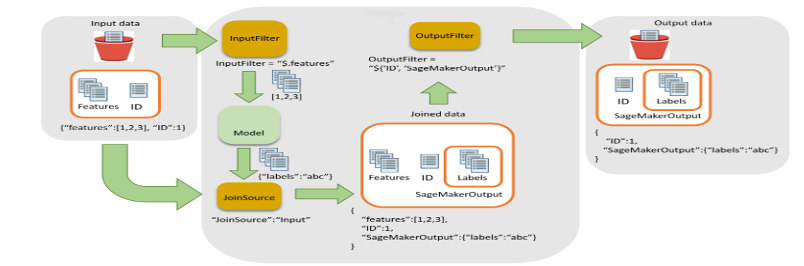

- Mencetak: Langkah ini menjalankan tugas transformasi batch untuk menghasilkan inferensi, memanggil versi terbaru dari model terdaftar dan menyimpan output penilaian dalam bucket S3. Wipro telah menggunakan filter input dan fungsi gabungan dari API transformasi batch SageMaker. Hal ini membantu memperkaya data penilaian untuk pengambilan keputusan yang lebih baik.

Gambar 5 – Filter masukan dan aliran gabungan untuk transformasi batch

- Pada langkah ini, alur mesin status diluncurkan oleh file data baru di bucket S3.

Pemberitahuan dikonfigurasi untuk dikirim ke email topik SNS yang dikonfigurasi tentang kegagalan/keberhasilan perubahan status mesin status.

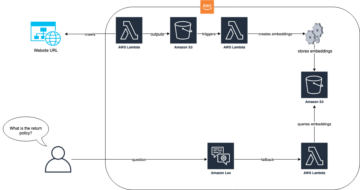

Saluran inferensi waktu nyata

- Tujuan: Untuk mengaktifkan inferensi waktu nyata dari titik akhir kedua model (Linear Learner dan XGBoost) dan mendapatkan nilai prediksi maksimum (atau dengan menggunakan logika khusus lainnya yang dapat ditulis sebagai fungsi Lambda) untuk dikembalikan ke aplikasi.

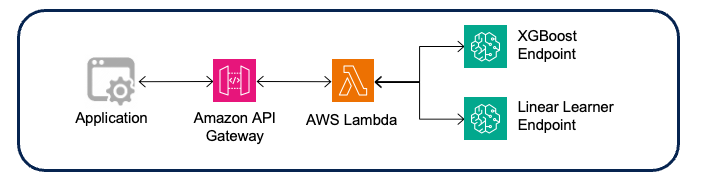

- Larutan: Tim Wipro telah menerapkan arsitektur yang dapat digunakan kembali Gerbang API Amazon, titik akhir Lambda, dan SageMaker seperti yang ditunjukkan pada Gambar 6:

Gambar 6 – Saluran inferensi waktu nyata

Deskripsi alur untuk pipeline inferensi real-time ditunjukkan pada Gambar 6:

- Payload dikirim dari aplikasi ke Amazon API Gateway, yang merutekannya ke fungsi Lambda masing-masing.

- Fungsi Lambda (dengan lapisan khusus SageMaker terintegrasi) melakukan pra-pemrosesan yang diperlukan, pemformatan muatan JSON atau CSV, dan memanggil titik akhir masing-masing.

- Respons dikembalikan ke Lambda dan dikirim kembali ke aplikasi melalui API Gateway.

Pelanggan menggunakan saluran ini untuk model skala kecil dan menengah, termasuk penggunaan berbagai jenis algoritme sumber terbuka. Salah satu manfaat utama SageMaker adalah berbagai jenis algoritma dapat dibawa ke SageMaker dan diterapkan menggunakan teknik bawa wadah Anda sendiri (BYOC). BYOC melibatkan memasukkan algoritme ke dalam container dan mendaftarkan gambar ke dalamnya Registri Kontainer Amazon Elastic (Amazon ECR), lalu menggunakan gambar yang sama untuk membuat wadah untuk melakukan pelatihan dan inferensi.

Penskalaan adalah salah satu masalah terbesar dalam siklus pembelajaran mesin. SageMaker dilengkapi dengan alat yang diperlukan untuk menskalakan model selama inferensi. Dalam arsitektur sebelumnya, pengguna perlu mengaktifkan penskalaan otomatis SageMaker, yang pada akhirnya akan menangani beban kerja. Untuk mengaktifkan penskalaan otomatis, pengguna harus memberikan kebijakan penskalaan otomatis yang menanyakan throughput per instans serta instans maksimum dan minimum. Sesuai dengan kebijakan yang berlaku, SageMaker secara otomatis menangani beban kerja untuk titik akhir real-time dan beralih antar instans bila diperlukan.

Saluran monitor model kustom

- Tujuan: Tim pelanggan ingin memiliki pemantauan model otomatis untuk menangkap penyimpangan data dan penyimpangan model. Tim Wipro menggunakan pemantauan model SageMaker untuk mengaktifkan penyimpangan data dan penyimpangan model dengan saluran yang dapat digunakan kembali untuk inferensi real-time dan transformasi batch. Perhatikan bahwa selama pengembangan solusi ini, pemantauan model SageMaker tidak menyediakan ketentuan untuk mendeteksi data atau penyimpangan model untuk transformasi batch. Kami telah menerapkan penyesuaian untuk menggunakan wadah monitor model untuk payload transformasi batch.

- Larutan: Tim Wipro menerapkan pipeline pemantauan model yang dapat digunakan kembali untuk menggunakan payload inferensi batch dan real-time Lem AWS untuk menangkap muatan tambahan dan menjalankan tugas pemantauan model sesuai dengan jadwal yang ditentukan.

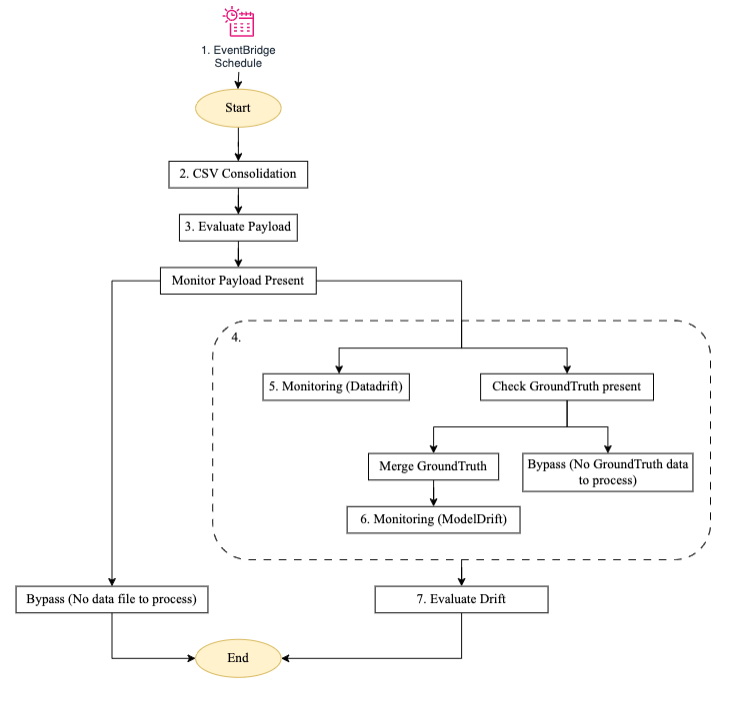

Gambar 7 – Model mesin langkah monitor

Deskripsi alur untuk alur monitor model kustom:

Alur berjalan sesuai dengan jadwal yang ditentukan yang dikonfigurasi melalui EventBridge.

- Konsolidasi CSV – Ini menggunakan fitur bookmark AWS Glue untuk mendeteksi keberadaan muatan tambahan dalam bucket S3 yang ditentukan untuk pengambilan dan respons data real-time serta respons data batch. Kemudian mengumpulkan data tersebut untuk diproses lebih lanjut.

- Evaluasi muatan – Jika ada data atau payload tambahan untuk proses saat ini, cabang pemantauan akan dipanggil. Jika tidak, ia akan melewati tanpa memproses dan keluar dari pekerjaan.

- Pengolahan pasca – Cabang pemantauan dirancang untuk memiliki dua sub cabang paralel—satu untuk penyimpangan data dan satu lagi untuk penyimpangan model.

- Pemantauan (pergeseran data) – Cabang penyimpangan data berjalan setiap kali ada muatan. Ia menggunakan batasan dasar model terlatih terbaru dan file statistik yang dihasilkan melalui alur pelatihan untuk fitur data dan menjalankan tugas pemantauan model.

- Pemantauan (penyimpangan model) – Cabang penyimpangan model hanya berjalan ketika data kebenaran dasar disediakan, bersama dengan muatan inferensi. Ia menggunakan batasan dasar model terlatih dan file statistik yang dihasilkan melalui pipeline pelatihan untuk fitur kualitas model dan menjalankan tugas pemantauan model.

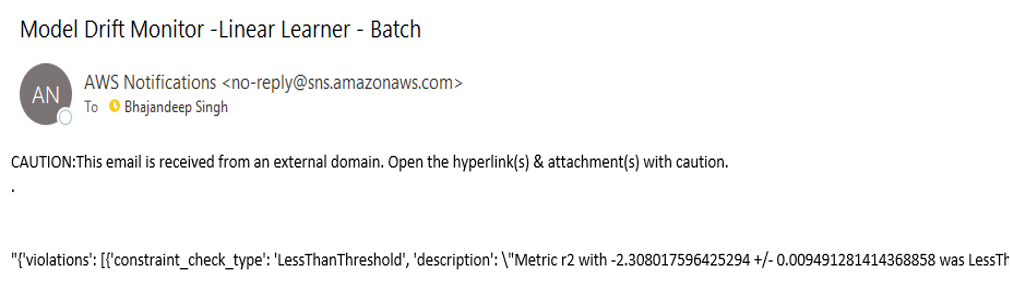

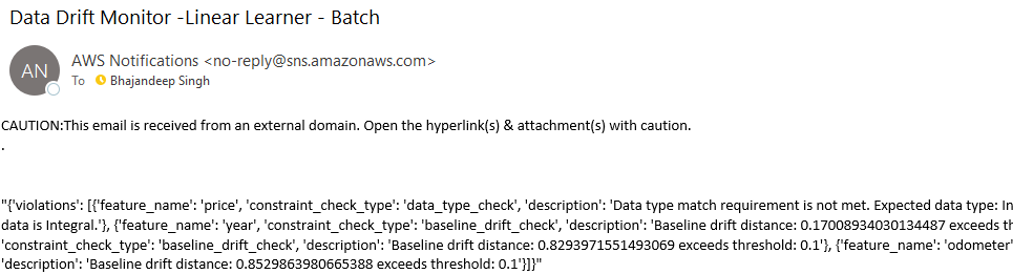

- Evaluasi penyimpangan – Hasil penyimpangan data dan model adalah file pelanggaran batasan yang dievaluasi oleh fungsi evaluasi penyimpangan Lambda yang mengirimkan pemberitahuan ke masing-masing topik Amazon SNS dengan rincian penyimpangan. Data drift diperkaya lebih lanjut dengan penambahan atribut untuk tujuan pelaporan. Email pemberitahuan penyimpangan akan terlihat serupa dengan contoh pada Gambar 8.

Gambar 8 – Pesan notifikasi penyimpangan data dan model

Gambar 9 – Pesan notifikasi penyimpangan data dan model

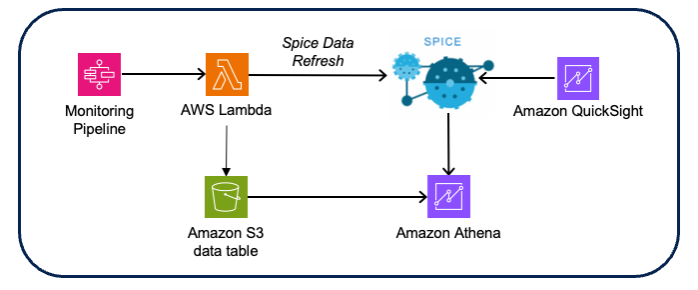

Wawasan dengan visualisasi Amazon QuickSight:

- Tujuan: Pelanggan ingin memiliki wawasan tentang penyimpangan data dan model, menghubungkan data penyimpangan dengan tugas pemantauan model masing-masing, dan mengetahui tren data inferensi untuk memahami sifat tren data interferensi.

- Larutan: Tim Wipro memperkaya data penyimpangan dengan menghubungkan data masukan dengan hasil penyimpangan, yang memungkinkan triase dari penyimpangan ke pemantauan dan data penilaian masing-masing. Visualisasi dan dashboard dibuat menggunakan Amazon QuickSight dengan Amazon Athena sebagai sumber data (menggunakan skor CSV Amazon S3 dan data drift).

Gambar 10 – Arsitektur visualisasi pemantauan model

Pertimbangan desain:

- Gunakan kumpulan data bumbu QuickSight untuk kinerja dalam memori yang lebih baik.

- Gunakan API himpunan data penyegaran QuickSight untuk mengotomatiskan penyegaran data bumbu.

- Menerapkan keamanan berbasis grup untuk kontrol akses dasbor dan analisis.

- Di seluruh akun, otomatisasi penerapan menggunakan kumpulan data ekspor dan impor, sumber data, dan panggilan API analisis yang disediakan oleh QuickSight.

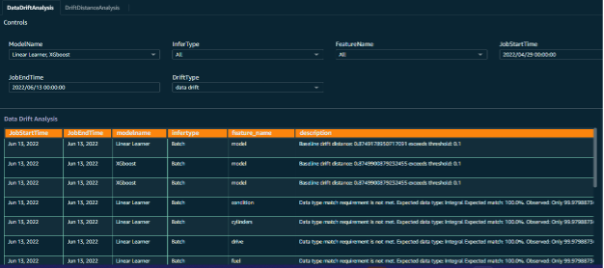

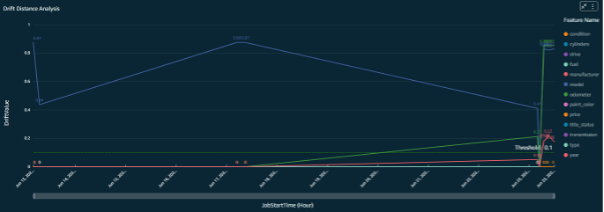

Dasbor pemantauan model:

Untuk memungkinkan hasil yang efektif dan wawasan yang bermakna tentang pekerjaan pemantauan model, dasbor khusus dibuat untuk data pemantauan model. Titik data masukan digabungkan secara paralel dengan data permintaan inferensi, data pekerjaan, dan keluaran pemantauan untuk menciptakan visualisasi tren yang diungkapkan oleh pemantauan model.

Hal ini sangat membantu tim pelanggan untuk memvisualisasikan aspek berbagai fitur data beserta prediksi hasil dari setiap kumpulan permintaan inferensi.

Gambar 11 – Dasbor monitor model dengan petunjuk pemilihan

Gambar 12 – Analisis penyimpangan monitor model

Kesimpulan

Implementasi yang dijelaskan dalam postingan ini memungkinkan Wipro untuk secara efektif memigrasikan model lokalnya ke AWS dan membangun kerangka pengembangan model otomatis yang dapat diskalakan.

Penggunaan komponen kerangka kerja yang dapat digunakan kembali memberdayakan tim ilmu data untuk secara efektif mengemas pekerjaan mereka sebagai komponen JSON AWS Step Functions yang dapat diterapkan. Secara bersamaan, tim DevOps menggunakan dan menyempurnakan pipeline CI/CD otomatis untuk memfasilitasi promosi dan pelatihan ulang model yang lancar di lingkungan yang lebih tinggi.

Komponen pemantauan model telah mengaktifkan pemantauan berkelanjutan terhadap kinerja model, dan pengguna menerima peringatan dan pemberitahuan setiap kali data atau penyimpangan model terdeteksi.

Tim pelanggan menggunakan kerangka kerja MLOps ini untuk memigrasikan atau mengembangkan lebih banyak model dan meningkatkan adopsi SageMaker mereka.

Dengan memanfaatkan rangkaian layanan SageMaker yang komprehensif bersama dengan arsitektur kami yang dirancang dengan cermat, pelanggan dapat dengan mudah melakukan onboarding beberapa model, sehingga secara signifikan mengurangi waktu penerapan dan mengurangi kompleksitas yang terkait dengan berbagi kode. Selain itu, arsitektur kami menyederhanakan pemeliharaan pembuatan versi kode, memastikan proses pengembangan yang efisien.

Arsitektur ini menangani seluruh siklus pembelajaran mesin, yang mencakup pelatihan model otomatis, inferensi real-time dan batch, pemantauan model proaktif, dan analisis penyimpangan. Solusi menyeluruh ini memberdayakan pelanggan untuk mencapai kinerja model yang optimal sambil mempertahankan kemampuan pemantauan dan analisis yang ketat untuk memastikan keakuratan dan keandalan yang berkelanjutan.

Untuk membuat arsitektur ini, mulailah dengan membuat sumber daya penting seperti Amazon Virtual Private Cloud (VPC Amazon), notebook SageMaker, dan fungsi Lambda. Pastikan untuk mengatur dengan tepat Identitas dan Manajemen Akses AWS (IAM) kebijakan untuk sumber daya ini.

Selanjutnya, fokuslah pada pembuatan komponen arsitektur—seperti skrip pelatihan dan prapemrosesan—dalam SageMaker Studio atau Jupyter Notebook. Langkah ini melibatkan pengembangan kode dan konfigurasi yang diperlukan untuk mengaktifkan fungsionalitas yang diinginkan.

Setelah komponen arsitektur ditentukan, Anda dapat melanjutkan dengan membangun fungsi Lambda untuk menghasilkan inferensi atau melakukan langkah pasca-pemrosesan pada data.

Pada akhirnya, gunakan Step Functions untuk menghubungkan komponen dan membangun alur kerja lancar yang mengoordinasikan jalannya setiap langkah.

Tentang Penulis

Stephen Randolph adalah Arsitek Solusi Mitra Senior di Amazon Web Services (AWS). Dia memberdayakan dan mendukung mitra Global Systems Integrator (GSI) pada teknologi AWS terbaru saat mereka mengembangkan solusi industri untuk memecahkan tantangan bisnis. Stephen sangat tertarik dengan Keamanan dan AI Generatif, serta membantu pelanggan dan mitra merancang solusi yang aman, efisien, dan inovatif di AWS.

Stephen Randolph adalah Arsitek Solusi Mitra Senior di Amazon Web Services (AWS). Dia memberdayakan dan mendukung mitra Global Systems Integrator (GSI) pada teknologi AWS terbaru saat mereka mengembangkan solusi industri untuk memecahkan tantangan bisnis. Stephen sangat tertarik dengan Keamanan dan AI Generatif, serta membantu pelanggan dan mitra merancang solusi yang aman, efisien, dan inovatif di AWS.

Bhajandeep Singh telah menjabat sebagai Kepala Pusat Keunggulan AI/ML AWS di Wipro Technologies, memimpin keterlibatan pelanggan untuk memberikan analisis data dan solusi AI. Dia memegang sertifikasi AWS AI/ML Specialty dan menulis blog teknis tentang layanan dan solusi AI/ML. Dengan pengalaman memimpin solusi AWS AI/ML di berbagai industri, Bhajandeep telah memungkinkan klien memaksimalkan nilai layanan AWS AI/ML melalui keahlian dan kepemimpinannya.

Bhajandeep Singh telah menjabat sebagai Kepala Pusat Keunggulan AI/ML AWS di Wipro Technologies, memimpin keterlibatan pelanggan untuk memberikan analisis data dan solusi AI. Dia memegang sertifikasi AWS AI/ML Specialty dan menulis blog teknis tentang layanan dan solusi AI/ML. Dengan pengalaman memimpin solusi AWS AI/ML di berbagai industri, Bhajandeep telah memungkinkan klien memaksimalkan nilai layanan AWS AI/ML melalui keahlian dan kepemimpinannya.

Ajay Vishwakarma adalah seorang insinyur ML untuk bagian AWS dari praktik solusi AI Wipro. Dia memiliki pengalaman yang baik dalam membangun solusi BYOM untuk algoritme khusus di SageMaker, penerapan pipeline ETL ujung ke ujung, membuat chatbot menggunakan Lex, berbagi sumber daya QuickSight lintas akun, dan membuat templat CloudFormation untuk penerapan. Dia suka menjelajahi AWS dengan menganggap setiap masalah pelanggan sebagai tantangan untuk mengeksplorasi lebih lanjut dan memberikan solusi kepada mereka.

Ajay Vishwakarma adalah seorang insinyur ML untuk bagian AWS dari praktik solusi AI Wipro. Dia memiliki pengalaman yang baik dalam membangun solusi BYOM untuk algoritme khusus di SageMaker, penerapan pipeline ETL ujung ke ujung, membuat chatbot menggunakan Lex, berbagi sumber daya QuickSight lintas akun, dan membuat templat CloudFormation untuk penerapan. Dia suka menjelajahi AWS dengan menganggap setiap masalah pelanggan sebagai tantangan untuk mengeksplorasi lebih lanjut dan memberikan solusi kepada mereka.

- Konten Bertenaga SEO & Distribusi PR. Dapatkan Amplifikasi Hari Ini.

- PlatoData.Jaringan Vertikal Generatif Ai. Berdayakan Diri Anda. Akses Di Sini.

- PlatoAiStream. Intelijen Web3. Pengetahuan Diperkuat. Akses Di Sini.

- PlatoESG. Karbon, teknologi bersih, energi, Lingkungan Hidup, Tenaga surya, Penanganan limbah. Akses Di Sini.

- PlatoHealth. Kecerdasan Uji Coba Biotek dan Klinis. Akses Di Sini.

- Sumber: https://aws.amazon.com/blogs/machine-learning/modernizing-data-science-lifecycle-management-with-aws-and-wipro/

- :memiliki

- :adalah

- $NAIK

- 1

- 10

- 100

- 11

- 12

- 212

- 300

- 32

- 7

- 8

- 804

- 9

- a

- Tentang Kami

- atas

- mempercepat

- dipercepat

- akselerator

- mengakses

- manajemen akses

- Menurut

- Akun

- Akun

- ketepatan

- Mencapai

- di seluruh

- Tindakan

- tambahan

- dialamatkan

- alamat

- Menambahkan

- Adopsi

- terhadap

- agregat

- AI

- AI / ML

- Alerts

- algoritma

- algoritma

- dialokasikan

- sepanjang

- juga

- Amazon

- Gerbang API Amazon

- Amazon QuickSight

- Amazon Web Services

- Layanan Web Amazon (AWS)

- Amazon.com

- an

- analisis

- analisis

- dan

- Lain

- Apa pun

- api

- Lebah

- Aplikasi

- aplikasi

- sesuai

- arsitektur

- ADALAH

- AS

- bertanya

- aspek

- terkait

- At

- atribut

- penulis

- mobil

- mengotomatisasikan

- Otomatis

- secara otomatis

- Otomatisasi

- tersedianya

- tersedia

- AWS

- Lem AWS

- Fungsi Langkah AWS

- kembali

- berdasarkan

- Dasar

- BE

- menjadi

- karena

- menjadi

- sebelum

- mulai

- makhluk

- Manfaat

- TERBAIK

- Lebih baik

- antara

- Terbesar

- blog

- kedua

- Cabang

- membawa

- Terbawa

- membangun

- Bangunan

- dibangun di

- built-in

- bis

- bisnis

- tapi

- by

- panggilan

- Panggilan

- CAN

- kemampuan

- Kapasitas

- menangkap

- mobil

- kasus

- pusat

- Pusat Keunggulan

- Sertifikasi

- menantang

- tantangan

- perubahan

- chatbots

- memeriksa

- diperiksa

- Cek

- klien

- klien

- awan

- kode

- Berbagi kode

- Berkolaborasi

- berkolaborasi

- kolaborasi

- COM

- kombinasi

- bergabung

- bagaimana

- datang

- nyaman

- berkomitmen

- padat

- lengkap

- Lengkap

- kompleks

- kompleksitas

- komponen

- komponen

- luas

- dilakukan

- konfigurasi

- konfigurasi

- dikonfigurasi

- hubungan

- Terhubung

- Menghubungkan

- pertimbangan

- kendala

- konsultan

- konsultasi

- Wadah

- kontinu

- kontrol

- Core

- Biaya

- membuat

- dibuat

- menciptakan

- membuat

- penciptaan

- Cross

- terbaru

- adat

- pelanggan

- pengalaman pelanggan

- pelanggan

- siklus

- dasbor

- dasbor

- data

- Data Analytics

- pemantauan data

- titik data

- ilmu data

- ilmuwan data

- kumpulan data

- memutuskan

- keputusan

- Pengambilan Keputusan

- didefinisikan

- keterlambatan

- menyampaikan

- pengiriman

- ketergantungan

- dikerahkan

- penyebaran

- penyebaran

- menjelaskan

- deskripsi

- dirancang

- diinginkan

- rincian

- menemukan

- terdeteksi

- mengembangkan

- dikembangkan

- berkembang

- Pengembangan

- DevOps

- berbeda

- penemuan

- membahas

- do

- tidak

- mendorong

- didorong

- selama

- setiap

- Terdahulu

- Efektif

- efektif

- efisiensi

- efisien

- usaha

- memberdayakan

- aktif

- diaktifkan

- memungkinkan

- meliputi

- akhir

- ujung ke ujung

- Titik akhir

- endpoint

- interaksi

- Pertunangan

- insinyur

- Teknik

- ditingkatkan

- memperkaya

- diperkaya

- memastikan

- memastikan

- Enterprise

- Seluruh

- Lingkungan Hidup

- lingkungan

- terutama

- penting

- menetapkan

- Eter (ETH)

- mengevaluasi

- dievaluasi

- Acara

- peristiwa

- akhirnya

- Setiap

- memeriksa

- contoh

- Keunggulan

- ada

- keluar

- harapan

- mempercepat

- pengalaman

- eksperimen

- keahlian

- menjelaskan

- menyelidiki

- Menjelajahi

- ekspor

- ekspor

- Menghadapi

- dihadapi

- memudahkan

- gagal

- Kegagalan

- lebih cepat

- Fitur

- Fitur

- beberapa

- Angka

- File

- File

- menyaring

- Menemukan

- Pertama

- aliran

- Fokus

- berikut

- Untuk

- Kerangka

- kerangka

- dari

- sepenuhnya

- fungsi

- fungsionalitas

- fungsi

- fungsi

- lebih lanjut

- pintu gerbang

- menghasilkan

- dihasilkan

- menghasilkan

- generasi

- generatif

- AI generatif

- mendapatkan

- GitHub

- Aksi

- baik

- pemerintahan

- diatur

- Tanah

- memiliki

- Menangani

- Memanfaatkan

- Memiliki

- he

- kepala

- membantu

- membantu

- membantu

- membantu

- High

- lebih tinggi

- -nya

- memegang

- Seterpercayaapakah Olymp Trade? Kesimpulan

- HTML

- HTTPS

- Penyesuaian Hyperparameter

- IAM

- identitas

- identitas dan manajemen akses

- if

- gambar

- implementasi

- diimplementasikan

- mengimplementasikan

- mengimplementasikan

- mengimpor

- in

- termasuk

- termasuk

- Termasuk

- Meningkatkan

- Meningkatkan

- inkremental

- industri

- industri

- Infrastruktur

- memulai

- inovatif

- memasukkan

- input

- wawasan

- contoh

- contoh

- terpadu

- Mengintegrasikan

- integrasi

- Intelijen

- gangguan

- ke

- memanggil

- melibatkan

- melibatkan

- terpencil

- masalah

- IT

- Pekerjaan

- Jobs

- ikut

- perjalanan

- json

- Notebook Jupyter

- kunci

- Terbaru

- jalankan

- diluncurkan

- lapisan

- Kepemimpinan

- terkemuka

- pelajar

- pengetahuan

- Tingkat

- siklus hidup

- 'like'

- 'like

- lokal

- tempat

- logika

- melihat

- TERLIHAT

- Rendah

- mesin

- Mesin belajar

- mempertahankan

- pemeliharaan

- membuat

- Membuat

- mengelola

- berhasil

- pengelolaan

- manajer

- pelaksana

- banyak

- Maksimalkan

- maksimum

- Mungkin..

- berarti

- medium

- Pelajari

- Anggota

- metode

- dengan cermat

- metrik

- Metrik

- mungkin

- bermigrasi

- migrasi

- minimum

- meringankan

- ML

- MLOps

- model

- model

- modern

- modernisasi

- Memantau

- pemantauan

- lebih

- Selain itu

- banyak

- beberapa

- harus

- nama

- Alam

- perlu

- Perlu

- dibutuhkan

- kebutuhan

- New

- berikutnya

- mencatat

- buku catatan

- laptop

- pemberitahuan

- pemberitahuan

- terjadi

- of

- Penawaran

- on

- Di atas kapal

- ONE

- terus-menerus

- hanya

- Buka

- open source

- operasional

- optimal

- or

- organisasi

- Lainnya

- jika tidak

- kami

- di luar

- Hasil

- keluaran

- secara keseluruhan

- sendiri

- Perdamaian

- paket

- Paralel

- parameter

- parameter

- pasangan

- rekan

- melewati

- bergairah

- untuk

- melakukan

- prestasi

- melakukan

- pipa saluran

- Tempat

- plato

- Kecerdasan Data Plato

- Data Plato

- poin

- Kebijakan

- kebijaksanaan

- portofolio

- Pos

- praktek

- diprediksi

- ramalan

- Prediksi

- perdana menteri

- siap

- kehadiran

- menyajikan

- sebelumnya

- harga pompa cor beton mini

- Prediksi Harga

- swasta

- Proaktif

- Masalah

- memproses

- proses

- pengolahan

- produktifitas

- promosi

- meminta

- memberikan

- disediakan

- pemberi

- menyediakan

- ketentuan

- tujuan

- Dorong

- terdorong

- kualitas

- Bacaan

- real-time

- data waktu nyata

- benar-benar

- menerima

- mengurangi

- referensi

- terdaftar

- mendaftar

- pendaftaran

- melepaskan

- keandalan

- tetap

- Pelaporan

- gudang

- permintaan

- permintaan

- wajib

- Persyaratan

- sumber

- Sumber

- itu

- tanggapan

- mengakibatkan

- Hasil

- pelatihan ulang

- dapat digunakan kembali

- Terungkap

- keras

- kuat

- rute

- Run

- berjalan

- berjalan

- pembuat bijak

- sama

- Skalabilitas

- terukur

- Skala

- skala

- menjadwalkan

- Ilmu

- ilmuwan

- ilmuwan

- mencetak gol

- script

- SDK

- mulus

- mulus

- Bagian

- aman

- keamanan

- seleksi

- mengirimkan

- senior

- mengirim

- terpisah

- yang telah dilayani

- Tanpa Server

- layanan

- Service Provider

- Layanan

- set

- pengaturan

- penyiapan

- Share

- berbagi

- harus

- ditunjukkan

- signifikan

- mirip

- Sederhana

- disederhanakan

- serentak

- kecil

- kelancaran

- larutan

- Solusi

- MEMECAHKAN

- Segera

- sumber

- Khusus

- Secara khusus

- bumbu

- membagi

- tumpukan

- Tumpukan

- Negara

- statis

- statistika

- statistik

- Status

- Langkah

- Stephen

- Tangga

- penyimpanan

- menyimpan

- tersimpan

- efisien

- merampingkan

- studio

- sukses

- seperti itu

- rangkaian

- dipasok

- mendukung

- Mendukung

- yakin

- sistem

- Mengambil

- Dibutuhkan

- pengambilan

- target

- tugas

- tim

- Anggota tim

- tim

- Teknis

- teknik

- Teknologi

- Teknologi

- template

- uji

- bahwa

- Grafik

- Negara

- mereka

- Mereka

- kemudian

- Sana.

- Ini

- mereka

- pihak ketiga

- ini

- itu

- ambang

- Melalui

- keluaran

- tingkat

- rapat

- waktu

- untuk

- terlalu

- alat

- alat

- tema

- Topik

- terhadap

- Pelatihan VE

- terlatih

- Pelatihan

- kereta

- Transformasi

- transformasi

- Tren

- triase

- dipicu

- kebenaran

- menyetel

- dua

- mengetik

- jenis

- memahami

- Memperbarui

- Pembaruan

- memperbarui

- menggunakan

- gunakan case

- bekas

- Pengguna

- kegunaan

- menggunakan

- MENGESAHKAN

- memvalidasi

- pengesahan

- nilai

- berbagai

- versi

- Versi

- PELANGGARAN

- maya

- visualisasi

- membayangkan

- ingin

- adalah

- Cara..

- we

- jaringan

- layanan web

- BAIK

- terdefinisi dengan baik

- adalah

- ketika

- kapan saja

- apakah

- yang

- sementara

- akan

- Sayap

- Wipro

- dengan

- dalam

- tanpa

- Kerja

- bekerja

- alur kerja

- Alur kerja

- bengkel

- penulisan

- tertulis

- XGBoost

- kamu

- Anda

- zephyrnet.dll