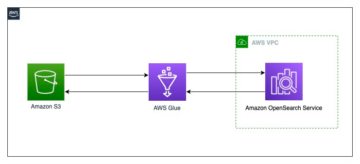

I dag lanserer vi Terraform-støtte for Amazon OpenSearch-inntak. Terraform er et verktøy for infrastruktur som kode (IaC) som hjelper deg med å bygge, distribuere og administrere skyressurser effektivt. OpenSearch Ingestion er en fullstendig administrert, serverløs datainnsamler som leverer logg-, metrikk- og sporingsdata i sanntid til Amazon OpenSearch-tjeneste domener og Amazon OpenSearch Serverless samlinger. I dette innlegget forklarer vi hvordan du kan bruke Terraform til å distribuere OpenSearch Ingestion-pipelines. Som et eksempel bruker vi en HTTP-kilde som input og en Amazon OpenSearch-tjeneste domene (indeks) som utdata.

Løsningsoversikt

Trinnene i dette innlegget distribuerer en offentlig tilgjengelig OpenSearch Ingestion-pipeline med Terraform, sammen med andre støtteressurser som trengs for at pipelinen skal kunne ta inn data i Amazon OpenSearch. Vi har implementert Veiledning: Innføring av data til et domene ved hjelp av Amazon OpenSearch Ingestion, ved hjelp av Terraform.

Vi oppretter følgende ressurser med Terraform:

Rørledningen du oppretter avslører en HTTP-kilde som input og en Amazon OpenSearch-vask for å lagre grupper med hendelser.

Forutsetninger

For å følge trinnene i dette innlegget trenger du følgende:

- En aktiv AWS-konto.

- Terraform installert på din lokale maskin. For mer informasjon, se Installer Terraform.

- De nødvendige IAM-tillatelsene som kreves for å opprette AWS-ressursene ved hjelp av Terraform.

- awscurl for å sende HTTPS-forespørsler gjennom kommandolinjen med AWS Sigv4 autentisering. For instruksjoner om hvordan du installerer dette verktøyet, se GitHub repo.

Lag en katalog

I Terraform administreres infrastruktur som kode, kalt en prosjekt. Et Terraform-prosjekt inneholder ulike Terraform-konfigurasjonsfiler, som f.eks main.tf, provider.tf, variables.tfog output.df . La oss lage en katalog på serveren eller maskinen som vi kan bruke til å koble til AWS-tjenester ved hjelp av AWS kommandolinjegrensesnitt (AWS CLI):

Bytt til katalogen.

Opprett Terraform-konfigurasjonen

Opprett en fil for å definere AWS-ressursene.

Skriv inn følgende konfigurasjon i main.tf og lagre filen din:

Lag ressursene

Initialiser katalogen:

Se gjennom planen for å se hvilke ressurser som vil bli opprettet:

Bruk konfigurasjonen og svar yes for å kjøre planen:

Prosessen kan ta rundt 7–10 minutter å fullføre.

Test rørledningen

Etter at du har opprettet ressursene, bør du se ingest_endpoint_url utgang vises. Kopier denne verdien og eksporter den i miljøvariabelen din:

Send prøvelogg med awscurl. Erstatt profilen med din passende AWS-profil for legitimasjon:

Du bør motta en 200 OK som et svar.

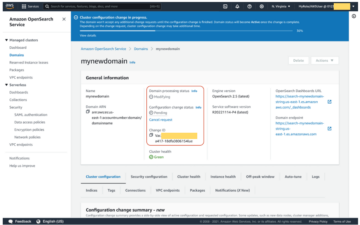

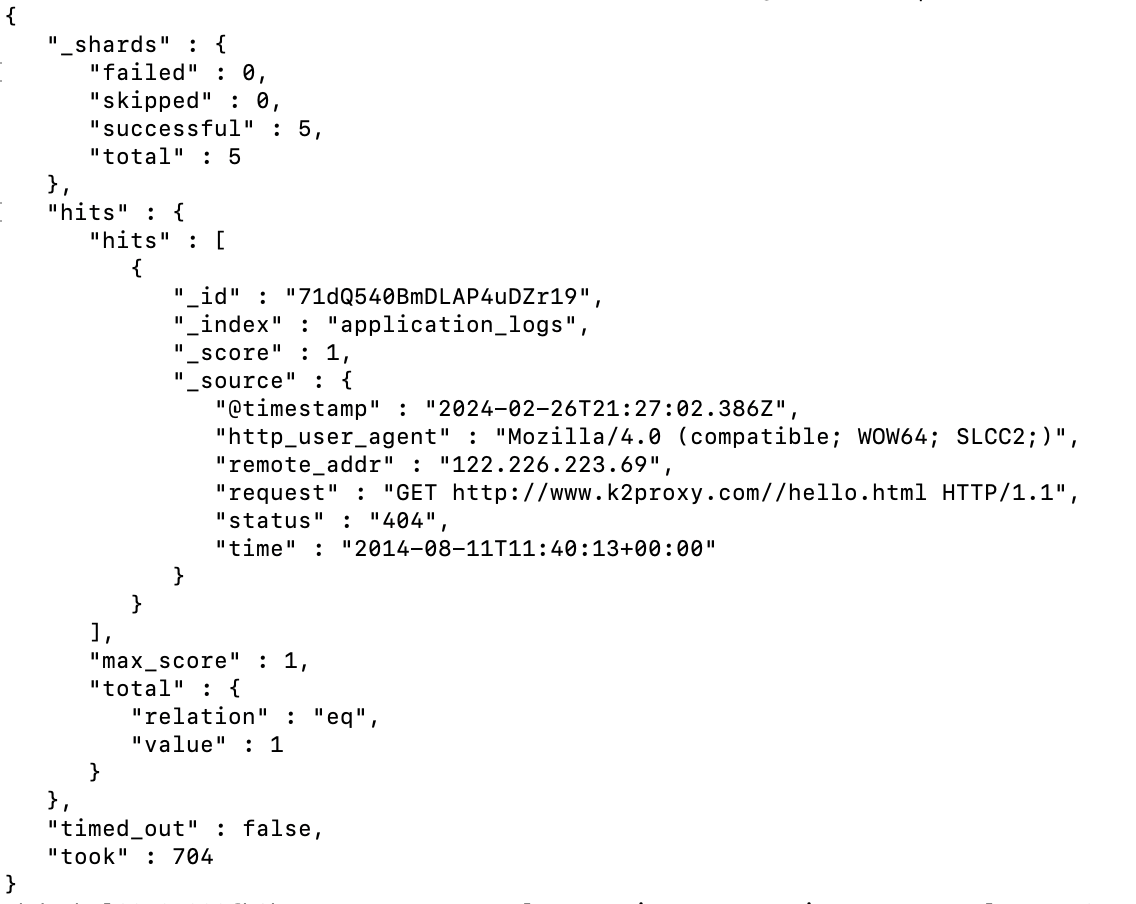

For å bekrefte at dataene ble inntatt i OpenSearch Ingestion-pipeline og lagret i OpenSearch, naviger til OpenSearch og få domeneendepunktet. Bytt ut <OPENSEARCH ENDPOINT URL> i kodebiten nedenfor og kjør den.

Du bør se utgangen som nedenfor:

Rydd opp

For å ødelegge ressursene du opprettet, kjør følgende kommando og svar yes når du blir bedt om det:

Prosessen kan ta rundt 30–35 minutter å fullføre.

konklusjonen

I dette innlegget viste vi hvordan du kan bruke Terraform til å distribuere OpenSearch Ingestion-pipelines. AWS tilbyr ulike ressurser slik at du raskt kan begynne å bygge rørledninger ved hjelp av OpenSearch Ingestion og bruke Terraform til å distribuere dem. Du kan bruke ulike innebygde rørledningsintegrasjoner å raskt innta data fra Amazon DynamoDB, Amazon administrerte strømming for Apache Kafka (Amazon MSK), Amazon Security Lake, Fluent Bit og mange flere. Følgende OpenSearch-inntak blåkopier lar deg bygge datapipelines med minimale konfigurasjonsendringer og enkelt administrere dem ved å bruke Terraform. For å lære mer, sjekk ut Terraform dokumentasjon for Amazon OpenSearch Ingestion.

Om forfatterne

Rahul Sharma er Technical Account Manager hos Amazon Web Services. Han er lidenskapelig opptatt av datateknologiene som bidrar til å utnytte data som en strategisk ressurs og er basert i New York by, New York.

Rahul Sharma er Technical Account Manager hos Amazon Web Services. Han er lidenskapelig opptatt av datateknologiene som bidrar til å utnytte data som en strategisk ressurs og er basert i New York by, New York.

Farhan Angullia er en skyapplikasjonsarkitekt ved AWS Professional Services, basert i Singapore. Han fokuserer først og fremst på moderne applikasjoner med mikroservice-programvaremønstre, og tar til orde for å implementere robuste CI/CD-praksiser for å optimere programvareleveransens livssyklus for kundene. Han liker å bidra til åpen kildekode Terraform-økosystemet på fritiden.

Farhan Angullia er en skyapplikasjonsarkitekt ved AWS Professional Services, basert i Singapore. Han fokuserer først og fremst på moderne applikasjoner med mikroservice-programvaremønstre, og tar til orde for å implementere robuste CI/CD-praksiser for å optimere programvareleveransens livssyklus for kundene. Han liker å bidra til åpen kildekode Terraform-økosystemet på fritiden.

Arjun Nambiar er produktsjef med Amazon OpenSearch Service. Han fokuserer på inntaksteknologier som gjør det mulig å innta data fra en lang rekke kilder til Amazon OpenSearch Service i stor skala. Arjun er interessert i distribuerte systemer i stor skala og skybaserte teknologier og er basert i Seattle, Washington.

Arjun Nambiar er produktsjef med Amazon OpenSearch Service. Han fokuserer på inntaksteknologier som gjør det mulig å innta data fra en lang rekke kilder til Amazon OpenSearch Service i stor skala. Arjun er interessert i distribuerte systemer i stor skala og skybaserte teknologier og er basert i Seattle, Washington.

Muthu Pitchaimani er en søkespesialist med Amazon OpenSearch Service. Han bygger søkeapplikasjoner og løsninger i stor skala. Muthu er interessert i temaene nettverk og sikkerhet, og er basert i Austin, Texas.

Muthu Pitchaimani er en søkespesialist med Amazon OpenSearch Service. Han bygger søkeapplikasjoner og løsninger i stor skala. Muthu er interessert i temaene nettverk og sikkerhet, og er basert i Austin, Texas.

- SEO-drevet innhold og PR-distribusjon. Bli forsterket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk deg selv. Tilgang her.

- PlatoAiStream. Web3 Intelligence. Kunnskap forsterket. Tilgang her.

- PlatoESG. Karbon, CleanTech, Energi, Miljø, Solenergi, Avfallshåndtering. Tilgang her.

- PlatoHelse. Bioteknologisk og klinisk etterretning. Tilgang her.

- kilde: https://aws.amazon.com/blogs/big-data/introducing-terraform-support-for-amazon-opensearch-ingestion/

- :er

- 00

- 1

- 10

- 100

- 14

- 16

- 2%

- 36

- 40

- 5

- 7

- 8

- 9

- a

- Om oss

- tilgjengelig

- Logg inn

- Handling

- aktiv

- talsmenn

- tillate

- langs

- Amazon

- Amazon Web Services

- an

- og

- besvare

- Apache

- Søknad

- søknader

- hensiktsmessig

- ER

- rundt

- AS

- eiendel

- At

- austin

- Autentisering

- AWS

- AWS profesjonelle tjenester

- basert

- BE

- under

- Bit

- Blogg

- bygge

- Bygning

- bygger

- innebygd

- som heter

- CAN

- Endringer

- sjekk

- City

- cli

- Cloud

- kode

- samlinger

- oppsamler

- COM

- kompatibel

- fullføre

- Konfigurasjon

- Koble

- inneholder

- medvirkende

- kopiere

- skape

- opprettet

- Credentials

- Gjeldende

- Kunder

- dato

- Dato

- definere

- leverer

- levering

- utplassere

- beskrivelse

- destinasjonen

- ødelegge

- katalog

- vises

- distribueres

- distribuerte systemer

- domene

- domener

- lette

- økosystem

- effekt

- effektivt

- muliggjøre

- aktivert

- Endpoint

- Miljø

- Eter (ETH)

- hendelser

- eksempel

- Forklar

- eksportere

- filet

- Filer

- fokuserer

- følge

- etter

- Til

- fra

- fullt

- få

- gitt

- Ha

- he

- hjelpe

- hjelper

- hans

- Vertskapet

- Hvordan

- HTML

- http

- HTTPS

- IAC

- IAM

- implementert

- implementere

- in

- indeks

- informasjon

- Infrastruktur

- inngang

- installerte

- installere

- instruksjoner

- interessert

- inn

- innføre

- IT

- DET ER

- stor

- storskala

- lansere

- LÆRE

- Leverage

- Livssyklus

- linje

- lokal

- logg

- maskin

- Hoved

- administrer

- fikk til

- leder

- mange

- metrisk

- mikrotjeneste

- kunne

- minimal

- minutter

- Moderne

- mer

- navn

- Naviger

- nødvendig

- Trenger

- nødvendig

- nettverk

- Ny

- New York

- New York City

- of

- Tilbud

- on

- åpen

- åpen kildekode

- Optimalisere

- or

- Annen

- ut

- produksjon

- lidenskapelig

- banen

- mønstre

- tillatelser

- rørledning

- fly

- plato

- Platon Data Intelligence

- PlatonData

- politikk

- Post

- praksis

- primært

- Principal

- prosess

- prosessor

- Produkt

- Produktsjef

- profesjonell

- Profil

- prosjekt

- leverandør

- offentlig

- raskt

- sanntids

- motta

- region

- erstatte

- anmode

- forespørsler

- påkrevd

- ressurs

- Ressurser

- svar

- robust

- Rolle

- Kjør

- sample

- Spar

- lagret

- Skala

- Søk

- Seattle

- sikkerhet

- se

- sending

- server

- server~~POS=TRUNC

- tjeneste

- Tjenester

- bør

- viste

- Singapore

- tekstutdrag

- Software

- Solutions

- kilde

- Kilder

- spesialist

- Begynn

- Uttalelse

- status

- Steps

- Strategisk

- streaming

- slik

- støtte

- Støtte

- Systemer

- Ta

- Teknisk

- Technologies

- terra

- test

- texas

- Det

- De

- Dem

- denne

- Gjennom

- tid

- til

- verktøy

- temaer

- spore

- sant

- bruke

- ved hjelp av

- verdi

- variabel

- variasjon

- ulike

- verifisere

- versjon

- var

- washington

- we

- web

- webtjenester

- Hva

- når

- bred

- vil

- med

- york

- du

- Din

- zephyrnet