Rótulos personalizados do Amazon Rekognition torna a detecção automática de ervas daninhas mais fácil. Em vez de localizar ervas daninhas manualmente, você pode automatizar o processo com Amazon Rekognition Custom Labels, que permite construir modelos de aprendizado de máquina (ML) que podem ser treinados com apenas um punhado de imagens e ainda são capazes de prever com precisão quais áreas de uma cultura têm ervas daninhas e precisam de tratamento. Isso economiza tempo, esforço e custos de tratamento de ervas daninhas aos agricultores.

Cada fazenda tem ervas daninhas. As ervas daninhas competem com as lavouras e, se não forem controladas, podem ocupar espaço precioso, luz solar, água e nutrientes das lavouras e reduzir seu rendimento. As ervas daninhas crescem muito mais rápido do que as lavouras e precisam de controle imediato e eficaz. A detecção de ervas daninhas nas lavouras é um processo demorado e demorado e, atualmente, é feito manualmente. Embora existam máquinas de pulverização de ervas daninhas que podem ser codificadas para ir a um local exato em um campo e pulverizar o tratamento de ervas daninhas apenas nesses pontos, o processo de localização onde essas ervas daninhas existem ainda não é automatizado.

A automação de localização de ervas daninhas não é um processo fácil. É aqui que entram a visão computacional e a IA. Reconhecimento da Amazônia é um serviço de visão por computador totalmente gerenciado que permite aos desenvolvedores analisar imagens e vídeos para uma variedade de casos de uso, incluindo identificação e verificação de rosto, inteligência de mídia, automação industrial personalizada e segurança no local de trabalho. A detecção de objetos e cenas personalizados pode ser difícil. Treinar e melhorar a precisão de um modelo de visão computacional requer uma grande quantidade de dados e é um problema complexo. O Amazon Rekognition Custom Labels permite detectar objetos e cenas com rótulos personalizados com apenas algumas imagens de treinamento.

Nesta postagem, usamos Amazon Rekognition Custom Labels para construir um modelo de ML que detecta ervas daninhas em plantações. No momento, estamos ajudando pesquisadores de uma universidade dos EUA a automatizar esse processo para agricultores locais.

Crie e treine um modelo de detecção de ervas daninhas

Resolvemos esse problema alimentando imagens de culturas com e sem ervas daninhas para Amazon Rekognition Custom Labels e construindo um modelo de ML. Depois que o modelo é construído e implantado, podemos realizar inferências alimentando as imagens do modelo das câmeras de campo. Desta forma, os agricultores podem automatizar a detecção de ervas daninhas em seus campos. Nossos experimentos mostraram que modelos altamente precisos podem ser construídos com apenas 32 imagens.

- No console do Amazon Rekognition, escolha Use rótulos personalizados.

- Escolha Projectos.

- Escolha Criar projeto.

- Escolha Nome do Projeto, insira um nome (por exemplo,

Weed-detection-in-crops). - Escolha Criar projeto.

Em seguida, criamos um conjunto de dados.

- No console Amazon Rekognition Custom Labels, escolha Conjuntos de dados.

- Escolha Criar conjunto de dados.

- Insira um nome para o seu conjunto de dados, como

crop-weed-ds. - Selecione o local dos dados de treinamento (para esta postagem, selecionamos Faça upload de imagens do seu computador).

- Escolha Adicionar imagens para fazer upload de suas imagens.

Para esta postagem, usamos 32 imagens de campo, das quais metade são imagens de culturas sem ervas daninhas e a outra metade são culturas infectadas com ervas daninhas.

- Depois de fazer upload de suas imagens de treinamento, escolha Adicionar rótulos para adicionar rótulos aos seus dados de treinamento.

Para esta postagem, definimos dois rótulos: good-crop e weed.

- Atribua às suas imagens carregadas um desses dois rótulos, dependendo do tipo de imagem.

- Salve essas alterações.

Agora rotulamos imagens para ambas as classes que definimos.

- Crie outro conjunto de dados para teste chamado

test-ds, que contém quatro imagens rotuladas para fins de teste.

Agora estamos prontos para treinar um novo modelo.

- Selecione o projeto que você criou e escolha Treinar novo modelo.

- Escolha o conjunto de dados de treinamento e o conjunto de dados de teste que você criou anteriormente.

- Escolha Trem.

Depois que o modelo é treinado, podemos ver seu desempenho. Nosso modelo foi quase perfeito, com uma pontuação F1 de 1.0. A precisão e o recall também foram 1.0.

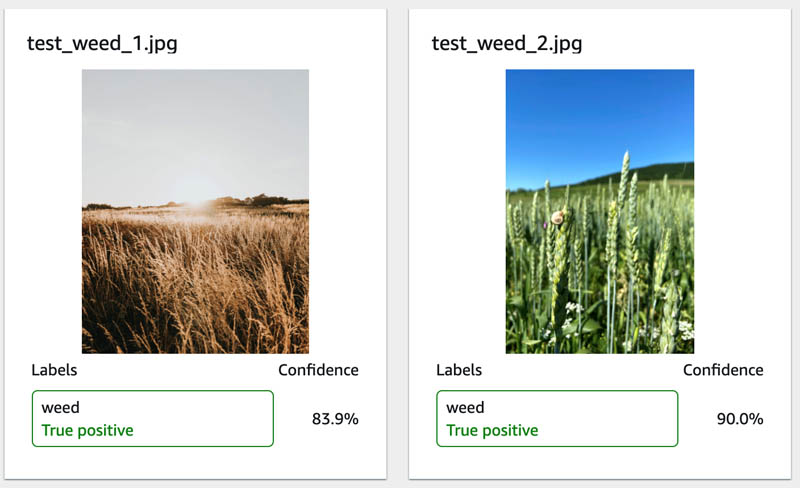

Podemos escolher Ver os resultados do teste para ver o desempenho desse modelo em nossos dados de teste. A captura de tela a seguir mostra que boas safras foram previstas com precisão, pois boas safras e safras infectadas com ervas daninhas foram detectadas como contendo ervas daninhas.

Teste o modelo por meio do seu navegador

Oferecemos um Formação da Nuvem AWS modelo no GitHub repo que permite testar o modelo por meio de um navegador. Escolha o modelo apropriado dependendo da sua região. O modelo inicia os recursos necessários para você testar o modelo

O modelo pede seu e-mail quando você o inicia. Quando o modelo está pronto, ele envia por e-mail as credenciais necessárias. O Saídas guia para a pilha do CloudFormation tem uma URL de site para testar o modelo.

- Na interface do navegador, escolha Comece o modelo.

- Insira 1 para unidades de inferência.

- Escolha Comece o modelo.

- Quando o modelo está em execução, você pode fazer upload de qualquer imagem para ele e obter resultados de classificação.

- Pare o modelo assim que seu teste for concluído.

Executar inferência usando o SDK

A inferência do modelo também é possível usando o SDK. O código a seguir é executado na mesma imagem da seção anterior:

Os resultados do uso do SDK são iguais aos anteriores no navegador:

Melhores práticas

Considere as seguintes práticas recomendadas ao usar rótulos personalizados do Amazon Rekognition:

- Use imagens de alta resolução

- Corte qualquer ruído de fundo na imagem

- Tenha um bom contraste entre o objeto que você está tentando detectar e outros objetos na imagem

- Exclua todos os recursos que você criou assim que seu projeto for concluído

Conclusão

Nesta postagem, mostramos como é possível automatizar a detecção de ervas daninhas em lavouras criando modelos de ML personalizados com Amazon Rekognition Custom Labels. Amazon Rekognition Custom Labels cuida de profundas complexidades de aprendizado nos bastidores, permitindo que você crie modelos de classificação de imagem poderosos com apenas um punhado de imagens de treinamento. Você pode melhorar a precisão do modelo aumentando o número de imagens em seus dados de treinamento e a resolução dessas imagens. Os agricultores podem implantar modelos como esses em suas máquinas de pulverização de ervas daninhas para reduzir o custo e o esforço manual. Para saber mais, incluindo outros casos de uso e tutoriais em vídeo, visite a página da web Amazon Rekognition Custom Labels.

Sobre o autor

Raju Penmatcha é arquiteto de soluções especialista sênior em AI / ML na AWS. Ele trabalha com clientes educacionais, governamentais e sem fins lucrativos em projetos relacionados ao aprendizado de máquina e inteligência artificial, ajudando-os a criar soluções usando a AWS. Quando não está ajudando os clientes, ele gosta de viajar para novos lugares.

Raju Penmatcha é arquiteto de soluções especialista sênior em AI / ML na AWS. Ele trabalha com clientes educacionais, governamentais e sem fins lucrativos em projetos relacionados ao aprendizado de máquina e inteligência artificial, ajudando-os a criar soluções usando a AWS. Quando não está ajudando os clientes, ele gosta de viajar para novos lugares.

- '

- "

- 100

- 11

- 7

- AI

- Permitindo

- Amazon

- Reconhecimento da Amazônia

- inteligência artificial

- Automatizado

- Automação

- AWS

- Por trás das cenas

- MELHOR

- melhores práticas

- navegador

- construir

- Prédio

- câmeras

- Cuidado

- casos

- classificação

- código

- Visão de Computador

- confiança

- custos

- Credenciais

- colheita

- culturas

- Clientes

- dados,

- deep learning

- Detecção

- desenvolvedores

- Educação

- Eficaz

- Rosto

- fazenda

- agricultores

- Campos

- Bom estado, com sinais de uso

- Governo

- Cresça:

- Alta

- Como funciona o dobrador de carta de canal

- HTTPS

- identificação

- imagem

- Incluindo

- industrial

- automação industrial

- Inteligência

- IT

- Rótulos

- grande

- lançamento

- lança

- APRENDER

- aprendizagem

- local

- localização

- aprendizado de máquina

- máquinas

- Mídia

- ML

- modelo

- Perto

- Ruído

- Sem fins lucrativos

- oferecer

- ordem

- Outros

- Precisão

- projeto

- projetos

- reduzir

- Recursos

- resposta

- Resultados

- corrida

- Segurança

- Sdk

- Soluções

- RESOLVER

- Espaço

- luz solar

- teste

- ensaio

- tempo

- Training

- tratamento

- tutoriais

- universidade

- us

- Verificação

- Vídeo

- VÍDEOS

- visão

- Água

- Site

- erva daninha

- Local de trabalho

- trabalho

- Produção