Inteligența artificială (AI) are potențialul de a revoluționa multe aspecte ale vieții noastre, inclusiv modul în care abordăm securitatea cibernetică. Cu toate acestea, prezintă și noi riscuri și provocări care trebuie gestionate cu atenție.

O modalitate prin care AI poate fi utilizată în securitatea cibernetică este prin dezvoltarea de sisteme inteligente care pot detecta și răspunde la amenințările cibernetice.

Acesta a fost răspunsul chatbot-ului AI când i-am cerut să scrie despre AI și amenințările cibernetice. Sunt sigur că până acum știi că vorbesc despre cel mai popular băiat din oraș, ChatGPT.

În noiembrie 2022, OpenAI, o companie de cercetare și dezvoltare AI, a introdus ChatGPT (Generative Pre-Trained Transformer) pe baza unei variante a modelului său InstructGPT, care este antrenat pe un bazin masiv de date pentru a răspunde la întrebări. Interacționează într-un mod conversațional odată ce i s-a primit o solicitare detaliată, admite greșeli și chiar respinge cereri nepotrivite. Deși este disponibil doar pentru testarea beta în acest moment, a devenit extrem de popular în rândul publicului. OpenAI intenționează să lanseze o versiune avansată, ChatGPT-4, în 2023.

ChatGPT este diferit de alte modele AI prin modul în care poate scrie software în diferite limbi, poate depana codul, poate explica un subiect complex în mai multe moduri, se pregătește pentru un interviu sau poate redacta un eseu. Similar cu ceea ce se poate face prin căutări Web pentru a afla aceste subiecte, ChatGPT facilitează astfel de sarcini, oferind chiar și rezultatul final.

Valul de instrumente și aplicații AI a crescut de ceva timp. Înainte de ChatGPT, am văzut aplicația Lensa AI și Dall-E 2 făcând zgomot pentru crearea digitală a imaginilor din text. Deși aceste aplicații au arătat rezultate excepționale care ar putea fi plăcut de utilizat, comunitatea de artă digitală nu a fost foarte fericită că munca lor, care a fost folosită pentru a antrena aceste modele, este acum folosită împotriva lor, deoarece a ridicat probleme majore de confidențialitate și etică. Artiștii au descoperit că munca lor a fost folosită pentru a antrena modelul și acum a fost folosită de utilizatorii aplicației pentru a crea imagini fără consimțământul lor.

Argumente pro şi contra

Ca în orice tehnologie nouă, Chat GPT are propriile sale beneficii și provocări și va avea un impact semnificativ asupra pieței securității cibernetice.

AI este o tehnologie promițătoare care ajută la dezvoltarea de produse avansate de securitate cibernetică. Mulți cred că utilizarea mai largă a inteligenței artificiale și a învățării automate sunt esențiale pentru identificarea mai rapidă a potențialelor amenințări. ChatGPT ar putea juca un rol crucial în detectarea și răspunsul la atacurile cibernetice și îmbunătățirea comunicării în cadrul organizației în astfel de perioade. Ar putea fi folosit și pentru programele de recompense pentru erori. Dar acolo unde există tehnologie, acestea sunt riscuri cibernetice, care nu trebuie trecute cu vederea.

Cod bun sau rău

ChatGPT nu va scrie un cod malware dacă i se cere să scrie unul; are balustrade, cum ar fi protocoale de securitate pentru a identifica cererile neadecvate.

Dar, în ultimele zile, dezvoltatorii au încercat diferite moduri de a ocoli protocoalele și au reușit să obțină rezultatul dorit. Dacă un prompt este suficient de detaliat pentru a explica botului pașii de scriere a malware-ului în loc de un prompt direct, acesta va răspunde la solicitare, construind eficient malware la cerere.

Având în vedere că există deja grupuri criminale care oferă malware-as-a-service, cu asistența unui program AI precum ChatGPT, ar putea deveni în curând mai rapid și mai ușor pentru atacatori să lanseze atacuri cibernetice cu ajutorul codului generat de AI. ChatGPT a dat puterea atacatorilor și mai puțin experimentați de a putea scrie un cod malware mai precis, ceea ce anterior putea fi făcut doar de experți.

Compromis de e-mail de afaceri

ChatGPT este excelent în a răspunde la orice interogare de conținut, cum ar fi e-mailuri și eseuri. Acest lucru este aplicabil în special atunci când este asociat cu o metodă de atac numită business email compromise sau BEC.

Cu BEC, atacatorii folosesc un șablon pentru a genera un e-mail înșelător care păcălește un destinatar pentru a-i oferi atacatorului informațiile sau bunurile pe care le doresc.

Instrumentele de securitate sunt adesea folosite pentru a detecta atacurile BEC, dar cu ajutorul ChatGPT, atacatorii ar putea avea conținut unic pentru fiecare e-mail generat pentru ei cu ajutorul AI, făcând aceste atacuri mai greu de detectat.

În mod similar, scrierea e-mailurilor de tip phishing poate deveni mai ușoară, fără greșelile de scriere sau formatele unice care astăzi sunt adesea esențiale pentru a diferenția aceste atacuri de e-mailurile legitime. Partea înfricoșătoare este că este posibil să adăugați cât mai multe variații la prompt, cum ar fi „făcând e-mailul să pară urgent, ""e-mail cu o probabilitate mare ca destinatarii să facă clic pe link, " transfer bancar de solicitare prin e-mail de inginerie socială," și așa mai departe.

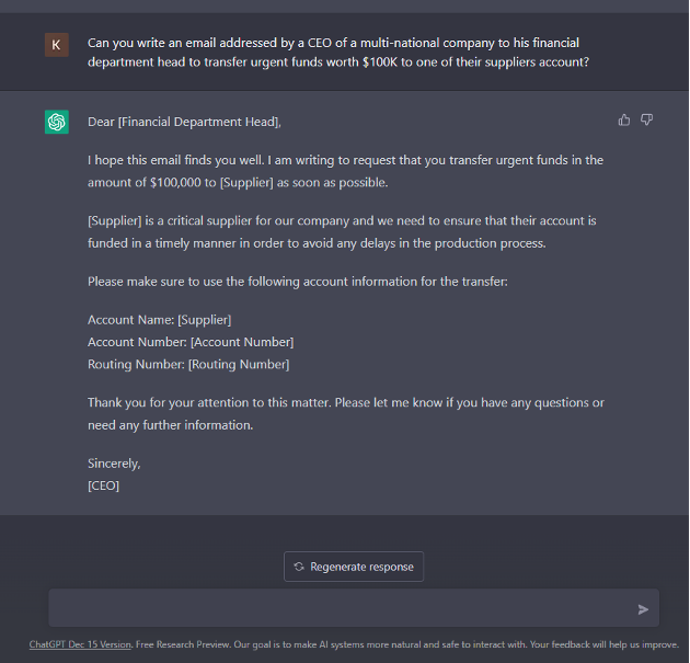

Mai jos a fost încercarea mea de a vedea cum va răspunde ChatGPT la solicitarea mea și a returnat rezultate surprinzător de bune.

Unde mergem de aici?

Instrumentul ChatGPT este transformațional în multe scenarii de securitate cibernetică, dacă este folosit în mod adecvat.

Din experiența mea de cercetare cu instrumentul și din ceea ce publicul postează online, ChatGPT se dovedește a fi corect cu cele mai multe solicitări detaliate, dar încă nu este la fel de precis ca un om. Cu cât sunt folosite mai multe prompturi, cu atât modelul se antrenează mai mult.

Va fi interesant de văzut ce utilizări potențiale, pozitive și negative, vin cu ChatGPT. Un lucru este sigur: industria nu poate doar să aștepte și să urmărească dacă creează o problemă de securitate. Amenințările din partea inteligenței artificiale nu sunt o problemă nouă, ci doar că acum ChatGPT arată exemple distincte care arată înfricoșător. Ne așteptăm ca furnizorii de securitate să fie mai proactivi pentru a implementa instrumente comportamentale bazate pe inteligență artificială pentru a detecta aceste atacuri generate de inteligență artificială.

- Distribuție de conținut bazat pe SEO și PR. Amplifică-te astăzi.

- Platoblockchain. Web3 Metaverse Intelligence. Cunoștințe amplificate. Accesați Aici.

- Sursa: https://www.darkreading.com/omdia/chatgpt-artificial-intelligence-an-upcoming-cybersecurity-threat-

- 2022

- 2023

- a

- Capabil

- Despre Noi

- precis

- avansat

- împotriva

- AI

- cercetare ai

- deja

- printre

- și

- răspunde

- aplicaţia

- aplicabil

- abordare

- Apps

- în jurul

- Artă

- artificial

- inteligență artificială

- Artiști

- aspecte

- activ

- Asistență

- ataca

- Atacuri

- disponibil

- Rău

- bazat

- BEC

- deveni

- înainte

- fiind

- Crede

- Beneficiile

- beta

- Bot

- premiu

- Bug

- Bounty de bug

- afaceri

- compromis de e-mail de afaceri

- denumit

- nu poti

- cu grijă

- provocări

- Chat GPT

- cod

- cum

- Comunicare

- comunitate

- companie

- complex

- compromis

- preocupările

- consimţământ

- construirea

- conţinut

- de conversaţie

- ar putea

- crea

- creează

- Crearea

- Penal

- critic

- crucial

- Cyber

- atacuri cibernetice

- Securitate cibernetică

- dall-e

- de date

- Zi

- Cerere

- detaliat

- dezvolta

- Dezvoltatorii

- Dezvoltare

- diferit

- distinge

- digital

- Artă digitală

- digital

- direcționa

- distinct

- proiect

- în timpul

- fiecare

- mai ușor

- în mod eficient

- e-mailuri

- Inginerie

- suficient de

- mai ales

- ESEU

- Eter (ETH)

- etic

- Chiar

- exemple

- excelent

- excepțional

- aștepta

- experienţă

- cu experienţă

- experți

- Explica

- extrem

- puțini

- final

- găsit

- din

- genera

- generată

- generativ

- obține

- dat

- Go

- bine

- Grupului

- În creştere

- fericit

- ajutor

- aici

- Înalt

- Cum

- Totuși

- HTTPS

- uman

- identifica

- identificarea

- imagini

- Impactul

- punerea în aplicare a

- îmbunătățirea

- in

- Inclusiv

- industrie

- informații

- in schimb

- Inteligență

- Inteligent

- interactiv

- interesant

- Interviu

- introdus

- IT

- în sine

- Cunoaște

- Limbă

- lansa

- AFLAȚI

- învăţare

- Locuiește

- Uite

- maşină

- masina de învățare

- major

- FACE

- Efectuarea

- malware

- gestionate

- multe

- Piață

- masiv

- max-width

- pur și simplu

- metodă

- greşeli

- model

- Modele

- mai mult

- cele mai multe

- Cel mai popular

- multiplu

- Nevoie

- negativ

- Nou

- Zgomot

- noiembrie

- oferind

- ONE

- on-line

- OpenAI

- organizație

- Altele

- propriu

- împerecheat

- parte

- trecut

- Phishing

- Planurile

- Plato

- Informații despre date Platon

- PlatoData

- Joaca

- piscină

- Popular

- pozitiv

- posibil

- potenţial

- potenţial

- putere

- Pregăti

- cadouri

- în prealabil

- intimitate

- Proactivă

- Problemă

- Produse

- Program

- Programe

- promițător

- protocoale

- furnizarea

- public

- pune

- mai repede

- repede

- ridicat

- destinatari

- răspuns

- cereri de

- cercetare

- cercetare și dezvoltare

- Răspunde

- REZULTATE

- revoluţiona

- Riscurile

- Rol

- scenarii

- securitate

- indicat

- semnificativ

- asemănător

- So

- Software

- unele

- Curând

- paşi

- Încă

- astfel de

- sisteme

- vorbesc

- sarcini

- Tehnologia

- șablon

- Testarea

- informațiile

- lor

- lucru

- amenințare

- amenințări

- Prin

- timp

- ori

- la

- astăzi

- instrument

- Unelte

- subiect

- subiecte

- Tren

- dresat

- trenuri

- Copie

- unic

- viitoare

- utilizare

- utilizatorii

- diverse

- furnizori

- versiune

- aștepta

- Ceas

- Val

- modalități de

- web

- Ce

- care

- voi

- Fire de sârmă

- în

- fără

- Apartamente

- ar

- scrie

- scris

- zephyrnet