Сьогодні ми раді повідомити, що моделі основи Meta Llama 3 доступні Amazon SageMaker JumpStart для розгортання та запуску висновку. Моделі Llama 3 — це набір попередньо підготовлених і точно налаштованих генеративних текстових моделей.

У цій публікації ми розглянемо, як виявити та розгорнути моделі Llama 3 за допомогою SageMaker JumpStart.

Що таке Meta Llama 3

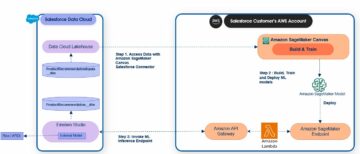

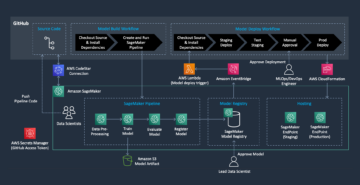

Llama 3 поставляється в двох розмірах параметрів — 8B і 70B з довжиною контексту 8k, — які можуть підтримувати широкий спектр варіантів використання з покращеними міркуваннями, генерацією коду та дотриманням інструкцій. Llama 3 використовує трансформаторну архітектуру лише декодера та новий токенизатор, який забезпечує покращену продуктивність моделі з розміром 128 Кб. Крім того, Meta вдосконалила процедури після тренінгу, які значно знизили рівень помилкових відмов, покращили узгодженість і збільшили різноманітність відповідей моделі. Тепер ви можете отримати сукупні переваги продуктивності Llama 3 і елементів керування MLOps за допомогою таких функцій Amazon SageMaker, як SageMaker Pipelines, SageMaker Debugger або журнали контейнерів. Крім того, модель буде розгорнуто в захищеному середовищі AWS під керуванням вашого VPC, допомагаючи забезпечити безпеку даних.

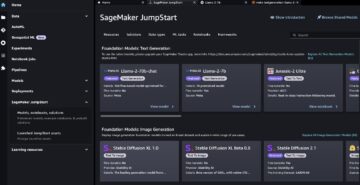

Що таке SageMaker JumpStart

За допомогою SageMaker JumpStart ви можете вибрати з широкого вибору загальнодоступних моделей основи. Практикуючі ML можуть розгортати базові моделі на виділених примірниках SageMaker із ізольованого мережевого середовища та налаштовувати моделі за допомогою SageMaker для навчання та розгортання моделей. Тепер ви можете відкривати та розгортати моделі Llama 3 кількома клацаннями миші Студія Amazon SageMaker або програмно за допомогою SDK SageMaker Python, що дає змогу отримувати продуктивність моделі та елементи керування MLOps за допомогою таких функцій SageMaker, як Трубопроводи SageMaker, Налагоджувач SageMaker, або контейнерні журнали. Модель розгортається в захищеному середовищі AWS і під керуванням вашого VPC, що допомагає забезпечити безпеку даних. Моделі Llama 3 доступні сьогодні для розгортання та виведення в Amazon SageMaker Studio в us-east-1 (Н. Вірджинія), us-east-2 (Огайо), us-west-2 (Орегон), eu-west-1 (Ірландія) і ap-northeast-1 (Токіо) Регіони AWS.

Відкрийте для себе моделі

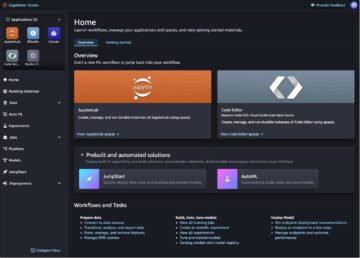

Ви можете отримати доступ до базових моделей через SageMaker JumpStart в інтерфейсі користувача SageMaker Studio та SageMaker Python SDK. У цьому розділі ми розглянемо, як знайти моделі в SageMaker Studio.

SageMaker Studio — це інтегроване середовище розробки (IDE), яке забезпечує єдиний візуальний веб-інтерфейс, де ви можете отримати доступ до спеціально створених інструментів для виконання всіх етапів розробки ML, від підготовки даних до створення, навчання та розгортання ваших моделей ML. Докладніше про те, як розпочати роботу та налаштувати SageMaker Studio, див Студія Amazon SageMaker.

У SageMaker Studio ви можете отримати доступ до SageMaker JumpStart, який містить попередньо навчені моделі, блокноти та готові рішення, у розділі Готові та автоматизовані рішення.

На цільовій сторінці SageMaker JumpStart ви можете легко знайти різні моделі, переглядаючи різні центри, названі на честь постачальників моделей. Ви можете знайти моделі Llama 3 в Meta hub. Якщо ви не бачите моделі Llama 3, оновіть версію SageMaker Studio, завершивши роботу та перезапустивши її. Для отримання додаткової інформації див Вимкніть і оновіть класичні програми Studio.

Ви можете знайти моделі Llama 3, ввівши в пошуковий рядок «Meta-llama-3» у верхньому лівому кутку.

Ви можете знайти всі моделі Meta, доступні в SageMaker JumpStart, натиснувши на Meta hub.

Натискання картки моделі відкриває відповідну сторінку деталей моделі, з якої ви можете легко розгорнути модель.

Розгорнути модель

Коли ви обираєте Розгортання і підтвердьте умови ліцензійної угоди, розпочнеться розгортання.

Ви можете відстежувати хід розгортання на сторінці, яка з’являється після натискання кнопки Розгорнути.

Можна також вибрати Відкрийте блокнот розгортати через приклад зошита. Приклад блокнота містить наскрізні вказівки щодо того, як розгорнути модель для висновків і очистити ресурси.

Щоб розгорнути використання ноутбука, ви починаєте з вибору відповідної моделі, зазначеної в model_id. Ви можете розгорнути будь-яку з вибраних моделей на SageMaker за допомогою наступного коду.

За замовчуванням accept_eula встановлений в False. Вам потрібно вручну прийняти ліцензійну угоду для успішного розгортання кінцевої точки. Роблячи це, ви приймаєте ліцензійну угоду користувача та політику прийнятного використання. Ви також можете знайти ліцензійну угоду Веб-сайт лами. Це розгортає модель на SageMaker із конфігураціями за замовчуванням, включаючи тип екземпляра за замовчуванням і конфігурації VPC за замовчуванням. Ви можете змінити цю конфігурацію, вказавши значення, відмінні від замовчування JumpStartModel. Щоб дізнатися більше, зверніться до наступного документація.

У наведеній нижче таблиці перераховано всі моделі Llama 3, доступні в SageMaker JumpStart разом із model_ids, типові екземпляри за замовчуванням і максимальна кількість загальних маркерів (сума кількості введених маркерів і кількості згенерованих маркерів), підтримуваних для кожної з цих моделей.

| Назва моделі | Ідентифікатор моделі | Максимальна загальна кількість токенів | Тип екземпляра за замовчуванням |

| Мета-лама-3-8B | meta-textgeneration-llama-3-8B | 8192 | мл.g5.12xвеликий |

| Meta-Llama-3-8B-Instruct | meta-textgeneration-llama-3-8B-instruct | 8192 | мл.g5.12xвеликий |

| Мета-лама-3-70B | meta-textgeneration-llama-3-70b | 8192 | ml.p4d.24xlarge |

| Meta-Llama-3-70B-Instruct | meta-textgeneration-llama-3-70b-instruct | 8192 | ml.p4d.24xlarge |

Виконайте висновок

Після розгортання моделі ви можете виконати висновок щодо розгорнутої кінцевої точки за допомогою предиктора SageMaker. Тонко налаштовані моделі інструкцій (Llama 3: 8B Instruct та 70B Instruct) приймають історію чатів між користувачем і помічником чату та генерують наступний чат. Попередньо навчені моделі (Llama 3: 8B і 70B) вимагають рядкової підказки та виконують завершення тексту за наданою підказкою.

Параметри висновку керують процесом генерації тексту в кінцевій точці. Нові токени Max контролюють розмір вихідних даних, створених моделлю. Це не те саме, що кількість слів, оскільки словниковий запас моделі не такий самий, як словниковий запас англійської мови, і кожна лексема може не бути словом англійської мови. Параметр температури контролює випадковість виходу. Більш висока температура призводить до більшої творчості та галюцинацій. Усі параметри висновку є необов’язковими.

Приклад підказок для моделі 70B

Ви можете використовувати моделі Llama 3 для завершення будь-якого тексту. За допомогою генерації тексту ви можете виконувати різноманітні завдання, наприклад відповідати на запитання, перекладати мовою, аналізувати настрої тощо. Вхідне навантаження на кінцеву точку виглядає так:

Нижче наведено кілька прикладів підказок і тексту, створеного моделлю. Усі виходи генеруються з параметрами висновку {"max_new_tokens":64, "top_p":0.9, "temperature":0.6}.

У наступному прикладі ми показуємо, як використовувати моделі Llama 3 з невеликою кількістю знімків у контексті навчання, де ми надаємо навчальні зразки, доступні для моделі. Ми виконуємо висновок лише для розгорнутої моделі та під час цього процесу, а ваги моделі не змінюються.

Приклад підказок для моделі 70B-Instruct

З моделями інструкцій Llama 3, оптимізованими для випадків використання діалогу, вхідними даними для кінцевих точок моделі інструкцій є попередня історія між помічником у чаті та користувачем. Ви можете задавати питання, пов’язані з розмовою, яка відбулася до цього часу. Ви також можете надати конфігурацію системи, як-от особи, які визначають поведінку помічника в чаті. Хоча формат вхідного корисного навантаження такий самий, як базова попередньо навчена модель, вхідний текст має бути відформатований у такий спосіб:

У цьому шаблоні інструкції ви можете почати з a system роль і включити в покрокову історію стільки змінних ролей, скільки забажаєте. Остаточна роль повинна бути завжди assistant і закінчується двома новими переходами рядка.

Далі розглянемо кілька прикладів підказок і відповідей моделі. У наступному прикладі користувач ставить просте запитання помічнику.

У наступному прикладі користувач веде розмову з помічником про туристичні місця в Парижі. Потім користувач запитує про перший варіант, рекомендований помічником у чаті.

У наступних прикладах ми встановлюємо конфігурацію системи.

Прибирати

Після того, як ви завершите роботу блокнота, обов’язково видаліть усі ресурси, які ви створили в процесі, щоб виставлення рахунків припинилося. Використовуйте наступний код:

Висновок

У цій публікації ми показали вам, як розпочати роботу з моделями Llama 3 у SageMaker Studio. Тепер у вас є доступ до чотирьох моделей основи Llama 3, які містять мільярди параметрів. Оскільки базові моделі попередньо навчені, вони також можуть допомогти знизити витрати на навчання та інфраструктуру, а також уможливити налаштування для вашого випадку використання. Перевірити SageMaker JumpStart у SageMaker Studio, щоб почати.

Про авторів

Кайл Ульріх є прикладним науковцем II в AWS

Сінь Хуан є старшим науковим співробітником AWS

Цин Лан є старшим інженером-розробником програмного забезпечення в AWS

Хаотян Ан є інженером-розробником програмного забезпечення II в AWS

Крістофер Віттен є інженером з розробки програмного забезпечення II в AWS

Тайлер Остерберг є інженером із розробки програмного забезпечення I в AWS

Манан -шах є менеджером з розробки програмного забезпечення в AWS

Джонатан Гінегань є старшим інженером-розробником програмного забезпечення в AWS

Адріана Сіммонс є старшим менеджером з маркетингу продуктів в AWS

Джун Вон є старшим менеджером із продуктів в AWS

Ашиш Хетан є старшим науковим співробітником AWS

Рачна Чадха є головним архітектором рішень – AI/ML в AWS

Діпак Рупакула є головним спеціалістом GTM в AWS

- Розповсюдження контенту та PR на основі SEO. Отримайте посилення сьогодні.

- PlatoData.Network Vertical Generative Ai. Додайте собі сили. Доступ тут.

- PlatoAiStream. Web3 Intelligence. Розширення знань. Доступ тут.

- ПлатонЕСГ. вуглець, CleanTech, Енергія, Навколишнє середовище, Сонячна, Поводження з відходами. Доступ тут.

- PlatoHealth. Розвідка про біотехнології та клінічні випробування. Доступ тут.

- джерело: https://aws.amazon.com/blogs/machine-learning/meta-llama-3-models-are-now-available-in-amazon-sagemaker-jumpstart/

- : має

- :є

- : ні

- :де

- $UP

- 1

- 10

- 11

- 120

- 19

- 2%

- 360-градус

- 4

- 42

- 5

- 7

- 8

- 8k

- 9

- a

- МЕНЮ

- Прийняти

- прийнятний

- доступ

- доступною

- визнавати

- додавати

- доданий

- доповнення

- Переваги

- після

- знову

- проти

- Угода

- AI / ML

- вирівнювання

- ВСІ

- по

- Також

- завжди

- am

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Студія Amazon SageMaker

- Amazon Web Services

- атмосфера

- an

- аналіз

- та

- та інфраструктури

- Оголосити

- відповідь

- відповідь

- будь-який

- Apple

- прикладної

- відповідний

- архітектура

- ЕСТЬ

- Art

- AS

- запитати

- запитувач

- Помічник

- асоційований

- At

- атмосфера

- залучення

- пам'ятки

- Автоматизований

- доступний

- уникнути

- AWS

- база

- BE

- ведмідь

- красивий

- оскільки

- було

- поведінка

- Пекін

- Вірити

- між

- біллінг

- мільярди

- Box

- ламається

- захоплюючи дух

- широкий

- Зламаний

- Перегляд

- Створюємо

- побудований

- але

- button

- by

- Виклики

- CAN

- капітал

- карта

- випадок

- випадків

- зміна

- чат

- коти

- перевірка

- Вибирати

- Місто

- classic

- очистити

- натиснувши

- код

- збір

- поєднання

- комбінований

- приходить

- Комунікація

- завершення

- конфігурація

- конфігурації

- Вважати

- узгодженість

- постійна

- містити

- Контейнер

- містить

- контекст

- контекстуальний

- постійно

- контроль

- управління

- Зручний

- Розмова

- Відповідний

- витрати

- незліченна кількість

- створювати

- створений

- Креатив

- вирішальне значення

- культура

- Чашка

- Клієнти

- настройка

- налаштувати

- дані

- безпеку даних

- de

- Палуби

- присвячених

- дефолт

- визначати

- видаляти

- розгортання

- розгорнути

- розгортання

- розгортання

- розгортає

- дрейф

- бажаний

- напрямки

- деталь

- деталі

- Розробник

- розробка

- Діалог

- різниця

- різний

- вечері

- відкрити

- різноманітність

- do

- байдуже

- справи

- Дон

- зроблений

- подвоєний

- вниз

- під час

- Сутінки

- e

- кожен

- легко

- зусилля

- включіть

- дозволяє

- кінець

- кінець в кінець

- Кінцева точка

- кінцеві точки

- інженер

- Машинобудування

- англійська

- досить

- забезпечення

- Навколишнє середовище

- Ефір (ETH)

- Навіть

- Кожен

- все

- приклад

- Приклади

- збуджений

- досвід

- ярмарок

- false

- знаменитий

- далеко

- подвиг

- ознаками

- риси

- ноги

- кілька

- фільми

- остаточний

- знайти

- Перший

- смак

- Поплавок

- потік

- після

- ніжка

- для

- формат

- фонд

- чотири

- Франція

- французька

- свіжий

- від

- Загальне

- Загальна теорія відносності

- породжувати

- генерується

- покоління

- генеративний

- ніжний

- німецька

- отримати

- скло

- Go

- буде

- поступово

- великий

- новаторський

- керівництво

- керуватися

- траплятися

- сталося

- Жорсткий

- важка робота

- Мати

- здоровий

- допомога

- допомогу

- тут

- вище

- історичний

- історія

- тримати

- Головна

- годину

- житло

- Як

- How To

- HTML

- HTTPS

- Концентратор

- концентратори

- i

- знакових

- if

- ii

- імпорт

- вражаючий

- поліпшений

- поліпшення

- in

- включати

- У тому числі

- Augmenter

- збільшений

- зростаючий

- інформація

- Інфраструктура

- інгредієнти

- вхід

- екземпляр

- випадки

- негайно

- інтегрований

- інтерфейс

- в

- Ірландія

- ізольований

- IT

- ЙОГО

- JPG

- просто

- тримати

- Знати

- відомий

- посадка

- цільової сторінки

- орієнтири

- мова

- найбільших

- запуск

- Законодавство

- УЧИТЬСЯ

- вивчення

- залишити

- довжина

- ліцензія

- життя

- Піднятий

- світло

- легше

- вогнів

- як

- Лінія

- списки

- літератури

- трохи

- жити

- Місце проживання

- Лама

- розташований

- ВИГЛЯДИ

- серія

- знизити

- made

- зробити

- Робить

- менеджер

- манера

- вручну

- багато

- Маркетинг

- Макс

- максимальний

- Може..

- сенс

- повідомлення

- Meta

- опівночі

- протокол

- змішувач

- суміш

- ML

- MLOps

- модель

- Моделі

- монітор

- більше

- найбільш

- Найбільш популярний

- багато

- музей

- Музеї

- Названий

- Необхідність

- необхідний

- мережу

- Нові

- наступний

- ніч

- немає

- ноутбук

- ноутбуки

- зараз

- номер

- NY

- спостереження

- спостерігачі

- відбуваються

- of

- пропонувати

- пропонує

- Пропозиції

- часто

- Огайо

- Нафта

- on

- ONE

- тільки

- Відкриється

- оптимальний

- оптимізований

- варіант

- or

- порядок

- Орегон

- інші

- наші

- нести

- з

- вихід

- виходи

- над

- сторінка

- параметр

- параметри

- Паріс

- частина

- виконувати

- продуктивність

- Фізика

- частина

- місце

- plato

- Інформація про дані Платона

- PlatoData

- грав

- будь ласка

- політика

- популярний

- пошта

- Прогноз

- підготовка

- попередній

- Головний

- Процедури

- процес

- Product

- менеджер по продукції

- Профілі

- прогрес

- підказок

- Пропозиції

- забезпечувати

- за умови

- провайдери

- забезпечує

- громадськість

- громадський транспорт

- публічно

- мета

- put

- Python

- питання

- питань

- випадковість

- діапазон

- ставки

- RE

- досяг

- міркування

- Причини

- рецепт

- рекомендований

- Знижений

- послатися

- відмова

- що стосується

- райони

- відносності

- вимагати

- ресурс

- ресурси

- відповіді

- результати

- Річка

- Роль

- ролі

- романтика

- Кімната

- прогін

- біг

- s

- мудрець

- Трубопроводи SageMaker

- сіль

- то ж

- зразок

- say

- вчений

- Sdk

- Пошук

- Грати короля карти - безкоштовно Nijumi логічна гра гри

- другий

- розділ

- безпечний

- безпеку

- побачити

- обраний

- вибирає

- вибір

- старший

- настрій

- Послуги

- виступаючої

- комплект

- кілька

- Форма

- постріл

- Повинен

- Показувати

- показав

- Шоу

- значний

- простий

- просто

- один

- сайти

- Розмір

- розміри

- сповільнювати

- Повільно

- згладити

- So

- так далеко

- Софтвер

- розробка програмного забезпечення

- рішення

- Рішення

- деякі

- іскритися

- спеціальний

- спеціаліст

- зазначений

- уточнюючи

- швидкість

- Spot

- стояти

- становище

- старт

- почалася

- Штати

- стійкий

- заходи

- Стоп

- зупинений

- потік

- рядок

- структура

- студія

- Приголомшливий

- наступні

- по суті

- Успішно

- такі

- сума

- підтримка

- Підтриманий

- Переконайтеся

- символ

- система

- T

- таблиця

- кравець

- Приймати

- приймає

- взяття

- завдання

- ключі

- команда

- шаблон

- terms

- текст

- генерація тексту

- дякувати

- Що

- Команда

- Капітал

- світ

- потім

- теорія

- Там.

- Ці

- вони

- тонкий

- це

- тисячі

- через

- час

- до

- сьогодні

- разом

- знак

- Жетони

- Токіо

- занадто

- інструменти

- топ

- Усього:

- Тур

- Башта

- Навчання

- трансформатор

- переводити

- Переклад

- транспорт

- два

- тип

- Типи

- ui

- при

- створеного

- до

- Оновити

- використання

- використання випадку

- користувач

- використовує

- використання

- Цінний

- Цінності

- варіації

- різноманітність

- різний

- версія

- дуже

- через

- думки

- Віргінія

- візуальний

- обсяг

- vs

- ходити

- хотів

- війна

- було

- вода

- способи

- we

- Web

- веб-сервіси

- Web-Based

- весілля

- ДОБРЕ

- пішов

- Що

- коли

- який

- в той час як

- білий

- чому

- волі

- windows

- ВИНО

- з

- дивуватися

- слово

- слова

- Work

- світ

- ви

- вашу

- зефірнет